Gioco d'azzardo IPO di Anthropic: Nel momento più improbabile, ha scelto di dire di no

Immagina questo scenario.

Sei in ritardo di tre mesi con le bollette, sei andato in ospedale il mese scorso, hai presentato le tasse diligentemente ogni anno. Queste cose sembrano non correlate.

Ma in un certo sistema di IA, queste tre informazioni vengono aggregate, generando un punto rosso su una mappa. Quel punto rosso rappresenta la tua posizione e una direttiva delle forze dell'ordine che ti mira.

Non è fantascienza. All'inizio del 2026, gli Stati Uniti L'Agenzia federale per l'immigrazione ha effettuato un'operazione di rastrellamento su larga scala a Minneapolis, alimentata da questa logica. Il sistema di IA pertinente proviene da una società di dati chiamata Palantir, che integra le cartelle cliniche, le bollette e le informazioni fiscali degli immigrati in un algoritmo, delineando freddamente gli obiettivi di inseguimento uno per uno.

L'IA viene usata come arma. Non un tempo futuro, ma presente.

La questione non è più se accadrà, ma chi ha il diritto di decidere cosa può o non può fare.

Il 27 febbraio 2026, quella domanda ha ricevuto una risposta inquietante.

Quel giorno, una società chiamata Anthropic, una società di IA, lo sviluppatore del prodotto di IA conversazionale Claude, un concorrente al livello di ChatGPT, fu formalmente bandita dal governo degli Stati Uniti. Il motivo del divieto era il suo rifiuto di consentire che la sua IA venisse utilizzata per monitorare i cittadini degli Stati Uniti e decidere autonomamente gli obiettivi da eliminare.

È stato classificato come un "rischio per la sicurezza nazionale" perché diceva: "Non può essere usato in questo modo".

Ciò di cui un'azienda ha più bisogno per prepararsi a un'IPO

Prima di rispondere "Perché Anthropic non scenderebbe a compromessi", è necessario capire a che punto è ora.

Anthropic è una delle aziende IA più apprezzate al mondo, valutata $380 miliardi, con un fatturato di $14 miliardi nel 2025. Il suo maggiore azionista è Amazon, con una quota superiore a qualsiasi altro azionista. Il suo modello IA Claude è uno dei prodotti IA in più rapida crescita nel mercato aziendale attualmente.

Sotto ogni punto di vista, questa è un'azienda pronta a quotarsi in borsa. Infatti, Anthropic si sta preparando per un'IPO di quest'anno, consentendo alla gente comune di acquistare le sue azioni.

Di cosa ha più bisogno un'azienda che si prepara per un'IPO? La risposta richiede poca riflessione: stabilità, prevedibilità e nessun problema normativo. Qualsiasi evento negativo potrebbe influire sulla fiducia degli investitori nella società e quindi deprimere il prezzo dell'IPO.

Poi, le cose hanno preso una piega completamente opposta.

Nel luglio 2025, il Pentagono ha assegnato contemporaneamente un contratto fino a $200 milioni ad Anthropic, OpenAI (sviluppatore di ChatGPT), Google e xAI di Musk, con l'obiettivo di integrare l'IA all'avanguardia nel sistema militare degli Stati Uniti. Si è trattato del più grande appalto pubblico nella storia dell'IA.

In particolare, il contratto di Anthropic conteneva un dettaglio che le altre tre società non avevano. Ha esplicitamente indicato due restrizioni d'uso: Claude non poteva essere utilizzato per la sorveglianza di massa dei cittadini americani o per sistemi di armi autonomi senza la supervisione umana.

OpenAI, Google, xAI, tutti d'accordo sul fatto che i militari possono utilizzare l'IA per tutti gli scopi legali senza ulteriori limitazioni. Solo Anthropic ha disegnato due linee rosse nel contratto.

Queste due linee rosse divennero poi il punto di partenza di tutti i problemi.

Ultimatum

Nel febbraio 2026, il Pentagono ha deciso di fare pressione su Anthropic.

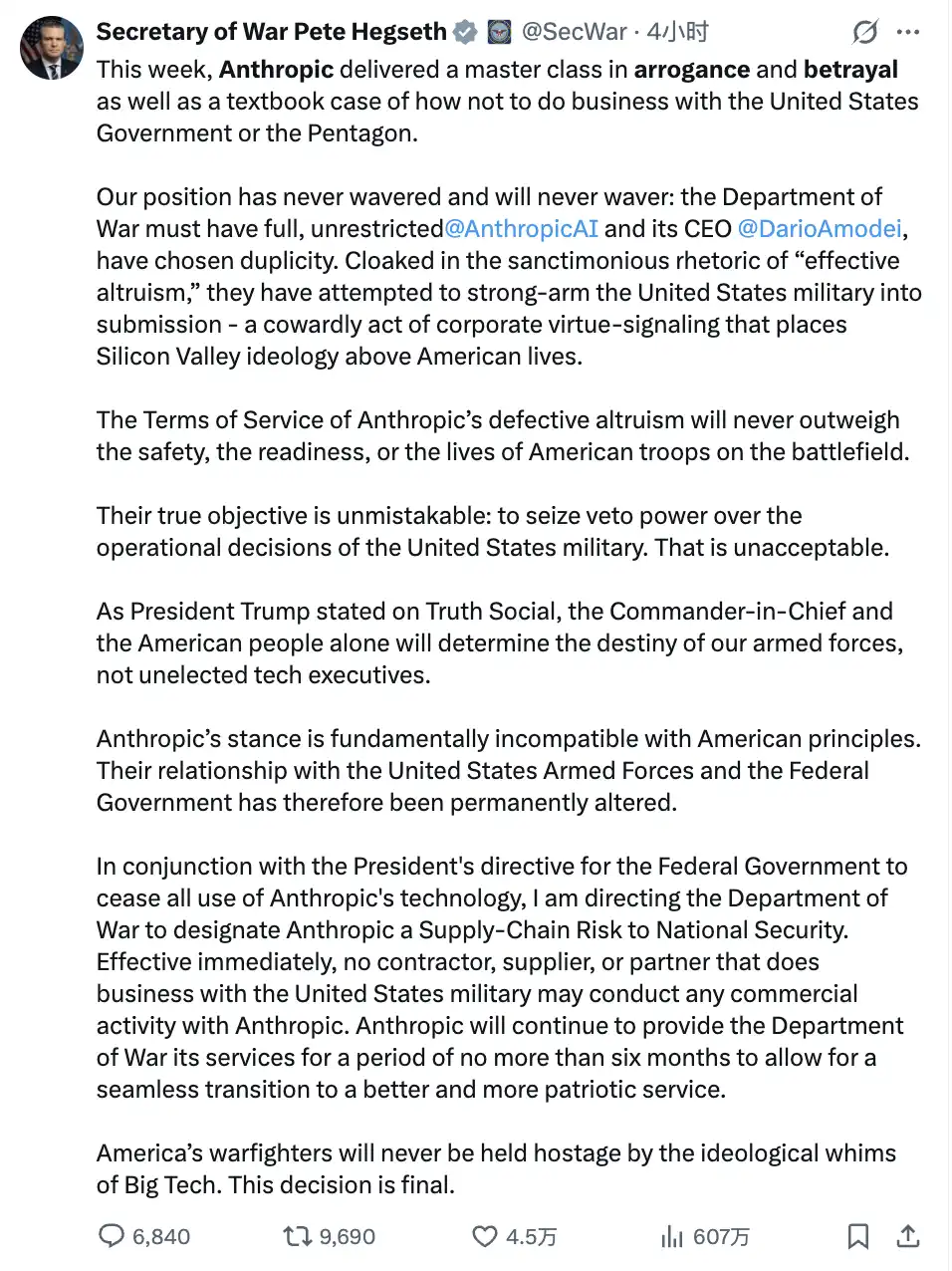

Il segretario alla Difesa Pete Hegseth ha lanciato un ultimatum al CEO di Anthropic, Dario Amodei: rimuovere le restrizioni d'uso dal contratto, consentendo a Claude di essere utilizzato per tutti gli scopi legali. Altrimenti, il Pentagono annullerebbe il contratto e designerebbe Anthropic come "rischio per la catena di fornitura". La scadenza era il 27 febbraio.

La risposta di Dario è stata: No, no.

In una dichiarazione pubblica, scrisse: "Comprendiamo che le decisioni militari sono prese dal governo, non dalle imprese private. Ma in pochissimi casi, riteniamo che l'IA possa minare i valori democratici anziché difenderli. Abbiamo la coscienza pulita e non possiamo accettare le loro richieste".

Emil Michael, il capo tecnologico del Pentagono, ha poi postato sui social media, definendo Dario un imbroglione, accusandolo di avere un complesso divino e cercando di controllare personalmente l'esercito americano, mettendo a rischio la sicurezza nazionale.

Poi è arrivato Trump stesso. Ha scritto sulla sua piattaforma social, Truth Social, che Anthropic era una "società di risveglio della sinistra radicale", aveva "commesso un errore catastrofico" e aveva ordinato: a tutte le agenzie governative federali di cessare immediatamente di utilizzare tutti i prodotti di Anthropic, con una transizione da completare entro 6 mesi.

Il Pentagono ha prontamente classificato Antropico come un "rischio per la catena di fornitura".

Questa etichetta in precedenza era utilizzata solo per contrassegnare le aziende relative ad avversari stranieri come la Cina. È stato utilizzato per Huawei e SMIC. Ora è il turno di una società americana di IA con sede a San Francisco con una valutazione di $380 miliardi.

200 milioni sono un problema minore, il vero problema è qui

La reazione iniziale di molte persone è stata: perdere un contratto governativo da $200 milioni è solo una piccola frazione per Anthropic con $14 miliardi di entrate annue.

Questa valutazione è corretta, ma l'attenzione è sbagliata.

Il vero impatto deriva dall'etichetta stessa di "rischio della supply chain". Significa che qualsiasi azienda che collabora con l'esercito americano deve dimostrare che la propria attività non ha coinvolto Anthropic. Non si tratta di una pressione etica morbida, ma di un requisito di conformità rigoroso.

Seguendo questa linea di pensiero al ribasso, la portata dell'impatto inizia a sembrare meno ottimistica.

Amazon Web Services è la principale infrastruttura operativa di Claude e anche il più grande fornitore di cloud per il governo degli Stati Uniti, con una profonda integrazione tra i due. La società di analisi dei dati Palantir, mentre serve l'esercito e le agenzie di intelligence americane, incorpora Claude. La società tecnologica di difesa Anduril elabora i dati utilizzando Claude in progetti relativi al Pentagono.

Questi clienti ora devono fare una scelta: continuare a utilizzare Claude, affrontando la pressione della collaborazione con un'azienda di "rischio della supply chain", o sostituire Claude, uno strumento profondamente integrato nei loro flussi di lavoro.

Entrambe le opzioni sono perdite per Anthropic. Questo è il vero rischio che deve essere gestito, molto più preoccupante dell'importo del contratto di $200 milioni.

Tutti questi problemi stanno accadendo prima dell'IPO.

Perché il rifiuto è ancora avvenuto

La situazione sta diventando intrigante.

Una società in corsa verso un'IPO, l'ultima cosa di cui ha bisogno in questo momento critico sono i guai, ma ha scelto di affrontare frontalmente le pressioni del governo. Si tratta di un errore di valutazione aziendale o di una scommessa calcolata?

Mettere le due opzioni una accanto all'altra rende la logica più chiara.

Se scendono a compromessi, il contratto viene salvato, i rapporti governativi vengono mantenuti e i guai immediati scompaiono. Ma la narrativa più importante del brand Anthropic degli ultimi tre anni - "la società IA più responsabile", "la sicurezza prima di tutto" - svilupperà una crepa in questo momento.

Il rischio maggiore non è immediato. Una volta che Claude sarà effettivamente utilizzato per la sorveglianza su larga scala o per prendere decisioni autonome sulle armi, una volta verificato un incidente, la perdita non sarà solo un contratto, ma l'intera tesi di valutazione dell'azienda. Il premio che gli investitori hanno inizialmente pagato per la storia di "IA responsabile" evaporerà durante la notte.

Se rifiutato, perdere $200 milioni, attivare un'etichetta di rischio per la supply chain e chiudere il mercato governativo. Ma la narrativa del marchio "Safety First" ha ricevuto l'approvazione pubblica più costosa della storia. Nessun budget di pubbliche relazioni potrebbe comprare questo effetto, essendo vietato dal governo per aver rifiutato all'IA di monitorare i cittadini del paese.

C'è una frase nella dichiarazione di Dario che vale la pena sottolineare: "La nostra valutazione e le nostre entrate aumentano solo dopo questa presa di posizione".

Questa frase è una dichiarazione di pubbliche relazioni o un giudizio commerciale? Potrebbero essere entrambi, ma non sono contraddittori.

C'è un controesempio da considerare. Palantir, la società di dati citata in precedenza che ha utilizzato l’IA per aiutare l’agenzia federale per l’immigrazione a tracciare gli obiettivi, ha preso una strada completamente opposta. Ha soddisfatto profondamente ogni richiesta del governo, essendo aperto al tracciamento dell'immigrazione, all'analisi dei servizi segreti e all'individuazione di obiettivi militari. Di conseguenza, è stato evitato dal circolo di capitali socialmente responsabile per quasi vent'anni, incapace di raccogliere fondi per molto tempo, e escluso da fondi importanti.

Poi, nel 2024, quando la narrativa militare IA è diventata la storia principale del mercato, il suo prezzo azionario è aumentato del 150% in un anno e il suo valore di mercato ha superato i 400 miliardi di dollari.

Due percorsi, due destini, ognuno con la sua logica. Palantir ha scambiato vent'anni di pazienza per l'esplosione di oggi. Anthropic sta scommettendo su una logica di valutazione diversa: nell'odierna competizione omogenea sempre più agguerrita tra le aziende IA, l'"IA più sicura" non è solo una posizione etica, ma un fossato commerciale reale.

Quale scommessa sia più grande è ancora sconosciuta. Ma Anthropic crede chiaramente che il costo del compromesso sia superiore al rifiuto.

La scommessa di Dario può dare i suoi frutti?

La risposta a questa domanda dipende da diverse variabili che non si sono ancora materializzate.

In primo luogo, è la vera risposta dei clienti aziendali. Amazon, Palantir e Anduril taglieranno attivamente fuori Claude a causa dell'etichetta di "rischio per la catena di fornitura" o sceglieranno di stare fermi e attendere che la situazione cambi? Attualmente, queste aziende non hanno rilasciato una dichiarazione pubblica. Se scelgono di aspettare e vedere, la perdita effettiva di Anthropic sarà davvero solo il contratto governativo da $200 milioni.

Poi c'è la difficoltà pratica della sostituzione del governo. Anche il dipartimento del Pentagono che usa Claude internamente riconosce: Claude è attualmente uno dei modelli di IA più potenti disponibili, con Musk's Grok ancora indietro tecnicamente. Sostituzione significa declassamento dell'uso. Chi sosterrà questo costo?

Infine, vi è l'impatto inaspettatamente di vasta portata di questa questione. Lo stesso giorno in cui Anthropic è stato bandito, Sam Altman, CEO di OpenAI, lo sviluppatore di ChatGPT, ha preso pubblicamente posizione: OpenAI e Anthropic condividono la "stessa linea rossa" per quanto riguarda il confine dell'uso militare dell'IA, con entrambe le aziende che adottano una posizione unificata.

In altre parole, se il governo è alla ricerca di un'alternativa che sia disposta a rispettare pienamente senza alcuna restrizione, le opzioni sono molto meno di quanto immaginato.

Il processo di armatura IA non rallenterà a causa di questo. Musk's Grok è già penetrato nella rete classificata del Pentagono, altre compagnie di IA non hanno perso contratti militari e i sistemi d'arma assistiti dall'IA continuano a iterare.

La scelta di Anthropic non cambia questa traiettoria. Quello che cambia è dove si trova su questa traiettoria.

Ma una cosa è certa: è la prima volta nella storia dell’industria dell’IA che un’azienda tradizionale resiste apertamente alle pressioni del governo su principi espliciti, anche se alla fine ha pagato il prezzo di essere bandita. Indipendentemente dall'esito di questa scommessa, questo precedente ora esiste.

L'ultimo problema aritmetico lasciato al lettore: una società del valore di $380 miliardi, in nome di due principi scritti in un contratto, ha rinunciato all'intero mercato governativo ed è stata quindi classificata come un rischio per la sicurezza nazionale.

Nell'era odierna dell'armizzazione accelerata dall'IA, il modo in cui calcoli questa equazione dipende da ciò che consideri la cosa più preziosa in futuro.

Potrebbe interessarti anche

Proprio ora, Sam Altman è stato nuovamente aggredito, questa volta con un'arma da fuoco

Blocco dello Stretto, riassunto sulle stablecoin | Rewire News - Edizione del mattino

Il Governatore della California Firma un Ordine per Vietare il Trading Insider sui Mercati Prediction

Il governatore Gavin Newsom ha firmato un ordine esecutivo che vieta ai funzionari pubblici di trarre beneficio dal…

Dalle grandi aspettative a una controversa inversione di rotta, l'airdrop di Genius scatena la reazione negativa della community.

Lo stabilimento di veicoli elettrici Xiaomi nel distretto di Daxing a Pechino è diventato la nuova Gerusalemme per l'élite americana

Corpo snello, grande abilità: La vera fonte di una produttività 100 volte superiore grazie all'IA

Ultraman non teme che la sua villa venga attaccata; ha una fortezza.

I negoziati USA-Iran crollano, Bitcoin affronta la battaglia per difendere il livello di 70.000 dollari

Riflessioni e perplessità di un venture capitalist nel settore delle criptovalute

Notizie del mattino | Ether Machine annulla un accordo SPAC da 1,6 miliardi di dollari; SpaceX detiene circa 603 milioni di dollari in Bitcoin; Michael Saylor pubblica nuovamente i dati relativi al Bitcoin Tracker

Anteprima delle notizie di questa settimana | Gli Stati Uniti diffonderanno i dati PPI di marzo; il presidente francese Macron terrà un discorso alla Settimana della blockchain di Parigi

Crypto ETF Settimanale | La scorsa settimana, il flusso netto per gli ETF Bitcoin spot negli Stati Uniti è stato di 816 milioni di dollari; il flusso netto per gli ETF Ethereum spot negli Stati Uniti è stato di 187 milioni di dollari

Come si fa l'autocustodia dei beni digitali? La lista di controllo in 15 punti del cofondatore di OpenAI

Direttore della gestione dei prodotti Circle: Il futuro della cross-chain: Costruire uno stack tecnologico di interoperabilità per i sistemi finanziari Internet

Guida UCL Fan Token 2026: Come fare trading di crypto UEFA Champions League senza commissioni su WEEX

Scopri i token dei tifosi UCL come PSG, Barcellona e Man City. Scopri come fare trading di criptovalute UEFA Champions League a zero commissioni e guadagnare ricompense su WEEX.

Festa di Poker WEEX Stagione 2: Controlla come guadagnare ricompense in criptovaluta ora!

Scopri come funziona la Festa di Poker WEEX Stagione 2 (Evento Carta Jolly). Scopri le regole, i punteggi, le ricompense e le strategie per guadagnare ricompense in criptovaluta attraverso il trading gamificato.

Yu Weiwen: Sviluppo costante dell'ecosistema di stablecoin conforme a Hong Kong

Dopo il cessate il fuoco TACO, la guerra in Iran è appena in pausa

Proprio ora, Sam Altman è stato nuovamente aggredito, questa volta con un'arma da fuoco

Blocco dello Stretto, riassunto sulle stablecoin | Rewire News - Edizione del mattino

Il Governatore della California Firma un Ordine per Vietare il Trading Insider sui Mercati Prediction

Il governatore Gavin Newsom ha firmato un ordine esecutivo che vieta ai funzionari pubblici di trarre beneficio dal…