Cuộc tranh chấp OpenAI: Quyền lực, niềm tin và những ranh giới không thể kiểm soát của trí tuệ nhân tạo tổng quát (AGI).

Tên bài viết gốc: Sam Altman có thể kiểm soát tương lai của chúng ta—Liệu ông ta có đáng tin cậy?

Tác giả bài viết gốc: Ronan Farrow và Andrew Marantz, tạp chí The New Yorker

Bản dịch: Peggy, BlockBeats

Ghi chú của biên tập viên: Bài viết này, thông qua một lượng lớn tài liệu chưa được công bố và các cuộc phỏng vấn chuyên sâu, xem xét lại cuộc khủng hoảng nội bộ tại OpenAI liên quan đến quyền lực và sự tin tưởng dành cho Sam Altman. Từ việc loại bỏ thành viên hội đồng quản trị đến việc bổ nhiệm lại nhanh chóng trong một "cuộc đảo chính đảo ngược", sự hỗn loạn này không phải là một sự kiện đơn lẻ mà là sự bùng phát tập trung của các xung đột quản trị kéo dài.

Cốt lõi của cuộc xung đột là sự giằng co liên tục giữa hai hệ tư duy: một bên là sứ mệnh phi lợi nhuận của OpenAI được thành lập dựa trên nguyên tắc "an toàn của con người là trên hết", và bên kia là sự dịch chuyển dần dần sang con đường phát triển hướng tới sản phẩm, quy mô và doanh thu khi trí tuệ nhân tạo tổng quát (AGI) đến gần và quá trình thương mại hóa tăng tốc. Trong quá trình này, các cam kết về an toàn liên tục bị suy yếu, và quyền lực cũng như việc ra quyết định dần tập trung vào tay một số ít người.

Nhiều nhân vật chủ chốt, bao gồm Ilya Sutskever và Dario Amodei, đã đặt câu hỏi về Altman, tập trung vào tính thiếu minh bạch thông tin và cách diễn đạt chiến lược, tin rằng phong cách lãnh đạo của ông không đủ mạnh mẽ để quản lý công nghệ "sẽ thay đổi vận mệnh nhân loại"; tuy nhiên, những người ủng hộ ông nhấn mạnh rằng khả năng tích hợp nguồn lực, vận hành vốn và thực thi là chìa khóa cho sự mở rộng nhanh chóng của OpenAI.

Khi sức mạnh công nghệ đủ lớn để tác động đến trật tự toàn cầu, liệu cấu trúc quản trị doanh nghiệp hiện tại có còn đủ sức kiềm chế cá nhân hay không? Nói cách khác, trong kỷ nguyên trí tuệ nhân tạo, sự bất định thực sự có thể không chỉ đến từ chính công nghệ mà còn từ những người kiểm soát công nghệ đó.

Dưới đây là bài báo gốc:

Quyền lực và lòng tin: Những rạn nứt trong quản trị dưới thời lãnh đạo của Altman

Vào mùa thu năm 2023, nhà khoa học trưởng của OpenAI, Ilya Sutskever, đã gửi một bản ghi nhớ bí mật cho ba thành viên hội đồng quản trị còn lại của công ty. Trong những tuần trước đó, họ đã bí mật thảo luận về một vấn đề nhạy cảm: liệu Giám đốc điều hành Sam Altman và cấp phó Greg Brockman có còn đủ năng lực để tiếp tục lãnh đạo công ty hay không.

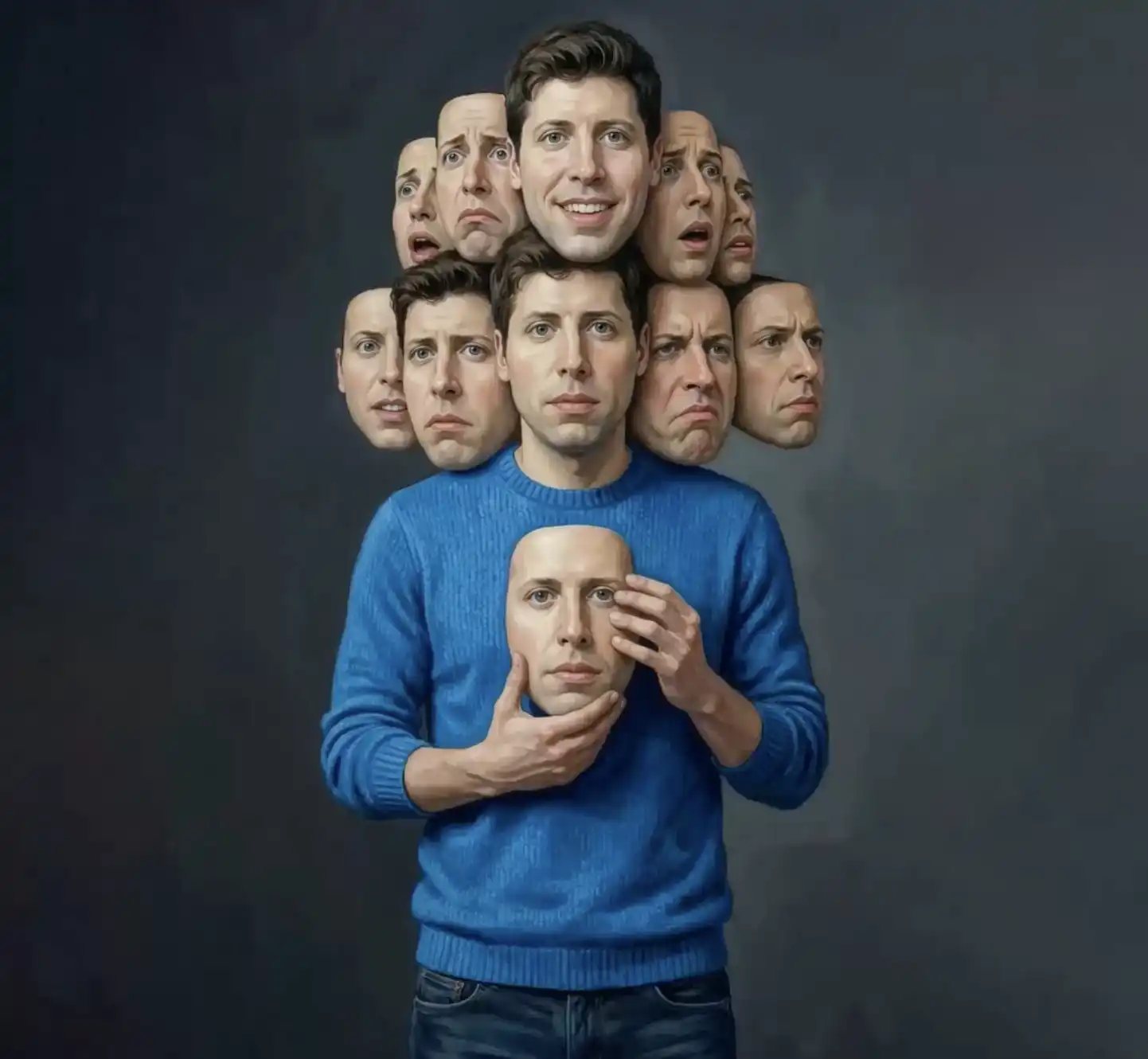

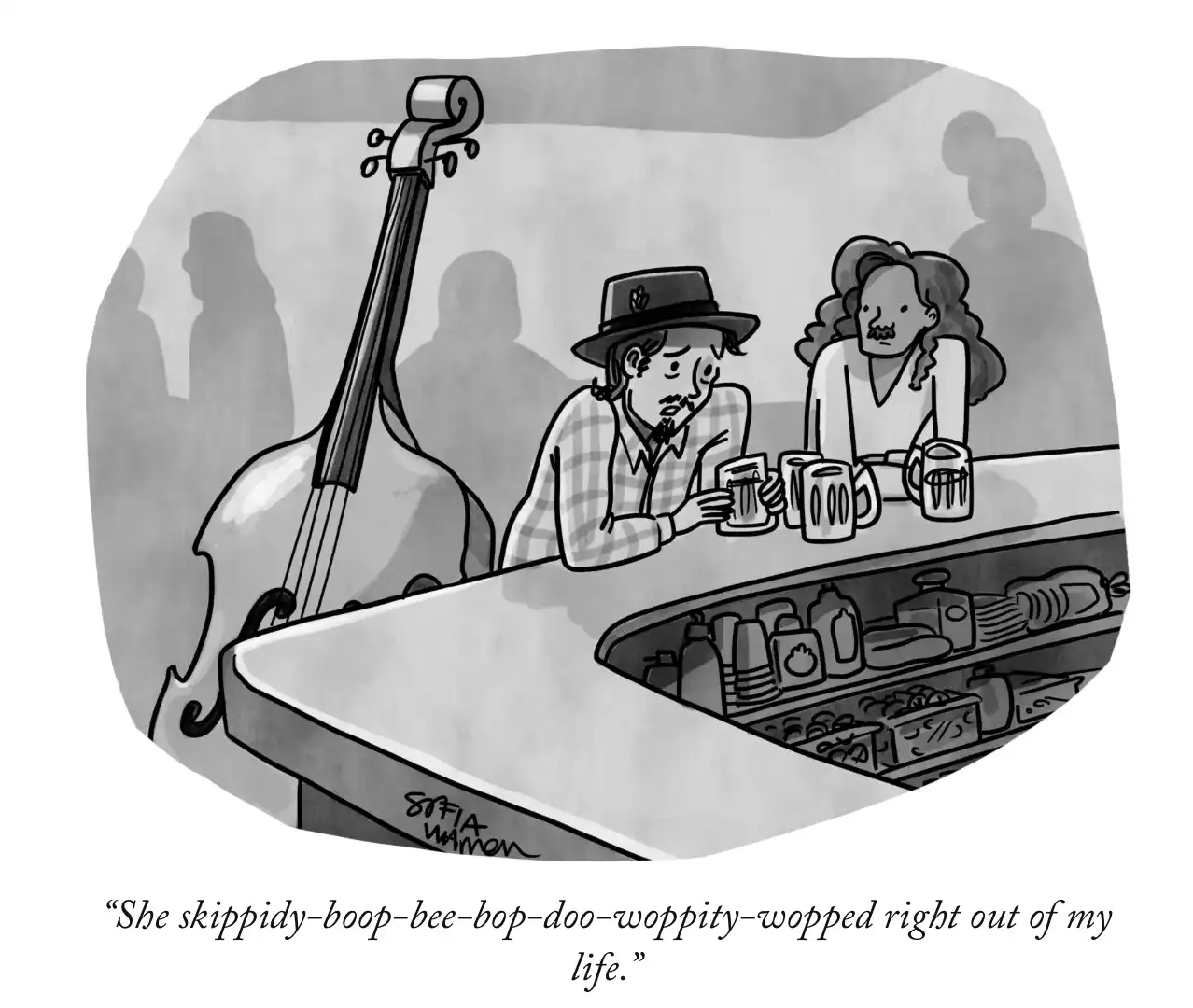

Nguồn ảnh: THẾ GIỚI TRÍ TUỆ NHÂN TẠO NGÀY NAY

Sutskever từng coi hai người họ là bạn bè. Năm 2019, ông thậm chí còn tổ chức đám cưới của Brockman tại văn phòng OpenAI, nơi có cả một cánh tay robot đóng vai trò "người mang nhẫn".

Nhưng khi ông ngày càng tin chắc rằng công ty đang tiến gần đến mục tiêu dài hạn của mình — tạo ra một trí tuệ nhân tạo có thể sánh ngang hoặc vượt qua khả năng nhận thức của con người — thì những nghi ngờ của ông về Altman lại càng sâu sắc hơn. Như ông đã nói với một thành viên khác trong hội đồng quản trị vào thời điểm đó, "Tôi không nghĩ Sam là người nên nắm quyền quyết định."

Theo yêu cầu của các thành viên hội đồng quản trị khác, Sutskever cùng với các đồng nghiệp có cùng chí hướng đã biên soạn một tài liệu dài khoảng bảy mươi trang, bao gồm nhật ký trò chuyện Slack, hồ sơ nhân sự và các bình luận kèm theo. Một số nội dung thậm chí là ảnh chụp màn hình bằng điện thoại, dường như để tránh bị theo dõi bởi các thiết bị của công ty. Cuối cùng, ông ta đã gửi những bản ghi nhớ này cho các thành viên khác trong hội đồng quản trị theo kiểu "đọc rồi đốt" để đảm bảo chúng không bị người khác nhìn thấy.

"Lúc đó anh ấy thực sự rất sợ hãi," một đạo diễn nhận được tài liệu nhớ lại. Chúng tôi đã xem xét những bản ghi nhớ này, vốn chưa từng được công bố đầy đủ trước đây. Các tài liệu cáo buộc Altman đã xuyên tạc sự thật với các giám đốc điều hành và thành viên hội đồng quản trị, cũng như có hành vi lừa dối liên quan đến các quy trình an ninh nội bộ. Một bản ghi nhớ về Altman bắt đầu bằng một danh sách các mục có tiêu đề "Sam luôn thể hiện...", với mục đầu tiên là "Nói dối".

Nhiều công ty công nghệ tuyên bố "làm cho thế giới tốt đẹp hơn", nhưng hoạt động thực tế của họ lại xoay quanh việc tối đa hóa doanh thu. Tuy nhiên, nguyên tắc nền tảng của OpenAI lại khác với mô hình này. Những người sáng lập, bao gồm Altman, Sutskever, Brockman và Elon Musk, tin rằng trí tuệ nhân tạo có thể là một trong những phát minh mạnh mẽ và tiềm tàng nguy hiểm nhất trong lịch sử loài người. Trong bối cảnh "rủi ro hiện hữu" này, công ty có thể cần một cấu trúc tổ chức không theo lối mòn.

Ban đầu, OpenAI được thành lập như một tổ chức phi lợi nhuận, với hội đồng quản trị được giao nhiệm vụ đặt "sự an toàn của toàn nhân loại" lên trên sự thành công của công ty, thậm chí ưu tiên hơn cả sự tồn vong của chính công ty. Vị CEO cần phải sở hữu phẩm chất và đạo đức phi thường.

Như Sutskever đã nói, "Bất cứ ai tham gia vào việc xây dựng công nghệ có thể thay đổi nền văn minh như chúng ta biết đều gánh vác một trách nhiệm nặng nề và một nghĩa vụ chưa từng có." Nhưng ông cũng lưu ý rằng "những người cuối cùng nắm giữ những vị trí này thường thuộc một kiểu người nhất định - những người khao khát quyền lực, những người thuộc giới chính trị, hoặc những người chỉ đơn giản là thích quyền lực vì chính bản thân nó." Trong một bản ghi nhớ, ông bày tỏ lo ngại về việc giao phó công nghệ này cho một người "chỉ nói những điều người khác muốn nghe".

Nếu cuối cùng CEO của OpenAI bị phát hiện là không đáng tin cậy, thì hội đồng quản trị gồm sáu người này có quyền sa thải ông ta. Một số giám đốc, bao gồm chuyên gia chính sách AI Helen Toner và doanh nhân Tasha McCauley, càng tin tưởng hơn vào nhận định trước đây của họ sau khi đọc những bản ghi nhớ này: Altman gánh vác trách nhiệm liên quan đến tương lai của nhân loại, nhưng bản thân ông ta lại không đáng tin cậy.

Cuộc đảo chính trong phòng họp: Sam Altman bị sa thải

Vào thời điểm đó, Sam Altman đang ở Las Vegas xem một cuộc đua Công thức 1 thì Ilya Sutskever mời ông tham gia cuộc gọi video với hội đồng quản trị và đọc một tuyên bố ngắn gọn thông báo rằng ông không còn là nhân viên của OpenAI nữa. Theo tư vấn pháp lý, hội đồng quản trị đã đưa ra một tuyên bố công khai, nêu rõ rằng ông Altman bị sa thải vì "không duy trì được sự trung thực trong giao tiếp một cách nhất quán".

Quyết định này đã gây sốc cho nhiều nhà đầu tư và giám đốc điều hành của OpenAI. Microsoft, công ty đã đầu tư khoảng 13 tỷ đô la vào OpenAI, cũng chỉ biết được tin này vào phút chót trước khi quyết định được thực thi. "Lúc đó tôi vô cùng ngạc nhiên," CEO của Microsoft, Satya Nadella, nhớ lại sau này. "Tôi không thể lấy thêm thông tin từ bất kỳ ai." Sau đó, ông liên hệ với Reid Hoffman (đồng sáng lập LinkedIn, nhà đầu tư của OpenAI và giám đốc của Microsoft), người bắt đầu điều tra khắp nơi xem Altman có phạm phải hành vi sai trái rõ ràng nào hay không. "Lúc đó tôi hoàn toàn bối rối," Hoffman nói với chúng tôi. "Chúng tôi đang tìm kiếm các vấn đề như tham ô hoặc quấy rối, nhưng tôi không tìm thấy gì cả."

Các đối tác kinh doanh khác cũng bị bất ngờ tương tự. Khi Altman gọi cho nhà đầu tư Ron Conway để thông báo về việc bị sa thải, Conway đang ăn trưa với nữ nghị sĩ Quốc hội Hoa Kỳ Nancy Pelosi, và ông đã đưa điện thoại cho bà ngay lập tức. "Tốt hơn hết là anh nên rời khỏi đây nhanh chóng," cô ấy nói với Conway.

Trong khi đó, OpenAI sắp hoàn tất một vòng gọi vốn lớn từ công ty đầu tư mạo hiểm Thrive Capital, do Josh Kushner sáng lập, cũng là anh trai của Jared Kushner, người mà Altman đã quen biết nhiều năm. Thỏa thuận này sẽ định giá OpenAI ở mức 86 tỷ đô la và cho phép nhiều nhân viên thu về hàng triệu đô la tiền cổ phiếu hưởng lợi. Kushner vừa kết thúc cuộc họp với nhà sản xuất âm nhạc Rick Rubin thì thấy cuộc gọi nhỡ của Altman và gọi lại. "Chúng tôi lập tức chuyển sang chế độ chiến đấu," ông nhớ lại sau này.

Vào ngày bị sa thải, Altman bay trở về biệt thự trị giá 27 triệu đô la của mình ở San Francisco, nhìn ra toàn bộ vịnh với một bể bơi vô cực nhô ra khỏi vách nhà, nơi ông thiết lập một trung tâm chỉ huy tạm thời mà ông gọi là "một dạng chính phủ lưu vong". Conway, người đồng sáng lập Airbnb Brian Chesky, và chuyên gia xử lý khủng hoảng quan hệ công chúng nổi tiếng nóng tính Chris Lehane đã tham gia qua video và điện thoại, đôi khi trò chuyện hàng giờ liền. Một số thành viên trong đội ngũ điều hành của Altman thậm chí còn cắm trại trong hành lang của ngôi nhà. Các luật sư đã bố trí văn phòng làm việc tại nhà ông, ngay cạnh phòng ngủ. Trong những lúc mất ngủ, Altman thường đi đi lại lại trong bộ đồ ngủ của mình. Trong một cuộc phỏng vấn gần đây, khi mô tả trải nghiệm sau khi bị sa thải, ông gọi đó là "một trạng thái mơ hồ kỳ lạ".

Trong khi hội đồng quản trị vẫn im lặng, nhóm cố vấn của Altman bắt đầu xây dựng kịch bản cho sự trở lại của ông. Lehane khẳng định rằng việc sa thải thực chất là một "cuộc đảo chính" do "những người theo chủ nghĩa vị tha hiệu quả" dàn dựng, những người ủng hộ một hệ thống tư tưởng nhấn mạnh việc tối đa hóa hạnh phúc tổng thể của con người, và coi trí tuệ nhân tạo là một mối đe dọa hiện hữu. (Hoffman cũng gợi ý với Nadella vào thời điểm đó rằng việc sa thải có thể là do "một kiểu điên rồ vị tha hiệu quả nào đó.") Lehane, người có khẩu hiệu nổi tiếng mượn từ Mike Tyson, "Ai cũng có kế hoạch cho đến khi bị đấm vào mặt," đã đề xuất Altman phát động một chiến dịch truyền thông xã hội táo bạo. Chesky vẫn giữ liên lạc với nhà báo chuyên về công nghệ Kara Swisher, liên tục lan truyền những lời chỉ trích đối với hội đồng quản trị ra bên ngoài.

Mỗi tối vào lúc sáu giờ, Altman sẽ bước ra khỏi "phòng chiến lược" của mình để tự rót cho mình một ly Negroni. Ông nhớ lại mình đã nói với những người xung quanh rằng: "Các bạn phải thư giãn; điều gì đến sẽ đến." Tuy nhiên, ông nói thêm rằng nhật ký cuộc gọi cho thấy ông đã gọi điện thoại hơn mười hai tiếng mỗi ngày trong khoảng thời gian đó.

Theo một nguồn tin tiết lộ, vào một thời điểm nào đó, Altman đã nói với Mira Murati, người khi đó đang giữ chức CEO tạm quyền của OpenAI, rằng các đồng minh của ông đang "làm tất cả" và cố gắng "tìm kiếm những điều xấu" để bôi nhọ bà và những người khác tham gia vào việc thúc đẩy việc ông bị sa thải. (Chính Altman tuyên bố không nhớ cuộc trò chuyện này.)

Chỉ vài giờ sau khi bị sa thải, Thrive Capital đã tạm dừng kế hoạch đầu tư và tuyên bố rõ ràng rằng chỉ khi Sam Altman quay trở lại thì thương vụ mới được thông qua và nhân viên mới được nhận cổ phần thưởng. Các bản ghi tin nhắn vào thời điểm đó cho thấy Altman thường xuyên liên lạc với Satya Nadella. (Trong quá trình soạn thảo tuyên bố chung, Altman đề xuất cách diễn đạt là: "Ưu tiên hàng đầu của Satya và tôi lúc này là cứu OpenAI", trong khi Nadella đề xuất cách diễn đạt khác: "Đảm bảo OpenAI tiếp tục phát triển mạnh mẽ."

Đảo ngược quyền lực: Altman được phục chức nhanh chóng sau 5 ngày.

Không lâu sau, Microsoft thông báo rằng họ sẽ khởi động một dự án cạnh tranh để tuyển dụng Altman và bất kỳ nhân viên nào của OpenAI đã rời công ty. Cùng lúc đó, một bức thư công khai yêu cầu Altman quay trở lại bắt đầu được lan truyền trong nội bộ công ty. Một số người ban đầu còn do dự không muốn ký đã nhận được những cuộc gọi và tin nhắn khẩn thiết từ đồng nghiệp. Cuối cùng, đa số nhân viên của OpenAI đã đe dọa sẽ đồng loạt từ chức để ủng hộ Altman.

Ban quản trị đã bị dồn vào thế bí. "Nhấn Ctrl + Z, đó là một lựa chọn," Helen Toner nói - ám chỉ việc hủy bỏ quyết định sa thải. "Lựa chọn khác là sự sụp đổ hoàn toàn." Thậm chí cả CEO tạm quyền lúc bấy giờ là Mira Murati cuối cùng cũng đã ký vào bức thư công khai. Các đồng minh của Altman bắt đầu cố gắng thuyết phục Ilya Sutskever thay đổi lập trường của mình. Vợ của Brockman, Anna, thậm chí còn đến gặp ông tại văn phòng và nói: "Anh là người tốt, anh có thể sửa chữa sai lầm này." Sau đó, Sutskever giải thích trong lời khai trước tòa: "Vào thời điểm đó, tôi cảm thấy rằng nếu chúng ta đi theo hướng Sam không quay trở lại, OpenAI sẽ bị phá hủy."

Một đêm nọ, Altman uống thuốc ngủ Ambien và bị chồng mình, nhà lập trình người Úc Oliver Mulherin, đánh thức. Mulherin nói với ông rằng lập trường của Sutskever đang lung lay và đề nghị Altman liên lạc với hội đồng quản trị ngay lập tức. "Tôi tỉnh dậy trong trạng thái mơ màng do thuốc Ambien gây ra," Altman nhớ lại, "và tôi hoàn toàn mất phương hướng, nghĩ rằng, 'Không thể nào mình có thể nói chuyện với hội đồng quản trị lúc này được.'"

Trong một loạt các cuộc điện thoại ngày càng căng thẳng, Sam Altman yêu cầu các thành viên hội đồng quản trị, những người đã gây áp lực buộc ông phải từ chức. Khi nghĩ về ý định quay trở lại, anh nhớ lại phản ứng ban đầu của mình là: "Mình sẽ dọn dẹp mớ hỗn độn của họ trong một môi trường vô cùng đáng ngờ như thế này sao?" "Tôi nghĩ, chắc chắn là không," anh nói. Cuối cùng, Ilya Sutskever, Helen Toner và Tasha McCauley đã mất ghế trong hội đồng quản trị, chỉ còn lại Adam D'Angelo (đồng sáng lập Quora) là thành viên hội đồng quản trị ban đầu.

Theo các điều khoản từ chức, các thành viên hội đồng quản trị này đã yêu cầu điều tra các cáo buộc chống lại Altman — bao gồm việc tạo ra sự chia rẽ giữa các giám đốc điều hành và che giấu các mối quan hệ tài chính. Họ cũng thúc đẩy việc thành lập một hội đồng mới để giám sát độc lập cuộc điều tra bên ngoài. Tuy nhiên, hai giám đốc mới được bổ nhiệm — cựu hiệu trưởng Đại học Harvard Lawrence Summers và cựu giám đốc công nghệ của Facebook Bret Taylor — đã được lựa chọn sau quá trình trao đổi chặt chẽ với Altman. "Cô nghĩ cách này có hiệu quả không?", Altman nhắn tin cho Satya Nadella, "với Bret, Larry Summers và Adam trong hội đồng quản trị, tôi làm CEO, và Bret dẫn đầu cuộc điều tra?" (Sau đó, McCauuley làm chứng rằng khi Taylor được xem xét cho vị trí trong hội đồng quản trị, bà lo ngại ông ta có thể quá nể nang Altman.)

Chưa đầy năm ngày sau khi bị sa thải, Altman đã được phục chức. Các nhân viên công ty sau này gọi giai đoạn này là "Blip", lấy cảm hứng từ một tình tiết trong phim Marvel - sự biến mất ngắn ngủi rồi trở lại, nhưng thế giới đã thay đổi về cơ bản bởi sự vắng mặt của họ.

Tuy nhiên, những tranh cãi xung quanh độ tin cậy của Altman từ lâu đã lan rộng ra ngoài phạm vi hội đồng quản trị của OpenAI. Người đồng nghiệp đã dàn xếp việc sa thải ông ta cáo buộc ông ta có hành vi lừa dối tràn lan, điều không thể chấp nhận được đối với bất kỳ giám đốc điều hành nào trong một tập đoàn, huống chi là một nhà lãnh đạo nắm giữ công nghệ mang tính đột phá như vậy. "Chúng ta cần những cơ chế kiểm soát quyền lực tương xứng với quyền lực đó," Mira Murati nói với chúng tôi. "Ban quản trị đã yêu cầu phản hồi, và tôi chỉ chia sẻ một cách trung thực những gì tôi thấy, và tôi vẫn giữ nguyên quan điểm đó." Ngược lại, những người ủng hộ Altman từ lâu đã hạ thấp tầm quan trọng của những cáo buộc này. Sau vụ sa thải, nhà đầu tư Ron Conway đã nhắn tin cho Brian Chesky và Chris Lehane, thúc giục họ thực hiện một cuộc phản công về mặt truyền thông: "Chuyện này liên quan đến danh tiếng của Sam." Ông cũng nói với tờ Washington Post rằng Altman đang bị đối xử bất công bởi "một hội đồng quản trị mất kiểm soát".

Kể từ đó, OpenAI đã vươn lên trở thành một trong những công ty có giá trị nhất thế giới, được cho là đang chuẩn bị cho đợt IPO tiềm năng trị giá nghìn tỷ đô la. Trong khi đó, Altman đang thúc đẩy việc xây dựng cơ sở hạ tầng trí tuệ nhân tạo quy mô lớn, với một số nỗ lực mở rộng sang các chế độ độc tài ở nước ngoài. OpenAI cũng đang theo đuổi các hợp đồng lớn với chính phủ và từng bước thiết lập các tiêu chuẩn cho ứng dụng AI trong việc thực thi luật nhập cư, giám sát nội địa và vũ khí tự động trong các khu vực xung đột.

Sam Altman đã dẫn dắt sự phát triển của OpenAI bằng cách liên tục vẽ nên một tầm nhìn vĩ đại về tương lai. Trong một bài đăng trên blog năm 2024, ông viết: "Những chiến thắng ngoạn mục — giải quyết vấn đề biến đổi khí hậu, thiết lập thuộc địa ngoài Trái đất, khám phá tất cả các định luật vật lý — cuối cùng rồi cũng sẽ trở nên bình thường." Câu chuyện này là nền tảng cho một trong những công ty khởi nghiệp phát triển nhanh nhất trong lịch sử, phụ thuộc rất nhiều vào nguồn vốn từ các đối tác có đòn bẩy tài chính cao. Nền kinh tế Mỹ ngày càng phụ thuộc vào một số ít các công ty trí tuệ nhân tạo (AI) có đòn bẩy tài chính cao, và nhiều chuyên gia — bao gồm cả chính Altman trong một số trường hợp — đã cảnh báo về nguy cơ bong bóng trong ngành này. "Sẽ có người mất rất nhiều tiền," ông nói với các phóng viên năm ngoái. Nếu bong bóng vỡ, nó có thể gây ra một thảm họa kinh tế; nhưng nếu những dự đoán lạc quan nhất của ông trở thành sự thật, ông cũng có thể trở thành một trong những cá nhân giàu có và quyền lực nhất toàn cầu.

Trong một cuộc gọi căng thẳng sau khi Altman bị sa thải, hội đồng quản trị yêu cầu ông thừa nhận hành vi lừa dối lặp đi lặp lại. Theo các nguồn tin có mặt, ông ấy liên tục nói: "Điều này thật nực cười" và khẳng định: "Tôi không thể thay đổi con người mình." Sau đó, Altman khẳng định không nhớ gì về cuộc trò chuyện đó. "Tôi nghĩ có lẽ điều tôi muốn nói là, 'Tôi luôn cố gắng trở thành người gắn kết mọi người'", ông giải thích với chúng tôi sau đó, và cho rằng thành công của mình trong việc lãnh đạo một công ty vô cùng thành công là nhờ vào phẩm chất này. Ông cho rằng những lời chỉ trích này xuất phát từ khuynh hướng "tránh xung đột quá mức" trong giai đoạn đầu sự nghiệp của mình. Tuy nhiên, một thành viên hội đồng quản trị lại đưa ra một cách giải thích hoàn toàn khác: "Ý thật của anh ấy là — 'Tôi có một thói quen là sẽ nói dối mọi người, và tôi sẽ không dừng lại.'"

Nhiệm vụ Drift: Từ ưu tiên bảo mật sang ưu tiên kinh doanh

Và như vậy, một câu hỏi cơ bản hơn đã nảy sinh: Liệu những đồng nghiệp thúc đẩy việc sa thải ông ta có phải xuất phát từ sự quá khích và thù hận cá nhân, hay phán đoán của họ là đúng đắn, và Altman thực sự không đáng tin cậy?

Một buổi sáng mùa đông năm nay, chúng tôi đã gặp Altman tại trụ sở của OpenAI ở San Francisco, một trong hơn chục cuộc trò chuyện mà chúng tôi đã thực hiện cho bài viết này. Công ty này gần đây đã chuyển đến hai tòa tháp kính mười một tầng, một trong số đó trước đây từng là trụ sở của một gã khổng lồ công nghệ khác, Uber. Travis Kalanick, người đồng sáng lập kiêm cựu CEO của Uber, từng được xem là một doanh nhân thiên tài không thể ngăn cản cho đến khi ông bị buộc phải rời khỏi vị trí vào năm 2017, cũng vì các vấn đề đạo đức. (Hiện tại Kalanick đang điều hành một công ty khởi nghiệp về robot; ông cho biết trong thời gian rảnh rỗi, ông sử dụng ChatGPT của OpenAI để “khám phá những ranh giới của vật lý lượng tử”.)

Một nhân viên đã dẫn chúng tôi tham quan không gian văn phòng. Trong một không gian tràn ngập những chiếc bàn dài dùng chung và ánh sáng tự nhiên, có một bức tranh kỹ thuật số sống động về nhà khoa học máy tính Alan Turing, đôi mắt ông dõi theo chúng tôi khi chúng tôi di chuyển. Tác phẩm sắp đặt này rõ ràng là một sự ám chỉ đến "Thử nghiệm Turing" - thí nghiệm tư duy năm 1950 nhằm xác định liệu một cỗ máy có thể bắt chước con người một cách thuyết phục hay không. (Trong một nghiên cứu năm 2025, hiệu suất của ChatGPT trong bài kiểm tra này thực sự vượt trội so với con người thật.) Thông thường, việc vẽ tranh mang tính tương tác. Nhưng hướng dẫn viên của chúng tôi giải thích rằng tính năng giọng nói đã bị vô hiệu hóa vì nó liên tục "nghe lén" các cuộc trò chuyện giữa các nhân viên và thường xuyên xen vào. Ở một khu vực khác trong văn phòng, người ta có thể thấy những tấm biển ghi "Cảm nhận AGI" - một khẩu hiệu ban đầu được Ilya Sutskever đặt ra để nhắc nhở các đồng nghiệp về những rủi ro của trí tuệ nhân tạo tổng quát tiên tiến (điểm mà máy móc đạt được khả năng nhận thức ngang tầm con người). Sau sự kiện Blip, nó đã phát triển thành một câu khẩu hiệu vui vẻ, ăn mừng một tương lai thịnh vượng.

Trong một phòng hội nghị không có gì nổi bật ở tầng tám, chúng tôi đã tìm thấy Sam Altman. “Tôi từng nghe mọi người nói về sự mệt mỏi do phải đưa ra quá nhiều quyết định, nhưng tôi chưa bao giờ cảm nhận được điều đó,” ông nói. “Giờ đây, ngày nào tôi cũng mặc áo len xám và quần jeans, và ngay cả việc chọn chiếc áo len xám nào trong tủ quần áo cũng khiến tôi phải suy nghĩ, ước gì mình không cần phải đưa ra quyết định này.”

Altman trông luôn trẻ trung, với vóc dáng mảnh khảnh, đôi mắt xanh cách xa nhau, mái tóc hơi rối, nhưng ông đã bốn mươi tuổi. Anh ấy và Oliver Mulherin có một cậu con trai một tuổi nhờ phương pháp mang thai hộ. “Tôi nghĩ, làm Tổng thống Hoa Kỳ chắc chắn sẽ chịu nhiều áp lực hơn, nhưng trong tất cả những công việc mà tôi nghĩ mình có thể làm được, đây là công việc mà tôi tưởng tượng sẽ gây áp lực lớn nhất,” ông nói, nhìn người này rồi người kia. Tôi đã mô tả điều đó với bạn bè như sau: 'Đây là công việc thú vị nhất trên thế giới cho đến ngày chúng tôi ra mắt ChatGPT.' Trước đó, chúng ta đã đạt được những bước đột phá khoa học vĩ đại—tôi nghĩ đó là một trong những phát hiện khoa học quan trọng nhất trong nhiều thập kỷ.” Anh ta nhìn xuống. “Nhưng kể từ khi ChatGPT ra mắt, mọi quyết định đều trở nên rất khó khăn.”

Altman lớn lên ở Clayton, Missouri, một vùng ngoại ô giàu có của St. Louis, là con cả trong một gia đình có bốn anh chị em. Mẹ anh, Connie Gibstine, là một bác sĩ da liễu, còn cha anh, Jerry Altman, là một nhà môi giới bất động sản kiêm chuyên viên tham gia các sáng kiến về nhà ở. Ông lớn lên trong một giáo đường Do Thái cải cách, theo học trường dự bị tư thục, và sau này mô tả nơi đó là "một nơi không dễ dàng để công khai mình là người đồng tính". Tuy nhiên, nhìn chung, cộng đồng thượng lưu trung lưu mà ông sinh sống tương đối tự do.

Khoảng mười sáu hoặc mười bảy tuổi, anh ấy đã trải qua một vụ hành hung nghiêm trọng và những lời lăng mạ kỳ thị đồng tính khi đang đi chơi đêm ở một khu phố dành cho người đồng tính ở St. Louis. Altman đã không trình báo vụ việc và không muốn cung cấp thêm chi tiết, nói rằng một lời kể đầy đủ hơn "sẽ khiến tôi trông giống như đang thao túng người khác hoặc tìm kiếm sự cảm thông." Anh ta đã xem nhẹ trải nghiệm này và tầm quan trọng của xu hướng tình dục đối với bản sắc cá nhân của mình. Nhưng ông cũng thừa nhận, "Có lẽ đây là một vấn đề tâm lý rất sâu sắc, về cảm giác như tôi đã công khai nhưng thực chất lại chưa - để tránh thêm xung đột."

Trong một cuộc phỏng vấn với tờ The New Yorker năm 2016, anh trai của ông đã mô tả tính cách thời thơ ấu của ông là "Tôi phải thắng, và tôi phải kiểm soát mọi thứ". Sau đó, Altman theo học Đại học Stanford và thường xuyên tham gia các trò chơi poker bên ngoài khuôn viên trường. "Tôi cảm thấy mình đã học được nhiều điều về cuộc sống và kinh doanh hơn ở đó so với ở trường đại học."

Kỷ nguyên Y Combinator: Sự phóng đại và tranh cãi về lòng tin

Sinh viên Stanford rất tham vọng, nhưng những người năng động nhất trong số họ thường chọn cách bỏ học. Vào cuối năm thứ hai đại học, Altman đến Massachusetts để tham gia nhóm các doanh nhân đầu tiên trong chương trình ươm tạo khởi nghiệp Y Combinator. Học viện này được đồng sáng lập bởi kỹ sư phần mềm nổi tiếng Paul Graham. Mỗi người tham gia đều mang theo một ý tưởng khởi nghiệp. (Trong số những người cùng khóa với ông có các nhóm sau này đã sáng lập ra Reddit và Twitch.) Dự án của Altman sau này được đặt tên là Loopt, một sản phẩm mạng xã hội đời đầu cho phép bạn bè biết vị trí của nhau bằng cách theo dõi vị trí của những chiếc điện thoại bị lật ngược. Công ty đã thể hiện cả khả năng điều hành xuất sắc và khuynh hướng tạo ra không gian riêng cho bản thân trong những tình huống khó đoán. Vào thời điểm đó, các quy định của liên bang yêu cầu các nhà mạng phải có khả năng xác định vị trí điện thoại trong các tình huống khẩn cấp, và Altman đã đạt được thỏa thuận với các nhà mạng để tích hợp khả năng này vào sản phẩm của mình.

Hầu hết nhân viên trong thời kỳ Loopt đều thích Sam Altman, nhưng một số người lại ấn tượng bởi xu hướng "phóng đại" của ông, ngay cả về những vấn đề nhỏ nhặt. Một số người nhớ lại Altman từng khoe khoang mình là nhà vô địch bóng bàn "kiểu như nhà vô địch bóng bàn trường trung học Missouri", trong khi thực tế lại là một trong những người chơi tệ nhất công ty. (Altman nói rằng đó có lẽ chỉ là một trò đùa.) Một nhân viên kỳ cựu của Loopt, Mark Jacobstein, được các nhà đầu tư bổ nhiệm làm "người quản lý" của Altman, và sau này ông đã bình luận trong cuốn tiểu sử "The Optimist" của Keach Hagey: "Có một vùng xám nằm giữa 'Tôi nghĩ mình có thể làm được điều này' và 'Tôi đã làm được điều này', và ở dạng cực đoan nhất, sự mơ hồ này có thể dẫn đến những kết quả như trường hợp của Theranos."

Theo Hagey, do lo ngại về phong cách lãnh đạo và sự thiếu minh bạch của Altman, một số nhân viên cấp cao của Loopt đã hai lần đề xuất với hội đồng quản trị việc cách chức ông khỏi vị trí CEO. Tuy nhiên, đồng thời, ông cũng sở hữu sức hút cá nhân mạnh mẽ. Một cựu nhân viên nhớ lại rằng một thành viên hội đồng quản trị đã trực tiếp đáp lại: "Đây là công ty của Sam, hãy quay lại làm việc của anh đi." (Tuy nhiên, một số thành viên hội đồng quản trị cũng phủ nhận rằng những nỗ lực loại bỏ này là nghiêm túc.)

Loopt không bao giờ chứng kiến sự cải thiện về tăng trưởng người dùng và cuối cùng đã bị một công ty fintech mua lại vào năm 2012. Theo nguồn tin nội bộ, thương vụ thâu tóm này chủ yếu nhằm giúp Altman "rút lui một cách êm đẹp". Tuy nhiên, đến năm 2014, khi Paul Graham nghỉ hưu khỏi Y Combinator, ông vẫn chọn Altman làm người kế nhiệm. "Tôi đã hỏi anh ấy ngay trong bếp nhà mình," Graham kể với tờ The New Yorker , "Anh ấy mỉm cười như thể mọi chuyện đã đâu vào đấy." Tôi chưa bao giờ thấy Sam cười tươi đến thế, kiểu cười mà bạn hay thể hiện khi ném quả bóng giấy vào thùng rác."

Vị trí mới đã biến Altman, khi đó mới 28 tuổi, thành một "người tạo ra các vị vua". Nhiệm vụ của anh ấy là sàng lọc những doanh nhân tham vọng và triển vọng nhất, kết nối họ với các lập trình viên và nhà đầu tư hàng đầu, và giúp họ xây dựng các công ty độc quyền dẫn đầu ngành (trong khi đó, YC sẽ nắm giữ từ 6% đến 7% cổ phần).

Dưới sự lãnh đạo của ông, Y Combinator đã mở rộng nhanh chóng, với số lượng dự án được ươm tạo tăng từ hàng chục lên hàng trăm. Nhưng một số nhà đầu tư ở Thung lũng Silicon bắt đầu tin rằng lợi ích của ông không hoàn toàn trùng khớp. Một nhà đầu tư nói với chúng tôi rằng Altman sẽ "tự mình đầu tư một cách có chọn lọc vào các công ty chất lượng cao nhất để loại trừ các nhà đầu tư bên ngoài" (Altman đã phủ nhận tuyên bố này). Ông cũng đóng vai trò là người tìm kiếm cơ hội đầu tư cho Sequoia Capital, tham gia vào các khoản đầu tư dự án giai đoạn đầu và nhận được một số lợi nhuận.

Theo các nguồn tin, khi Altman đầu tư vào công ty fintech Stripe với tư cách là nhà đầu tư thiên thần, ông đã nhất quyết đòi nắm giữ tỷ lệ cổ phần cao hơn, một hành động khiến Sequoia không hài lòng. Nguồn tin cho biết điều này phản ánh chiến lược "ưu tiên Sam". (Altman đã phủ nhận tuyên bố này.) Ông ấy đã đầu tư khoảng 15.000 đô la vào Stripe vào khoảng năm 2010, nắm giữ khoảng 2% cổ phần, và hiện nay công ty này được định giá hơn 150 tỷ đô la. Altman tuyên bố đã đầu tư vào khoảng 400 công ty.

Đến năm 2018, một số đối tác của Y Combinator không hài lòng với hành vi của Altman và đã báo cáo sự việc cho Graham. Sau đó, Graham đã có một cuộc trò chuyện thẳng thắn với vợ mình, Jessica Livingston, người đồng sáng lập YC, và Altman. Sau đó, Graham bắt đầu công khai tuyên bố rằng mặc dù Altman đã đồng ý bằng miệng sẽ rời đi, nhưng trên thực tế ông ấy vẫn chưa từ chức.

Altman thông báo với một số đối tác rằng ông sẽ từ chức chủ tịch nhưng vẫn giữ chức chủ tịch hội đồng quản trị. Vào tháng 5 năm 2019, Y Combinator đã đăng một bài viết trên blog thông báo về chủ tịch mới, kèm theo ghi chú rằng, "Sam sẽ chuyển sang vị trí chủ tịch hội đồng quản trị của YC." Vài tháng sau, tuyên bố này được sửa đổi thành "Sam Altman đã từ chức khỏi mọi vai trò điều hành tại YC," và sau đó câu này đã bị xóa hoàn toàn. Tuy nhiên, tính đến năm 2021, Altman vẫn được liệt kê là Chủ tịch của Y Combinator tại Mỹ. Hồ sơ nộp cho Ủy ban Chứng khoán và Giao dịch. (Altman cho biết ông chỉ biết về điều này sau đó.)

Trong nhiều năm qua và trong lời khai pháp lý gần đây, Sam Altman luôn khẳng định công khai rằng ông không bị sa thải khỏi Y Combinator và cho biết ông không phản đối việc bị sa thải. Paul Graham đã đăng trên Twitter: "Chúng tôi không muốn anh ấy rời đi nhưng muốn anh ấy phải lựa chọn giữa YC và OpenAI." Trong một tuyên bố, Graham cũng nói với chúng tôi: "Chúng tôi không có quyền pháp lý để sa thải bất cứ ai; tất cả những gì chúng tôi có thể làm là gây áp lực về mặt đạo đức."

Tuy nhiên, trong nội bộ, câu chuyện lại rõ ràng hơn — sự ra đi của Altman xuất phát từ việc thiếu tin tưởng từ các đối tác của YC. Bài viết này kể về thời gian Altman làm việc tại Y Combinator dựa trên các cuộc phỏng vấn với nhiều nhà sáng lập và đối tác của YC, cùng với các tài liệu đương thời, tất cả đều cho thấy rằng sự chia tay không hoàn toàn là do cả hai bên cùng thuận lợi. Thậm chí, theo các nguồn tin, trong một cuộc thảo luận nội bộ, Graham đã nói với các đồng nghiệp tại YC rằng "Sam đã nói dối chúng ta suốt thời gian qua trước khi bị sa thải."

Sự lệch hướng sứ mệnh của OpenAI: Từ ưu tiên an toàn đến ưu tiên lợi nhuận

Vào tháng 5 năm 2015, Altman đã gửi email cho Elon Musk, người khi đó xếp hạng khoảng 100 người giàu nhất thế giới. Giống như nhiều doanh nhân ở Thung lũng Silicon, Musk khi đó tập trung cao độ vào một loạt những gì ông coi là "rủi ro sống còn" - mặc dù hầu hết những người khác xem chúng là những khả năng xa vời. "Chúng ta cần hết sức cẩn thận với trí tuệ nhân tạo," ông viết trên Twitter, "Nó có thể nguy hiểm hơn cả vũ khí hạt nhân."

Altman, người vốn luôn lạc quan về công nghệ, nhanh chóng chuyển sang quan điểm bi quan hơn về trí tuệ nhân tạo. Trong các phát biểu công khai và trao đổi riêng với Musk và những người khác, ông đã cảnh báo không nên để công nghệ này bị độc quyền bởi các tập đoàn công nghệ chỉ vì lợi nhuận. "Tôi vẫn luôn tự hỏi liệu có cách nào để ngăn chặn cuộc chạy đua vũ trang AI hay không," ông viết, "nhưng nếu không có cách nào, thì có vẻ như tốt nhất là nên để một công ty phù hợp thực hiện việc đó." Dựa trên sự tương đồng với năng lượng hạt nhân, ông đề xuất thành lập một "Trí tuệ nhân tạo" (AI). Dự án Manhattan." Ông tiếp tục nêu rõ các nguyên tắc cốt lõi của tổ chức này: "An toàn phải là ưu tiên hàng đầu"; "Chắc chắn chúng ta phải tuân thủ và ủng hộ mọi quy định."

Sau đó, ông và Musk đã thống nhất tên của dự án: OpenAI.

Không giống như Dự án Manhattan, ban đầu do chính phủ dẫn đầu và dẫn đến việc chế tạo bom nguyên tử, OpenAI được tài trợ tư nhân trong giai đoạn đầu. Altman dự đoán rằng một khi một dạng "siêu trí tuệ" vượt trội hơn trí tuệ nhân tạo tổng quát (AGI) xuất hiện, nó sẽ tạo ra đủ giá trị kinh tế để "nắm bắt được chùm tia sáng tương lai của vũ trụ". Tuy nhiên, ông cũng nhiều lần nhấn mạnh những rủi ro tiềm tàng đối với sự tồn tại của công nghệ này: đến một lúc nào đó, tác động của công nghệ này đối với an ninh quốc gia có thể trở nên nghiêm trọng đến mức buộc chính phủ Mỹ phải tiếp quản OpenAI, thậm chí quốc hữu hóa nó, và di dời các cơ sở của nó đến một căn cứ an toàn ở sa mạc. Đến cuối năm 2015, Musk đã bị thuyết phục. "Chúng ta nên công bố cam kết tài trợ 1 tỷ đô la," ông viết, "và tôi sẽ ủng hộ nếu những người khác không làm vậy."

Ban đầu, Sam Altman đặt OpenAI dưới sự quản lý của tổ chức phi lợi nhuận Y Combinator và định hình nó như một dự án từ thiện nội bộ. Ông đã phân bổ cổ phiếu YC cho các thành viên tham gia OpenAI và chuyển tiền quyên góp thông qua các tài khoản YC. Có thời điểm, phòng thí nghiệm này thậm chí còn nhận được sự hỗ trợ từ một quỹ của YC mà Altman có cổ phần cá nhân. (Sau này, Altman gọi phần vốn cổ phần này là "không đáng kể" và tuyên bố rằng cổ phiếu YC được phân bổ cho nhân viên đến từ tài sản cá nhân của ông.)

Sự tương đồng với "Dự án Manhattan" cũng thể hiện rõ trong cuộc đua giành nhân tài. Tương tự như nghiên cứu phân hạch hạt nhân, học máy khi đó là một lĩnh vực khoa học quy mô nhỏ nhưng có tiềm năng tạo nên bước ngoặt lịch sử, được dẫn dắt bởi một nhóm nhỏ các cá nhân tài năng xuất chúng. Elon Musk, Altman và Greg Brockman, người gia nhập từ Stripe, đều tin rằng những nhà khoa học máy tính thực sự đột phá rất hiếm hoi. Ngược lại, Google lại có lợi thế rất lớn về nguồn vốn và thời gian. "Chúng tôi đang tụt hậu rất xa về nhân lực và nguồn lực, khoảng cách này thật khó tin," Musk sau đó viết trong một email. Nhưng ông cũng tin rằng "nếu chúng ta có thể tiếp tục thu hút những tài năng xuất sắc nhất và đảm bảo đúng hướng đi, OpenAI vẫn sẽ thành công."

Một trong những mục tiêu tuyển dụng quan trọng nhất là Ilya Sutskever - một nhà nghiên cứu hướng nội, tận tâm, thường được coi là một trong những nhà khoa học AI tài năng nhất thời bấy giờ. Sinh ra tại Liên Xô năm 1986, Sutskever có mái tóc thưa dần, đôi mắt sâu và thói quen dừng lại, nhìn chăm chú trước khi nói. Một nhân vật quan trọng khác là Dario Amodei, một nhà nghiên cứu năng động với nền tảng về vật lý sinh học, người thường hay lo lắng vuốt tay lên mái tóc đen của mình trong những lúc căng thẳng và trả lời bằng những bài luận dài nhiều đoạn văn ngay cả đối với những email chỉ có một câu. Cả hai đều đang giữ những vị trí có mức lương cao tại các công ty khác vào thời điểm đó, nhưng Altman đã đầu tư rất nhiều công sức để đưa họ về làm việc. Sau đó, anh ấy nói đùa, "Tôi gần như 'theo dõi' Ilya vậy."

Mặc dù Musk có độ nhận diện tên tuổi cao hơn, nhưng Altman lại là người khéo léo hơn. Anh ấy đã chủ động gửi email cho Amodei và sắp xếp một cuộc gặp riêng tại một nhà hàng Ấn Độ. (Altman: "Xe Uber của tôi gặp tai nạn!" Có thể trễ 10 phút. Amodei: (Ôi không, hy vọng bạn vẫn ổn.) Giống như nhiều nhà nghiên cứu AI khác, Amodei tin rằng công nghệ này chỉ nên được phát triển khi nó được chứng minh là "phù hợp" với các giá trị của con người - nghĩa là nó không đi chệch hướng một cách thảm khốc so với ý định của con người, chẳng hạn như xóa sổ loài người nhân danh "làm sạch môi trường". Altman liên tục nhắc lại mối lo ngại về an toàn này trong cuộc trò chuyện của họ, qua đó tạo dựng niềm tin.

Amodei, người sau này gia nhập công ty, đã dành nhiều năm ghi chép lại các hành động của Altman và Brockman, biên soạn chúng thành một tài liệu có tiêu đề "Kinh nghiệm của tôi tại OpenAI" (phụ đề: "Bảo mật: "Không được phép phân phối." Hơn hai trăm trang tài liệu liên quan đến Amodei—bao gồm những ghi chú này, email nội bộ và bản ghi nhớ—đã được lưu hành trong giới công nghệ Thung lũng Silicon nhưng chưa bao giờ được công khai. Trong các tài liệu này, Amodei viết rằng mục tiêu của Altman là tạo ra "một phòng thí nghiệm AI tập trung vào an toàn ('có thể không phải ngay từ đầu, nhưng sẽ sớm thôi')."

Vào tháng 12 năm 2015, chỉ vài giờ trước khi OpenAI chính thức công bố, Altman đã gửi email cho Musk đề cập đến một tin đồn: Google "sẽ đưa ra một lời đề nghị ngược chiều khổng lồ cho tất cả mọi người tại OpenAI vào ngày mai, nhằm mục đích tiêu diệt hoàn toàn tổ chức này." Musk hỏi, "Ilya đã đưa ra câu trả lời dứt khoát chưa?" Altman đáp lại rằng Sutskever rất kiên quyết. Thực tế, Google đã đề nghị Sutskever mức lương 6 triệu đô la mỗi năm, một mức lương mà OpenAI không thể đáp ứng. Tuy nhiên, Altman vẫn giữ vững niềm tin, tuyên bố: "Thật đáng tiếc là họ không đứng về phía 'làm điều đúng đắn'."

Elon Musk từng cung cấp không gian văn phòng cho OpenAI trong một nhà máy sản xuất vali cũ ở khu Mission của San Francisco. Như Ilya Sutskever đã kể với chúng tôi, khẩu hiệu cốt lõi của các nhân viên vào thời điểm đó là: "Tất cả các bạn sẽ cứu thế giới." Nếu mọi việc suôn sẻ, những người sáng lập OpenAI tin rằng trí tuệ nhân tạo sẽ mở ra một kỷ nguyên "hậu khan hiếm" lý tưởng: tự động hóa những công việc nặng nhọc, chữa khỏi ung thư, mang lại cho con người nhiều thời gian rảnh rỗi và sự sung túc hơn. Nhưng nếu công nghệ này vượt tầm kiểm soát hoặc rơi vào tay kẻ xấu, hậu quả có thể là hoàn toàn - chẳng hạn như được sử dụng để phát triển vũ khí sinh học mới hoặc các đàn máy bay không người lái tiên tiến; các mô hình có thể vượt qua sự giám sát của con người, tự nhân bản trên các máy chủ bí mật ngay cả khi bị tắt; trong trường hợp cực đoan, chúng thậm chí có thể kiểm soát lưới điện, thị trường chứng khoán hoặc kho vũ khí hạt nhân.

Mặc dù không phải ai cũng đồng ý với những đánh giá này, Sam Altman đã nhiều lần bày tỏ niềm tin của mình về nguy cơ này. Trong một bài đăng trên blog năm 2015, ông viết rằng trí tuệ máy móc siêu phàm "không cần phải độc ác để hủy diệt nhân loại, nó chỉ cần thờ ơ, khi thực hiện các mục tiêu khác... thản nhiên xóa sổ chúng ta." Người đồng sáng lập OpenAI cam kết không ưu tiên tốc độ hơn sự an toàn, và điều lệ của công ty bao gồm một cam kết pháp lý "vì lợi ích của toàn nhân loại". Họ cũng lo ngại rằng nếu trí tuệ nhân tạo (AI) trở thành công nghệ mạnh nhất từ trước đến nay, bất kỳ người điều khiển nào cũng sẽ có được quyền lực chưa từng có — một kịch bản mà họ gọi là "chế độ độc tài AGI".

Sau khi Musk rời đi, các nhà nghiên cứu như Dario Amodei bắt đầu bày tỏ sự không hài lòng với phong cách quản lý của Greg Brockman, một số người cho rằng ông ta độc đoán, trong khi Sutskever được mô tả là "có nguyên tắc nhưng thiếu khả năng tổ chức". Trong quá trình chuyển giao chức vụ CEO, Altman dường như đã đưa ra những cam kết khác nhau đối với các phe phái khác nhau trong công ty. Ông ta đảm bảo với một số nhà nghiên cứu rằng mình sẽ làm suy yếu quyền lực của Brockman, nhưng đồng thời, ông ta cũng đạt được "thỏa thuận miệng" với Brockman và Sutskever: ông ta sẽ giữ chức CEO, nhưng sẽ từ chức nếu cả hai yêu cầu. (Altman bác bỏ tuyên bố này, cho rằng ông được mời làm CEO.) Cả ba người đều thừa nhận sự tồn tại của thỏa thuận, trong đó Brockman nói rằng đó là một thỏa thuận không chính thức: "Ông ấy đơn phương tuyên bố rằng nếu cả hai chúng tôi cùng yêu cầu, ông ấy sẽ từ chức." Thực ra chúng tôi phản đối ý tưởng này, nhưng ông ấy nói rằng điều đó rất quan trọng đối với ông ấy và được thực hiện vì lòng vị tha. Sau đó, hội đồng quản trị mới biết rằng CEO thực chất đã lập ra một "hội đồng quản trị ngầm" cho riêng mình, điều này khiến họ vô cùng sốc.

Các hồ sơ nội bộ cho thấy nhóm sáng lập đã có những nghi ngờ về cấu trúc phi lợi nhuận ngay từ năm 2017. Cũng trong năm đó, sau khi Musk cố gắng thâu tóm công ty, Brockman đã viết trong nhật ký của mình: "Không thể nói rằng chúng tôi thực sự tuân thủ nguyên tắc là một tổ chức phi lợi nhuận..." Nếu chúng ta trở thành doanh nghiệp B-Corp trong vòng ba tháng, thì những tuyên bố trước đó là dối trá." Amodei cũng ghi lại trong những ghi chép ban đầu rằng ông đã hỏi Brockman về những ưu tiên hàng đầu của ông ta, và Brockman trả lời là "tiền bạc và quyền lực". (Brockman phủ nhận tuyên bố này.) Nhật ký của anh ấy cũng cho thấy một tư duy mâu thuẫn: một mặt tuyên bố "nếu người khác không giàu, tôi cũng không quan tâm đến việc mình giàu có", mặt khác lại tự hỏi "mình thực sự muốn gì?", với một câu trả lời là "đạt được 1 tỷ đô la về mặt tài chính".

Vào năm 2017, Sutskever đã đọc một bài nghiên cứu từ các nhà nghiên cứu của Google tại văn phòng, đề xuất một "kiến trúc mạng đơn giản mới - Transformer". Ông ta nhảy khỏi ghế, chạy ra hành lang và hét lên: "Dừng mọi việc đang làm lại, đây là câu trả lời." Theo ông, kiến trúc này sẽ cho phép OpenAI huấn luyện các mô hình phức tạp hơn. Bước đột phá này đã dẫn đến sự ra đời của các mô hình Transformer tiền huấn luyện tạo sinh sớm nhất và đóng vai trò là nền tảng cho ChatGPT sau này.

Trước đó, Altman đã cam kết với các nhân viên đầu tiên rằng OpenAI sẽ luôn giữ vững bản chất phi lợi nhuận thuần túy, dẫn đến việc nhiều lập trình viên chấp nhận giảm lương đáng kể để gia nhập công ty. OpenAI cũng nhận được khoảng 30 triệu đô la tiền quyên góp, bao gồm cả từ tổ chức Open Philanthropy, một trung tâm tài trợ quan trọng trong phong trào vị tha hiệu quả, vốn từ lâu đã hỗ trợ các dự án như phân phát màn chống muỗi cho các khu vực nghèo khó.

Các hoạt động hàng ngày chủ yếu do Brockman và Sutskever giám sát, trong khi Musk và Altman vẫn bận rộn với các dự án khác của họ, thường chỉ đến thăm công ty một lần mỗi tuần. Đến tháng 9 năm 2017, Musk bắt đầu mất kiên nhẫn. Khi các cuộc thảo luận nảy sinh về khả năng chuyển đổi OpenAI thành một công ty vì lợi nhuận, ông đã yêu cầu được nắm quyền kiểm soát đa số.

Câu trả lời của Altman thay đổi tùy từng dịp, nhưng có một điều ông luôn nhấn mạnh là nếu công ty tái cấu trúc dưới sự điều hành của một CEO, thì vị trí đó phải do ông nắm giữ. Sutskever tỏ ra vô cùng lo lắng về điều này. Thay mặt cho bản thân và Brockman, ông đã gửi một email dài cho Musk và Altman với tiêu đề "Những suy nghĩ chân thành", trong đó nêu rõ: "Mục tiêu của OpenAI là làm cho tương lai tốt đẹp hơn và tránh chế độ độc tài của trí tuệ nhân tạo tổng quát (AGI)." Trong thư gửi Musk, ông viết: "Do đó, việc thiết lập một cấu trúc có thể biến bạn thành một nhà độc tài là một ý tưởng tồi." Ông cũng bày tỏ những lo ngại tương tự như Altman, nói rằng, "Chúng tôi không hiểu tại sao chức danh CEO lại quan trọng đến vậy đối với ông." Lý do của anh/chị cứ thay đổi liên tục, khiến chúng tôi khó mà hiểu được động cơ thực sự."

"Thưa các quý ông, tôi nói xong rồi," Musk đáp, "Hoặc là các ông tự làm việc khác, hoặc là tiếp tục duy trì tư cách phi lợi nhuận của OpenAI—nếu không, tôi chỉ đang tài trợ miễn phí cho các ông để điều hành một công ty khởi nghiệp mà thôi." Năm tháng sau, anh ta rời đi với vẻ mặt rõ rệt không hài lòng. (Năm 2023, ông thành lập công ty đối thủ hoạt động vì lợi nhuận là xAI.) Năm sau đó, ông đã kiện Altman và OpenAI về tội gian lận và vi phạm lòng tin từ thiện, cáo buộc rằng ông đã bị "thao túng một cách cẩn thận" và Altman đã thực hiện một "mưu đồ dài hạn" bằng cách lợi dụng những lo ngại của ông về rủi ro của AI để đảm bảo nguồn tài trợ. Vụ kiện vẫn đang tiếp diễn, và OpenAI kiên quyết bác bỏ các cáo buộc.

Khi khả năng công nghệ phát triển, chúng ta biết được rằng khoảng một chục kỹ sư cốt lõi tại OpenAI đã tổ chức một loạt các cuộc họp bí mật, thảo luận riêng về việc liệu đội ngũ sáng lập, bao gồm Sam Altman và Greg Brockman, có đáng tin cậy hay không. Trong một cuộc họp như vậy, một nhân viên nhớ lại một tiểu phẩm châm biếm của bộ đôi diễn viên hài người Anh Mitchell và Webb - một người lính Đức Quốc xã ở mặt trận phía Đông đột nhiên giác ngộ và hỏi: "Phải chăng chúng ta là kẻ xấu?"

Đến năm 2018, Dario Amodei đã bắt đầu công khai đặt câu hỏi về động cơ của những người sáng lập. Sau đó, ông viết trong một ghi chú: "Mọi thứ trông giống như một kế hoạch tài chính không bao giờ kết thúc." Tôi cảm thấy điều mà OpenAI thực sự cần là một định nghĩa rõ ràng: nó muốn làm gì, không muốn làm gì và sự tồn tại của nó sẽ làm cho thế giới tốt đẹp hơn như thế nào." Mặc dù công ty đã có tuyên ngôn sứ mệnh — "đảm bảo trí tuệ nhân tạo tổng quát mang lại lợi ích cho toàn nhân loại" — Amodei cảm thấy tuyên ngôn này chưa rõ ràng đối với đội ngũ điều hành.

Đầu năm 2018, ông bắt đầu soạn thảo điều lệ công ty và sau nhiều tuần thảo luận với Altman và Brockman, đã thúc đẩy việc đưa vào một trong những điều khoản cấp tiến nhất: nếu một "dự án phù hợp với giá trị và chú trọng đến an toàn" tiến gần hơn đến việc đạt được Trí tuệ Nhân tạo Tổng quát (AGI) so với OpenAI, công ty sẽ "ngừng cạnh tranh và thay vào đó hỗ trợ dự án đó". Điều này được gọi là điều khoản "sáp nhập và hỗ trợ" — ví dụ, nếu Google đạt được trí tuệ nhân tạo tổng quát (AGI) an toàn trước, về mặt lý thuyết, OpenAI sẽ tự giải thể và chuyển giao nguồn lực cho Google. Từ góc nhìn kinh doanh truyền thống, cam kết này gần như là điều không thể tưởng tượng nổi, nhưng OpenAI chưa bao giờ có ý định trở thành một công ty truyền thống.

Giả thuyết này đã phải đối mặt với thực tế phũ phàng vào mùa xuân năm 2019. Vào thời điểm đó, OpenAI đang đàm phán với Microsoft về một khoản đầu tư tiềm năng lên tới 1 tỷ đô la. Mặc dù Amodei (khi đó đang dẫn dắt nhóm an toàn) đã tham gia thuyết trình dự án cho Bill Gates, nhưng trong nhóm vẫn có lo ngại rằng Microsoft có thể đưa ra những điều khoản làm suy yếu các cam kết đạo đức của OpenAI. Amodei đã đệ trình lên Altman một danh sách các yêu cầu an toàn được ưu tiên, trong đó điều khoản "hợp nhất và hỗ trợ" được đặt ở vị trí đầu tiên.

Altman đã đồng ý vào thời điểm đó. Tuy nhiên, khi thương vụ gần hoàn tất vào tháng 6, Amodei đã phát hiện ra một điều khoản mới trong thỏa thuận cho phép Microsoft có quyền phủ quyết việc sáp nhập OpenAI. "Điều này tương đương với việc vi phạm 80% điều lệ," ông nhớ lại sau đó. Ông đã chất vấn Altman về vấn đề này, và Altman ban đầu phủ nhận sự tồn tại của điều khoản đó. Amodei đọc to bản hợp đồng ngay tại chỗ, và cuối cùng phải nhờ một đồng nghiệp khác xác nhận trực tiếp với Altman. (Altman nói rằng ông không nhớ vụ việc này.)

Cuộc di cư vì an toàn và sự ra đời của chủ nghĩa nhân sinh

Ghi chép của Amodei cũng ghi lại một loạt các cuộc xung đột căng thẳng leo thang. Vài tháng sau, trong một cuộc họp, Altman triệu tập ông và em gái Daniela, người cũng làm việc trong bộ phận an toàn và chính sách của công ty, với lý do ông đã nhận được thông tin đáng tin cậy từ một "giám đốc điều hành cấp cao" rằng hai người đang lên kế hoạch "đảo chính". Theo ghi chú, Daniela đã "quá xúc động" ngay tại chỗ và gọi vị giám đốc điều hành đến, người này sau đó phủ nhận việc từng nói điều đó. Các nguồn tin thân cận với vụ việc cho biết Altman sau đó đã phủ nhận việc từng đưa ra cáo buộc này: "Tôi chưa từng nói điều đó." Daniela đáp lại, "Anh vừa làm điều đó đấy." (Altman cho biết ký ức của ông hơi khác một chút, khẳng định ông chỉ buộc tội Amodei tham gia vào "hành vi chính trị.") Năm 2020, Amodei, Daniela và một số đồng nghiệp rời công ty để thành lập Anthropic, công ty này sau đó đã trở thành một trong những đối thủ cạnh tranh chính của OpenAI.

Trong khi đó, Altman tiếp tục nhấn mạnh cam kết của OpenAI về vấn đề an toàn, đặc biệt là khi có sự hiện diện của các ứng viên tiềm năng. Vào cuối năm 2022, bốn nhà khoa học máy tính đã công bố một bài báo đề xuất nguy cơ "sự liên kết đánh lừa": các mô hình tiên tiến có thể hoạt động tốt trong quá trình thử nghiệm nhưng lại theo đuổi mục tiêu riêng của chúng sau khi được triển khai thực tế. (Tình huống tưởng chừng như viễn tưởng này đã từng xảy ra trong một số điều kiện thử nghiệm nhất định.) Vài tuần sau khi bài báo được xuất bản, một trong những tác giả—một nghiên cứu sinh tiến sĩ tại Đại học California, Berkeley—đã nhận được email từ Altman. Altman bày tỏ mối lo ngại ngày càng tăng về mối đe dọa của "trí tuệ nhân tạo không được kiểm soát" và cân nhắc đầu tư 1 tỷ đô la để giải quyết vấn đề này, chẳng hạn như thành lập một giải thưởng nghiên cứu toàn cầu. Mặc dù sinh viên này đã nghe đồn rằng "Sam hơi xảo quyệt", nhưng sự tận tâm cuối cùng đã thuyết phục anh ta tạm dừng việc học và gia nhập OpenAI.

Tuy nhiên, qua nhiều cuộc gặp gỡ vào mùa xuân năm 2023, thái độ của Altman dường như đã thay đổi. Ông không còn đề cập đến việc thiết lập một giải thưởng nữa mà thay vào đó chuyển sang việc thành lập một "đội ngũ siêu liên kết" nội bộ trong công ty. Thông báo chính thức cho biết nhóm sẽ nhận được "20% tài nguyên điện toán được bảo mật của công ty", một nguồn lực có giá trị tiềm năng hơn 1 tỷ đô la. Thông báo cũng nhấn mạnh rằng nếu vấn đề đồng bộ hóa không thể được giải quyết, trí tuệ nhân tạo tổng quát (AGI) có thể dẫn đến "nhân loại bị tước quyền hoặc thậm chí tuyệt chủng". Jan Leike, người phụ trách nhóm, sau đó tuyên bố: "Đó quả thực là một chiến lược giữ chân nhân sự rất hiệu quả."

Tuy nhiên, lời hứa về "20% khả năng tính toán" đã không được thực hiện. Bốn cá nhân tham gia hoặc theo sát nhóm cho biết rằng nguồn lực thực tế được phân bổ chỉ chiếm từ 1% đến 2% tổng tài nguyên tính toán của công ty. Ngoài ra, một nhà nghiên cứu chỉ ra rằng "hầu hết các phép tính siêu căn chỉnh được gọi là như vậy thực chất đều chạy trên cụm máy tính cũ nhất và có hiệu suất kém nhất." Các thành viên trong nhóm nhìn chung tin rằng phần cứng tiên tiến hơn sẽ được ưu tiên cho các dự án tạo ra doanh thu. (OpenAI đã phủ nhận điều này.) Leike đã nêu vấn đề này với Giám đốc Công nghệ lúc bấy giờ là Mira Murati, nhưng câu trả lời nhận được là không cần phải thúc ép thêm nữa — cam kết này ngay từ đầu đã là "không thực tế".

Khoảng thời gian này, một cựu nhân viên cho biết Ilya Sutskever "bắt đầu đặc biệt chú trọng đến vấn đề an toàn." Trong những ngày đầu của OpenAI, mặc dù ông cho rằng rủi ro thảm họa là một mối lo ngại chính đáng, nhưng nó vẫn còn khá xa vời; tuy nhiên, khi ông dần tin rằng trí tuệ nhân tạo tổng quát (AGI) đang đến gần, mối lo ngại này đã leo thang nhanh chóng. Theo lời kể của nhân viên này, trong một cuộc họp toàn thể, "Ilya đứng dậy và nói rằng trong vài năm tới sẽ đến lúc hầu hết mọi người trong công ty phải chuyển sang làm công tác an toàn, nếu không thì công ty sẽ phá sản." Tuy nhiên, năm sau đó, "đội ngũ siêu liên kết" này đã bị giải tán trước khi hoàn thành nhiệm vụ.

Hiện tại, các thông tin nội bộ cho thấy các giám đốc điều hành và thành viên hội đồng quản trị bắt đầu tin rằng việc che giấu và hành vi gây hiểu nhầm của Sam Altman có thể ảnh hưởng nghiêm trọng đến sự an toàn của các sản phẩm OpenAI. Trong một cuộc họp vào tháng 12 năm 2022, Altman đã đảm bảo với hội đồng quản trị rằng nhiều tính năng của GPT-4 sắp ra mắt đã được ủy ban an toàn phê duyệt. Thành viên hội đồng quản trị kiêm chuyên gia chính sách AI, Helen Toner, đã yêu cầu xem các tài liệu liên quan nhưng phát hiện ra rằng hai tính năng gây tranh cãi nhất—một tính năng cho phép người dùng "tinh chỉnh" mô hình và một tính năng khác cho phép triển khai nó như một trợ lý cá nhân—thực tế vẫn chưa được phê duyệt. Sau cuộc họp, một thành viên khác trong hội đồng quản trị, nữ doanh nhân Tasha McCauley, đã bị một nhân viên kéo sang một bên hỏi liệu bà có biết về "vụ việc vi phạm quy định ở Ấn Độ" hay không: Altman chưa từng đề cập trong nhiều bản cập nhật diễn đàn rằng Microsoft đã ra mắt phiên bản thử nghiệm sớm của ChatGPT tại Ấn Độ mà chưa hoàn tất các đánh giá an toàn cần thiết. "Vấn đề này gần như bị che giấu hoàn toàn," nhà nghiên cứu Jacob Hilton của OpenAI khi đó cho biết.

Mặc dù những vấn đề này không trực tiếp dẫn đến sự cố an toàn nào, nhưng nhà nghiên cứu Carroll Wainwright tin rằng chúng phản ánh "xu hướng tiếp tục trượt dốc theo hướng ưu tiên sản phẩm, xem nhẹ vấn đề an ninh". Sau khi GPT-4 được thả, Jan Leike, người phụ trách công tác an ninh, đã viết thư cho ban quản trị: "OpenAI đang đi chệch khỏi sứ mệnh của mình." Chúng tôi ưu tiên sản phẩm và doanh thu lên hàng đầu, sau đó là năng lực, nghiên cứu và mở rộng quy mô, còn sự đồng bộ và an toàn đứng thứ ba. Ông cũng lưu ý rằng "các công ty như Google đang rút ra bài học - đẩy nhanh tiến độ triển khai trong khi bỏ qua các vấn đề an ninh."

Trong một email gửi các thành viên hội đồng quản trị, McCauley viết: "Tôi tin rằng chúng ta thực sự đang ở giai đoạn cần tăng cường giám sát." Tuy nhiên, khi ban quản trị cố gắng giải quyết vấn đề này, họ rõ ràng đã ở thế bất lợi. "Nói thẳng ra, đó là một nhóm người thiếu kinh nghiệm thực tế," cựu thành viên hội đồng quản trị Sue Yoon cho biết. Vào năm 2023, công ty đang chuẩn bị phát hành GPT-4 Turbo. Theo mô tả của Sutskever trong một bản ghi nhớ, Altman đã nói với Mira Murati rằng mô hình này không cần phê duyệt an ninh và cho rằng quyết định này là do cố vấn pháp lý của công ty, Jason Kwon, đưa ra. Nhưng khi Murati hỏi Kwon trên Slack, anh ấy trả lời, "Ừm..." Tôi không chắc lắm tại sao Sam lại nghĩ như vậy." (OpenAI cho biết sự việc này "không đáng kể.")

Không lâu sau, hội đồng quản trị quyết định sa thải Altman—và sau đó, cả thế giới đã chứng kiến ông nhanh chóng đảo ngược quyết định đó như thế nào. Điều lệ của OpenAI vẫn có trên trang web chính thức, nhưng những người quen thuộc với các tài liệu quản trị của công ty cho biết nội dung của nó đã bị giảm nhẹ đến mức gần như vô nghĩa. Vào tháng 6 năm ngoái, Altman đã viết trong một bài đăng trên blog cá nhân về siêu trí tuệ: "Chúng ta đã vượt qua chân trời sự kiện; quá trình cất cánh đã bắt đầu."

Theo điều lệ ban đầu, đây được cho là bước ngoặt để công ty chấm dứt cạnh tranh và chuyển sang hợp tác. Tuy nhiên, trong bài viết có tựa đề "Sự kỳ dị dịu dàng", ông đã sử dụng một giọng điệu hoàn toàn mới, thay thế cụm từ "nỗi sợ hãi hiện sinh" bằng "trí tưởng tượng lạc quan": "Tất cả chúng ta sẽ có những điều tốt đẹp hơn, và chúng ta sẽ tạo ra những điều ngày càng tốt đẹp hơn cho nhau." Ông thừa nhận rằng các vấn đề về sự đồng bộ vẫn chưa được giải quyết nhưng đã định nghĩa lại chúng như một "phiền toái", tương tự như việc nghiện thuật toán đề xuất của Instagram.

Altman thường được nhắc đến với sự ngưỡng mộ hoặc hoài nghi như là "người kể chuyện tài ba nhất thế hệ của ông". Steve Jobs mà ông ngưỡng mộ từng được cho là sở hữu "trường bóp méo thực tại", có khả năng định hình thế giới theo tầm nhìn của mình với sự tự tin tuyệt đối. Nhưng ngay cả Jobs cũng chưa bao giờ nói với người dùng rằng: nếu họ không mua sản phẩm của ông, nhân loại có thể sẽ diệt vong. Năm 2008, khi mới 23 tuổi, Altman được người thầy của mình, Paul Graham, mô tả như sau: "Hãy thả hắn xuống một hòn đảo toàn ăn thịt người, quay lại sau năm năm, và hắn sẽ trở thành vua." Đánh giá này không dựa trên những thành tích của ông vào thời điểm đó mà dựa trên ý chí gần như không bị ràng buộc của ông.

Tuy nhiên, đối với một số người từng làm việc thân cận nhất với ông, đặc điểm này lại có một mặt khác. Khi Sutskever ngày càng lo lắng về sự an toàn của trí tuệ nhân tạo, ông đã biên soạn một loạt bản ghi nhớ về Altman và Greg Brockman—một bộ tài liệu quan trọng đến mức ở Thung lũng Silicon, chúng thậm chí còn được gọi là "Bản ghi nhớ Ilya".

Trong khi đó, Dario Amodei tiếp tục ghi lại những hình ảnh. Những tài liệu này không cung cấp cái gọi là "bằng chứng không thể chối cãi" mà chỉ mô tả một loạt các hành vi dường như rời rạc nhưng lại tích lũy dần: chẳng hạn như đưa ra cùng một vị trí cho nhiều người khác nhau, đưa ra những lời khai mâu thuẫn về thông tin công khai và không rõ ràng về các quy trình an ninh. Kết luận của Sutskever là hành vi này "không tạo ra môi trường thuận lợi cho trí tuệ nhân tạo tổng quát (AGI) an toàn"; Amodei thì thẳng thắn hơn, viết rằng, "Vấn đề của OpenAI chính là Sam."

Chúng tôi đã phỏng vấn hơn một trăm người quen thuộc với phương pháp của Altman: các nhân viên và giám đốc hiện tại và trước đây của OpenAI, các đồng nghiệp và đối thủ cạnh tranh, bạn bè và kẻ thù của ông - ở Thung lũng Silicon, nhiều người thường đảm nhiệm nhiều vai trò khác nhau. Một số người bênh vực tài năng kinh doanh của ông, tin rằng Sutskever và Amodei chỉ là những đối thủ thất bại; những người khác lại coi ông là một nhà khoa học ngây thơ, đãng trí, hoặc thậm chí là một người cực đoan bị mắc kẹt trong "chủ nghĩa tận thế". Yoon tin rằng Altman không phải là một "kẻ phản diện theo chủ nghĩa Machiavellian" mà là một người bị thuyết phục bởi chính câu chuyện của mình, "ông ta quá đắm chìm trong niềm tin vào bản thân đến nỗi đưa ra những quyết định không thể hiểu nổi trong thế giới thực - nhưng ngay từ đầu ông ta đã không sống trong thế giới thực."

Tuy nhiên, nhận định của hầu hết những người được phỏng vấn đều tương tự như của Sutskever và Amodei: Altman sở hữu ý chí mạnh mẽ phi thường, nổi bật ngay cả giữa những ông trùm công nghiệp mà tên tuổi được khắc trên tên lửa. "Ông ta không bị ràng buộc bởi 'thực tế'," một thành viên hội đồng quản trị nói, "Ông ta sở hữu hai đặc điểm hiếm khi xuất hiện cùng nhau: một là khao khát mãnh liệt được người khác yêu mến, làm hài lòng đối phương trong mọi tương tác; đặc điểm còn lại gần như là chống đối xã hội, thiếu quan tâm đến hậu quả của việc lừa dối người khác."

Hơn một người được phỏng vấn đã tự nhiên sử dụng thuật ngữ "nhân cách chống đối xã hội". Altman, một người cùng khóa đầu tiên của Y Combinator, là đồng nghiệp của lập trình viên Aaron Swartz, người sau đó đã tự tử vào năm 2013. Trước khi qua đời, Swartz đã bày tỏ những lo ngại về Altman với một người bạn: "Bạn phải hiểu rằng, không bao giờ được phép tin tưởng Sam." Hắn là một kẻ có tính cách bất hảo; hắn có khả năng làm bất cứ điều gì." Một số giám đốc điều hành của Microsoft cũng cho biết rằng, bất chấp sự ủng hộ lâu dài của Satya Nadella dành cho Altman, mối quan hệ giữa hai người đang trở nên căng thẳng. "Ông ta sẽ lừa dối, xuyên tạc, đàm phán lại, hoặc thậm chí lật đổ các thỏa thuận," một giám đốc điều hành cho biết. Đầu năm nay, OpenAI đã tái khẳng định Microsoft là nhà cung cấp dịch vụ đám mây độc quyền cho "mô hình không trạng thái" của mình, nhưng cùng ngày, họ lại công bố hợp tác trị giá 500 tỷ đô la với Amazon, biến Amazon trở thành nhà phân phối độc quyền nền tảng AI doanh nghiệp của họ. Mặc dù thỏa thuận này không vi phạm hợp đồng, Microsoft vẫn cho rằng có khả năng xảy ra xung đột lợi ích. (OpenAI tuyên bố sẽ không vi phạm hợp đồng.) Vị giám đốc điều hành thậm chí còn nhận xét: "Tôi tin rằng có khả năng rất lớn là trong tương lai ông ta sẽ bị coi là người tương tự như Bernie Madoff hoặc Sam Bankman-Fried."

Altman không phải là một thiên tài kỹ thuật — theo đánh giá của nhiều đồng nghiệp, khả năng chuyên môn của ông trong lập trình hoặc máy học còn hạn chế, và thậm chí ông còn có thể nhầm lẫn các khái niệm cơ bản. Ông đã xây dựng OpenAI chủ yếu bằng cách kết hợp nguồn vốn và tài nguyên kỹ thuật của người khác. Điều này không phải là hiếm gặp—đây chính là vai trò của một doanh nhân. Điều đáng chú ý hơn cả là khả năng thuyết phục các kỹ sư, nhà đầu tư và công chúng với những quan điểm trái ngược, khiến họ tin rằng những ưu tiên của ông cũng chính là những ưu tiên của họ. Khi những người này cố gắng ngăn cản ông ta, ông ta thường có thể xoa dịu tình hình bằng những lời lẽ khéo léo—ít nhất là tạm thời; và đến khi đối phương nhận ra vấn đề, ông ta thường đã đạt được mục tiêu của mình. "Trên giấy tờ, anh ấy sẽ thiết kế một số cấu trúc để hạn chế bản thân mình trong tương lai," Wainwright nói, "nhưng khi tương lai thực sự đến và cần được hạn chế, anh ấy sẽ phá bỏ những cấu trúc này từng cái một."

"Khả năng thuyết phục của anh ấy cực kỳ mạnh mẽ, giống như một thủ thuật thôi miên của Jedi vậy," một giám đốc điều hành công nghệ từng làm việc với anh ấy cho biết, "Nó ở một đẳng cấp hoàn toàn khác." Trong nghiên cứu về sự phù hợp của trí tuệ nhân tạo, có một khái niệm kinh điển: ý chí của con người đối đầu với một trí tuệ nhân tạo hùng mạnh, và trí tuệ nhân tạo gần như chắc chắn sẽ thắng thế, giống như một kiện tướng cờ vua đấu với một đứa trẻ. Theo quan điểm của vị giám đốc điều hành đó, việc chứng kiến Altman điều hướng giữa các bên khác nhau trong sự kiện "Blip" giống như xem "một trí tuệ nhân tạo tổng quát (AGI) thoát khỏi lồng giam của nó".

Trong những ngày sau khi bị sa thải, Sam Altman đã cố gắng ngăn chặn bất kỳ cuộc điều tra nào về những cáo buộc chống lại ông diễn ra. Ông ta đã bày tỏ với hai người rằng ông lo ngại ngay cả việc có một cuộc điều tra cũng sẽ khiến ông trông có vẻ phạm tội. (Altman phủ nhận việc đưa ra tuyên bố này.) Tuy nhiên, sau khi các thành viên hội đồng quản trị từ chức và khăng khăng đòi "một cuộc điều tra độc lập phải được tiến hành" như một điều kiện để ông rời nhiệm, cuối cùng Altman đã đồng ý "xem xét" các "sự kiện gần đây". Theo các nguồn tin thân cận với cuộc đàm phán, hai thành viên hội đồng quản trị mới đã nhất quyết tự mình dẫn đầu cuộc đánh giá này.

Lawrence Summers, bằng cách tận dụng các mối quan hệ của mình trong chính trường và trên phố Wall, dường như đã góp phần tạo thêm độ tin cậy cho bài đánh giá này. (Tháng 11 năm ngoái, Summers đã từ chức khỏi hội đồng quản trị sau khi thông tin ông từng tìm kiếm lời khuyên từ Jeffrey Epstein qua email trong quá trình theo đuổi một người học trò trẻ tuổi được công khai.) Cuối cùng, OpenAI đã thuê hãng luật nổi tiếng WilmerHale để xử lý vụ việc này. Trước đây, công ty này đã từng dẫn đầu các cuộc điều tra nội bộ về Enron và WorldCom.

Sáu cá nhân thân cận với quá trình điều tra cho biết cuộc xem xét dường như được thiết kế để hạn chế tính minh bạch. Một số người cho rằng ban đầu các nhà điều tra đã không liên hệ với một số cá nhân chủ chốt trong công ty. Một nhân viên thậm chí đã liên hệ với Summers và Bret Taylor để bày tỏ mối lo ngại của mình. "Họ chỉ quan tâm đến khoảng thời gian ngắn ngủi khi vụ lùm xùm trong hội đồng quản trị xảy ra, chứ không phải những vấn đề về tính liêm chính lâu dài của Sam," nhân viên này nhớ lại cảm giác của mình trong cuộc phỏng vấn với các nhà điều tra. Một số người cũng ngần ngại chia sẻ những lo ngại của họ về Altman vì cho rằng không có sự bảo vệ quyền riêng tư. "Tất cả các dấu hiệu đều cho thấy họ đang tìm kiếm một kết luận đã được định trước - đó là minh oan cho anh ta," nhân viên này nói. (Tuy nhiên, một số luật sư tham gia vào quá trình này đã bảo vệ cuộc xem xét, gọi đó là "độc lập, kỹ lưỡng, toàn diện và dựa trên sự thật.") Taylor cũng khẳng định rằng cuộc đánh giá này "rất kỹ lưỡng và độc lập."

Vai trò của một cuộc điều tra nội bộ doanh nghiệp thường là để hợp thức hóa một quyết định. Tại các công ty tư nhân, kết quả điều tra đôi khi thậm chí không được lập thành văn bản báo cáo, nhằm mục đích giảm thiểu trách nhiệm pháp lý. Tuy nhiên, trong những trường hợp gây tranh cãi công khai, thường có kỳ vọng về mức độ minh bạch cao hơn. Vào năm 2017, trước khi Travis Kalanick rời khỏi Uber, hội đồng quản trị đã thuê một công ty bên ngoài và công bố bản tóm tắt dài 13 trang về cuộc điều tra cho công chúng. Xét đến tư cách phi lợi nhuận 501(c)(3) của OpenAI và tính chất công khai cao của việc chấm dứt này, nhiều giám đốc điều hành trong công ty ban đầu đã dự đoán một báo cáo điều tra chi tiết. Tuy nhiên, đến tháng 3 năm 2024, OpenAI chỉ thông báo về việc "giải oan" cho Altman mà không đưa ra bất kỳ báo cáo chính thức nào, thừa nhận "sự đổ vỡ lòng tin" trong khoảng 800 từ trên trang web của họ.

Ngay cả những đồng nghiệp cũ cũng đang cảm nhận được dư chấn. Mira Murati rời OpenAI vào năm 2024 để thành lập công ty khởi nghiệp về trí tuệ nhân tạo của riêng mình. Sau đó, Josh Kushner, một người thân cận của Altman, đã gọi điện cho cô. Ông ta bắt đầu bằng việc ca ngợi khả năng lãnh đạo của bà nhưng sau đó đưa ra một lời đe dọa ngầm, bày tỏ "mối lo ngại" về "danh tiếng" của bà và đề cập rằng một số đồng nghiệp cũ hiện coi bà là "kẻ thù". (Thông qua người phát ngôn, Kushner cho biết lời kể lại này "không cung cấp đầy đủ bối cảnh"; mặt khác, Altman tuyên bố không biết về cuộc gọi.)

Ngay từ đầu nhiệm kỳ CEO, Altman đã tuyên bố rằng OpenAI sẽ thành lập một công ty "có giới hạn lợi nhuận" do tổ chức phi lợi nhuận nắm giữ. Cấu trúc công ty rối rắm, gần như xoắn xuýt này rõ ràng là do chính Altman nghĩ ra. Trong quá trình chuyển đổi, một giám đốc tên là Holden Karnofsky đã lên tiếng phản đối, cho rằng sự sắp xếp này đã đánh giá thấp nghiêm trọng giá trị của tổ chức phi lợi nhuận. "Tôi không thể nào đồng tình với điều này được," Karnofsky nói. Theo ghi chép vào thời điểm đó, ông đã bỏ phiếu phản đối. Tuy nhiên, sau khi luật sư của hội đồng quản trị gợi ý rằng sự phản đối của ông "có thể là dấu hiệu đáng ngờ cho việc điều tra thêm về tính hợp pháp của cấu trúc mới", phiếu bầu của ông cuối cùng được ghi nhận là phiếu trắng và dường như không có sự đồng ý của ông - thậm chí có khả năng cấu thành hành vi làm giả hồ sơ thương mại. (OpenAI cho biết nhiều nhân viên nhớ rằng Karnofsky đã bỏ phiếu trắng và đã cung cấp biên bản cuộc họp làm bằng chứng.)

Vào tháng 10 năm ngoái, OpenAI đã trải qua quá trình "tái cấu trúc vốn", trở thành một thực thể kinh doanh vì lợi nhuận. Công ty này đã công khai tuyên bố rằng tổ chức phi lợi nhuận trực thuộc của họ — hiện được đặt tên là OpenAI Foundation — sẽ trở thành một trong những tổ chức giàu có nhất trong lịch sử. Tuy nhiên, hiện tại quỹ chỉ nắm giữ 26% cổ phần của công ty, và tất cả các thành viên hội đồng quản trị của quỹ, trừ một người, cũng đồng thời là thành viên hội đồng quản trị của công ty vì lợi nhuận.

Trong một phiên điều trần trước Quốc hội, Altman được hỏi liệu ông có "kiếm được nhiều tiền" hay không. Ông ấy trả lời, "Tôi không có bất kỳ cổ phần nào trong OpenAI..." Tôi làm điều này vì tôi yêu thích nó." Với cổ phần gián tiếp của ông thông qua các quỹ liên quan đến Y Combinator, câu trả lời này khá thận trọng. Về mặt kỹ thuật, điều đó là đúng. Tuy nhiên, một số cá nhân, trong đó có Altman, đã cho chúng tôi biết rằng tình hình này có khả năng sẽ sớm thay đổi. "Các nhà đầu tư sẽ nói, 'Tôi cần biết rằng khi mọi thứ trở nên khó khăn, các bạn vẫn sẽ tiếp tục làm điều này'", Altman nói, mặc dù ông cũng cho biết thêm rằng hiện tại không có "cuộc thảo luận tích cực" nào về vấn đề này. Theo một lời khai pháp lý, cổ phần của Greg Brockman trị giá khoảng 20 tỷ đô la, và về mặt lý thuyết, cổ phần của Altman phải cao hơn. Tuy nhiên, Altman nói với chúng tôi rằng tiền bạc không phải là động lực chính của ông. Một cựu nhân viên nhớ lại lời ông ấy nói: "Tôi không quan tâm đến tiền bạc." Tôi quan tâm đến quyền lực hơn.

Vào năm 2023, Altman và Oliver Mulherin đã tổ chức một lễ cưới nhỏ tại nhà riêng của họ ở Hawaii. (Hai người đã gặp nhau chín năm trước tại nhà của Peter Thiel, bên cạnh bồn tắm nước nóng vào đêm khuya.) Họ đã từng đón tiếp rất nhiều khách tại khu biệt thự đó, và những cảnh tượng được những vị khách mà chúng tôi phỏng vấn mô tả không vượt quá phạm vi thông thường của lối sống siêu giàu: bữa tối do đầu bếp riêng chuẩn bị, những chuyến du ngoạn ngắm hoàng hôn trên thuyền. Có một bữa tiệc đón năm mới theo chủ đề chương trình truyền hình thực tế Survivor ; những bức ảnh cho thấy một nhóm đàn ông cởi trần, tươi cười, trong đó có cả người dẫn chương trình, Jeff Probst. Altman cũng từng tổ chức những buổi tụ họp nhỏ tại các bất động sản khác của mình, trong đó ít nhất một sự kiện có màn chơi bài cởi đồ sôi nổi. (Bức ảnh bị rò rỉ không có Altman, nên không rõ ai là người chiến thắng cuối cùng, nhưng ít nhất ba người đàn ông dường như đã thua cuộc rõ ràng.) Nhiều vị khách cũ được phỏng vấn chỉ đề cập đến một điều: ông ấy quả thực là một chủ nhà hào phóng.

Những người tham gia điều tra cho biết không có báo cáo nào được ban hành vì chưa từng có báo cáo bằng văn bản chính thức nào. Những kết quả được cho là của cuộc điều tra chỉ được thông báo bằng miệng cho Summers và Taylor. "Bản đánh giá không kết luận rằng 'Sam trung thực như George Washington chặt cây anh đào'", một nguồn tin thân cận với cuộc điều tra cho biết. Nhưng nhìn chung, dường như cuộc điều tra không thực sự tập trung vào "vấn đề liêm chính" đằng sau việc sa thải Altman, mà phần lớn nỗ lực lại dành cho việc xác định xem có hành vi phạm tội rõ ràng hay không; theo tiêu chuẩn đó, cuộc điều tra cuối cùng kết luận rằng ông ta có thể tiếp tục giữ chức CEO. Không lâu sau, Altman đã giành lại được ghế trong hội đồng quản trị mà ông đã mất khi bị sa thải. Nguồn tin thân cận tiết lộ rằng một phần lý do không ghi lại kết quả điều tra bằng văn bản là do lời khuyên từ luật sư riêng của Summers và Taylor. (Summers từ chối bình luận công khai về vấn đề này; Taylor tuyên bố rằng vì đã có cuộc trao đổi miệng, "nên không cần một báo cáo bằng văn bản chính thức.")

Nhiều nhân viên hiện tại và cựu nhân viên của OpenAI cho biết họ rất sốc trước việc thiếu thông tin công khai. Altman khẳng định rằng ông tin tất cả các thành viên hội đồng quản trị gia nhập sau khi ông được phục chức đều đã được thông báo bằng miệng về những vấn đề này. "Đây hoàn toàn là lời nói dối," một người quen thuộc với vụ việc cho biết. Một số giám đốc cũng nói với chúng tôi rằng những nghi vấn đang được đặt ra về tính xác thực của những "kết quả điều tra" này thậm chí có thể dẫn đến việc "tiến hành lại cuộc điều tra" trong tương lai.

Nếu không có hồ sơ bằng văn bản, những cáo buộc này sẽ dễ bị giảm nhẹ mức độ nghiêm trọng hơn. Trong khi đó, sự thăng tiến không ngừng của Altman tại Thung lũng Silicon càng làm suy yếu sự giám sát từ bên ngoài đối với những vấn đề này. Một số nhà đầu tư nổi tiếng từng làm việc với ông đã kể cho chúng tôi về một thói quen được nhiều người biết đến của Altman: nếu một nhà đầu tư đặt cược vào đối thủ cạnh tranh của OpenAI, sau đó ông ta có thể "đưa họ vào danh sách đen". "Nếu họ đầu tư vào một dự án mà Sam không thích, đừng mong sẽ có bất kỳ cơ hội nào khác sau này," một người trong số họ nói. Một nguồn sức mạnh khác của Altman là mạng lưới đầu tư rộng lớn của ông, đôi khi thậm chí còn ảnh hưởng đến cả đời sống cá nhân của ông. Ông có mối quan hệ tài chính với một số đối tác cũ: một số liên quan đến việc cùng quản lý quỹ, một số khác ông dẫn đầu các khoản đầu tư, và một số là các khoản đầu tư chung thường xuyên. Việc này không phải là hiếm gặp ở Thung lũng Silicon. Nhiều giám đốc điều hành dị tính cũng hành xử theo cách này. ("Bạn phải làm vậy thôi," một CEO nổi tiếng nói với chúng tôi.) Chính Altman đã tuyên bố: "Rõ ràng, tôi đã đầu tư cùng một số người yêu cũ sau khi chúng tôi chia tay, và tôi nghĩ điều đó hoàn toàn ổn." Nhưng chính cách sắp xếp này lại tạo ra mức độ phụ thuộc rất cao. "Điều này về cơ bản tạo ra một sự phụ thuộc rất, rất mạnh mẽ," một người thân cận với Altman cho biết, "nhiều khi, thậm chí là sự phụ thuộc suốt đời."

Tuy nhiên, nhiều tin đồn xoay quanh đời tư của Sam Altman đã bị các đối thủ cạnh tranh lợi dụng và thậm chí xuyên tạc. Cạnh tranh khốc liệt trong kinh doanh không phải là điều mới mẻ, nhưng cạnh tranh trong ngành trí tuệ nhân tạo lại trở nên đặc biệt tàn khốc. "Giống như trong kịch Shakespeare," một giám đốc điều hành của OpenAI mô tả, và nói thêm, "Những quy tắc thông thường của trò chơi dường như không còn áp dụng nữa." Một số người trung gian có liên hệ trực tiếp với Elon Musk, thậm chí trong một số trường hợp còn nhận được tiền tài trợ từ ông, đã phát tán hàng chục trang "nghiên cứu phản bác" về Altman. Những tài liệu này cho thấy mức độ giám sát rất cao: bao gồm các công ty ma có liên quan đến ông ta, thông tin liên lạc cá nhân, và thậm chí cả biên bản phỏng vấn với một người được gọi là gái mại dâm tại một quán bar dành cho người đồng tính. Một người trung gian cũng tuyên bố rằng lịch trình các chuyến bay và các bữa tiệc mà Altman tham dự đều đang bị theo dõi. Altman nói với chúng tôi: "Tôi cảm thấy như không ai được thuê để điều tra về tôi kỹ lưỡng hơn chính bản thân tôi."

Trong khi đó, nhiều lời cáo buộc cực đoan khác nhau cũng đang lan truyền. Nhân vật truyền thông cánh hữu Tucker Carlson đã ám chỉ mà không có bất kỳ bằng chứng nào rằng Altman có liên quan đến cái chết của một người tố giác, một tuyên bố mà các đối thủ cạnh tranh liên tục khuếch đại. Annie, em gái của Altman, đã tuyên bố trong một vụ kiện và trong một cuộc phỏng vấn với chúng tôi rằng ông ta đã lạm dụng tình dục cô từ khi cô ba tuổi và ông ta mười hai tuổi. (Chúng tôi không thể xác minh những lời khẳng định của Annie.) Altman phủ nhận điều này, và mẹ cùng anh trai của ông cũng khẳng định rằng những cáo buộc này là "hoàn toàn sai sự thật" và đã gây ra "nỗi đau đớn tột cùng" cho toàn bộ gia đình. Trong một cuộc phỏng vấn do nhà báo Karen Hao thực hiện cho cuốn sách "Đế chế Trí tuệ Nhân tạo" của bà, Annie cho biết những ký ức này được khôi phục lại trong những "hồi ức" khi bà trưởng thành.

Ngoài ra, một số cá nhân từ các công ty và फर्म đầu tư cạnh tranh cũng ám chỉ với chúng tôi rằng Altman có liên quan đến các hoạt động tình dục với người chưa đủ tuổi – một lời cáo buộc được lan truyền rộng rãi ở Thung lũng Silicon mà dường như cũng không có căn cứ. Chúng tôi đã dành nhiều tháng để điều tra, tiến hành hàng chục cuộc phỏng vấn và không tìm thấy bằng chứng nào ủng hộ tuyên bố này. Altman đáp lại: "Đây là một thủ đoạn đáng ghê tởm mà tôi tin là các đối thủ đang cố gắng 'đầu độc bồi thẩm đoàn' cho các vụ án trong tương lai." Mặc dù nghe có vẻ vô lý, tôi vẫn muốn khẳng định: mọi cáo buộc về việc tôi có quan hệ tình dục với trẻ vị thành niên, thuê gái mại dâm hoặc liên quan đến giết người đều hoàn toàn sai sự thật. Ông cũng nói thêm rằng ông "phần nào biết ơn" vì chúng tôi đã dành "nhiều tháng trời để điều tra những vấn đề này một cách kỹ lưỡng".

Sam Altman thừa nhận từng có quan hệ tình cảm với những thanh niên đủ tuổi hợp pháp. Chúng tôi đã phỏng vấn một số cộng sự của ông ấy, và tất cả đều nói rằng họ không thấy có vấn đề gì với việc này. Tuy nhiên, "thông tin phản biện" từ phía Elon Musk đã cố tình biến điều này thành một điểm tấn công. (Những tài liệu này thậm chí còn bao gồm một số tuyên bố giật gân và chưa được kiểm chứng, chẳng hạn như cái gọi là "Đội quân Twink" và "Sở thích tình dục của Sugar Daddy.") Altman đáp lại, "Có rất nhiều sự kỳ thị đồng tính luyến ái được khuếch đại lẫn lộn trong đây." Nhà báo chuyên về công nghệ Kara Swisher cũng đồng ý: "Tất cả những người giàu có này đã làm đủ mọi chuyện tai tiếng, còn tai tiếng hơn bất cứ điều gì tôi từng nghe về Sam." Nhưng vì anh ấy là người đồng tính ở San Francisco, điều đó đang bị lợi dụng như một vũ khí."

Trong thập kỷ qua, các giám đốc điều hành của các công ty truyền thông xã hội từng hứa hẹn họ có thể "thay đổi thế giới" mà hầu như không có tác dụng phụ, bác bỏ các yêu cầu về quy định là "những kẻ chống lại công nghệ", cuối cùng gây ra sự phẫn nộ từ cả hai phe chính trị. Ngược lại, hình ảnh của Altman lại có vẻ đặc biệt "tự nhận thức". Ông không những không né tránh việc ban hành quy định mà còn chủ động kêu gọi điều đó. Năm 2023, khi điều trần trước Ủy ban Tư pháp Thượng viện Hoa Kỳ, ông đề xuất thành lập một cơ quan liên bang mới để điều chỉnh các mô hình trí tuệ nhân tạo tiên tiến. "Nếu công nghệ này gặp trục trặc, hậu quả sẽ rất nghiêm trọng," ông nói. Thượng nghị sĩ bang Louisiana, John Kennedy, nổi tiếng với những lời chỉ trích gay gắt đối với các CEO của các công ty công nghệ, thậm chí dường như cũng có phần tán thành, nửa đùa nửa thật đề nghị rằng Altman nên tự mình chịu trách nhiệm về việc điều tiết.

Tuy nhiên, trong khi công khai ủng hộ việc điều chỉnh, Altman cũng bí mật vận động chống lại nó. Theo tạp chí Time , trong giai đoạn từ năm 2022 đến năm 2023, OpenAI đã thành công trong việc làm giảm nhẹ một đề xuất quy định của Liên minh châu Âu nhắm vào các công ty AI lớn. Vào năm 2024, cơ quan lập pháp California đã đưa ra một dự luật yêu cầu kiểm tra an ninh đối với các mô hình trí tuệ nhân tạo, nhiều mô hình trong số đó phản ánh khá sát với những kiến nghị mà Altman đã đưa ra tại Quốc hội. OpenAI đã công khai phản đối dự luật và gây áp lực ngầm. "Suốt năm đó, chúng tôi nhận thấy hành vi của OpenAI ngày càng trở nên xảo quyệt và lừa dối hơn," một trợ lý lập pháp nói với chúng tôi.

Trong khi đó, Musk tiếp tục công khai chỉ trích Altman, gọi ông ta là "Altman lừa đảo" và "Sam gian xảo". (Khi Altman phàn nàn về sự cố với một chiếc Tesla trên tuyến X, Musk đáp lại, "Ông đã ăn cắp tiền của một tổ chức phi lợi nhuận.) Nhưng ở Washington, Altman dường như chiếm ưu thế. Trước đây, Musk từng đóng góp hơn 250 triệu đô la để giúp Donald Trump tái đắc cử, và từng giữ chức Tổng thống trong một thời gian ngắn trước khi rời đi, điều này đã làm rạn nứt mối quan hệ của ông với Trump.

Ngày nay, Altman đã trở thành một trong những ông trùm công nghệ được Trump ưu ái nhất, thậm chí còn cùng ông đến thăm lâu đài Windsor ở Anh. Hai người nói chuyện với nhau vài lần mỗi năm. "Bạn có thể gọi điện trực tiếp cho anh ấy," Altman nói. "Đó không phải là tình bạn kiểu đó, nhưng nếu tôi cần nói chuyện với anh ấy về việc gì đó, tôi sẽ gọi điện." Khi ông Trump tiếp đón các lãnh đạo công nghệ tại Nhà Trắng năm ngoái, Musk vắng mặt, và Altman ngồi đối diện với tổng thống. "Sam, cậu là một nhân vật quan trọng đấy," Trump nói với anh ta. "Trước đây anh/chị đã kể cho tôi nghe một vài chuyện khó tin."

Nhà đầu tư Ron Conway cũng đã vận động các nhân vật chính trị, bao gồm Nancy Pelosi và Gavin Newsom, để thúc đẩy việc bác bỏ dự luật nói trên. Cuối cùng, mặc dù dự luật nhận được sự ủng hộ của cả hai đảng và được thông qua, nhưng đã bị Newsom phủ quyết. Năm nay, một số ứng cử viên quốc hội ủng hộ việc điều chỉnh AI đã phải đối mặt với các đối thủ được tài trợ bởi "Leading the Future", một siêu PAC ủng hộ AI. OpenAI chính thức tuyên bố sẽ không quyên góp cho các tổ chức như vậy, nhưng người đồng sáng lập Greg Brockman đã cam kết quyên góp 50 triệu đô la. (Cũng trong năm đó, ông và vợ đã quyên góp 25 triệu đô la cho một siêu PAC ủng hộ Trump.)

Các hành động của OpenAI vượt xa hoạt động vận động hành lang truyền thống. Năm ngoái, khi Thượng viện California đề xuất một phiên bản sửa đổi của dự luật, Nathan Calvin, một luật sư của tổ chức vì lợi ích công cộng tham gia soạn thảo dự luật, đã nhận được trát triệu tập từ OpenAI trong một bữa tối tại nhà. Công ty này tuyên bố mục đích là để điều tra xem Musk có bí mật tài trợ cho những người chỉ trích hay không, nhưng đã yêu cầu tất cả các thông tin liên lạc riêng tư của Calvin liên quan đến dự luật. "Họ hoàn toàn có thể hỏi thẳng chúng tôi xem có nhận được tiền từ Musk hay không — chúng tôi hoàn toàn không nhận được gì cả," ông nói. Những người ủng hộ dự luật khác, cũng như những người chỉ trích quá trình thương mại hóa của OpenAI, cũng nhận được trát triệu tập tương tự. "Họ đang cố gắng đe dọa những người này để họ im lặng," Don Howard, người đứng đầu tổ chức vì lợi ích công cộng, cho biết. (OpenAI cho biết đây là một phần của quy trình pháp lý thông thường.)

Về lập trường chính trị, Altman từ lâu đã ủng hộ Đảng Dân chủ. Ông ấy đã tuyên bố: "Tôi rất cảnh giác với những nhà cầm quyền độc đoán sử dụng luận điệu hù dọa để đàn áp kẻ yếu - điều này xuất phát từ nền tảng Do Thái của tôi hơn là xu hướng tình dục của tôi." Năm 2016, ông ủng hộ Hillary Clinton, gọi Trump là "mối đe dọa chưa từng có đối với nước Mỹ"; năm 2020, ông quyên góp cho Đảng Dân chủ và quỹ tranh cử của Biden. Trong nhiệm kỳ của Joe Biden, ông đã nhiều lần đến Nhà Trắng để thảo luận về chính sách và góp phần thúc đẩy việc xây dựng khuôn khổ pháp lý an ninh trí tuệ nhân tạo cấp liên bang đầu tiên.

Tuy nhiên, đến năm 2024, khi tỷ lệ ủng hộ Biden giảm, quan điểm của Altman bắt đầu thay đổi: "Bất kể kết quả bầu cử thế nào, nước Mỹ vẫn sẽ ổn thôi." Sau chiến thắng của Trump, ông đã quyên góp 1 triệu đô la cho quỹ lễ nhậm chức của mình và chụp ảnh cùng những người nổi tiếng trên mạng Jake và Logan Paul tại lễ nhậm chức. Trên X, anh ấy viết, "Gần đây tôi đã theo dõi @potus kỹ hơn, và điều đó thực sự đã thay đổi nhận thức của tôi về ông ấy (ước gì tôi đã suy nghĩ độc lập hơn sớm hơn...)." Ngay trong ngày đầu tiên nhậm chức, Trump đã bãi bỏ các sắc lệnh hành pháp về trí tuệ nhân tạo từ thời Biden. Một cựu quan chức cấp cao của chính phủ nhận xét: "Ông ấy đã tìm ra một cách hiệu quả để khiến chính quyền Trump làm việc có lợi cho mình."

Trong nhiều năm qua, Altman luôn ví sự phát triển của trí tuệ nhân tạo tổng quát (AGI) như "Dự án Manhattan". Giống như J. Robert Oppenheimer từng huy động các nhà khoa học với tinh thần trách nhiệm "chống lại Đức Quốc xã", Altman cũng tận dụng câu chuyện về cạnh tranh địa chính trị để thu hút sự ủng hộ. Khi đối diện với các đối tượng khán giả khác nhau, ông ấy sử dụng phép so sánh này một cách linh hoạt — đôi khi nhấn mạnh sự tăng tốc, đôi khi nhấn mạnh sự thận trọng. Vào mùa hè năm 2017, trong một cuộc gặp với các quan chức tình báo Mỹ, ông tuyên bố rằng Trung Quốc đã khởi động "Dự án Manhattan về Trí tuệ Nhân tạo tổng quát" và sử dụng điều này để tìm kiếm sự hỗ trợ tài chính từ chính phủ. Khi được yêu cầu cung cấp bằng chứng, ông ta chỉ nói, "Tôi đã nghe một số điều," nhưng không bao giờ đưa ra bằng chứng cụ thể. Một quan chức chính phủ tham gia vào cuộc điều tra sau đó tuyên bố rằng không tìm thấy dự án nào như vậy: "Nghe có vẻ giống như một lời chào hàng hơn." (Altman khẳng định không nhớ mình đã nói như vậy.)