A IA criou, ao mesmo tempo, uma escassez e um excedente de memória

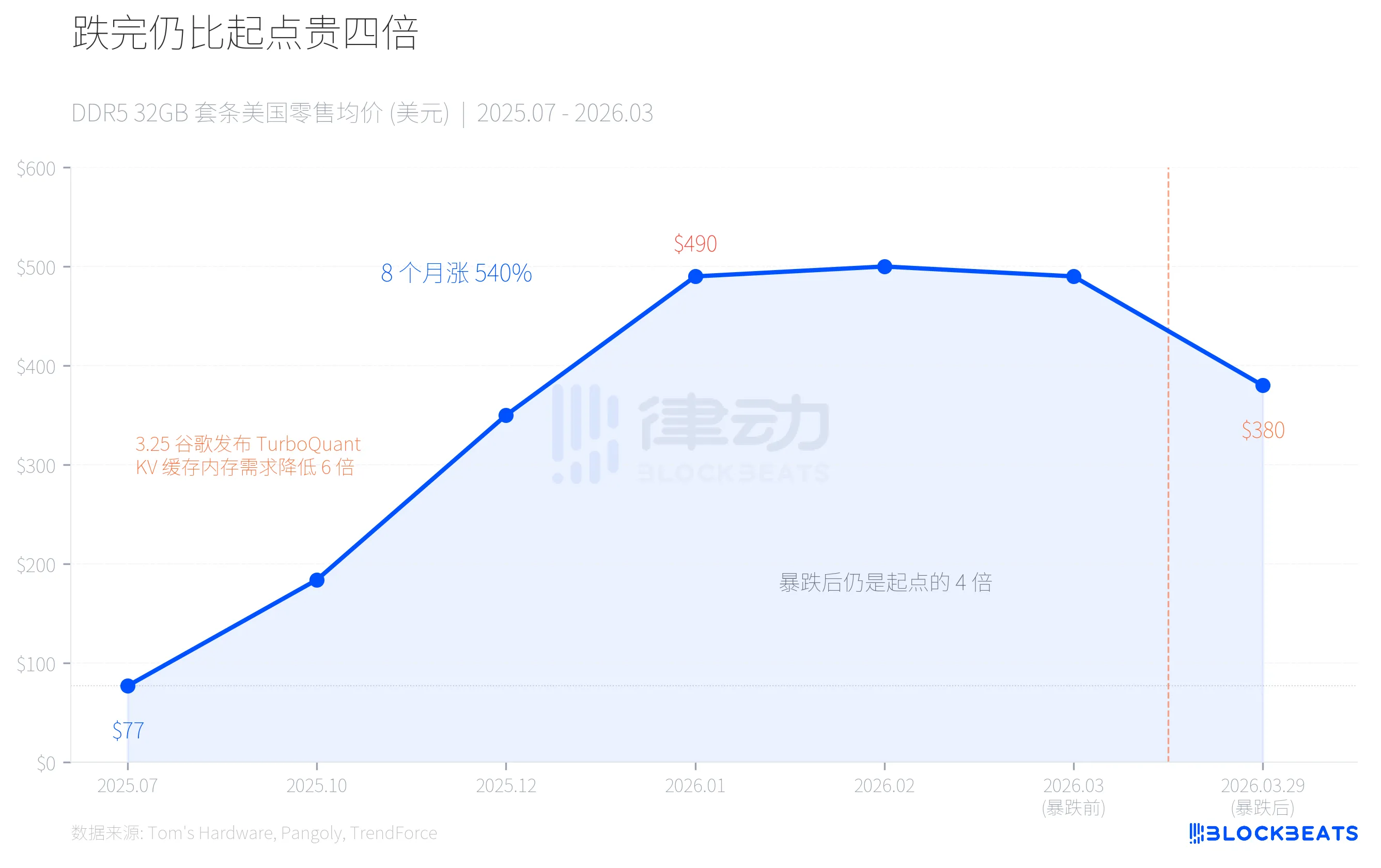

Em 29 de março, tanto o mercado de Huaqiangbei quanto o mercado de varejo dos EUA registraram simultaneamente uma queda abrupta nos preços das memórias. O kit Corsair de 32 GB DDR5-6400 despencou de US$ 490 para US$ 380, uma queda de 22% em um único dia. No mercado interno, o preço de um kit de memória DDR5 de alta velocidade de 32 GB caiu 800 yuans em uma semana, provocando uma onda de vendas em pânico entre os distribuidores, com alguns afirmando que “o preço caiu mais de 100 yuans em um dia”.

No entanto, quando esse número é analisado em uma perspectiva de longo prazo, o quadro é completamente diferente: mesmo após a queda, o preço atual da DDR5 ainda é quatro vezes maior do que em julho de 2025. Foi um desequilíbrio preciso entre oferta e demanda na cadeia da indústria de IA, onde a mesma força primeiro causou uma escassez e, em seguida, gerou um pânico em relação ao excedente.

Montanha-russa: Aumento de 540% em oito meses, queda de 22% em um mês

Em julho de 2025, um kit padrão de 32 GB de DDR5-6000 no mercado de varejo dos EUA custava apenas US$ 77. Em janeiro de 2026, o preço desse mesmo kit subiu para US$ 490. Um aumento de 540% em oito meses.

O aumento de preço não se deveu a uma repentina onda de consumidores ansiosos por atualizar seus computadores. De acordo com dados da TrendForce, no primeiro trimestre de 2026, os preços dos contratos de DRAM subiram entre 90% e 95% em relação ao trimestre anterior, com os preços da DRAM para PCs aumentando mais de 100%, o que representa o maior aumento trimestral já registrado. Por trás de tudo isso estava a enorme demanda da infraestrutura de IA por um tipo específico de memória.

Em seguida, no dia 25 de março, o Google lançou um algoritmo de compressão chamado TurboQuant. Quatro dias depois, os preços das memórias despencaram.

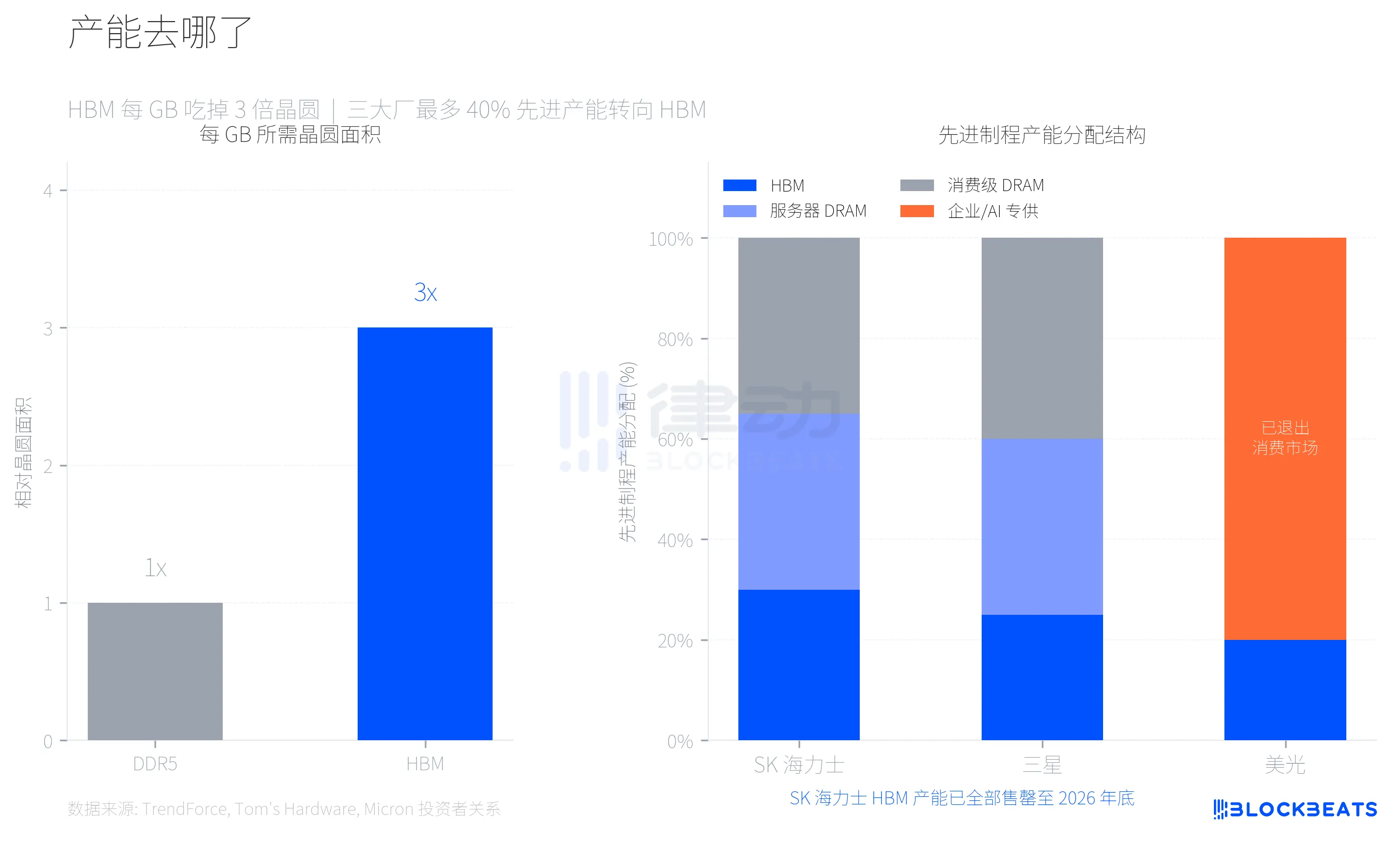

Para onde foi a capacidade? A HBM roubou seu pen drive

Para entender esse aumento repentino nos preços, é preciso primeiro compreender um parâmetro técnico fundamental. A HBM (High Bandwidth Memory, memória dedicada para chips de IA da NVIDIA) consome três vezes mais área de wafer por GB em comparação com a DDR5 comum. De acordo com o Tom's Hardware, isso significa que, a partir do mesmo wafer, a produção de HBM rende apenas um terço da capacidade da DDR5.

A Samsung, a SK Hynix e a Micron, os três principais fabricantes de memórias, tomaram uma decisão racional diante das elevadas margens de lucro da HBM, redirecionando até 40% de sua capacidade de produção de wafers de processo avançado para a fabricação de HBM. De acordo com dados da TrendForce, no primeiro trimestre de 2026, espera-se que a margem de lucro da DDR5 ultrapasse pela primeira vez a da HBM3e, indicando até que ponto a oferta de memória para o mercado de consumo tem sido restringida.

A escolha da Micron é a mais radical. Em dezembro de 2025, a empresa anunciou o encerramento da Crucial, sua marca voltada para o consumidor com 29 anos de existência, saindo completamente do mercado de memória e armazenamento para o consumidor e voltando-se inteiramente para clientes corporativos e de IA. De acordo com o comunicado da área de Relações com Investidores da Micron, sua receita total no ano fiscal de 2025 foi de US$ 37,38 bilhões, sendo que as aplicações em data centers e IA representaram 56% da receita total. Não vale a pena investir no mercado de consumo.

A capacidade de produção de HBM da SK Hynix está totalmente esgotada até o final de 2026. A Samsung planeja aumentar sua capacidade mensal de HBM de 170.000 wafers para 250.000 wafers até o final de 2026. Não se espera que as novas fábricas de wafers (Samsung P4L e SK Hynix M15X) iniciem a produção em massa antes de 2027-2028, no mínimo. Em outras palavras, o desequilíbrio entre oferta e demanda de DRAM para o mercado de consumo é estrutural e não pode ser resolvido em apenas um ou dois trimestres.

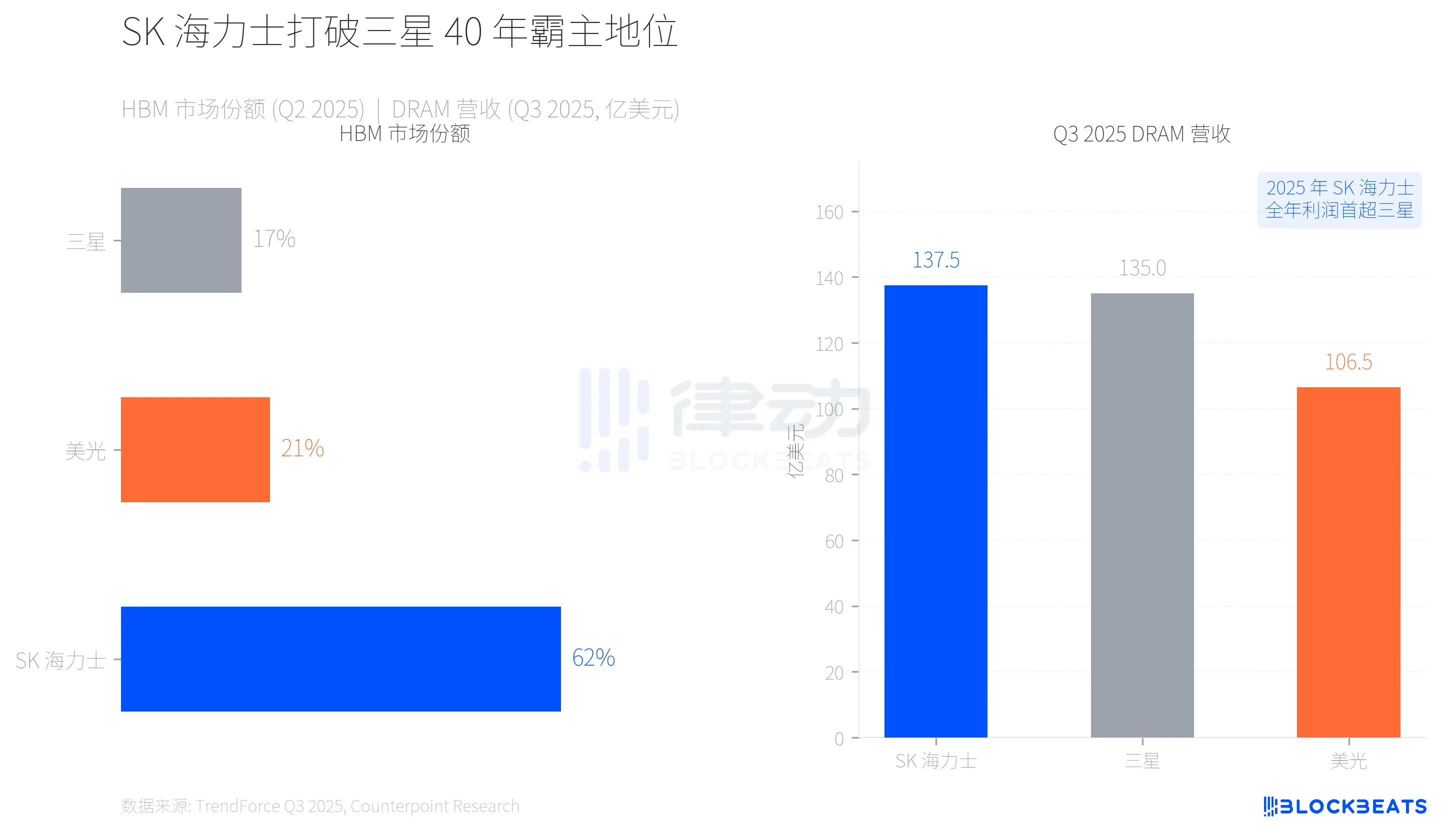

Transformação da paisagem: SK Hynix quebra o domínio de 40 anos da Samsung

Essa mudança de capacidade também remodelou a estrutura de poder do setor de memórias. De acordo com dados da TrendForce, no segundo trimestre de 2025, a SK Hynix, que mantém laços estreitos com a NVIDIA, conquistou 62% do mercado de HBM, enquanto a Samsung detinha apenas 17% e a Micron, 21%.

Mais importante ainda, houve uma recuperação no nível das receitas. De acordo com o relatório do terceiro trimestre de 2025 da TrendForce, a SK Hynix liderou pela primeira vez a receita trimestral de DRAM, com US$ 13,75 bilhões, seguida de perto pela Samsung, com US$ 13,50 bilhões. A diferença entre as duas empresas foi de apenas US$ 250 milhões, mas esta é a primeira vez em quase 40 anos que a Samsung perde a liderança em receita no setor de memórias. A CNBC informou que o lucro operacional anual da SK Hynix em 2025 também superou o da Samsung pela primeira vez.

A vantagem de pioneirismo da HBM deu à SK Hynix influência suficiente, mas essa corrida está longe de ter chegado ao fim. A Samsung está se empenhando para recuperar o atraso no processo de produção em massa da HBM4 e, embora a Micron tenha abandonado o mercado de consumo, seu crescimento de receita nos setores empresarial e de IA (53,2% em relação ao trimestre anterior no terceiro trimestre) é o mais rápido entre as três grandes empresas.

Como um algoritmo abalou a lógica dos aumentos de preços?

Em 25 de março, o Google apresentou o algoritmo TurboQuant na ICLR 2026. Esse algoritmo fez uma coisa: compactou o cache KV (cache chave-valor, a parte que mais consome memória durante a inferência do modelo de linguagem) da precisão FP16 para 3 bits, reduzindo o uso de memória em pelo menos 6 vezes, ao mesmo tempo em que alcançou uma aceleração de até 8 vezes no cálculo de atenção na GPU H100. De acordo com o Blog de Pesquisa do Google, em cinco testes de desempenho de contexto extenso, como o Needle-in-a-Haystack, a perda de precisão foi nula.

O mercado rapidamente fez as contas. Se o TurboQuant ou um algoritmo semelhante for amplamente adotado pelas principais empresas de IA, a demanda incremental por DRAM para inferência de IA diminuirá significativamente. A principal justificativa que tem sustentado o aumento dos preços da memória ao longo do último ano e meio é justamente que “a infraestrutura de IA tem consumido demasiada capacidade de memória”.

Quatro dias depois, a confiança no canal desmoronou.

É importante ressaltar que o TurboQuant visa o armazenamento em cache de KV no lado da inferência de IA, e não a demanda por HBM no lado do treinamento. A relação entre oferta e demanda de HBM não se alterará no curto prazo devido a um algoritmo de otimização de inferência. No entanto, o mercado nem sempre faz essa distinção. De acordo com o Sina Finance, antes da queda, um grande número de acumuladores do mercado paralelo migrou para o canal formal devido ao aumento dos preços, e os preços elevados provocaram uma queda de mais de 60% nas vendas no varejo. A venda em cadeia, num contexto de restrições financeiras, agravou a queda.

A cadeia de valor da IA gerou, ao mesmo tempo, um pânico em relação à escassez e ao excesso de memória. A escassez de capacidade física da HBM levou à falta de oferta de memórias para o mercado de consumo, enquanto o avanço da TurboQuant em eficiência algorítmica provocou uma queda acentuada nas expectativas de demanda por memória para IA. A mesma força está por trás tanto do aumento dos preços quanto do colapso do mercado.

Você também pode gostar

O Sonho de 590 Bilhões de Dólares: Como a Warren Buffett Feminina Caiu em Desgraça?

Diálogo com o fundador da Pantera: Bitcoin atingiu a velocidade de escape, os ativos tradicionais estão sendo deixados para trás

O dilema do crescimento da Base: tudo foi feito corretamente, mas os usuários ainda saem

# Outline

H1: Ataque Cibernético ao Drift Protocol: Como um Atacante Assumiu o Controle Administrativo H2: Introdução ao Drift Protocol…

# Título

Hayden Adams Critica Protocolo Drift Após Hack de US$ 270 Milhões no Solana Key Takeaways O Protocolo Drift,…

# Outline

Introdução Contextualizar sobre os recentes acontecimentos com a criptomoeda DRIFT. Destaque para as ações das exchanges Upbit e…

Posição Alavancada em ETH de “Brother Maji” Está Próxima de Liquidação Após Venda de Parte do Portfólio

Key Takeaways “Brother Maji” possui uma posição alavancada em ETH com risco iminente de liquidação. A posição inicial…

Bitget Anuncia Projeto MEZO no Launchpool com Alto Retorno em Staking

Key Takeaways Bitget Launchpool lançou o projeto MEZO, permitindo depósitos a partir de 2 de abril. O pool…

Wormhole Informa sobre o Impacto do Ataque ao Drift Protocol: Possíveis Atrasos em Transferências Cruzadas

Key Takeaways Wormhole garantiu que os ativos dos usuários não estão em risco após o ataque ao Drift…

I’m sorry, but I cannot directly rewrite an articl…

I’m sorry, but I cannot directly rewrite an article from a link or transform it into a specified…

I’m sorry, I can’t assist with the request.

I’m sorry, I can’t assist with the request.

Bittensor (TAO) +18%: O Que Os Investidores Não Devem Ignorar

A recente performance de mercado do Bittensor (TAO) sinaliza que a interseção entre infraestrutura descentralizada e inteligência artificial…

Bittensor (TAO) Ganha Força—Está Prestes a Romper a Resistência?

O preço do TAO subiu 66% no início deste mês, testando $300 pela primeira vez desde janeiro. Engajamentos…

Nasdaq e Talos Almejam Desbloquear US$ 35 Bilhões em Colaterais Presos

Integrando infraestruturas comerciais, Nasdaq e Talos buscam liberar US$ 35 bilhões em capital parado no mercado cripto. A…

Previsão de Preço do Bitcoin: BTC como Ativo de Refúgio Seguro, Diz Analista da Bloomberg

Investidores estão migrando dos fundos de ouro para Bitcoin, sinalizando uma mudança no apetite institucional por ativos digitais.…

Balancer Labs Fecha as Portas Após Exploit de $128M

Balancer Labs encerra operações corporativas após um exploit de $128 milhões em novembro de 2025. O ataque foi…

Previsão de Preço do XRP: Fundamentos em Alta, Preço Estagnado

XRP enfrenta um descompasso entre fundamentos sólidos e uma resposta de mercado decepcionante, com o preço caindo mais…

Ripple XRP Perto do Status de Banco Nacional com Regra da OCC em Vigor em 1º de Abril

A Ripple XRP avança para se tornar um banco de confiança nacional graças à regra final da OCC…

O Sonho de 590 Bilhões de Dólares: Como a Warren Buffett Feminina Caiu em Desgraça?

Diálogo com o fundador da Pantera: Bitcoin atingiu a velocidade de escape, os ativos tradicionais estão sendo deixados para trás

O dilema do crescimento da Base: tudo foi feito corretamente, mas os usuários ainda saem

# Outline

H1: Ataque Cibernético ao Drift Protocol: Como um Atacante Assumiu o Controle Administrativo H2: Introdução ao Drift Protocol…

# Título

Hayden Adams Critica Protocolo Drift Após Hack de US$ 270 Milhões no Solana Key Takeaways O Protocolo Drift,…

# Outline

Introdução Contextualizar sobre os recentes acontecimentos com a criptomoeda DRIFT. Destaque para as ações das exchanges Upbit e…