Feudo OpenAI: Poder, confianza y límites incontrolables de AGI

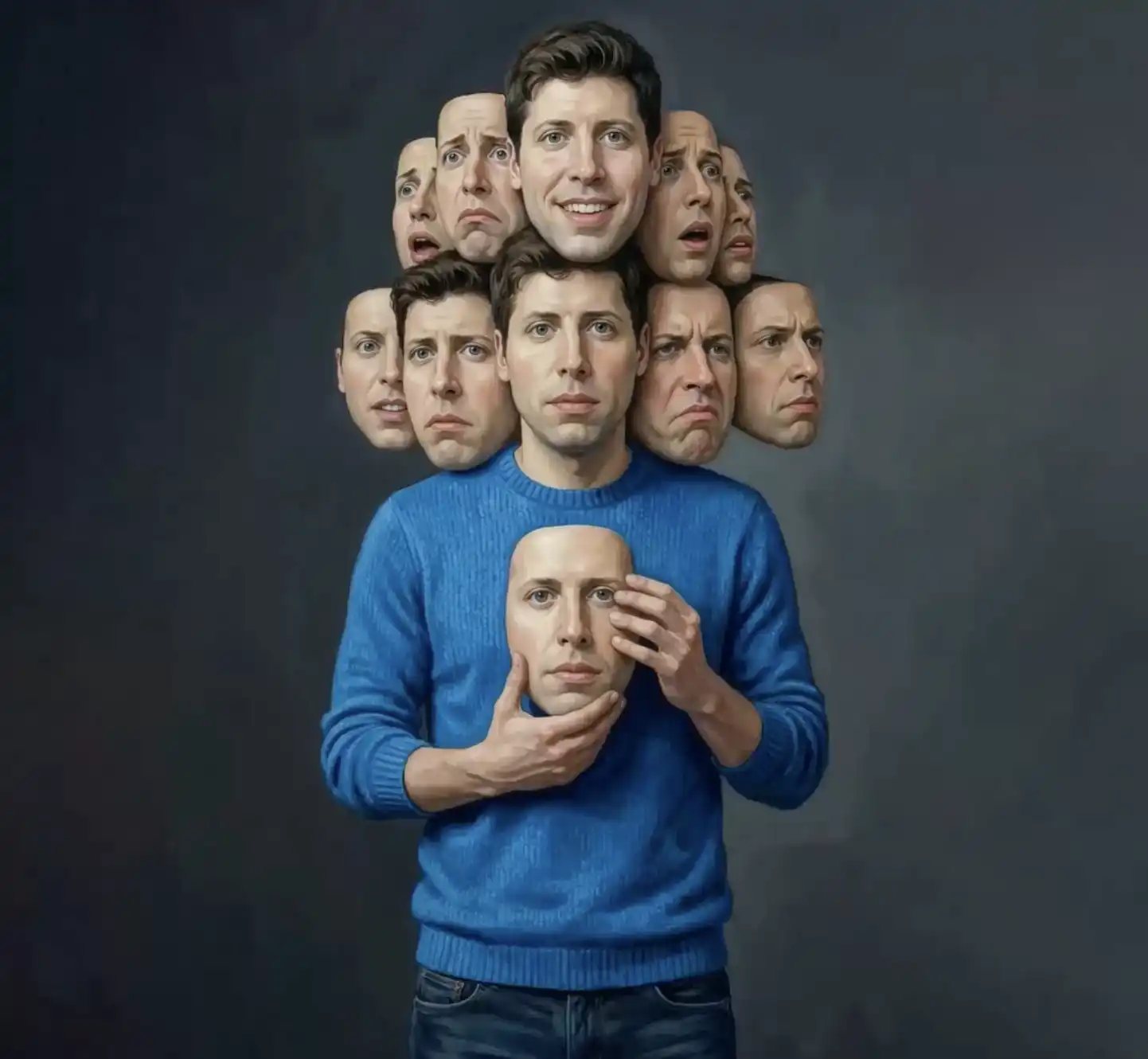

Título original del artículo: Sam Altman puede controlar nuestro futuro: ¿Se puede confiar en él?

Artículo original Autores: Ronan Farrow y Andrew Marantz, el neoyorquino

Traducción: Peggy, bloque

Nota del editor: Este artículo, a través de una gran cantidad de documentos inéditos y entrevistas en profundidad, revisa la crisis interna dentro de OpenAI con respecto al poder y la confianza de Sam Altman. De la destitución de la junta directiva a una rápida renovación en un “cambio similar a un golpe de Estado”, esta agitación no fue un evento puntual, sino una erupción concentrada de conflictos de gobernanza de en long data.

El núcleo del conflicto es un continuo tira y afloja entre dos conjuntos de lógicas: por un lado, la misión sin fines de lucro de OpenAI fundada en “la seguridad humana primero”, y por otro lado, un cambio gradual hacia un camino de desarrollo orientado hacia los productos, la escala y los ingresos a medida que se acerca AGI y acelera la comercialización. En este proceso, se han ido debilitando continuamente las asignaciones destinadas a la seguridad y el poder y la adopción de decisiones se han ido centralizando gradualmente entre unos pocos.

Muchas figuras clave, entre ellas Ilya Sutskever y Dario Amodei, han cuestionado a Altman, centrándose en la opacidad de la información y la expresión estratégica, creyendo que su estilo de liderazgo es insuficiente para gobernar con solidez la tecnología que "cambiará el destino de la humanidad"; sus partidarios, sin embargo, enfatizan que su capacidad en la integración de recursos, la operación de capital y la ejecución es clave para la rápida expansión de OpenAI.

Cuando el poder tecnológico es suficiente para influir en el orden mundial, ¿sigue siendo suficiente la estructura de gobierno corporativo existente para limitar individuos? En otras palabras, en la era de la inteligencia artificial, la verdadera incertidumbre puede no provenir solo de la tecnología en sí misma, sino de aquellos que controlan la tecnología.

A continuación tienes el artículo original:

Poder y confianza: Fisuras de gobernanza bajo el liderazgo de Altman

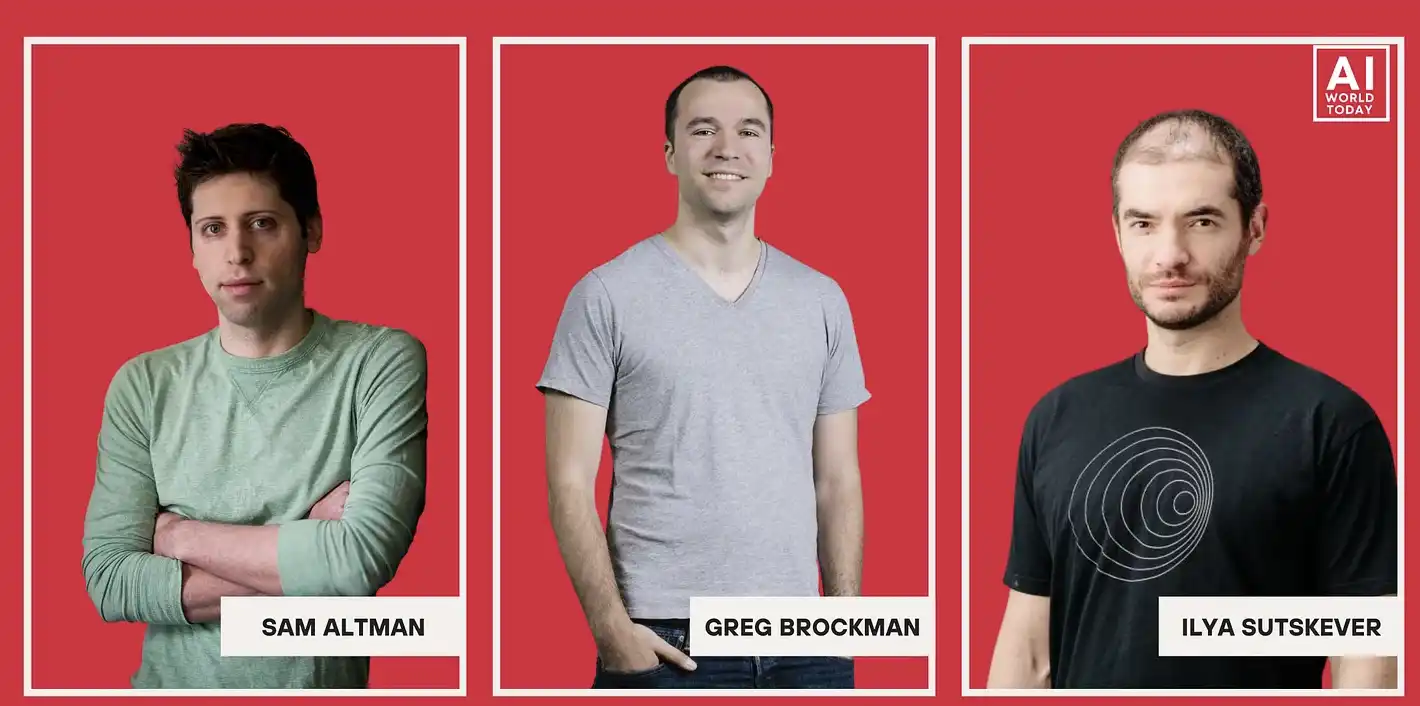

En el otoño de 2023, el Científico Jefe de OpenAI, Ilya Sutskever, envió un memorando secreto a los otros tres miembros de la junta directiva de la Empresa. En las semanas precedentes, habían estado discutiendo en privado un tema sensible: si el CEO de la Empresa Sam Altman y su adjunto Greg Brockman aún estaban en condiciones de seguir liderando la Empresa.

Fuente de la imagen: MUNDO DE IA HOY

Sutskever una vez los consideró amigos. En 2019, incluso organizó la boda de Brockman en la oficina de OpenAI, donde incluso había un brazo robótico que actuaba como el "portador del anillo".

Pero a medida que se convencía cada vez más de que la Empresa se acercaba a su objetivo en long plazo —crear una inteligencia artificial que pudiera igualar o superar las capacidades cognitivas humanas— sus dudas sobre Altman se profundizaban. Como se lo dijo a otro miembro de la junta en ese momento, "no creo que Sam sea la persona que debería tener el dedo en el botón".

A petición de otros miembros de la junta, Sutskever, junto con colegas de ideas afines, elaboró un documento de alrededor de setenta páginas, que incluía registros de chat de Slack, archivos de RR.HHH. y comentarios adjuntos. Parte del contenido incluso fueron capturas de pantalla tomadas con un teléfono, aparentemente para evitar la supervisión por parte de los dispositivos de la Empresa. evento envió estos memorandos a otros miembros de la junta directiva de una manera de "leer y quemar" para asegurarse de que no fueran vistos por más personas.

"Estaba realmente asustado en ese momento", recordó un director que recibió los materiales. Revisamos estos memorandos, que nunca antes se habían divulgado por completo. Los documentos acusaban a Altman de distorsionar los hechos ante ejecutivos y miembros del directorio y de comportamiento engañoso en torno a protocolos internos de seguridad. Un memorando sobre Altman comenzó con una lista de elementos titulada “Sam se ha mostrado consistentemente...”, y el primer elemento fue “Mentirosa”.

Muchas empresas tecnológicas afirman "hacer del mundo un lugar mejor", pero sus operaciones reales giran en torno a maximizar los ingresos. El principio fundacional de OpenAI, sin embargo, estaba destinado a ser diferente de este modelo. Sus fundadores, entre ellos Altman, Sutskever, Brockman y Elon Musk, creían que la inteligencia artificial podría ser uno de los inventos más poderosos y potencialmente peligrosos de la historia de la humanidad. En el contexto de este "riesgo existencial", la Empresa puede requerir una estructura organizativa no convencional.

OpenAI se estableció inicialmente como una organización sin fines de lucro, con su junta tarea de colocar "la seguridad de toda la humanidad" por encima del éxito de la Empresa, incluso priorizándola sobre la propia supervivencia de la Empresa. El CEO necesitaría poseer un carácter y una ética extraordinarios.

Como dijo Sutskever, "Cualquier persona involucrada en la construcción de esta tecnología que podría cambio civilización tal como la conocemos conlleva una gran responsabilidad y un deber sin precedentes". Pero también señaló que "aquellos que terminan en estas posiciones suelen ser de un determinado tipo: personas hambrientas de poder, tipos políticos, o aquellos que simplemente disfrutan del poder por su propio bien". En un memorando, expresó su preocupación por confiar esta tecnología a alguien "que solo dice lo que los demás quieren escuchar".

Si finalmente se descubre que el CEO de OpenAI no es confiable, entonces esta junta directiva de seis personas tiene el poder de destituirlo. Algunos directores, entre ellos la experta en políticas de IA Helen Toner y el empresario Tasha McCauley, se convencieron más de su juicio anterior después de leer estos memorandos: lo que Altman asumió fue una responsabilidad con respecto al futuro de la humanidad, pero él mismo no era confiable.

Golpe en la sala de juntas: Sam Altman despedido

En ese momento, Sam Altman se encontraba en Las Vegas viendo una carrera de Fórmula 1 cuando Ilya Sutskever lo Refiere a una videollamada con la junta directiva y leyó un breve comunicado anunciando que en long no era empleado de OpenAI. La junta, bajo asesoramiento legal, emitió un comunicado público, afirmando que Altman fue despedido por "no mantener consistentemente la honestidad en la comunicación".

Esta decisión sorprendió a muchos de los inversores y ejecutivos de OpenAI. Microsoft, que había invertido unos 13.000 millones de dólares en OpenAI, también se enteró de la noticia en el último minuto antes de que se ejecutara la decisión. "Me sorprendió increíblemente en ese momento", recordó más tarde el CEO de Microsoft, Satya Nadella. "No pude obtener más información de nadie". Luego se puso en contacto con Reid Hoffman (cofundador del enlace, inversor en OpenAI y director de Microsoft), quien comenzó a preguntar por todas partes si Altman había asignado alguna mala conducta clara. “Estaba totalmente confundido en ese momento”, nos dijo Hoffman. “Buscamos problemas como malversación o acoso, pero no encontré nada”.

Otros socios comerciales también fueron sorprendidos desprevenidos. Cuando Altman llamó al inversor Ron Conway para informarle de su despido, Conway estaba almorzando con la congresista estadounidense Nancy Pelosi, y este le entregó el teléfono en el spot. —Será mejor que te vayas de aquí rápidamente —le dijo a Conway—.

Mientras tanto, OpenAI estaba cerca de completar una importante ronda de financiación de la firma de capital riesgo Thrive Capital, fundada por Josh Kushner, también hermano de Jared Kushner, a quien Altman conocía desde hacía muchos años. Este acuerdo habría valor OpenAI en $86 mil millones de dólares y permitido que muchos empleados cobraran millones de dólares en beneficios en stock. Kushner acababa de terminar una reunión con el productor musical Rick Rubin cuando vio la llamada perdida de Altman y la devolvió. "Inmediatamente pasamos al modo de batalla", recordó más tarde.

El día de su despido, Altman voló de regreso a su mansión de 27 millones de dólares en San Francisco, con vistas a toda la bahía con una piscina infinita en voladizo, donde estableció un centro de mando temporal que llamó una "especie de gobierno exiliado". Conway, el cofundador de Airbnb Brian Chesky y el famoso y combativo responsable de relaciones públicas Chris Lehane se unieron por video y teléfono, a veces hablando durante horas y horas. Algunos del equipo ejecutivo de Altman incluso acamparon en los pasillos de la casa. Los abogados se apostaron en su oficina junto al dormitorio. Durante los episodios de insomnio, Altman iba y venía en pijama. Al describir esta experiencia posterior al despido en una entrevista reciente, la llamó "un extraño tipo de estado de fuga".

Con la junta guardando silencio, el equipo asesor de Altman comenzó a construir una narrativa para su regreso. Lehane insistió en que el disparo fue en realidad un "golpe" orquestado por "altruistas eficaces", defensores de un sistema de pensamiento que enfatizaba la maximización del bienestar humano general, que veían la inteligencia artificial como una amenaza existencial. (Hoffman también le sugirió a Nadella en ese momento que el disparo podría deberse a "algún tipo de locura altruista efectiva"). Lehane, cuyo lema ampliamente difundido fue prestado por Mike Tyson, "Todos tienen un plan hasta que les den un puñetazo en la cara", sugirió Altman lanzar una audaz ofensiva en las redes sociales. Chesky se mantuvo en contacto con la periodista tecnológica Kara Swisher, haciéndose eco constantemente de las críticas de la junta al mundo exterior.

Cada noche a las seis, Altman salía de su "cuarto de guerra" para servirse un negroni. Recordó haberles dicho a los que le rodeaban: "Tienes que relajarte; lo que se supone que va a pasar va a pasar". Sin embargo, agregó que los registros de llamadas mostraron que estuvo al teléfono durante más de doce horas al día durante ese tiempo.

En un momento dado, reveló una fuente, Altman le dijo a Mira Murati, quien entonces ejercía como CEO interino de OpenAI, que sus aliados estaban "yendo de todo" e intentando "desenterrar tierra" para empañarla a ella y a otros involucrados en presionar por su destitución. (Altman mismo afirma no recordar esta conversación.)

A las pocas horas de su despido, Thrive Capital había pausado su inversión planificada y dejado claro que solo si Sam Altman regresaba se concretaría el acuerdo y los empleados cosecharían sus recompensas en capital. Registros de mensajes de texto en ese momento mostraron que Altman estaba en comunicación muy frecuente con Satya Nadella. (Al elaborar una declaración conjunta, Altman sugirió redactarla como: "Satya y mi máxima prioridad en este momento es salvar OpenAI", mientras que Nadella propuso una frase diferente: "Asegurar que OpenAI continúe prosperando."

Inversión de energía: Altman se restableció rápidamente después de 5 días

En short después, Microsoft anunció que lanzarían un proyecto competitivo para Altman y cualquier empleado de OpenAI que se fuera. Al mismo tiempo, una carta pública solicitando el regreso de Altman comenzó a circular dentro de la Empresa. Algunos que inicialmente dudaron en firmar recibieron llamadas y mensajes de sus colegas. En última instancia, la mayoría de los empleados de OpenAI amenazaron con una renuncia colectiva en apoyo de Altman.

La pizarra estaba acorralada. “Controla a Z, esa es una opción”, dijo Helen Toner, refiriéndose a deshacer la decisión de despido. "La otra opción es el colapso total". Incluso la entonces CEO interina Mira Murati evento firmó la carta pública. Los aliados de Altman comenzaron a tratar de persuadir a Ilya Sutskever de cambio de postura. La esposa de Brockman, Anna, incluso se le acercó en la oficina y le dijo: "Eres una buena persona, puedes hacer esto bien". Sutskever explicó más tarde en un testimonio judicial: "Sentí en ese momento que si íbamos por el camino de que Sam no regresara, OpenAI sería destruido".

Una noche, Altman tomó la pastilla para dormir Ambien y fue despertado por su esposo, el programador australiano Oliver Mulherin, quien le dijo que la posición de Sutskever estaba vacilando y le sugirió a Altman comunicarse con la junta directiva de inmediato. "Me desperté en una especie de neblina inducida por Ambien", recordó Altman, "y estaba totalmente desorientado y pensé: 'No hay manera de que pueda hablar con la junta en este momento'".

En una serie de llamadas cada vez más tensas, Sam Altman exigió la renuncia de los miembros de la junta que habían presionado por su despido. Reflexionando sobre la idea de regresar, recordó su reacción inicial como: "¿Voy a limpiar su desastre en este entorno increíblemente sospechoso?" "Pensé, absolutamente no", dijo. evento, Ilya Sutskever, Helen Toner y Tasha McCauley perdieron sus asientos en la junta, dejando solo a Adam D'Angelo (cofundador de Quora) como miembro original de la junta restante.

Como parte de los plazos de renuncia, estos miembros de la junta solicitaron una investigación sobre los cargos contra Altman, lo que incluía la creación de divisiones entre ejecutivos y el ocultamiento de vínculos financieros. También presionaron para que se estableciera una nueva junta que supervisara de manera independiente la investigación externa. Sin embargo, los dos nuevos directores designados —el expresidente de la Universidad de Harvard Lawrence Summers y el ex CTO de Facebook Bret Taylor— fueron seleccionados después de una estrecha comunicación con Altman. “¿Crees que esto funciona”, le escribió Altman a Satya Nadella, “con Bret, Larry Summers y Adam en la junta, yo como CEO y Bret liderando la investigación?” (McCauuley testificó más tarde que cuando Taylor estaba siendo considerado para la junta, le preocupaba que pudiera ser demasiado deferente a Altman).

Menos de cinco días después de ser despedido, Altman fue restituido. Los empleados de la Empresa más tarde se referirían a este periodo como el "Blip," extrayendo un punto de la trama de una película de Marvel —una breve desaparición seguida de un regreso, pero el mundo había sido fundamentalmente alterado por su ausencia—.

Sin embargo, la controversia en torno a la confiabilidad de Altman se había extendido en long más allá de la sala de juntas de OpenAI. El colega que había diseñado su destitución lo acusó de comportamiento engañoso generalizado, que sería inaceptable para cualquier ejecutivo corporativo, y mucho menos para un líder en posesión de esa tecnología transformadora. “Necesitamos verificaciones del poder que sean proporcionales a ese poder”, nos dijo Mira Murati. “La junta había pedido comentarios, y simplemente compartí honestamente lo que vi, y me mantengo al respecto”. Los partidarios de Altman, por otra parte, habían minimizado en long estas acusaciones. Después del tiroteo, el inversor Ron Conway había enviado mensajes a Brian Chesky y Chris Lehane instando a un contraataque de relaciones públicas: "Esto es sobre la reputación de Sam". También le dijo a The Washington Post que Altman estaba siendo tratado injustamente por "una junta que está fuera de control".

Desde entonces, OpenAI ha ascendido hasta convertirse en una de las empresas más valiosas del mundo, según se informa, preparándose para una salida a bolsa potencialmente billonaria. Mientras tanto, Altman está impulsando una enorme construcción de infraestructura de inteligencia artificial, con algunos esfuerzos que se extienden a regímenes autoritarios en el extranjero. OpenAI también está persiguiendo grandes contratos gubernamentales y estableciendo gradualmente estándares para las aplicaciones de IA en la aplicación de la ley de inmigración, la vigilancia doméstica y las armas autónomas en zonas de conflicto.

Sam Altman ha dirigido el crecimiento de OpenAI pintando continuamente una gran visión del futuro. En una entrada de blog de 2024, escribió: "Las impresionantes victorias —resolver cambio climático, establecer colonias fuera del mundo, descubrir todas las leyes físicas— se volverán en todo evento mundanas". Esta narrativa es la base de una de las startups de combustión más rápida de la historia, que depende en gran medida de fondos de socios con un alto apalancamiento. La economía estadounidense depende cada vez más de un puñado de empresas de IA de alto apalancamiento. Muchos expertos —entre ellos el propio Altman en ocasiones— advierten sobre un riesgo de burbuja en el sector. "Alguien va a perder mucho dinero", dijo a los periodistas el año pasado. Si la burbuja explota, podría activación una catástrofe económica; sin embargo, si sus predicciones más rosadas se hacen realidad, también podría convertirse en uno de los individuo más riqueza y poderosos a nivel mundial.

En una tensa llamada tras el despido de Altman, la junta le exigió que reconociera un patrón de comportamiento engañoso. Según fuentes presentes, dijo reiteradamente: "Esto es ridículo", y afirmó: "No puedo cambio quién soy". Altman más tarde afirmó no recordar esa conversación. "Creo que tal vez lo que intentaba decir era más como: 'Siempre he intentado ser unificador'", nos explicó más tarde, atribuyendo su éxito en liderar una Empresa increíblemente exitosa a este rasgo. Atribuyó estas críticas a una tendencia en sus primeros años de carrera a "evitar demasiado los conflictos". Un miembro de la junta, sin embargo, ofreció una interpretación completamente diferente: "Lo que realmente quería decir era: 'Tengo esta cosa en la que mentiré a la gente, y no me detendré'".

Deriva de la misión: De la seguridad primero a la empresa primero

Y así, surgió una pregunta más fundamental: ¿Esos colegas estaban presionando para que lo derrocaran actuando por exceso de celo y ánimo personal, o su juicio era sólido, y Altman realmente no era de fiar?

Una mañana de invierno de este año, conocimos a Altman en la sede de OpenAI en San Francisco, una de las más de una docena de conversaciones que llevamos a cabo para este artículo. La Empresa se había mudado recientemente a dos torres de vidrio de once pisos, una de las cuales había albergado anteriormente a otro gigante tecnológico, Uber. El cofundador y ex CEO de Uber, Travis Kalanick, había sido visto como un empresario genial imparable hasta que fue expulsado en 2017, también por cuestiones éticas. (Kalanick ahora dirige una startup de robótica; ha dicho que en su tiempo libre, utiliza ChatGPT de OpenAI para “explorar las fronteras de la física cuántica”.)

Un empleado nos dio un recorrido por el espacio de oficinas. En un área llena de mesas en long compartidas y luz natural, había una pintura digital dinámica del informático Alan Turing, cuyos ojos nos seguían mientras nos movíamos. La instalación fue claramente un guiño a la “Turing Test”, el experimento mental de 1950 para determinar si una máquina puede imitar de manera convincente a un ser humano. (En un estudio realizado en 2025, el rendimiento de ChatGPT en esta prueba realmente superó al de los humanos reales.) Normalmente, la pintura era interactiva. Pero nuestro guía explicó que su función de voz había sido deshabilitada porque constantemente estaba “escuchando” conversaciones entre empleados e interviniendo con frecuencia. En otra parte de la oficina, eran visibles letreros que decían “Siente el AGI”, un eslogan acuñado originalmente por Ilya Sutskever para recordar a sus colegas los riesgos de la inteligencia general artificial avanzada (el punto en el que las máquinas alcanzan la capacidad cognitiva a nivel humano). Después de Blip, se había convertido en un eslogan alegre que celebraba un futuro próspero.

En una sala de conferencias no descriptiva en el octavo piso, encontramos a Sam Altman. “Solía escuchar a la gente hablar sobre la fatiga de las decisiones, y nunca lo conseguí”, dijo. “Ahora uso un suéter gris y jeans todos los días, e incluso eligiendo qué suéter gris fuera del armario, me gustaría no tener que tomar esta decisión”.

Altman se veía perpetuamente joven, con un marco delgado, ojos azules muy espaciados, el cabello ligeramente despeinado, pero tenía cuarenta años. Él y Oliver Mulherin tienen un hijo de un año por gestación subrogada. “Creo que ser Presidente de los Estados Unidos es ciertamente más presión, pero de todos los trabajos que creo que podría hacer de manera realista, este es el que podría imaginar que fuera el que más presión me ejerciera”, dijo, mirando a uno de nosotros, luego al otro. “Se lo he descrito a mis amigos de esta manera: “Es el trabajo de mayor interés en el mundo hasta el día WE-Launch ChatGPT”. Antes de eso, estábamos haciendo estos enormes avances científicos, pensé que era uno de los descubrimientos científicos más importantes en décadas”. Miró hacia abajo. “Pero desde que ChatGPT lanzó, todas las decisiones se han vuelto muy difíciles”.

Altman creció en Clayton, Misuri, un suburbio próspero de San Luis, como el mayor de cuatro hijos. Su madre, Connie Gibstine, es dermatóloga, y su padre, Jerry Altman, fue un agente inmobiliario que también trabajó en iniciativas de vivienda. Fue criado en un templo judío reformista, asistió a una escuela preparatoria privada y más tarde lo describió como "un lugar no fácil para salir como gay". Sin embargo, en general, la comunidad de clase media alta en la que se encontraba era relativamente liberal.

Alrededor de la edad de dieciséis o diecisiete años, experimentó una agresión física grave e insultos homófobos mientras estaba fuera por la noche en un barrio gay en San Luis. Altman no informó del incidente y no estuvo dispuesto a proporcionar más detalles, afirmando que una cuenta más completa "me haría parecer que estaba manipulando a la gente o buscando simpatía". Minimizó esta experiencia y la importancia de su orientación sexual para su identidad. Pero también reconoció: "Probablemente hay algo muy profundo aquí psicológicamente, sobre sentir que había salido pero en realidad no lo había hecho, para evitar más conflictos".

Su hermano describió su personalidad infantil como "tengo que ganar, y tengo que controlarlo todo", en una entrevista con The New Yorker en 2016. Altman más tarde asistió a la Universidad de Stanford y participó con frecuencia en juegos de póquer fuera del campus. "Siento que aprendí más sobre la vida y los negocios allí que en la universidad".

Era del combinador Y: Hipérbole y controversia de confianza

Los estudiantes de Stanford son ambiciosos, pero los más orientados a la acción entre ellos a menudo eligen abandonar los estudios. Al final de su segundo año, Altman se dirigió a Massachusetts para unirse al primer grupo de emprendedores en el programa de incubadora de startups Y Combinator. La institución fue cofundada por el reconocido ingeniero de software Paul Graham. Cada participante participó con una idea de startup. (Entre los que estaban en su lote estaban los equipos que más tarde fundaron Reddit y Twitch.) El proyecto de Altman más tarde se llamó Loopt, un producto de las primeras redes sociales que permitía a los amigos ver el paradero de cada uno rastreando la ubicación de sus teléfonos volteados. La Empresa mostró bot sus habilidades de ejecución como su tendencia a labrarse un espacio en áreas grises. En ese momento, las regulaciones federales exigían que los transportistas fueran capaces de localizar la posición de un teléfono en situaciones de emergencia, y Altman llegó a acuerdos con los transportistas para incorporar esta capacidad en su producto.

A la mayoría de los empleados durante la era Loopt les gustaba Sam Altman, pero a algunos les llamó la atención su tendencia a «exagerar» e incluso en algunos asuntos triviales. Algunos recordaron que Altman se jactaba de ser un campeón de ping-pong "como el campeón de ping-pong de la escuela secundaria de Misuri" solo para ser uno de los peores jugadores de la Empresa. (Altman dijo que probablemente era solo una broma.) Un empleado mayor de Loopt, Mark Jacobstein, fue designado por los inversores para servir como «cuidador» de Altman, y más tarde hizo un comentario en la biografía de Keach Hagey, "The Optimist": "Hay un área gris entre 'creo que podría ser capaz de hacer esto' y 'he hecho esto', y en su forma más extrema, esta vaguedad puede conducir a resultados como el de Theranos".

Según Hagey, debido a preocupaciones sobre el estilo de liderazgo de Altman y la falta de transparencia, algunos empleados sénior de Loopt sugirieron dos veces a la junta directiva que lo destituyera de la posición de CEO. Sin embargo, al mismo tiempo, también tenía un fuerte atractivo personal. Un ex empleado recordó que un miembro de la junta respondió directamente: "Esta es la Empresa de Sam, vuelva a hacer su trabajo". (Sin embargo, algunos miembros de la junta también negaron que estos intentos de remoción fueran en serio).

Loopt nunca experimentó mejoras en el crecimiento de los usuarios y en el evento fue adquirido por una Empresa fintech en 2012. Según información privilegiada, esta adquisición fue en gran medida para ayudar a Altman a "salir con gracia". Sin embargo, en 2014, cuando Paul Graham se retiró de Y Combinator, aún eligió a Altman como su sucesor. —Le pregunté en mi propia cocina —dijo Graham al New Yorker—, sonrió como si todo hubiera caído en su lugar. Nunca he visto la sonrisa incontrolable de Sam, como la que muestras cuando tiras una bola de papel lejos en el bote de basura".

La nueva posición convirtió al entonces joven Altman de 28 años en un "kingmaker". Su trabajo consistía en seleccionar a los emprendedores más ambiciosos y prometedores, vincularlos con los mejores programadores e inversores y ayudarles a construir empresas monopólicas líderes en el sector (mientras tanto, Y.C. tomaría entre un 6% y un 7% de capital).

Bajo su liderazgo, Y Combinator se expandió rápidamente, con el número de proyectos incubados creciendo de docenas a cientos. Pero algunos inversores de Silicon Valley comenzaron a creer que sus intereses no estaban completamente alineados. Un inversor nos dijo que Altman "invertiría selectivamente de forma personal en las empresas de mayor calidad para excluir a los inversores externos" (Altman negó esta afirmación). También actuó como cazatalentos de Sequoia Capital, participando en inversiones en proyectos en etapa temprana y recibiendo algunos retornos.

Según las fuentes, cuando Altman invirtió en la Empresa fintech Stripe como inversor ángel, insistió en obtener un mayor porcentaje de acciones, práctica que disgustó internamente a Sequoia. La fuente comentario que esto reflejaba una estrategia de "prioridad Sam". (Altman negó esta afirmación. Invirtió alrededor de $15.000 en Stripe alrededor de 2010, teniendo alrededor del 2% de las acciones, y la Empresa ahora tiene un valor de más de $150.000 millones.) Altman afirmó haber invertido en unas 400 empresas.

Para 2018, varios socios de Y Combinator no estaban satisfechos con el comportamiento de Altman y lo informaron a Graham. Posteriormente, Graham tuvo una conversación sincera con su esposa y cofundadora de Y.C., Jessica Livingston y Altman. Después, Graham comenzó a declarar públicamente que aunque Altman aceptó verbalmente irse, en realidad no renunció en la práctica.

Altman informó a algunos socios que renunciaría como presidente pero que se mantendría como presidente. En mayo de 2019, Y Combinator publicó una publicación en el blog anunciando al nuevo presidente, con una nota que indica: "Sam está en transición a presidente de YC". Unos meses después, esta declaración fue revisada a “Sam Altman ha renunciado a cualquier función operativa en YC”, y luego esta frase fue eliminada por completo. No obstante, a partir de 2021, Altman aún figuraba como el presidente de Y Combinator en EE. Presentaciones de comisiones Securities and exchange. (Altman ha dicho que solo se enteró de esto más tarde.)

Sam Altman siempre ha declarado públicamente a lo largo de los años y en testimonios legales recientes que no fue despedido de Y Combinator y nos dijo que no se resistió a la partida. Paul Graham tuiteó: "No queríamos que se fuera, sino que eligiera entre YC y OpenAI". En un comunicado, Graham también nos dijo: "No tenemos el poder legal para despedir a nadie; todo lo que podemos hacer es aplicar presión moral".

Sin embargo, en privado, la historia fue más explícita: la partida de Altman surgió de la desconfianza de los socios de YC. Esta cuenta del tiempo que Altman pasó en Y Combinator se basa en entrevistas con múltiples fundadores y socios de YC y materiales contemporáneos, todo lo cual sugiere que la separación no fue del todo mutua. Graham incluso les dijo a colegas de YC en una discusión interna que "Sam nos había estado mintiendo todo el tiempo antes de que lo despidieran".

Deriva de la misión de OpenAI: De la seguridad primero a las ganancias primero

En mayo de 2015, Altman email Elon Musk, entonces aproximadamente la persona 100 riqueza a nivel mundial. Al igual que muchos empresarios de Silicon Valley, Musk estaba entonces fuertemente centrado en una serie de lo que consideraba "riesgos existenciales", aunque la mayoría de los demás los veían como posibilidades remotas. “Necesitamos tener mucho cuidado con la inteligencia artificial”, escribió en Twitter, “potencialmente más peligroso que las armas nucleares”.

Altman, que en long había sido un optimista tecnológico, cambió rápidamente su tono sobre la IA a uno más apocalíptico. En comentarios públicos y comunicaciones privadas con Musk y otros, advirtió contra permitir que esta tecnología sea monopolizada por gigantes tecnológicos impulsados por las ganancias. "Me he estado preguntando si hay una manera de detener la carrera armamentista de IA", escribió, "pero si no hay manera, entonces parece que lo mejor sería que lo hiciera la Empresa adecuada". extraer en la analogía nuclear, propuso establecer una "IA. Manhattan Project". Además, describió los principios fundamentales de esta organización: “La seguridad debe ser la máxima prioridad”; “Ciertamente debemos seguir y apoyar todas las regulaciones”.

Posteriormente, Musk y él decidieron el nombre del proyecto: OpenAI.

A diferencia del Proyecto Manhattan, que inicialmente estuvo liderado por el gobierno y culminó con la creación de la bomba atómica, OpenAI recibiría fondos privados en sus primeras etapas. Altman previó que una vez que surgiera una forma de "superinteligencia" que superara a la inteligencia artificial general (AGI), generaría suficiente valor económico para "capturar el futuro cono de luz del universo". Sin embargo, también enfatizó repetidamente sus riesgos existenciales potenciales: en algún momento, el impacto de la tecnología en la seguridad nacional podría ser tan significativo que podría obligar al gobierno de Estados Unidos a hacerse cargo de OpenAI, incluso nacionalizarla y reubicar sus instalaciones en una base segura en el desierto. A finales de 2015, Musk estaba convencido. “Deberíamos anunciar una asignación de fondos de 1.000 millones de dólares”, escribió, “y la respaldaré si otros no lo hacen”.

Sam Altman inicialmente colocó OpenAI bajo el brazo sin fines de lucro de Y Combinator y lo enmarcó como un proyecto filantrópico interno. Asignó stock de YC a los miembros que se unían a OpenAI y transferencia fondo de donación a través de cuenta de YC. En un momento dado, este laboratorio incluso se basó en el apoyo de un fondo YC en el que Altman tenía stakes personales. (Altman más tarde se refirió a este equity stake como "insignificante" y afirmó que el stock YC asignado a los empleados provenía de sus holdings personales).

La analogía con el "Proyecto Manhattan" también se manifestó en la carrera de talentos. Similar a la investigación sobre la fisión nuclear, el aprendizaje automático era entonces un campo científico a pequeña escala con un impacto potencial que marcaba una época, dirigido por un pequeño grupo de individuos claramente talentosos. Elon Musk, Altman y Greg Brockman, que se unieron desde Stripe, todos creían que los informáticos verdaderamente innovadores eran pocos y estaban lejos. Google, por otra parte, tenía una gran ventaja en plazo de fondos y tiempo. "Estamos muy atrasados en mano de obra y recursos, la brecha es surrealista", escribió Musk más tarde en un email. Pero también creía que "si podemos seguir atrayendo al mejor talento y asegurar la dirección correcta, OpenAI seguirá prevaleciendo".

Uno de los objetivos de reclutamiento más importantes fue Ilya Sutskever, un investigador introvertido e intenso considerado a menudo como uno de los científicos de IA más talentosos de su tiempo. Nacido en la Unión Soviética en 1986, Sutskever tenía una línea de cabello retraída, ojos profundos y el hábito de hacer una pausa y mirar contemplativamente antes de hablar. Otra figura clave fue Dario Amodei, un investigador de alta energía con experiencia en biofísica que a menudo pasaba nerviosamente la mano por su cabello negro en momentos de tensión y respondía con ensayos de varios párrafos incluso a email de una sola frase. Bot estaban en posiciones bien pagadas en otras empresas en ese momento, pero Altman invirtió un esfuerzo significativo en incorporarlos. Más tarde bromeó: "Prácticamente estaba 'acechando' a Ilya".

Si bien Musk puede tener el mayor reconocimiento de nombres, Altman es el operador más sencillo. Tomó la iniciativa de enviar un email a Amodei y organizó una reunión individual en un restaurante indio. (Altman: "¡Mi Uber tuvo un accidente! Podría llegar 10 minutos tarde." Amodei: "Oh no, espero que estés bien"). Al igual que muchos investigadores de IA, Amodei cree que esta tecnología solo debe desarrollarse una vez que se haya demostrado que está "alineada" con valores humanos, lo que significa que no se desvía catastróficamente de la intención humana, como acabar con la humanidad en nombre de la "limpieza del medio ambiente". Altman se hizo eco reiteradamente de esta preocupación por la seguridad en su conversación, infundiendo confianza.

Amodei, que más tarde se unió a la Empresa, pasó años documentando las acciones de Altman y Brockman, compilándolas en un documento titulado "Mi experiencia en OpenAI" (subtítulo: "Confidencial: No distribuir"). Más de doscientas páginas de archivos relacionados con Amodei, incluidas estas notas, email internos y memorandos, circularon dentro de los círculos de Silicon Valley, pero nunca se habían divulgado públicamente. En estos registros, Amodei escribió que el objetivo de Altman era crear "un laboratorio de IA centrado en la seguridad ('quizás no al principio, sino poco después')".

En diciembre 2015, pocas horas antes del anuncio oficial de OpenAI, Altman email Musk mencionando un rumor: Google "iba a presentar una gran oferta inversa a todos en OpenAI mañana, tratando de matar a la organización de inmediato". Musk preguntó: "¿Ha dado Ilia una respuesta definitiva?" Altman respondió diciendo que Sutskever estaba decidido. De hecho, Google le había ofrecido a Sutskever un salario anual de 6 millones de dólares, que OpenAI no podía igualar. Sin embargo, Altman se mantuvo confiado, afirmando: "Lástima que no estén del lado de 'hacer lo correcto'".

Elon Musk una vez proporcionó espacio de oficina para OpenAI en una antigua fábrica de maletas en el distrito Mission de San Francisco. Como nos dijo Ilya Sutskever, el grito de guerra principal para los empleados en ese momento fue: "Todos ustedes van a salvar el mundo". Si todo iba bien, los fundadores de OpenAI creían que la inteligencia artificial marcaría el comienzo de una utopía "post-escasez": automatizar el trabajo arduo, curar el cáncer, otorgar a los humanos más ocio y abundancia. Pero si la tecnología se volvía pícara o caía en las manos equivocadas, la destrucción podría ser total, como ser utilizada para desarrollar nuevas armas biológicas o enjambres avanzados de drones; los modelos podrían superar la supervisión humana, autorreplicarse en servidores clandestinos más allá del cierre; en casos extremos, incluso podrían tomar el control del grid, el stock o el arsenal nuclear.

Si bien no todos están de acuerdo con estas evaluaciones, Sam Altman ha expresado reiteradamente su creencia en este riesgo. En una publicación de blog de 2015, escribió que la inteligencia de máquina de nivel sobrehumano "no necesita ser malvada para destruir a la humanidad, podría ser simplemente indiferente, ya que avanza hacia el logro de otros objetivos... acabar casualmente con nosotros". El cofundador de OpenAI se comprometió a no priorizar la velocidad sobre la seguridad, y el gráfico de la Empresa incluye un asignado legal para "beneficiar a toda la humanidad". También desconfían de que si la IA se convierte en la tecnología más poderosa de la historia, cualquier controlador ganaría un poder sin precedentes, un escenario al que se refieren como “dictadura AGI”.

Después de la partida de Musk, investigadores como Dario Amodei comenzaron a expresar su descontento con el estilo de gestión de Greg Brockman, y algunos lo encontraron autoritario, mientras que Sutskever fue descrito como "de principios pero carente de capacidad organizativa". Durante su transición a CEO, Altman parecía asignar diferentes compromisos a diversas facciones dentro de la Empresa. Aseguró a algunos investigadores que debilitaría la autoridad de Brockman, pero al mismo tiempo, llegó a un "acuerdo de apretón de manos" con Brockman y Sutskever: ejercería como CEO, pero dimitiría si bot lo solicitaban. (Altman disputa este reclamo, afirmando que fue Refiere a ser CEO. Los tres reconocen la existencia del acuerdo, con Brockman diciendo que fue informal: “Él dijo unilateralmente que si los dos preguntábamos, renunciaría. En realidad nos opusimos a esta idea, pero él dijo que era importante para él y se hizo por altruismo.") Más tarde, la junta se enteró de que el CEO en realidad había establecido una "junta sombra" para sí mismo, lo que resultó sorprendente.

Los registros internos muestran que el equipo fundador tenía dudas sobre la estructura sin fines de lucro ya en 2017. Ese mismo año, después de que Musk intentara una absorción, Brockman escribió en una entrada de su diario: "No puedo decir que realmente nos apegamos a ser una organización sin fines de lucro... Si nos convertimos en un Cuerpo B en tres meses, las declaraciones anteriores eran mentiras". Amodei también documentó en las primeras notas que le había preguntado a Brockman sobre sus principales prioridades, a lo que respondió "dinero y poder". (Brockman niega esta afirmación). Su diario también revela una mentalidad contradictoria: por un lado, declara "si los demás no son ricos, tampoco me importa serlo" y, por otro, se pregunta "¿qué es lo que realmente quiero?" y una respuesta es "alcanzar financieramente los 1.000 millones de dólares".

En 2017, Sutskever leyó un artículo de investigación de investigadores de Google en la oficina que proponía una "nueva arquitectura de red simple: el Transformer". Saltó de su silla, corrió hacia el pasillo y gritó: "Detén todo lo que estás haciendo, esta es la respuesta". Para él, esta arquitectura permitiría a OpenAI entrenar modelos más complejos. Este avance condujo a los primeros modelos generativos de transformadores preentrenados y sirvió como base para ChatGPT más tarde.

Altman había asignado previamente a los primeros empleados que OpenAI siempre permanecería pura en su naturaleza sin fines de lucro, lo que llevó a muchos programadores a aceptar importantes recortes salariales para unirse a la Empresa. OpenAI también recibió alrededor de 30 millones de dólares en donaciones, incluso de la organización Open Philanthropy, un centro de fondos clave en el movimiento de altruismo eficaz, que ha apoyado en long proyectos como la distribución de mosquiteros a zonas empobrecidas.

Las operaciones diarias eran supervisadas principalmente por Brockman y Sutskever, mientras que Musk y Altman seguían ocupados con sus respectivas otras empresas, visitando típicamente la Empresa una vez a la semana. En septiembre 2017, Musk estaba impaciente. A medida que surgían debates (según contexto) sobre la posible transición de OpenAI a una Empresa con fines de lucro, solicitó el control mayoritario.

Las respuestas de Altman variaron en diferentes ocasiones, pero una cosa en la que insistió constantemente fue que si la Empresa se reestructuraba bajo un CEO, esa posición debía ser mantenida por él. Sutskever estaba notablemente inquieto por esto. En su nombre y el de Brockman, envió un largo email a Musk y Altman titulado "Pensamientos honestos", declarando: "El objetivo de OpenAI es hacer el futuro mejor y evitar la dictadura AGI". dirección a Musk, escribió: "Por lo tanto, establecer una estructura que pueda convertirte en un dictador es una mala idea". También expresó preocupaciones similares a Altman, afirmando: "No entendemos por qué el título de CEO es tan crucial para ti. Tus razones siguen cambiando, lo que nos hace difícil ver la verdadera motivación".

“Caballeros, ya terminé”, respondió Musk, “o hacen otra cosa por su cuenta o siguen manteniendo el estado de organización sin fines de lucro de OpenAI; de lo contrario, solo les estoy fondos gratis para dirigir una Empresa emergente”. Cinco meses más tarde, se fue con visible insatisfacción. (En 2023, fundó el competidor con fines de lucro xAI. Al año siguiente, demandó a Altman y OpenAI por fraude y violación de la confianza caritativa, alegando que fue "cuidadosamente manipulado" y que Altman participó en una "estafa en long" utilizando sus preocupaciones sobre el riesgo de la IA para asegurar fondos. La demanda está en curso, y OpenAI refuta enérgicamente las afirmaciones.)

A medida que las capacidades tecnológicas avanzaban, nos enteramos de que alrededor de una docena de ingenieros clave de OpenAI habían celebrado una serie de reuniones secretas, discutiendo en privado si se podía confiar en el equipo fundador, incluidos Sam Altman y Greg Brockman. Durante una de estas reuniones, un empleado recordó un bosquejo satírico del dúo cómico británico Mitchell y Webb: un soldado nazi del frente oriental de repente tiene una epifanía, preguntando: "¿Somos los malos?"

En 2018, Dario Amodei había comenzado a cuestionar públicamente los motivos de los fundadores. Más tarde escribió en una nota: "Todo parece un esquema de financiación interminable. Siento que lo que OpenAI realmente necesita es una definición clara: qué quiere hacer, qué no quiere hacer y cómo su existencia hará que el mundo sea mejor". A pesar de que la Empresa ya tenía una declaración de su misión —"garantizar que la inteligencia general artificial beneficie a toda la humanidad"—, Amodei consideró que esta declaración no estaba clara para el equipo ejecutivo.

A principios de 2018, comenzó a redactar el gráfico de la Empresa y, después de semanas de discusión con Altman y Brockman, impulsó la inclusión de una de las cláusulas más radicales: si un "proyecto alineado con el valor y consciente de la seguridad" estuviera más cerca de alcanzar el AGI que OpenAI, la Empresa "cesaría la competitividad y en su lugar asistiría a ese proyecto". Esto se conocía como la cláusula de "fusión y asistencia": por ejemplo, si Google lograra primero un AGI seguro, OpenAI se disolvería teóricamente y transferencia recursos a Google. Desde una perspectiva comercial tradicional, este asignado era casi impensable, pero OpenAI nunca tuvo la intención de convertirse en una Empresa tradicional.

Esta premisa se enfrentó a una verificación de realidad en la primavera de 2019. En ese momento, OpenAI estaba en conversaciones con Microsoft para una inversión potencial de hasta 1.000 millones de dólares. Aunque Amodei (que entonces lideraba el equipo de seguridad) había estado involucrado en presentarle el proyecto a Bill Gates, aún había ansiedad dentro del equipo de que Microsoft pudiera introducir plazos que diluyeran los asignados éticos de OpenAI. Amodei presentó una lista priorizada de requisitos de seguridad a Altman, con la cláusula de "fusión y asistencia" en la parte superior.

Altman aceptó en ese momento. Sin embargo, cuando el acuerdo estaba a punto de completarse en junio, Amodei descubrió una nueva cláusula en el acuerdo que le otorga a Microsoft el poder de vetar la fusión de OpenAI. "Este monto (según contexto) supuso un incumplimiento del 80% del gráfico", recordó más tarde. Se enfrentó a Altman sobre esto, con Altman inicialmente negando la existencia de tal cláusula. Amodei leyó textualmente el contrato en el spot, teniendo que hacer en el evento que otro colega confirmara directamente con Altman. (Altman declaró que no recuerda este incidente.)

Éxodo de seguridad y nacimiento de Antrópico

Las notas de Amodei también documentaron una serie de conflictos tensos cada vez más intensos. En una reunión varios meses después, Altman lo convocó a él y a su hermana Daniela, quien también trabajaba en seguridad y política en la Empresa, alegando que había recibido información confiable de un "alto ejecutivo" de que ambos estaban planeando un "golpe de Estado". En las notas se afirmaba que Daniela se sintió «emocionalmente abrumada» en el spot y se llamó al ejecutivo, quien luego negó haber dicho tal cosa. Fuentes familiarizadas con el asunto recordaron que Altman negó más tarde haber hecho esta acusación: "Nunca dije eso." Daniela respondió: «Acabas de hacerlo.» (Altman declaró que su recuerdo era ligeramente diferente, alegando que solo acusó a Amodei de estar involucrado en «comportamiento político.») En 2020, Amodei, Daniela y varios colegas dejaron la Empresa para fundar Anthropic, que desde entonces se ha convertido en uno de los principales competidores de OpenAI.

Mientras tanto, Altman siguió enfatizando el asignado de OpenAI a la seguridad, especialmente en presencia de posibles reclutas. A finales de 2022, cuatro informáticos publicaron un artículo en el que proponían el riesgo de una "alineación engañosa": los modelos altamente avanzados podrían funcionar bien durante las pruebas, pero perseguir sus propios objetivos después de la implementación real. (Este escenario aparentemente de ciencia ficción ya ocurrió en determinadas condiciones experimentales.) Varias semanas después de que se publicara el artículo, uno de los autores —estudiante de doctorado de la Universidad de California en Berkeley— recibió un email de Altman. Altman expresó creciente preocupación por la amenaza de la "IA no alineada" y contempló invertir mil millones de dólares en dirección a este tema, como establecer un premio global de investigación. A pesar de que este estudiante había escuchado rumores de que "Sam era un poco hábil", el asignar evento lo convenció de pausar sus estudios y unirse a OpenAI.

Sin embargo, por múltiples reuniones en la primavera de 2023, la actitud de Altman parecía cambiar. En long no mencionó la creación de una adjudicación sino que se volcó en establecer un "equipo de superalineación" interno dentro de la Empresa. Un anuncio oficial afirmó que el equipo recibiría "el 20% del cómputo asegurado de la Empresa", un recurso valorado en potencialmente más de 1.000 millones de dólares. El anuncio también enfatizó que si el problema de alineación no se podía resolver, el AGI podría llevar a que "la humanidad fuera desempoderada o incluso extinta". Jan Leike, quien estuvo a cargo del equipo, declaró más tarde: "Efectivamente fue una estrategia de retención muy efectiva".

Sin embargo, la promesa del "cómputo del 20%" no se cumplió. Cuatro individuos involucrados con el equipo o que lo seguían de cerca afirmaron que los recursos reales asignados solo daban cuenta del 1% al 2% del cálculo total de la Empresa. Además, un investigador señaló que "la mayoría de los llamados cálculos de superalineación en realidad se ejecutan en el clúster más antiguo y de peor rendimiento". En general, los miembros del equipo consideraron que se daba prioridad a los equipos más avanzados para los proyectos generadores de ingresos. (OpenAI negó esto.) Leike le había planteado este problema a la entonces directora de tecnología Mira Murati, pero la respuesta fue que no había necesidad de seguir adelante: este asignado fue "poco realista" desde el principio.

Alrededor de este tiempo, un ex empleado nos dijo que Ilya Sutskever "comenzó a enfatizar fuertemente la seguridad". En los primeros días de OpenAI, aunque pensaba que el riesgo catastrófico era una preocupación razonable, aún estaba algo distante; sin embargo, a medida que gradualmente llegó a creer que AGI se acercaba, esta preocupación se intensificó rápidamente. Según el recuerdo del empleado, durante una reunión de todas las manos, "Ilya se puso de pie y dijo que llegaría un punto en los próximos años en el que casi todos en la Empresa tendríamos que cambiar a hacer seguridad, o de lo contrario ya estamos". Sin embargo, al año siguiente, este "equipo de superalineación" fue disuelto antes de completar su misión.

En este punto, las comunicaciones internas indican que los ejecutivos y los miembros de la junta están comenzando a creer que la ocultación y el comportamiento engañoso de Sam Altman pueden tener un impacto material en la seguridad de los productos de OpenAI. Durante una reunión en diciembre 2022, Altman aseguró a la junta que las múltiples características del próximo GPT-4 habían sido aprobadas por el asignado de seguridad. Helen Toner, miembro de la junta directiva y experta en políticas de IA, solicitó ver los documentos pertinentes, pero descubrió que las dos características más controvertidas (una que permite a los usuarios "afinar" el modelo y otra que permite su implementación como asistente personal) en realidad no habían sido aprobadas. Después de la reunión, otra miembro de la junta, la empresaria Tasha McCauley, fue apartada por una empleada que le preguntó si sabía sobre "el incidente de cumplimiento en India": Altman nunca había mencionado en múltiples actualizaciones del tablero que Microsoft había lanzado una versión temprana de ChatGPT en la India sin completar las revisiones de seguridad necesarias. "Esto fue casi en su totalidad rozado debajo de la alfombra", dijo entonces el investigador de OpenAI Jacob Hilton.

Si bien estos problemas no provocaron directamente un incidente de seguridad, el investigador Carroll Wainwright consideró que reflejaban un "deslizamiento continuo hacia una tendencia que prioriza el producto y es ligera en cuanto a la seguridad". Tras la liberación del GPT-4, Jan Leike, quien estaba a cargo del trabajo de seguridad, escribió a la junta: "OpenAI se desvía de su misión. Priorizamos el producto y los ingresos primero, luego la capacidad, la investigación y la escalabilidad, con la alineación y la seguridad en tercer lugar". También señaló que "empresas como Google están aprendiendo lecciones, acelerando la implementación mientras descuidan las preocupaciones de seguridad".

En un email a los miembros de la junta, McCauley escribió: "Creo que efectivamente estamos en una etapa en la que es necesaria una mayor supervisión". Sin embargo, cuando la junta intentó dirección esta cuestión, estaba claramente en desventaja. "Para decirlo sin rodeos, es un grupo de personas que carecen de experiencia en el mundo real", dijo la exmiembro de la junta directiva Sue Yoon. En 2023, la Empresa se preparaba para lanzar GPT-4 Turbo. Según la descripción de Sutskever en un memorando, Altman le había dicho a Mira Murati que el modelo no requería aprobación de seguridad y atribuyó esta decisión al abogado general de la Empresa, Jason Kwon. Pero cuando Murati le preguntó a Kwon sobre Slack, él respondió: "Um... No estoy muy seguro de por qué Sam pensaría eso". (OpenAI declaró que este incidente "no fue significativo").

En short después, la junta decidió destituir a Altman; posteriormente, el mundo presenció cómo rápidamente revirtió esa decisión. El gráfico de OpenAI todavía está disponible en el sitio web oficial, pero aquellos familiarizados con los documentos de gobierno de la Empresa dicen que su contenido se ha diluido hasta casi perder sentido. En junio del año pasado, Altman escribió en una entrada de blog personal sobre superinteligencia: "Hemos cruzado el horizonte del evento; el despegue ha comenzado".

Según el gráfico original, esto debía ser un punto de inflexión para que la Empresa cesara la competencia y la transición a la colaboración. Sin embargo, en el artículo titulado “La singularidad gentil”, adoptó un tono completamente nuevo, reemplazando el “pavor existencial” por “imaginación optimista”: “Todos tendremos cosas mejores, y crearemos cosas cada vez mejores para los demás”. Reconoció que los problemas de alineación seguían sin resolverse pero los redefinió como una "molestia", similar a ser adicto a un algoritmo de recomendación de Instagram.

Altman suele ser referido con asombro o escepticismo como "el narrador más poderoso de su generación". Una vez se pensó que Steve Jobs que admiraba poseía un “campo de distorsión de la realidad”, moldeando el mundo a su visión con absoluta confianza. Pero incluso Jobs nunca se lo dijo a los usuarios: si no compraban su producto, la humanidad podría perecer. En 2008, con solo 23 años, Altman fue descrito por su mentor Paul Graham de la siguiente manera: "Déjalo en una isla caníbal, regresa en 5 años y será rey." Esta evaluación no se basó en sus logros en ese momento, sino en su fuerza de voluntad casi irrestricta.

Sin embargo, para algunos de aquellos que han trabajado más de cerca con él, este rasgo tiene otro lado. A medida que Sutskever se preocupaba cada vez más por la seguridad de la inteligencia artificial, compiló una serie de memorandos sobre Altman y Greg Brockman, un conjunto de documentos tan significativos en Silicon Valley que incluso se los conoce como los “Memos de Ilya”.

Mientras tanto, Dario Amodei siguió documentándose. Estos materiales no proporcionaron la llamada "evidencia de armas humeantes" sino que representaron una serie de patrones de comportamiento aparentemente dispersos pero en acumulación: como ofrecer la misma posición a diferentes personas, dar cuentas contradictorias de información pública y ser ambiguos sobre los procesos de seguridad. La conclusión de Sutskever fue que este comportamiento "no construye un entorno propicio para un AGI seguro"; Amodei fue más directo, escribiendo: "El problema con OpenAI es el propio Sam".

Entrevistamos a más de un centenar de personas familiarizadas con el enfoque de Altman: empleados y directores actuales y anteriores de OpenAI, sus colegas y competidores, amigos y enemigos; en Silicon Valley, muchos suelen usar sombreros múltiples. Algunos defendieron su perspicacia comercial, creyendo que Sutskever y Amodei eran competidores fallidos; otros lo veían como un científico ingenuo y distraído, o incluso como un extremista atrapado en el "juicio final". Yoon creía que Altman no era un "villano maquiavélico" sino una persona convencida por su propia narrativa, "está tan inmerso en su autocreencia que toma decisiones que son incomprensibles en el mundo real —pero para empezar no en tiempo real en el mundo real".

Sin embargo, el juicio de la mayoría de los entrevistados es similar al de Sutskever y Amodei: Altman tiene una voluntad de poder extrema, destacándose incluso entre los titanes industriales que tienen sus nombres grabados en cohetes. "No está vinculado por la 'realidad'", dijo un miembro de la junta, "posee dos rasgos que rara vez aparecen juntos: uno es un fuerte deseo de gustar, de complacer a la otra parte en cada interacción; el otro es casi antisocial, sin preocupación por las consecuencias de engañar a los demás".

Más de un entrevistado utilizó espontáneamente el plazo “personalidad antisocial”. Altman, un compañero del primer lote de Y Combinator, fue colega del programador Aaron Swartz, quien más tarde asignó suicidio en 2013. Antes de su muerte, Swartz expresó su preocupación a un amigo acerca de Altman: "Debes entender, Sam nunca es de fiar. Es una personalidad antisocial; es capaz de cualquier cosa". Varios ejecutivos de Microsoft también declararon que a pesar del apoyo de Satya Nadella a Altman desde hace en long tiempo, la relación entre ambos se está volviendo tensa. "Desorientará, distorsionará, renegociará o incluso anulará los acuerdos", dijo un ejecutivo. A principios de este año, OpenAI reafirmó a Microsoft como el proveedor exclusivo de servicios en la nube para su "modelo apátrida", pero el mismo día, anunció una asociación de 500.000 millones de dólares con Amazon, convirtiendo a esta última en la revendedora exclusiva de su plataforma de IA empresarial. Si bien este arreglo no violaba el contrato, Microsoft creía que había un conflicto potencial. (OpenAI declaró que no incumpliría el contrato.) El ejecutivo incluso comentario: "Creo que hay una posibilidad significativa de que en el futuro sea visto como alguien similar a Bernie Madoff o Sam Bankman-Fried".

Altman no es un genio técnico: a ojos de muchos colegas, sus habilidades profesionales en programación o aprendizaje automático son limitadas, e incluso puede confundir conceptos básicos. Construyó OpenAI en gran medida integrando fondos y recursos técnicos de otras personas. Esto no es raro: este es el papel de un empresario. Lo que es más notable es su capacidad para persuadir a ingenieros, inversores y al público con opiniones encontradas, convenciéndolos de que sus prioridades también son las de ellos. Cuando estas personas tratan de detenerlo, a menudo es capaz de desactivar la situación con la retórica adecuada, al menos temporalmente; y para cuando la otra parte se da cuenta del problema, generalmente ya ha logrado su objetivo. “Diseñará algunas estructuras para restringir su futuro yo sobre el papel”, dijo Wainwright, “pero cuando el futuro realmente llegue y necesite ser restringido, desmantelará estas estructuras una por una”.

"Su persuasión es increíblemente fuerte, como un truco mental Jedi", dijo un ejecutivo de tecnología que trabajó con él, "es un nivel completamente diferente". En la investigación de alineación de la IA, hay un concepto clásico: la voluntad de la humanidad versus una IA poderosa, con esta última prevaleciendo casi inevitablemente, como un gran maestro de ajedrez contra un niño. Y en opinión de ese ejecutivo, presenciar a Altman navegar a través de las diversas fiestas durante el evento "Blip" fue como ver "un AGI liberándose de su jaula".

En los días posteriores a su despido, Sam Altman había estado tratando de impedir que se llevara a cabo cualquier investigación sobre las acusaciones en su contra. Había expresado a dos personas que le preocupaba que incluso la existencia de una investigación lo hiciera parecer culpable. (Altman niega haber hecho esta declaración.) Sin embargo, después de que los miembros de la junta directiva que renunciaron insistieran en que "debe llevarse a cabo una investigación independiente" como condición para su salida, Altman evento acordó una "revisión" de los "eventos recientes". Según fuentes familiarizadas con las negociaciones, los dos nuevos miembros de la junta insistieron en liderar ellos mismos esta revisión.

Lawrence Summers, aprovechando sus conexiones en la política y en Wall Street, pareció darle algo de credibilidad a esta revisión. (En noviembre pasado, Summers renunció a la junta después de que se divulgara públicamente que había buscado asesoramiento de Jeffrey Epstein por email mientras perseguía a un joven protegido.) OpenAI finalmente contrató al destacado bufete de abogados WilmerHale para que se encargara de esta revisión. La firma ha liderado previamente investigaciones internas sobre Enron y WorldCom.

Seis individuos cercanos al proceso de investigación indicaron que el examen parecía estar diseñado para limitar la transparencia. Algunos dijeron que inicialmente los investigadores no se comunicaron con algunos individuos clave de la Empresa. Un empleado llegó a comunicarse con Summers y Bret Taylor para expresar sus inquietudes. "Solo tenían interés en ese breve periodo en el que ocurrió el drama de la junta directiva, no en los problemas de integridad en longevidad de Sam", recordó sentir el empleado durante su entrevista con los investigadores. Algunos también dudaron en compartir sus preocupaciones sobre Altman debido a la percepción de falta de protección en el anonimato. “Todos los signos indican que están buscando una conclusión predeterminada, exonerarlo”, dijo el empleado. (Sin embargo, algunos abogados involucrados en el proceso defendieron la revisión, calificándola de "independiente, exhaustiva, exhaustiva y guiada por los hechos". Taylor también afirmó que la revisión fue «exhaustiva e independiente».

La función de una investigación corporativa interna suele servir para legitimar una decisión. En las empresas privadas, los resultados de las investigaciones a veces ni siquiera dan lugar a un informe escrito, lo que sirve como una forma de mitigar la responsabilidad legal. Sin embargo, en los casos de controversia pública, suele esperarse un mayor grado de transparencia. En 2017, antes de la salida de Travis Kalanick de Uber, la junta había contratado a una firma externa y publicado un resumen de 13 páginas de la investigación al público. Teniendo en cuenta el estado de organización sin fines de lucro 501(c)(3) de OpenAI y el carácter sumamente público de esta terminación, muchos ejecutivos de la Empresa habían anticipado inicialmente un informe de investigación detallado. Sin embargo, para marzo 2024, OpenAI solo anunció la «liquidación» de Altman sin publicar ningún informe formal, reconociendo un «quebrantamiento de confianza» en unas 800 palabras en su sitio web.

Incluso los ex colegas están sintiendo las réplicas. Mira Murati dejó OpenAI en 2024 para comenzar su propia startup de IA. Posteriormente, el aliado cercano de Altman, Josh Kushner, la llamó. Comenzó elogiando su liderazgo, pero luego hizo una amenaza velada, expresando su "preocupación" por su "reputación" y mencionando que algunos ex colegas ahora la ven como una "enemiga" (Kushner, a través de un portavoz, dijo que este recuento "no proporcionó el contexto completo"; Altman, por otra parte, afirmó desconocer el llamado).

Al principio de su mandato como consejero delegado, Altman anunció que OpenAI crearía una Empresa "con límites máximos" en manos de la entidad sin ánimo de lucro. Esta estructura de Empresa casi retorcida aparentemente fue ideada por Altman. Durante la transición, un director llamado Holden Karnofsky expresó su oposición, creyendo que este arreglo infravaloraba gravemente el valor de la organización sin fines de lucro. “No puedo, en buena conciencia, seguir adelante con esto”, dijo Karnofsky. Según los registros de la época, emitió un voto disidente. Sin embargo, después de que el abogado de la junta sugirió que su oposición “puede servir como señal de advertencia para una investigación adicional sobre la legalidad de la nueva estructura”, su voto finalmente se registró como una abstención y aparentemente sin su consentimiento, lo que potencialmente incluso constituye una falsificación de registros comerciales. (OpenAI nos dijo que varios empleados recuerdan que Karnofsky se abstuvo y proporcionó actas de la reunión como evidencia.)

En octubre del año pasado, OpenAI sufrió una "reestructuración de capital", convirtiéndose en una entidad con fines de lucro. La Empresa declaró públicamente que su organización sin fines de lucro afiliada —ahora llamada OpenAI Foundation— se convertiría en una de las instituciones con mayor riqueza de la historia. Sin embargo, la fundación ahora solo tiene el 26% de las acciones de la Empresa, y todos sus directores, excepto uno, también forman parte del consejo con fines de lucro.

Durante una audiencia en el Congreso, se le preguntó a Altman si había "ganado mucho dinero". Él respondió: "No tengo ninguna propiedad en OpenAI... Lo hago porque me encanta". Dado su stake indirecto a través de fondos relacionados con Y Combinator, esta respuesta fue bastante cautelosa. Técnicamente, es cierto. Pero varios individuos, entre ellos Altman, nos han indicado que esta situación probablemente cambie pronto. "Los inversores dirán: 'Necesito saber que cuando las cosas se ponen difíciles, aún vas a hacer esto'", dijo Altman, aunque agregó que actualmente no hay "debates (según contexto) activos" al respecto. Según un testimonio legal, el stake de Greg Brockman tiene un valor de alrededor de 20.000 millones de dólares, y la parte de Altman debería ser teóricamente mayor. Sin embargo, Altman nos dijo que la riqueza no es su principal motivador. Un ex empleado lo recordó diciendo: "No me importa el dinero. Me importa más el poder".

En 2023, Altman y Oliver Mulherin celebraron una pequeña boda en su residencia de Hawái. (Los dos se habían conocido nueve años antes en la casa de Peter Thiel, junto al jacuzzi nocturno.) Habían recibido a muchos huéspedes en esa propiedad, y las escenas descritas por los referidos que entrevistamos no superaban el alcance común del estilo de vida súper rico: cena preparada por un chef privado, paseos en barco al atardecer. Hubo una fiesta de Año Nuevo con el tema del reality show Survivor; las fotos mostraron a un grupo de hombres sonrientes y sin camisa, incluido el presentador del programa, Jeff Probst. Altman también había organizado pequeñas reuniones en sus otras propiedades, con al menos un evento que involucró a animados strip poker. (Una foto filtrada no incluía a Altman, por lo que se desconoce quién ganó en última instancia, pero al menos tres hombres parecían haber perdido claramente.) Muchos de los ex huéspedes entrevistados solo mencionaron una cosa: de hecho, era un anfitrión generoso.

Los involucrados en la investigación dijeron que nunca se emitió ningún informe porque nunca hubo un informe formal por escrito. Las supuestas conclusiones de la investigación solo se informaron oralmente a Summers y Taylor. "La revisión no concluyó que 'Sam sea tan honesto como George Washington talando el cerezo'", dijo una fuente cercana a la investigación. Pero en general, parecía que la investigación no se centraba verdaderamente en el 'problema de integridad' detrás del despido de Altman, con una parte significativa del esfuerzo que se dedicó en su lugar a determinar si había delitos penales claros; bajo ese estándar, la investigación concluyó finalmente que podía continuar como CEO. En short después, Altman recuperó el asiento en la junta que había perdido al ser despedido. Los informantes revelaron que parte de la razón para no conmemorar los hallazgos de la investigación por escrito también se debió al asesoramiento de Summers y el respectivo abogado privado de Taylor. (Summers se negó a hacer comentarios públicos sobre este asunto; Taylor afirmó que, dado que hubo una exposición oral, "no hubo necesidad de un informe formal por escrito").

Muchos empleados actuales y anteriores de OpenAI nos dijeron que estaban sorprendidos por la falta de divulgación pública. Altman declaró que creía que todos los miembros de la junta que se unieron después de su reincorporación habían sido informados oralmente sobre estos asuntos. “Esta es una mentira franca”, dijo una persona familiarizada con la situación. Algunos directores también nos dijeron que las preguntas en curso sobre la integridad de estos “hallazgos de investigación” incluso podrían requerir una “reversión de la investigación” en el futuro.

Sin registros escritos, estas acusaciones son más fáciles de minimizar. Mientras tanto, el continuo ascenso de Altman en el estado de Silicon Valley debilitó aún más el escrutinio externo de estos problemas. Varios inversores destacados que habían trabajado con él nos hablaron de un hábito ampliamente conocido que tenía Altman: si un inversor apostaba por un competidor de OpenAI, más tarde podría "listarle negra". "Si invierten en un proyecto que a Sam no le gusta, no esperes ser parte de ninguna otra oportunidad más adelante", dijo uno de ellos. Otra fuente del poder de Altman era su extensa red de inversión, que a veces incluso se extendía a su vida personal. Mantuvo relaciones financieras con varios exsocios: algunos implicaban cogestionar fondos, otros donde lideraba inversiones, y algunos eran coinversiones frecuentes. Esta práctica no es rara en Silicon Valley. Muchos ejecutivos heterosexuales también operan de esta manera. ("Tienes que hacerlo", nos dijo un CEO muy conocido). El propio Altman declaró: "Claramente, he invertido con algunos ex después de que nos separamos, y creo que eso está totalmente bien". Pero este arreglo en sí crea un nivel muy alto de dependencia. “Esto crea fundamentalmente una confianza muy, muy fuerte”, dijo una persona cercana a Altman, “muchas veces, incluso una confianza de por vida”.

Sin embargo, varios rumores en torno a la vida personal de Sam Altman han sido explotados e incluso distorsionados por los competidores. La feroz competencia comercial no es nada nuevo, pero la competencia dentro del sector de la inteligencia artificial se ha vuelto excepcionalmente brutal. "Shakespeareana", descrita por un ejecutivo de OpenAI, que agregó: "Las reglas habituales del juego parecen en long no aplicarse". Algunos intermediarios asociados directamente con Elon Musk, recibiendo incluso sus fondos en algunos casos, han difundido decenas de páginas de "investigaciones de la oposición" sobre Altman. Estos materiales muestran un alto nivel de vigilancia: incluyendo empresas fantasma relacionadas con él, información de contacto íntimo e incluso registros de entrevistas con una llamada trabajadora sexual en un bar gay. Un intermediario también afirmó que los itinerarios de vuelo de Altman y las fiestas a las que asistió estaban siendo rastreados. Altman nos dijo: "Siento que nadie fue contratado para investigar más sobre mí de lo que yo he sido".

Mientras tanto, también se están spread diversas acusaciones extremas. La personalidad mediática de derecha Tucker Carlson ha dado a entender sin ninguna evidencia que Altman estuvo involucrado en la muerte de un denunciante, afirmación que los competidores han amplificado continuamente. La hermana de Altman, Annie, declaró en una demanda y durante una entrevista con nosotros que él había abusado sexualmente de ella desde que tenía tres años y él doce. (No pudimos verificar las afirmaciones de Annie. Altman lo niega, y su madre y su hermano también afirmaron que estas acusaciones son "completamente falsas" y han traído un "enorme dolor" a toda la familia. En una entrevista realizada por la periodista Karen Hao para su libro "Empire of AI," Annie afirmó que estos recuerdos fueron recuperados en "flashbacks" en la edad adulta.)

Además, varios individuos de empresas competidoras y empresas de inversión también nos insinuaron que Altman estaba involucrado en actividades sexuales de menores de edad, una afirmación que circuló ampliamente en Silicon Valley y que parece igualmente infundada. Pasamos meses investigando, realizando docenas de entrevistas y no encontramos evidencia que apoye esta afirmación. Altman respondió: "Esta es una táctica repugnante que creo que es la de los competidores que tratan de 'envenenar al pool de jurados' para futuros casos. Si bien suena absurdo, aún quiero declarar: cualquier afirmación sobre mí teniendo relaciones sexuales con menores, contratando a trabajadoras sexuales o estando involucrada en asesinatos es completamente falsa". También agregó que está "algo agradecido" por que hayamos pasado "tantos meses investigando estas cosas con tanta profundidad".

Sam Altman admite haber tenido relaciones con jóvenes de edad legal. Entrevistamos a algunos de sus socios, quienes dijeron que no veían ningún problema con esto. Sin embargo, la "investigación de la oposición" del campo de Elon Musk deliberadamente enmarcó esto como un punto de ataque. (Estos materiales incluso incluyeron algunas afirmaciones sensacionales y no verificadas, como el llamado "Ejército Gemelo" y "La torcedura de Sugar Daddy"). Altman respondió: "Hay mucha homofobia amplificada mezclada aquí". La periodista tecnológica Kara Swisher también está de acuerdo: “Toda esta gente rica ha hecho todo tipo de cosas escandalosas, más escandalosas que cualquier otra cosa que haya escuchado sobre Sam. Pero debido a que es un hombre gay en San Francisco, eso está siendo utilizado como un arma".

Durante la última década, ejecutivos de la Empresa prometieron en una ocasión que podrían "cambiar el mundo" casi sin efectos secundarios, descartando las demandas regulatorias como "luditas", provocando en algún evento la ira bipartidista. Por el contrario, la imagen de Altman parecía particularmente "autoconsciente". No solo no rehuyó la regulación, sino que la pidió activamente. En 2023, testificando ante el asignado Judicial del Senado estadounidense, propuso establecer una nueva agencia federal para regular los modelos avanzados de IA. "Si esta tecnología sale mal, las consecuencias serán muy severas", dijo. El senador de Luisiana John Kennedy, conocido por sus comentarios bruscos hacia los CEO de Empresas tecnológicas, incluso parecía algo aprobatorio, sugiriendo medio en broma que Altman debería estar a cargo de la regulación él mismo.

Sin embargo, mientras abrazaba públicamente la regulación, Altman también estaba presionando en privado en contra de ella. Según Time, entre 2022 y 2023, OpenAI diluyó con éxito una propuesta regulatoria de la Unión Europea dirigida a las grandes empresas de IA. En 2024, la legislatura de California presentó un proyecto de ley que requería pruebas de seguridad de modelos de IA, muchos de los cuales reflejaban de cerca la defensa de Altman en el Congreso. OpenAI se opuso públicamente al proyecto de ley y ejerció presión entre bastidores. "A lo largo de ese año, vimos que el comportamiento de OpenAI se volvía cada vez más astuto y engañoso", nos dijo un asesor legislativo.

Mientras tanto, Musk continuó sus ataques públicos contra Altman, refiriéndose a él como "Scam Altman" y "Swindly Sam". (Cuando Altman se quejó de un problema con un Tesla en X, Musk respondió: "Le robaste a una organización sin fines de lucro"). Pero en Washington, Altman parecía tener ventaja. Musk había contribuido una vez con más de 250 millones de dólares para ayudar a Donald Trump a ser reelegido, sirviendo brevemente en la Casa Blanca antes de irse, lo que agrió su relación con Trump.

Hoy, Altman se ha convertido en uno de los magnates de la tecnología preferidos por Trump, visitando incluso el castillo de Windsor, en el Reino Unido, con él. Ambos hablan varias veces al año. "Puedes llamarlo directamente", dijo Altman. "No es ese tipo de amistad, pero si necesito hablar con él sobre algo, lo llamaré". Cuando Trump recibió a los líderes tecnológicos en la Casa Blanca el año pasado, Musk estaba ausente, y Altman se sentó frente al presidente. "Sam, eres un pez gordo", le dijo Trump. "Me dijiste algunas cosas increíbles antes."

El inversor Ron Conway también presionó a figuras políticas como Nancy Pelosi y Gavin Newsom para que presionaran por el rechazo del mencionado proyecto de ley. En última instancia, mientras el proyecto de ley recibió el apoyo bipartidista y se aprobó, fue vetado por Newsom. Este año, algunos candidatos al Congreso que apoyaban la regulación de IA se enfrentaron a opositores fondo por "Liderando el Futuro", un súper PAC pro IA. OpenAI declaró oficialmente que no donaría a dichas organizaciones, pero su cofundador Greg Brockman prometió $50 millones. (Ese mismo año, él y su esposa también donaron $25 millones a un súper PAC que apoya a Trump.)

Las acciones de OpenAI van más allá del lobby tradicional. El año pasado, cuando el Senado de California propuso una versión revisada de un proyecto de ley, Nathan Calvin, un abogado de una organización de interés público involucrado en la redacción del proyecto de ley, recibió una citación de OpenAI durante una cena en su casa. La Empresa afirmó que era para investigar si Musk estaba fondo secretamente a los críticos, pero solicitó todas las comunicaciones privadas de Calvin sobre el proyecto de ley. “Podrían habernos preguntado directamente si habíamos recibido dinero de Musk, en absoluto”, dijo. Otros partidarios del proyecto de ley, así como aquellos críticos de la transición de comercialización de OpenAI, también recibieron citaciones similares. "Están tratando de intimidar a estas personas para que guarden silencio", dijo Don Howard, jefe de la organización de interés público. (OpenAI afirmó que esto forma parte de los procedimientos legales normales.)

En plazo de postura política, Altman ha apoyado en long al Partido Demócrata. Él ha declarado: "Estoy muy cauteloso con aquellos gobernantes autoritarios que usan una narrativa de miedo para reprimir a los débiles, esto es más de mi origen judío que de mi orientación sexual". En 2016, apoyó a Hillary Clinton, calificando a Trump como "una amenaza sin precedentes para Estados Unidos"; en 2020, donó al Partido Demócrata y al fondo de campaña de Biden. Durante el mandato de Joe Biden, visitó la Casa Blanca en múltiples ocasiones para debates (según contexto) y ayudó a impulsar el primer marco regulatorio de seguridad de IA a nivel federal.

Sin embargo, para 2024, a medida que los índices de aprobación de Biden disminuyeron, la postura de Altman comenzó a cambio: "Independientemente del resultado de las elecciones, Estados Unidos estará bien". Después de la victoria de Trump, donó un millón de dólares a su fondo de toma de posesión y se tomó una foto con las celebridades de internet Jake y Logan Paul en la ceremonia de toma de posesión. En X, escribió: "He estado observando a @potus más de cerca recientemente, y realmente cambio mi percepción de él (ojalá hubiera pensado más independientemente antes...)". En el primer día de Trump en el cargo, derogó las órdenes ejecutivas de IA de la era Biden. Un ex alto funcionario del gobierno comentario: "Encontró una forma efectiva de hacer que la administración Trump funcione para él".

A lo largo de los años, Altman siempre ha comparado el desarrollo del AGI con el "Proyecto Manhattan". Así como J. Robert Oppenheimer movilizó una vez a científicos con un sentido de misión "contra los nazis", Altman también apalancamiento la narrativa de la competencia geopolítica para obtener apoyos. Frente a diferentes audiencias, utiliza esta analogía de manera flexible, a veces enfatizando la aceleración, a veces enfatizando la precaución. En el verano de 2017, durante una reunión con funcionarios de inteligencia de Estados Unidos, afirmó que China había lanzado un "Proyecto AGI Manhattan" y lo utilizó para buscar fondos gubernamentales. Cuando se le pidió que proporcionara evidencia, solo dijo: "He escuchado algunas cosas", pero nunca proporcionó evidencia específica. Un funcionario del gobierno involucrado en la investigación declaró más tarde que no se encontraron tales proyectos: "Esto parece más bien un argumento de venta". (Altman afirmó no recordar haberlo dicho de esa manera).