Limite de 3 saudações, para onde foi o seu limite do Código Claude? Um bug no cache de 28 dias e uma resposta oficial que recomenda que você "use com moderação".

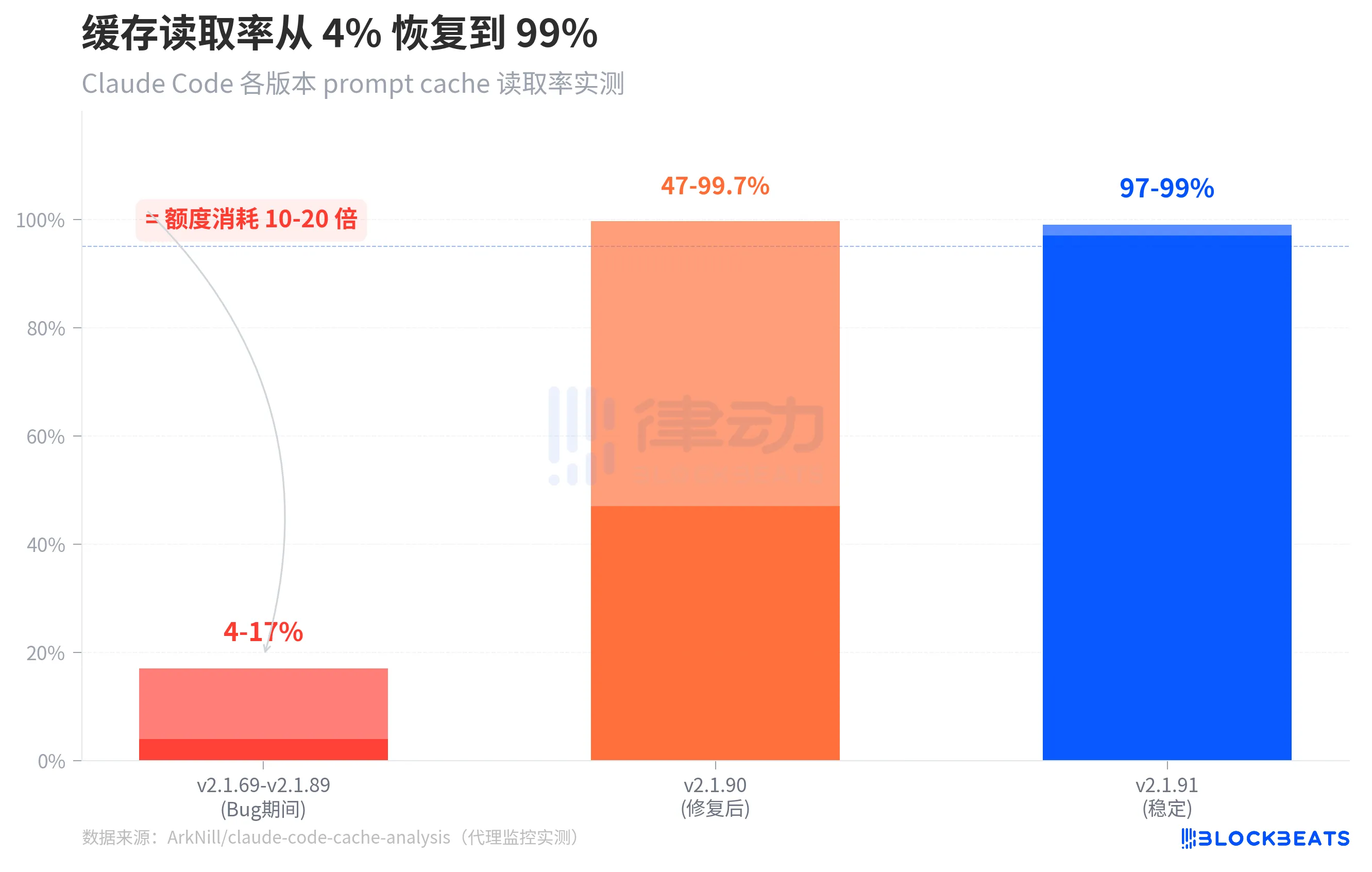

4-17%. Esta é a taxa de acertos no cache de prompts do Claude Code no último mês. O nível normal é de 97% a 99%.

Isso significa que, ao retomar uma sessão anterior, o Claude Code não reutiliza o contexto processado anteriormente, mas sim processa tudo do zero a cada vez, consumindo créditos a uma taxa de 10 a 20 vezes maior do que o normal. Você pode achar que está dando continuidade a uma conversa, mas, na verdade, está iniciando uma conversa totalmente nova e paga integralmente a cada vez.

Esses dados provêm do monitoramento de proxies realizado pelo desenvolvedor independente ArkNill. Ao configurar um proxy transparente, ele registrou todas as solicitações entre o Claude Code e a API da Anthropic, identificando pelo menos dois erros de cache no lado do cliente que impediam o servidor da API de reconhecer os prefixos das conversas armazenados em cache, forçando uma reconstrução completa dos tokens a cada rodada.

O gráfico acima mostra uma comparação das taxas de acertos de cache em três etapas. Durante as versões v2.1.69 a v2.1.89 (o período em que o bug ocorreu), a taxa de acertos no cache da versão autônoma foi de apenas 4% a 17%. Após a correção de um bug crítico na versão v2.1.90, a taxa de acertos do cache em inicialização a frio voltou a ficar entre 47% e 99,7%. Na versão 2.1.91, a taxa de acertos do cache estável voltou a ficar entre 97% e 99%.

Um detalhe digno de nota no gráfico: a variação na versão 2.1.90 é bastante ampla (47% a 99,7%), pois o cache ainda precisa “aquecer” quando uma sessão é retomada, o que resulta em baixas taxas de acertos nas primeiras tentativas, mas volta rapidamente ao normal. Na versão com falha, esse aquecimento nunca ocorre — a taxa de acertos do cache permanece sempre em 14.500 tokens de prompt do sistema, sendo que o histórico completo da conversa é cobrado integralmente a cada vez.

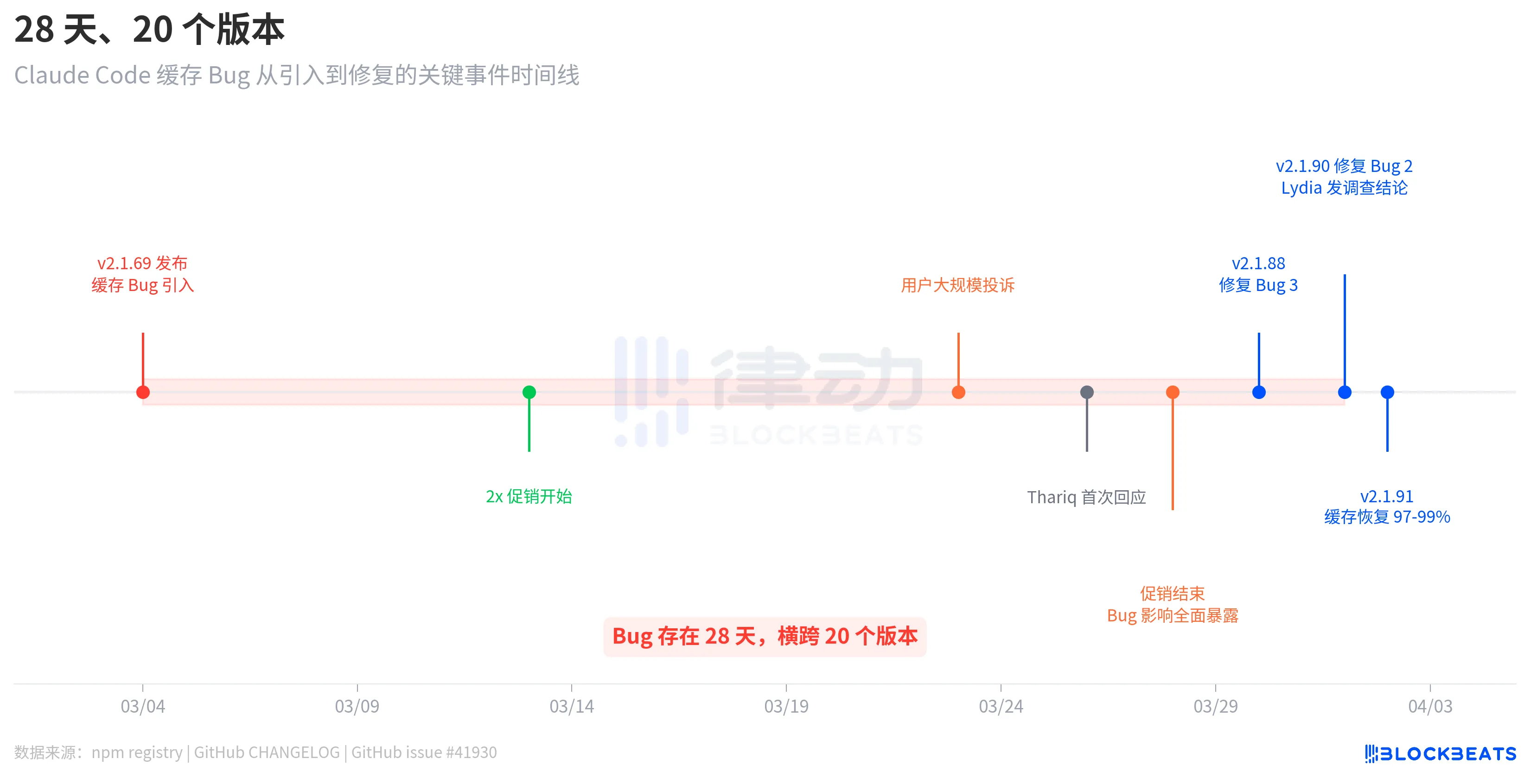

28 dias, 20 versões

Esse bug não é do tipo que é introduzido em uma atualização e corrigido na seguinte. De acordo com os registros de lançamento do repositório npm, a versão v2.1.69, que introduziu o bug, foi lançada em 4 de março, e a versão v2.1.90, que corrigiu o bug, foi lançada em 1º de abril. Passaram-se 28 dias nesse intervalo, com um total de 20 versões.

A linha do tempo revelou um detalhe intrigante. Depois que o bug surgiu, em 4 de março, os usuários não reclamaram em massa de imediato. Foi só em 23 de março que as reclamações surgiram em massa, quase três semanas depois. A razão é que, de acordo com a análise da issue #41930 do GitHub, entre 13 e 28 de março, a Anthropic tinha em vigor uma promoção que duplicava a cota (durante os horários de menor movimento), o que, objetivamente, mascarou o impacto do bug. Após o término da promoção, o consumo do cache bug voltou aos níveis normais de faturamento, e as cotas dos usuários "evaporuaram" instantaneamente.

A resposta da Anthropic não foi imediata. Em 26 de março, três dias após o surgimento das reclamações dos usuários, o engenheiro Thariq Shihipar anunciou em sua conta pessoal no X que o limite para o horário de pico (dias úteis, das 5h às 11h, horário do Pacífico) havia sido reforçado. Em 30 de março, a Anthropic admitiu no Reddit que “a velocidade com que os usuários atingiram sua cota superou em muito as expectativas”, indicando isso como a principal prioridade da equipe. Foi somente em 1º de abril que Lydia Hallie, membro da equipe, divulgou as conclusões oficiais da investigação.

Durante todo o processo, a Anthropic não publicou nenhuma postagem no blog, não enviou notificações por e-mail nem atualizou a página de status. Todas as comunicações oficiais foram feitas exclusivamente por meio de publicações nas redes sociais pessoais dos engenheiros e de alguns comentários no Reddit.

Quanto você pagou e por quanto tempo pode usá-lo?

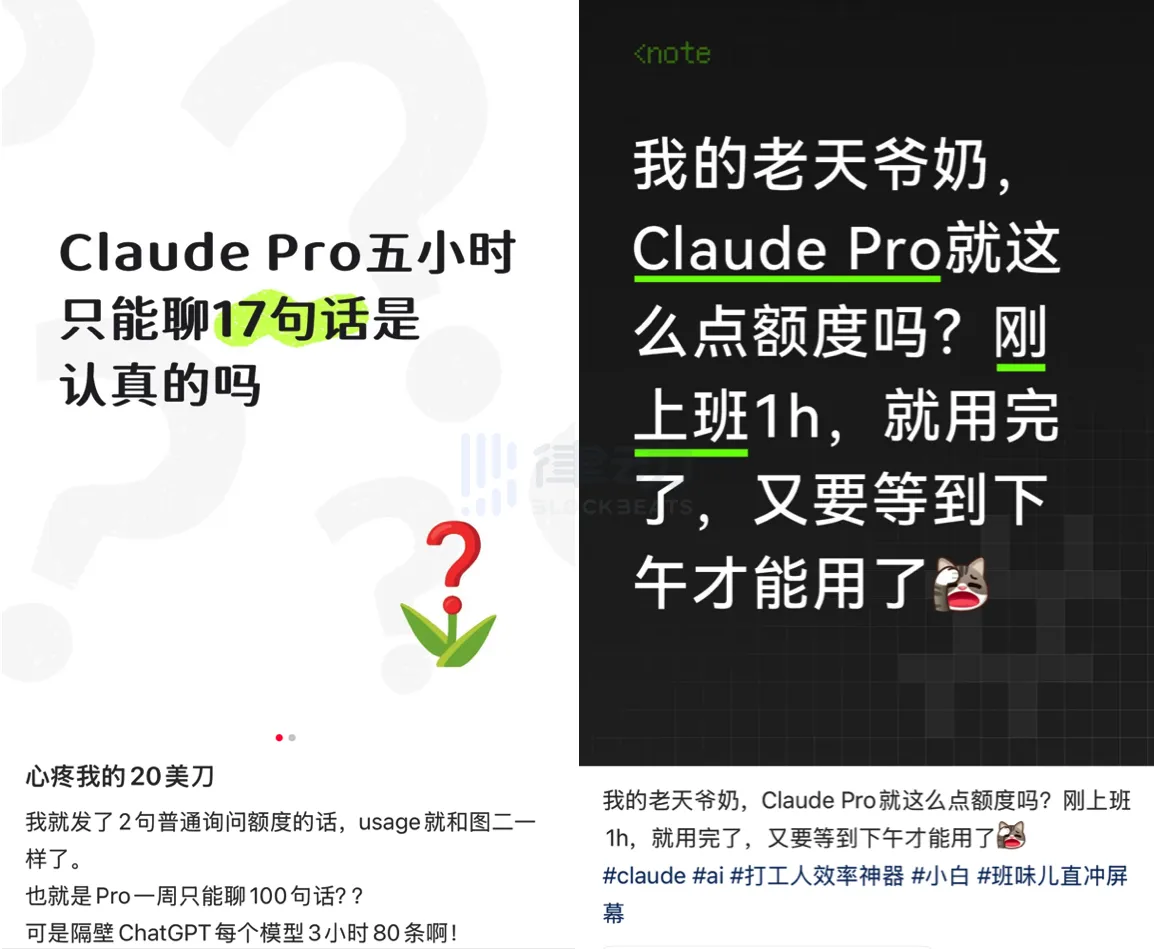

A issue #41930 do GitHub reuniu centenas de relatos de usuários. O caso mais extremo foi o de um usuário com assinatura Max 20x (US$ 200/mês), cujo limite de 5 horas foi totalmente esgotado em 19 minutos. Os usuários do plano Max 5x (US$ 100/mês) relataram que seu período de 5 horas se esgotou em 90 minutos. De acordo com o The Letter Two, alguns usuários alegaram que um simples “olá” consumiu 13% de sua cota de sessão. Um usuário Pro (US$ 20/mês) do Discord mencionou que sua cota “esgotava todas as segundas-feiras e só era reiniciada no sábado”, o que significava apenas 12 dias de uso normal em 30 dias.

De acordo com os testes de benchmark realizados por ArkNill, na versão v2.1.89, a cota de 100% do plano Max 20x seria esgotada em cerca de 70 minutos. Ele também calculou o custo de uma única operação de retomada para uma sessão de contexto de 500 mil tokens, que é de aproximadamente US$ 0,15, já que o sistema reproduz integralmente todo o contexto.

“Você está segurando errado”

A investigação de Lydia Hallie confirmou dois pontos: primeiro, houve de fato um endurecimento dos limites nas horas de pico; e, segundo, houve um aumento no consumo de fichas no contexto de 1 milhão de fichas. Ela mencionou que a equipe corrigiu alguns bugs, mas enfatizou que “nenhum desses bugs resultou em cobrança indevida”.

Em seguida, ela deu quatro recomendações para economizar:

1. Use o Sonnet 4.6 em vez do Opus (o Opus consome cerca do dobro);

2. Reduza a profundidade do raciocínio ou desative o raciocínio avançado quando não for necessário um raciocínio profundo;

3. Não retome sessões inativas que durem mais de uma hora; em vez disso, inicie uma nova;

4. Defina a variável de ambiente CLAUDE_CODE_AUTO_COMPACT_WINDOW=200000 para limitar o tamanho da janela de contexto.

Não foi feita qualquer menção a qualquer tipo de reajuste de cotas ou compensação.

O apresentador do podcast sobre IA, Alex Volkov, resumiu essa resposta com a frase “Você está usando da maneira errada”, ressaltando que a própria Anthropic definiu o contexto de 1 milhão de tokens como padrão, promoveu o Opus como seu modelo principal e destacou o raciocínio estendido como um argumento de venda, mas agora está aconselhando os usuários pagantes a não utilizarem esses recursos.

A afirmação de que "não há cobrança excessiva" também entra em contradição com o próprio histórico de atualizações do Claude Code. Pouco antes da resposta de Lydia, a versão 2.1.90 corrigiu um bug de regressão no cache que estava presente desde a versão 2.1.69: ao usar a opção --resume para retomar uma sessão, as solicitações que deveriam ter sido atendidas pelo cache provocavam uma falha total no cache de prompts, resultando em cobrança integral. A resposta de Lydia não mencionou essa anomalia confirmada na cobrança.

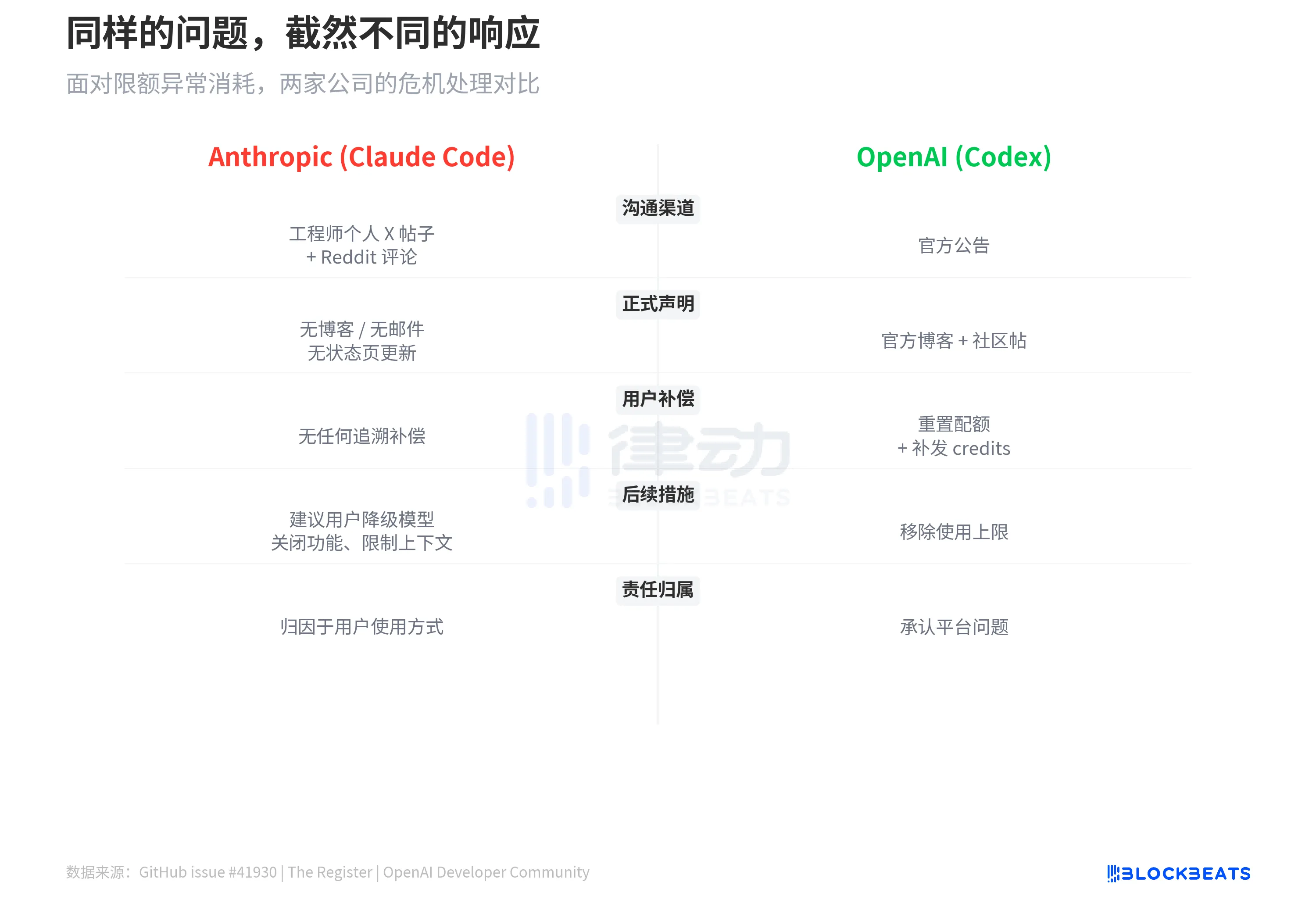

A título de comparação, o Codex da OpenAI já havia enfrentado problemas semelhantes de consumo anormal de cotas. A abordagem da OpenAI consistiu em zerar as cotas dos usuários, emitir reembolsos de crédito e anunciar a remoção do limite de uso do Codex em março. A abordagem da Anthropic consiste em aconselhar os usuários a reduzir o nível dos modelos, desativar recursos, limitar o contexto e atribuir a responsabilidade ao uso feito pelo usuário.

A Anthropic oferece uma assinatura que inclui “o modelo mais potente + o máximo de contexto + as melhores capacidades de raciocínio”, cobrando uma taxa que varia de US$ 20 a US$ 200 por mês. Um bug no cache com duração de 28 dias fez com que as cotas dos usuários pagos se esgotassem a uma velocidade 10 a 20 vezes maior, tendo sido a recomendação oficial que se fizesse uso moderado do serviço.

Você também pode gostar

Quase US$ 300 milhões destinados aos EUA Eleições de meio de mandato: executivo da Tether lidera o segundo maior fundo político do setor de criptomoedas

O que é o Auto Earn? Como reivindicar criptografia extra gratuita no Auto Earn 2026

O que é o Auto Earn e como você o usa? Este guia explica como o Auto Earn funciona e como o saldo aumenta e as indicações podem se qualificar para recompensas extras durante o Auto Earn Boost Fest.

A OpenAI e a Anthropic anunciaram aquisições no mesmo dia, causando apreensão em relação a duas ofertas públicas iniciais.

Auto Earn Comparado 2026: Qual Exchange Oferece O Maior Bônus Extra?

O que é Auto Earn em cripto? Compare as funcionalidades de Auto Earn da Kraken, OKX, Bybit, Binance e WEEX em 2026 e veja quais plataformas oferecem recompensas promocionais adicionais além dos mecanismos de rendimento padrão.

Atualização da Lei CLARITY 2026: Proibição de Rendimento de Stablecoin, Compromisso do Senado e o que Isso Significa para os Mercados de Criptomoedas

A Lei CLARITY pode reformular as regras de rendimento de stablecoin, incentivos DeFi e liquidez de criptomoedas em 2026. Saiba as últimas atualizações do Senado, mudanças de cronograma e o que a regulamentação pode significar para os traders de criptomoedas.

O Triplo Momento da Anthropic: Vazamento de código, impasse governamental e instrumentalização

Forbes: A tecnologia quântica ameaça a indústria de criptomoedas? Mas é mais provável que seja uma oportunidade

Recrutamento para o evento Rhythm X Zhihu em Hong Kong: inscreva-se agora e tenha a chance de se apresentar ao vivo

Empresas de mineração de Bitcoin fogem pela enésima vez

Como ganhar dinheiro no Polymarket usando IA?

A Filosofia de Economia de Dinheiro da Era da IA: Como Gastar Cada Moeda Inteligentemente

“A Floresta Negra de US$ 240 bilhões: A Queda da Iron Finance”

Relatório Matinal | YZi Labs aumenta estrategicamente o investimento na Predict.fun; Drift Protocol sofre um ataque com perdas de pelo menos US$ 200 milhões; x402, da Coinbase, passa a integrar a Linux Foundation

O Sonho de 590 Bilhões de Dólares: Como a Warren Buffett Feminina Caiu em Desgraça?

Diálogo com o fundador da Pantera: Bitcoin atingiu a velocidade de escape, os ativos tradicionais estão sendo deixados para trás

O dilema do crescimento da Base: tudo foi feito corretamente, mas os usuários ainda saem

# Outline

H1: Ataque Cibernético ao Drift Protocol: Como um Atacante Assumiu o Controle Administrativo H2: Introdução ao Drift Protocol…

# Título

Hayden Adams Critica Protocolo Drift Após Hack de US$ 270 Milhões no Solana Key Takeaways O Protocolo Drift,…

Quase US$ 300 milhões destinados aos EUA Eleições de meio de mandato: executivo da Tether lidera o segundo maior fundo político do setor de criptomoedas

O que é o Auto Earn? Como reivindicar criptografia extra gratuita no Auto Earn 2026

O que é o Auto Earn e como você o usa? Este guia explica como o Auto Earn funciona e como o saldo aumenta e as indicações podem se qualificar para recompensas extras durante o Auto Earn Boost Fest.

A OpenAI e a Anthropic anunciaram aquisições no mesmo dia, causando apreensão em relação a duas ofertas públicas iniciais.

Auto Earn Comparado 2026: Qual Exchange Oferece O Maior Bônus Extra?

O que é Auto Earn em cripto? Compare as funcionalidades de Auto Earn da Kraken, OKX, Bybit, Binance e WEEX em 2026 e veja quais plataformas oferecem recompensas promocionais adicionais além dos mecanismos de rendimento padrão.

Atualização da Lei CLARITY 2026: Proibição de Rendimento de Stablecoin, Compromisso do Senado e o que Isso Significa para os Mercados de Criptomoedas

A Lei CLARITY pode reformular as regras de rendimento de stablecoin, incentivos DeFi e liquidez de criptomoedas em 2026. Saiba as últimas atualizações do Senado, mudanças de cronograma e o que a regulamentação pode significar para os traders de criptomoedas.