نزاع OpenAI: القوة والثقة والحدود الخارجة عن السيطرة للذكاء الاصطناعي العام

عنوان المقال الأصلي: سام ألتمان قد يتحكم بمستقبلنا - هل يمكن الوثوق به؟

مؤلفو المقال الأصلي: رونان فارو وأندرو مارانتز، مجلة نيويوركر

ترجمة: بيغي، بلوك بيتس

ملاحظة المحرر: تعيد هذه المقالة، من خلال عدد كبير من الوثائق غير المنشورة والمقابلات المتعمقة، النظر في الأزمة الداخلية داخل OpenAI فيما يتعلق بسلطة سام ألتمان والثقة. من الإطاحة بمجلس الإدارة إلى إعادة التعيين السريع في "انقلاب يشبه الانقلاب"، لم يكن هذا الاضطراب حدثًا لمرة واحدة، بل كان انفجارًا مركزًا لصراعات الحوكمة طويلة الأمد.

يكمن جوهر الصراع في استمرار شد الحبل بين مجموعتين من المنطق: من جهة، المهمة غير الربحية لـ OpenAI القائمة على "سلامة الإنسان أولاً"، ومن جهة أخرى، التحول التدريجي نحو مسار تطوير موجه نحو المنتجات والحجم والإيرادات مع اقتراب الذكاء الاصطناعي العام وتسارع التسويق. وفي هذه العملية، تم إضعاف الالتزامات المتعلقة بالسلامة بشكل مستمر، وتركزت السلطة وصنع القرار تدريجياً بين أيدي قلة.

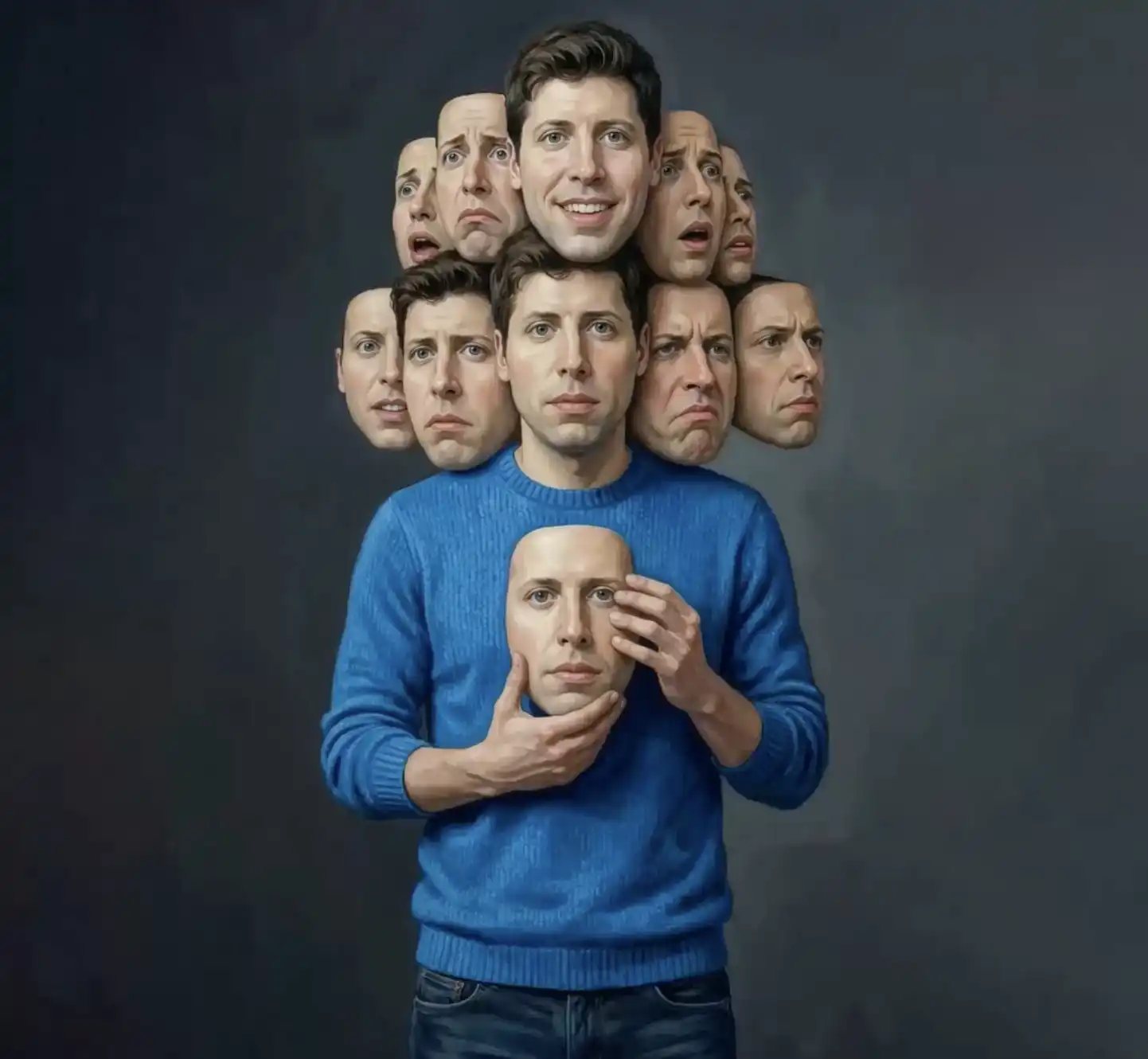

وقد شكك العديد من الشخصيات الرئيسية، بما في ذلك إيليا سوتسكيفر وداريو أمودي، في قدرات ألتمان، مركزين على غموض المعلومات والتعبير الاستراتيجي، معتقدين أن أسلوب قيادته غير كافٍ لإدارة التكنولوجيا التي "ستغير مصير البشرية" بشكل قوي؛ ومع ذلك، يؤكد مؤيدوه أن قدرته في تكامل الموارد وإدارة رأس المال والتنفيذ هي مفتاح التوسع السريع لشركة OpenAI.

عندما تكون القوة التكنولوجية كافية للتأثير على النظام العالمي، فهل لا يزال هيكل حوكمة الشركات الحالي كافياً لتقييد الأفراد؟ بمعنى آخر، في عصر الذكاء الاصطناعي، قد لا يأتي عدم اليقين الحقيقي من التكنولوجيا نفسها فحسب، بل من أولئك الذين يتحكمون في التكنولوجيا.

فيما يلي المقال الأصلي:

القوة والثقة: انقسامات الحوكمة في ظل قيادة ألتمان

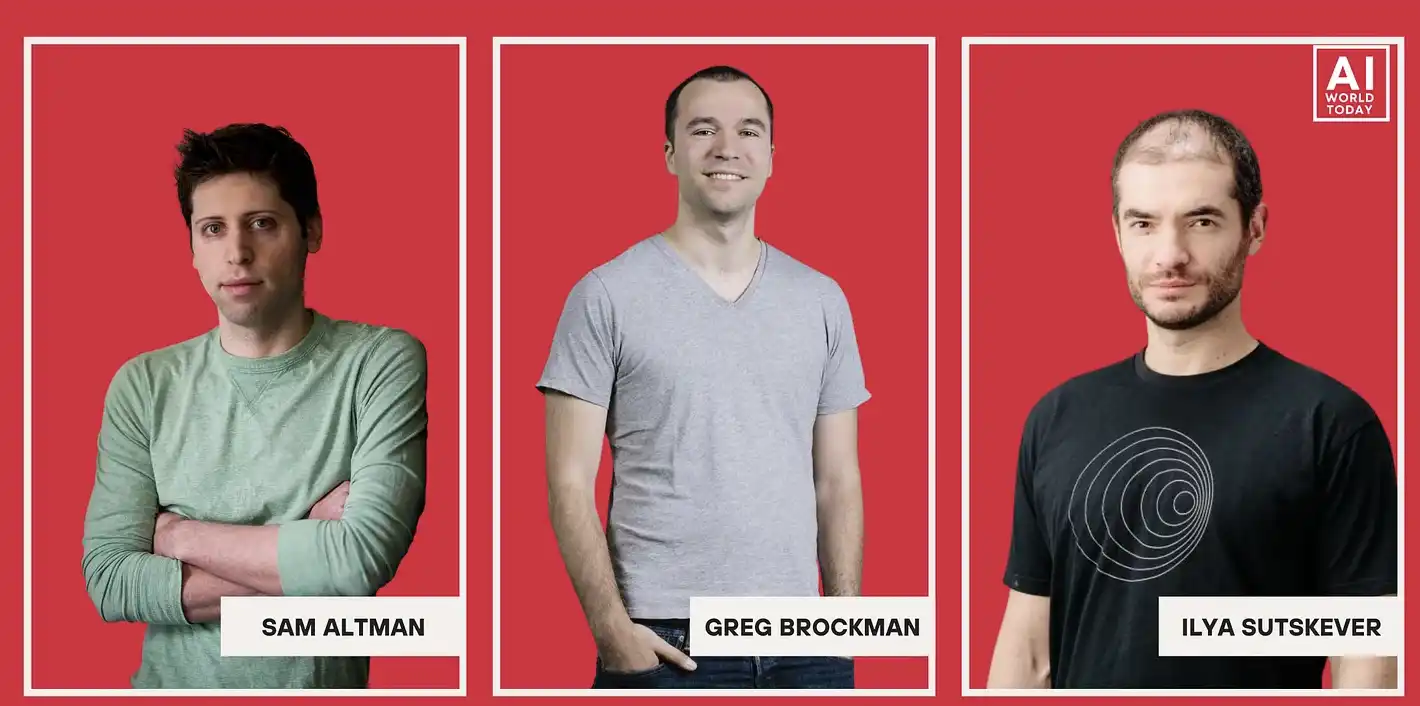

في خريف عام 2023، أرسل كبير علماء شركة OpenAI، إيليا سوتسكيفر، مذكرة سرية إلى الأعضاء الثلاثة الآخرين في مجلس إدارة الشركة. في الأسابيع السابقة، كانوا يناقشون بشكل خاص قضية حساسة: ما إذا كان الرئيس التنفيذي للشركة سام ألتمان ونائبه جريج بروكمان لا يزالان مؤهلين لمواصلة قيادة الشركة.

مصدر الصورة: عالم الذكاء الاصطناعي اليوم

كان سوتسكيفر يعتبرهما صديقين في وقت من الأوقات. في عام 2019، استضاف حتى حفل زفاف بروكمان في مكتب OpenAI، حيث كان هناك ذراع روبوتية تعمل كـ "حامل الخواتم".

لكن مع ازدياد اقتناعه بأن الشركة تقترب من هدفها طويل المدى - وهو إنشاء ذكاء اصطناعي يمكنه أن يضاهي أو يتجاوز القدرات المعرفية البشرية - تعمقت شكوكه بشأن ألتمان. وكما قال لأحد أعضاء مجلس الإدارة في ذلك الوقت: "لا أعتقد أن سام هو الشخص الذي يجب أن يكون له الكلمة الفصل".

بناءً على طلب أعضاء مجلس الإدارة الآخرين، قام سوتسكيفر، إلى جانب زملائه ذوي التفكير المماثل، بتجميع وثيقة من حوالي سبعين صفحة، بما في ذلك سجلات دردشة سلاك وملفات الموارد البشرية والتعليقات المصاحبة. بل إن بعض المحتوى كان عبارة عن لقطات شاشة تم التقاطها بالهاتف، على ما يبدو لتجنب المراقبة بواسطة أجهزة الشركة. وفي النهاية أرسل هذه المذكرات إلى أعضاء مجلس الإدارة الآخرين بطريقة "القراءة والحرق" لضمان عدم اطلاع المزيد من الناس عليها.

"لقد كان خائفاً حقاً في ذلك الوقت"، هكذا تذكر أحد المخرجين الذين تلقوا المواد. لقد راجعنا هذه المذكرات، التي لم يتم الكشف عنها بالكامل من قبل. واتهمت الوثائق ألتمان بتشويه الحقائق أمام المديرين التنفيذيين وأعضاء مجلس الإدارة، وبالسلوك الخادع فيما يتعلق ببروتوكولات الأمن الداخلي. بدأت إحدى المذكرات المتعلقة بألتمان بقائمة من العناصر بعنوان "لقد أظهر سام باستمرار ..."، وكان العنصر الأول هو "الكذب".

تدعي العديد من شركات التكنولوجيا أنها "تجعل العالم مكاناً أفضل"، لكن عملياتها الفعلية تتمحور حول تحقيق أقصى قدر من الإيرادات. لكن المبدأ التأسيسي لـ OpenAI كان من المفترض أن يكون مختلفًا عن هذا النموذج. كان مؤسسوها، بمن فيهم ألتمان وسوتسكيفر وبروكمان وإيلون ماسك، يعتقدون أن الذكاء الاصطناعي يمكن أن يكون أحد أقوى الاختراعات وأكثرها خطورة في تاريخ البشرية. في ظل هذا "الخطر الوجودي"، قد تحتاج الشركة إلى هيكل تنظيمي غير تقليدي.

تأسست OpenAI في البداية كمنظمة غير ربحية، وكان مجلس إدارتها مكلفاً بوضع "سلامة البشرية جمعاء" فوق نجاح الشركة، بل وحتى إعطائها الأولوية على بقاء الشركة نفسها. سيحتاج الرئيس التنفيذي إلى امتلاك شخصية وأخلاق استثنائية.

وكما قال سوتسكيفر: "إن أي شخص يشارك في بناء هذه التكنولوجيا التي يمكن أن تغير الحضارة كما نعرفها يتحمل مسؤولية جسيمة وواجبًا غير مسبوق". لكنه أشار أيضاً إلى أن "أولئك الذين ينتهي بهم المطاف في هذه المناصب غالباً ما يكونون من نوع معين - أشخاص متعطشون للسلطة، أو سياسيون، أو أولئك الذين يستمتعون بالسلطة لذاتها". وفي إحدى المذكرات، أعرب عن قلقه بشأن إسناد هذه التكنولوجيا إلى شخص "لا يقول إلا ما يريد الآخرون سماعه".

إذا تبين في نهاية المطاف أن الرئيس التنفيذي لشركة OpenAI غير جدير بالثقة، فإن مجلس الإدارة المكون من ستة أشخاص لديه القدرة على عزله. أصبح بعض المخرجين، بمن فيهم خبيرة سياسات الذكاء الاصطناعي هيلين تونر ورائدة الأعمال تاشا مكولي، أكثر اقتناعاً بحكمهم السابق بعد قراءة هذه المذكرات: ما افترضه ألتمان كان مسؤولية تتعلق بمستقبل البشرية، لكنه لم يكن جديراً بالثقة.

انقلاب في قاعة الاجتماعات: إقالة سام ألتمان

في ذلك الوقت، كان سام ألتمان في لاس فيغاس يشاهد سباق الفورمولا واحد عندما دعاه إيليا سوتسكيفر إلى مكالمة فيديو مع مجلس الإدارة وقرأ بيانًا موجزًا يعلن فيه أنه لم يعد موظفًا في OpenAI. أصدر المجلس، بناءً على نصيحة قانونية، بيانًا عامًا، جاء فيه أن ألتمان قد تم فصله بسبب "فشله في الحفاظ على الصدق في التواصل بشكل مستمر".

أثار هذا القرار صدمة لدى العديد من مستثمري ومسؤولي شركة OpenAI. كما علمت شركة مايكروسوفت، التي استثمرت حوالي 13 مليار دولار في شركة OpenAI، بالخبر في اللحظة الأخيرة قبل تنفيذ القرار. "لقد فوجئت للغاية في ذلك الوقت"، هذا ما ذكره ساتيا ناديلا، الرئيس التنفيذي لشركة مايكروسوفت، لاحقاً. "لم أتمكن من الحصول على مزيد من المعلومات من أي شخص." ثم اتصل بريد هوفمان (المؤسس المشارك لشركة لينكد إن، ومستثمر في شركة أوبن إيه آي، ومدير في شركة مايكروسوفت)، الذي بدأ في الاستفسار في كل مكان عما إذا كان ألتمان قد ارتكب أي مخالفة واضحة. قال هوفمان لنا: "كنت في حيرة تامة في ذلك الوقت". "كنا نبحث عن قضايا مثل الاختلاس أو التحرش، لكنني لم أجد شيئاً."

وقد فوجئ شركاء تجاريون آخرون بالمثل. عندما اتصل ألتمان بالمستثمر رون كونواي لإبلاغه بفصله، كان كونواي يتناول الغداء مع عضوة الكونجرس الأمريكي نانسي بيلوسي، فسلمها الهاتف على الفور. قالت لكونواي: "من الأفضل أن تغادر من هنا بسرعة".

في غضون ذلك، كانت شركة OpenAI على وشك إكمال جولة تمويل رئيسية من شركة رأس المال الاستثماري Thrive Capital، التي أسسها جوش كوشنر، وهو أيضًا شقيق جاريد كوشنر، الذي كان ألتمان يعرفه لسنوات عديدة. كانت هذه الصفقة ستقدر قيمة OpenAI بـ 86 مليار دولار وستسمح للعديد من الموظفين بسحب ملايين الدولارات من مزايا الأسهم. كان كوشنر قد أنهى لتوه اجتماعاً مع المنتج الموسيقي ريك روبين عندما رأى مكالمة ألتمان الفائتة وأعاد الاتصال بها. "دخلنا على الفور في وضعية القتال"، كما ذكر لاحقاً.

في يوم إقالته، عاد ألتمان جواً إلى قصره الذي تبلغ قيمته 27 مليون دولار في سان فرانسيسكو، والذي يطل على الخليج بأكمله مع مسبح لا متناهي معلق، حيث أنشأ مركز قيادة مؤقت أطلق عليه اسم "نوع من الحكومة المنفية". انضم كونواي، وبريان تشيسكي المؤسس المشارك لشركة Airbnb، وكريس ليهان، مدير العلاقات العامة الشهير بمواقفه العدائية في إدارة الأزمات، عبر الفيديو والهاتف، وتحدثوا أحياناً لساعات متواصلة. بل إن بعض أعضاء الفريق التنفيذي لألتمان أقاموا مخيمات في ممرات المنزل. تمركز المحامون في مكتبه المنزلي المجاور لغرفة النوم. خلال نوبات الأرق، كان ألتمان يذرع المكان جيئة وذهاباً وهو يرتدي بيجامته. وفي وصفه لتجربة ما بعد إطلاق النار في مقابلة حديثة، وصفها بأنها "نوع غريب من حالة الشرود الذهني".

مع التزام مجلس الإدارة الصمت، بدأ الفريق الاستشاري لألتمان في بناء سردية لعودته. أصر ليهان على أن عملية الفصل كانت في الواقع "انقلابًا" دبره "المؤثرون الفعالون"، وهم دعاة نظام فكري يؤكد على تعظيم الرفاهية البشرية الشاملة، والذين رأوا الذكاء الاصطناعي كتهديد وجودي. (كما أشار هوفمان إلى ناديلا في ذلك الوقت أن الفصل قد يكون بسبب "نوع من الجنون الإيثاري الفعال".) اقترح ليهان، الذي استعار شعاره المنتشر على نطاق واسع من مايك تايسون، "لكل شخص خطة حتى يتلقى لكمة في وجهه"، على ألتمان شن هجوم جريء على وسائل التواصل الاجتماعي. ظل تشيسكي على اتصال مع الصحفية التقنية كارا سويشر، وكان يردد باستمرار انتقادات مجلس الإدارة للعالم الخارجي.

في كل مساء عند الساعة السادسة، كان ألتمان يخرج من "غرفة الحرب" الخاصة به ليصب لنفسه مشروب نيغروني. وتذكر أنه قال لمن حوله: "عليكم أن تسترخوا؛ ما قُدِّر له أن يحدث سيحدث". لكنه أضاف أن سجلات المكالمات أظهرت أنه كان يتحدث على الهاتف لأكثر من اثنتي عشرة ساعة يومياً خلال تلك الفترة.

في مرحلة ما، كشف مصدر أن ألتمان أخبر ميرا موراتي، التي كانت تشغل آنذاك منصب الرئيس التنفيذي المؤقت لشركة OpenAI، أن حلفاءه كانوا "يبذلون قصارى جهدهم" ويحاولون "التنقيب عن معلومات تسيء" لتشويه سمعتها وسمعة الآخرين المتورطين في الضغط من أجل إقالته. (يزعم ألتمان نفسه أنه لا يتذكر هذه المحادثة.)

في غضون ساعات من فصله، أوقفت شركة Thrive Capital استثمارها المخطط له وأوضحت أنه فقط في حالة عودة سام ألتمان ستتم الصفقة وسيحصل الموظفون على مكافآتهم من الأسهم. أظهرت سجلات الرسائل النصية في ذلك الوقت أن ألتمان كان على اتصال متكرر للغاية مع ساتيا ناديلا. (في صياغة بيان مشترك، اقترح ألتمان صياغته على النحو التالي: "أولويتي القصوى الآن هي إنقاذ OpenAI"، بينما اقترح ناديلا صياغة مختلفة: "ضمان استمرار ازدهار OpenAI."

انعكاس القوة: أُعيد ألتمان إلى منصبه سريعًا بعد 5 أيام

بعد ذلك بوقت قصير، أعلنت مايكروسوفت أنها ستطلق مشروعًا تنافسيًا لألتمان وأي موظفين آخرين من شركة OpenAI غادروا الشركة. وفي الوقت نفسه، بدأت رسالة عامة تطالب بعودة ألتمان بالانتشار داخل الشركة. تلقى بعض الذين كانوا مترددين في البداية في التوقيع مكالمات ورسائل توسلات من زملائهم. في نهاية المطاف، هددت غالبية موظفي OpenAI بالاستقالة الجماعية دعماً لألتمان.

تم حصر اللوحة في زاوية. قالت هيلين تونر: "الضغط على زر زد، هذا خيار متاح" - في إشارة إلى التراجع عن قرار الفصل. "الخيار الآخر هو الانهيار التام." حتى الرئيسة التنفيذية المؤقتة آنذاك، ميرا موراتي، وقعت في النهاية على الرسالة العامة. بدأ حلفاء ألتمان محاولاتهم لإقناع إيليا سوتسكيفر بتغيير موقفه. حتى أن زوجة بروكمان، آنا، اقتربت منه في المكتب وقالت: "أنت شخص جيد، يمكنك إصلاح هذا الأمر". أوضح سوتسكيفر لاحقًا في شهادة أمام المحكمة: "شعرت في ذلك الوقت أنه إذا سلكنا طريق عدم عودة سام، فسوف يتم تدمير OpenAI".

في إحدى الليالي، تناول ألتمان حبة النوم أمبين، وأيقظه زوجُه، المبرمج الأسترالي أوليفر مولهيرين، الذي أخبره أن موقف سوتسكيفر متذبذب، واقترح على ألتمان التواصل مع مجلس الإدارة على الفور. "استيقظت في حالة ضبابية ناتجة عن تناول دواء أمبين"، كما يتذكر ألتمان، "وكنت مشوشًا تمامًا وفكرت، 'لا يمكنني بأي حال من الأحوال التحدث إلى مجلس الإدارة الآن.'"

وفي سلسلة من المكالمات التي تصاعدت حدتها، طالب سام ألتمان باستقالة أعضاء مجلس الإدارة الذين ضغطوا من أجل فصله. عندما فكر في فكرة العودة، تذكر رد فعله الأولي قائلاً: "هل سأقوم بتنظيف فوضاهم في هذه البيئة المشبوهة للغاية؟" قال: "فكرت، بالتأكيد لا". في النهاية، خسر كل من إيليا سوتسكيفر وهيلين تونر وتاشا مكولي مقاعدهم في مجلس الإدارة، ولم يتبق سوى آدم دانجيلو (المؤسس المشارك لـ Quora) كعضو مجلس الإدارة الأصلي.

كجزء من شروط الاستقالة، طلب أعضاء مجلس الإدارة هؤلاء إجراء تحقيق في التهم الموجهة ضد ألتمان - بما في ذلك خلق انقسامات بين المديرين التنفيذيين وإخفاء العلاقات المالية. كما ضغطوا من أجل إنشاء مجلس جديد للإشراف بشكل مستقل على التحقيق الخارجي. ومع ذلك، تم اختيار المديرين الجديدين المعينين - الرئيس السابق لجامعة هارفارد لورانس سامرز والمدير التقني السابق لفيسبوك بريت تايلور - بعد تواصل وثيق مع ألتمان. "هل تعتقدين أن هذا سينجح؟" أرسل ألتمان رسالة نصية إلى ساتيا ناديلا، "مع وجود بريت ولاري سامرز وآدم في مجلس الإدارة، وأنا الرئيس التنفيذي، وبريت يقود التحقيق؟" (أدلت ماكولي بشهادتها لاحقًا بأنه عندما كان تايلور مرشحًا لعضوية مجلس الإدارة، كانت قلقة من أنه قد يكون شديد الخضوع لألتمان).

بعد أقل من خمسة أيام من فصله، أعيد ألتمان إلى منصبه. سيشير موظفو الشركة لاحقًا إلى هذه الفترة باسم "الوميض"، استنادًا إلى نقطة حبكة من فيلم مارفل - اختفاء قصير يتبعه عودة، لكن العالم قد تغير بشكل جذري بسبب غيابهم.

ومع ذلك، فإن الجدل الدائر حول مصداقية ألتمان قد تجاوز منذ فترة طويلة مجلس إدارة OpenAI. اتهمه زميله الذي دبر إقالته بسلوك مضلل متفشي، وهو أمر غير مقبول لأي مسؤول تنفيذي في شركة، ناهيك عن قائد يمتلك مثل هذه التكنولوجيا التحويلية. "نحن بحاجة إلى ضوابط على السلطة تتناسب مع تلك السلطة"، هكذا قالت لنا ميرا موراتي. "طلب مجلس الإدارة تقديم ملاحظات، وقمت بمشاركة ما رأيته بصدق، وأنا أؤيد ذلك." أما مؤيدو ألتمان، من جانبهم، فقد قللوا من شأن هذه الادعاءات لفترة طويلة. عقب عملية الفصل، أرسل المستثمر رون كونواي رسالة إلى برايان تشيسكي وكريس ليهان، يحثهما فيها على شن هجوم مضاد في مجال العلاقات العامة: "الأمر يتعلق بسمعة سام." وقال أيضاً لصحيفة واشنطن بوست إن ألتمان يتعرض لمعاملة غير عادلة من قبل "مجلس إدارة خارج عن السيطرة".

ومنذ ذلك الحين، ارتقى OpenAI ليصبح واحداً من أكثر الشركات قيمة في العالم، ويُقال إنه يستعد لطرح عام أولي محتمل بقيمة تريليون دولار. وفي الوقت نفسه، يقود ألتمان عملية بناء ضخمة للبنية التحتية للذكاء الاصطناعي، مع امتداد بعض الجهود إلى الأنظمة الاستبدادية في الخارج. تسعى OpenAI أيضاً إلى الحصول على عقود حكومية ضخمة وتعمل تدريجياً على وضع معايير لتطبيقات الذكاء الاصطناعي في إنفاذ قوانين الهجرة والمراقبة الداخلية والأسلحة ذاتية التشغيل في مناطق النزاع.

لقد قاد سام ألتمان نمو شركة OpenAI من خلال رسم رؤية عظيمة للمستقبل بشكل مستمر. في منشور على مدونته عام 2024، كتب: "إن الانتصارات المذهلة - حل مشكلة تغير المناخ، وإنشاء مستعمرات خارج كوكب الأرض، والكشف عن جميع القوانين الفيزيائية - ستصبح جميعها في النهاية أموراً عادية". هذه الرواية تدعم واحدة من أسرع الشركات الناشئة نمواً في التاريخ، والتي تعتمد بشكل كبير على التمويل من شركاء ذوي رافعة مالية عالية. يعتمد الاقتصاد الأمريكي بشكل متزايد على عدد قليل من شركات الذكاء الاصطناعي ذات الرافعة المالية العالية، حيث يحذر العديد من الخبراء - بمن فيهم ألتمان نفسه في بعض الأحيان - من خطر حدوث فقاعة في هذه الصناعة. وقال للصحفيين العام الماضي: "سيخسر أحدهم الكثير من المال". إذا انفجرت الفقاعة، فقد يؤدي ذلك إلى كارثة اقتصادية؛ ومع ذلك، إذا تحققت أكثر توقعاته تفاؤلاً، فقد يصبح أيضاً واحداً من أغنى وأقوى الأفراد على مستوى العالم.

في مكالمة متوترة أعقبت إقالة ألتمان، طالب مجلس الإدارة بأن يعترف بنمط من السلوك المضلل. وبحسب مصادر حاضرة، فقد قال مراراً وتكراراً: "هذا أمر سخيف"، وصرح قائلاً: "لا أستطيع تغيير من أنا". ادعى ألتمان لاحقاً أنه لا يتذكر تلك المحادثة. "أعتقد أن ما كنت أحاول قوله هو أقرب إلى القول: 'لقد حاولت دائماً أن أكون موحداً'،" أوضح لنا لاحقاً، عازياً نجاحه في قيادة شركة ناجحة بشكل لا يصدق إلى هذه السمة. وقد عزا هذه الانتقادات إلى ميله في بداية حياته المهنية إلى "تجنب الصراع كثيراً". لكن أحد أعضاء مجلس الإدارة قدم تفسيراً مختلفاً تماماً: "ما كان يقصده حقًا هو - 'لدي عادة الكذب على الناس، ولن أتوقف عن ذلك.'"

مهمة الانحراف: من التركيز على الأمن أولاً إلى التركيز على الأعمال أولاً

وهكذا، برز سؤال أكثر جوهرية: هل كان هؤلاء الزملاء الذين يسعون لإقالته يتصرفون بدافع الحماس المفرط والعداء الشخصي، أم أن حكمهم كان سليماً، وأن ألتمان كان حقاً غير جدير بالثقة؟

في صباح أحد أيام الشتاء هذا العام، التقينا بألتمان في مقر شركة OpenAI في سان فرانسيسكو، وكانت هذه واحدة من أكثر من اثنتي عشرة محادثة أجريناها من أجل هذه المقالة. انتقلت الشركة مؤخراً إلى برجين زجاجيين مكونين من أحد عشر طابقاً، وكان أحدهما سابقاً مقراً لشركة أوبر، عملاق التكنولوجيا الآخر. كان يُنظر إلى ترافيس كالانيك، المؤسس المشارك لشركة أوبر والرئيس التنفيذي السابق لها، على أنه رائد أعمال عبقري لا يمكن إيقافه حتى تم إجباره على الاستقالة في عام 2017، وذلك أيضاً بسبب قضايا أخلاقية. (يدير كالانيك الآن شركة ناشئة في مجال الروبوتات؛ وقد صرح بأنه في أوقات فراغه، يستخدم ChatGPT من OpenAI "لاستكشاف حدود الفيزياء الكمومية".)

قام أحد الموظفين بجولة تعريفية لنا في مساحة المكتب. في منطقة مليئة بالطاولات الطويلة المشتركة والضوء الطبيعي، كانت هناك لوحة رقمية ديناميكية لعالم الكمبيوتر آلان تورينج، الذي كانت عيناه تتبعنا أثناء تحركنا. كان هذا العمل الفني بمثابة إشارة واضحة إلى "اختبار تورينج" - التجربة الفكرية التي أجريت عام 1950 لتحديد ما إذا كان بإمكان الآلة محاكاة الإنسان بشكل مقنع. (في دراسة أجريت عام 2025، تجاوز أداء ChatGPT في هذا الاختبار أداء البشر الحقيقيين.) عادةً، كانت اللوحة تفاعلية. لكن المرشد السياحي أوضح أن خاصية الصوت فيه قد تم تعطيلها لأنه كان "يتنصت" باستمرار على المحادثات بين الموظفين ويقاطعها بشكل متكرر. وفي أماكن أخرى من المكتب، كانت اللافتات التي تحمل عبارة "اشعر بالذكاء الاصطناعي العام" مرئية - وهو شعار صاغه إيليا سوتسكيفر في الأصل لتذكير الزملاء بمخاطر الذكاء الاصطناعي العام المتقدم (النقطة التي تصل فيها الآلات إلى مستوى القدرة المعرفية البشرية). بعد انحسار الموجة، تطورت العبارة إلى شعار بهيج يحتفي بمستقبل مزدهر.

وجدنا سام ألتمان في غرفة اجتماعات عادية في الطابق الثامن. قال: "كنت أسمع الناس يتحدثون عن إرهاق اتخاذ القرارات، ولم أفهم ذلك أبداً". "الآن أرتدي سترة رمادية وبنطال جينز كل يوم، وحتى عند اختيار أي سترة رمادية من الخزانة، أتمنى لو لم أضطر إلى اتخاذ هذا القرار."

بدا ألتمان شاباً دائماً، بجسمه النحيل، وعينيه الزرقاوين المتباعدتين، وشعره الأشعث قليلاً، لكنه كان في الأربعين من عمره. لديه هو وأوليفر مولهيرين ابن يبلغ من العمر عاماً واحداً عن طريق تأجير الأرحام. قال وهو ينظر إلى أحدنا ثم إلى الآخر: "أعتقد أن منصب رئيس الولايات المتحدة يمثل بالتأكيد ضغطاً أكبر، ولكن من بين جميع الوظائف التي أعتقد أنني أستطيع القيام بها بشكل واقعي، هذه هي الوظيفة التي يمكنني تخيل أنها ستكون الأكثر ضغطاً". لقد وصفت الأمر لأصدقائي بهذه الطريقة: "إنها الوظيفة الأكثر إثارة للاهتمام في العالم حتى اليوم الذي أطلقنا فيه ChatGPT." قبل ذلك، كنا نحقق هذه الإنجازات العلمية العملاقة - كنت أعتقد أنها واحدة من أهم الاكتشافات العلمية منذ عقود. نظر إلى الأسفل. "لكن منذ إطلاق ChatGPT، أصبحت جميع القرارات صعبة للغاية."

نشأ ألتمان في كلايتون بولاية ميسوري، وهي ضاحية ثرية لمدينة سانت لويس، وكان أكبر أربعة أطفال. والدته، كوني جيبستين، طبيبة أمراض جلدية، ووالده، جيري ألتمان، كان وكيل عقارات عمل أيضاً في مبادرات الإسكان. نشأ في معبد يهودي إصلاحي، والتحق بمدرسة تحضيرية خاصة، ووصفها لاحقاً بأنها "ليست مكاناً سهلاً للإفصاح عن ميولك المثلية". ومع ذلك، بشكل عام، كان مجتمع الطبقة المتوسطة العليا الذي كان ينتمي إليه ليبرالياً نسبياً.

في سن السادسة عشرة أو السابعة عشرة تقريباً، تعرض لاعتداء جسدي خطير وإهانات معادية للمثليين أثناء خروجه ليلاً في حي يقطنه المثليون في سانت لويس. لم يبلغ ألتمان عن الحادثة ولم يكن على استعداد لتقديم المزيد من التفاصيل، مصرحاً بأن سردًا أكثر تفصيلاً "سيجعلني أبدو وكأنني أتلاعب بالناس أو أسعى إلى التعاطف". قلل من شأن هذه التجربة ومن أهمية ميوله الجنسية لهويته. لكنه أقر أيضاً قائلاً: "ربما هناك شيء عميق جداً من الناحية النفسية، يتعلق بالشعور بأنني قد أعلنت عن ميولي الجنسية ولكنني لم أفعل ذلك في الواقع - لتجنب المزيد من الصراع".

وصف شقيقه شخصيته في طفولته بأنها "يجب أن أفوز، ويجب أن أسيطر على كل شيء"، وذلك في مقابلة مع مجلة نيويوركر عام 2016. التحق ألتمان لاحقًا بجامعة ستانفورد وشارك بشكل متكرر في ألعاب البوكر خارج الحرم الجامعي. "أشعر أنني تعلمت هناك عن الحياة والأعمال أكثر مما تعلمت في الجامعة."

عصر واي كومبيناتور: الجدل حول المبالغة والثقة

طلاب جامعة ستانفورد طموحون، لكن أكثرهم ميلاً إلى العمل غالباً ما يختارون الانسحاب. في نهاية سنته الدراسية الثانية، توجه ألتمان إلى ماساتشوستس للانضمام إلى المجموعة الأولى من رواد الأعمال في برنامج حاضنة الشركات الناشئة Y Combinator. شارك في تأسيس هذه المؤسسة مهندس البرمجيات الشهير بول غراهام. انضم كل مشارك بفكرة مشروع ناشئ. (ومن بين أولئك الذين كانوا في دفعته الفرق التي أسست فيما بعد موقعي Reddit و Twitch.) أُطلق على مشروع ألتمان لاحقًا اسم Loopt، وهو منتج مبكر للتواصل الاجتماعي يسمح للأصدقاء برؤية أماكن وجود بعضهم البعض من خلال تتبع موقع هواتفهم المقلوبة. أظهرت الشركة قدراته التنفيذية وميله إلى إيجاد مساحة لنفسه في المناطق الرمادية. في ذلك الوقت، كانت اللوائح الفيدرالية تشترط على شركات الاتصالات أن تكون قادرة على تحديد موقع الهاتف في حالات الطوارئ، وقد أبرم ألتمان صفقات مع شركات الاتصالات لدمج هذه الإمكانية في منتجه.

أحب معظم الموظفين خلال حقبة Loopt سام ألتمان، لكن البعض اندهش من ميله إلى "المبالغة" حتى في بعض الأمور التافهة. يتذكر البعض أن ألتمان كان يتباهى بكونه بطلًا في لعبة تنس الطاولة "مثل بطل تنس الطاولة في مدرسة ميسوري الثانوية" فقط ليكون أحد أسوأ اللاعبين في الشركة. (قال ألتمان إنها ربما كانت مجرد مزحة.) تم تعيين مارك جاكوبشتاين، وهو موظف قديم في شركة لوبت، من قبل المستثمرين ليكون بمثابة "الوصي" على ألتمان، وقد علق لاحقًا في سيرة كيتش هاجي الذاتية بعنوان "المتفائل": "هناك منطقة رمادية بين "أعتقد أنني قد أكون قادراً على فعل هذا" و "لقد فعلت هذا بالفعل"، وفي أقصى صورها، يمكن أن يؤدي هذا الغموض إلى نتائج مثل نتائج ثيرانوس."

وبحسب هاجي، ونظرًا للمخاوف بشأن أسلوب قيادة ألتمان وافتقاره للشفافية، اقترح بعض كبار موظفي شركة لوبت مرتين على مجلس الإدارة إقالته من منصب الرئيس التنفيذي. لكن في الوقت نفسه، كان يتمتع أيضاً بجاذبية شخصية قوية. تذكر موظف سابق أن أحد أعضاء مجلس الإدارة رد مباشرة قائلاً: "هذه شركة سام، عد إلى عملك." (ومع ذلك، نفى بعض أعضاء مجلس الإدارة أيضًا أن تكون محاولات الإقالة هذه جدية.)

لم تشهد شركة Loopt أي تحسن في نمو المستخدمين، وفي النهاية استحوذت عليها شركة تكنولوجيا مالية في عام 2012. وبحسب مصادر مطلعة، فإن عملية الاستحواذ هذه كانت تهدف إلى حد كبير إلى مساعدة ألتمان على "الخروج بكرامة". ومع ذلك، بحلول عام 2014، عندما تقاعد بول غراهام من شركة واي كومبيناتور، اختار ألتمان كخليفة له. قال غراهام لصحيفة نيويوركر : "سألته في مطبخي الخاص، فابتسم كما لو أن كل شيء قد استقر في مكانه". لم أرَ قط ابتسامة سام الجامحة، مثل تلك التي تظهر عندما ترمي كرة ورقية بعيداً في سلة المهملات.

جعل المنصب الجديد من ألتمان، الذي كان يبلغ من العمر آنذاك 28 عاماً، "صانع ملوك". كانت مهمته فحص رواد الأعمال الأكثر طموحًا والأكثر وعدًا، وربطهم بكبار المبرمجين والمستثمرين، ومساعدتهم في بناء شركات احتكارية رائدة في الصناعة (وفي الوقت نفسه، ستحصل YC على 6٪ إلى 7٪ من الأسهم).

تحت قيادته، توسعت شركة Y Combinator بسرعة، حيث ازداد عدد المشاريع المحتضنة من العشرات إلى المئات. لكن بعض المستثمرين في وادي السيليكون بدأوا يعتقدون أن مصالحه لم تكن متوافقة تماماً. أخبرنا أحد المستثمرين أن ألتمان "سيستثمر شخصياً بشكل انتقائي في الشركات ذات الجودة الأعلى لاستبعاد المستثمرين الخارجيين" (نفى ألتمان هذا الادعاء). كما عمل ككشاف لشركة سيكويا كابيتال، وشارك في استثمارات المشاريع في مراحلها المبكرة وحصل على بعض العوائد.

وبحسب المصادر، عندما استثمر ألتمان في شركة التكنولوجيا المالية Stripe كمستثمر ملاك، أصر على الحصول على نسبة أعلى من الأسهم، وهي ممارسة لم ترضي شركة Sequoia داخليًا. وأشار المصدر إلى أن هذا يعكس استراتيجية "سام أولاً". (نفى ألتمان هذا الادعاء). استثمر حوالي 15000 دولار في شركة سترايب حوالي عام 2010، وكان يمتلك حوالي 2% من الأسهم، وتبلغ قيمة الشركة الآن أكثر من 150 مليار دولار. زعم ألتمان أنه استثمر في حوالي 400 شركة.

بحلول عام 2018، كان العديد من شركاء Y Combinator غير راضين عن سلوك ألتمان وأبلغوا غراهام بذلك. وبعد ذلك، أجرى غراهام محادثة صريحة مع زوجته وشريكته المؤسسة لـ YC، جيسيكا ليفينغستون، وألتمان. بعد ذلك، بدأ غراهام بالتصريح علنًا بأنه على الرغم من أن ألتمان وافق شفهيًا على المغادرة، إلا أنه لم يتنحى فعليًا من الناحية العملية.

أبلغ ألتمان بعض الشركاء بأنه سيستقيل من منصب الرئيس لكنه سيبقى رئيساً لمجلس الإدارة. في مايو 2019، نشرت شركة Y Combinator منشورًا على مدونتها تعلن فيه عن الرئيس الجديد، مع ملاحظة تنص على أن "سام ينتقل إلى منصب رئيس مجلس إدارة YC". بعد بضعة أشهر، تم تعديل هذا البيان إلى "لقد تنحى سام ألتمان عن أي دور تشغيلي في YC"، ثم تم حذف هذه الجملة بالكامل. ومع ذلك، وحتى عام 2021، كان ألتمان لا يزال مدرجاً كرئيس لمجلس إدارة شركة واي كومبيناتور في الولايات المتحدة. ملفات هيئة الأوراق المالية والبورصات. (قال ألتمان إنه لم يعلم بهذا الأمر إلا لاحقاً.)

صرح سام ألتمان علنًا على مر السنين وفي شهادة قانونية حديثة بأنه لم يتم طرده من شركة Y Combinator وأخبرنا أنه لم يقاوم المغادرة. غرّد بول غراهام قائلاً: "لم نكن نريده أن يرحل، لكننا أردنا منه أن يختار بين YC و OpenAI". وفي بيان له، قال غراهام أيضاً: "ليس لدينا السلطة القانونية لفصل أي شخص؛ كل ما يمكننا فعله هو ممارسة الضغط الأخلاقي".

لكن في السر، كانت القصة أكثر وضوحًا - رحيل ألتمان نابع من انعدام الثقة من شركاء YC. يستند هذا السرد لفترة عمل ألتمان في واي كومبيناتور إلى مقابلات مع العديد من مؤسسي وشركاء واي كومبيناتور ومواد معاصرة، وكلها تشير إلى أن الانفصال لم يكن بالتراضي تمامًا. وبحسب ما ورد، قال غراهام لزملائه في YC في إحدى المناقشات الداخلية إن "سام كان يكذب علينا طوال الوقت قبل فصله".

انحراف مهمة OpenAI: من السلامة أولاً إلى الربح أولاً

في مايو 2015، أرسل ألتمان بريدًا إلكترونيًا إلى إيلون ماسك، الذي كان آنذاك يحتل المرتبة المئة تقريبًا بين أغنى أغنياء العالم. ومثل العديد من رواد الأعمال في وادي السيليكون، كان ماسك يركز بشدة آنذاك على سلسلة مما اعتبره "مخاطر وجودية" - على الرغم من أن معظم الآخرين اعتبروها احتمالات بعيدة. وكتب على تويتر: "علينا أن نكون حذرين للغاية بشأن الذكاء الاصطناعي، فهو ربما يكون أكثر خطورة من الأسلحة النووية".

سرعان ما غيّر ألتمان، الذي كان متفائلاً بالتكنولوجيا لفترة طويلة، نبرته بشأن الذكاء الاصطناعي إلى نبرة أكثر تشاؤماً. وفي تصريحات علنية واتصالات خاصة مع ماسك وآخرين، حذر من السماح لشركات التكنولوجيا العملاقة التي تحركها الأرباح باحتكار هذه التكنولوجيا. وكتب قائلاً: "كنت أتساءل عما إذا كانت هناك طريقة لوقف سباق التسلح في مجال الذكاء الاصطناعي، ولكن إذا لم تكن هناك طريقة، فيبدو أنه من الأفضل أن تقوم الشركة المناسبة بذلك". واستناداً إلى التشبيه النووي، اقترح إنشاء "ذكاء اصطناعي" مشروع مانهاتن. كما أوضح المبادئ الأساسية لهذه المنظمة - "يجب أن تكون السلامة هي الأولوية القصوى"؛ "بالتأكيد يجب علينا اتباع جميع اللوائح ودعمها".

وبعد ذلك، استقر هو وإيلون ماسك على اسم المشروع: OpenAI.

وعلى عكس مشروع مانهاتن، الذي كان في البداية بقيادة الحكومة وبلغ ذروته في صنع القنبلة الذرية، سيتم تمويل OpenAI بشكل خاص في مراحله المبكرة. توقع ألتمان أنه بمجرد ظهور شكل من أشكال "الذكاء الخارق" الذي يتجاوز الذكاء الاصطناعي العام، فإنه سيولد قيمة اقتصادية كافية "للسيطرة على مخروط الضوء المستقبلي للكون". ومع ذلك، فقد أكد مرارًا وتكرارًا على مخاطرها الوجودية المحتملة: ففي مرحلة ما، قد يكون تأثير التكنولوجيا على الأمن القومي كبيرًا لدرجة أنه قد يجبر الحكومة الأمريكية على الاستيلاء على OpenAI، بل وتأميمها، ونقل مرافقها إلى قاعدة آمنة في الصحراء. وبحلول نهاية عام 2015، كان ماسك قد اقتنع. وكتب: "ينبغي أن نعلن عن التزام بتمويل قدره مليار دولار، وسأدعمه إذا لم يفعل الآخرون ذلك".

وضع سام ألتمان في البداية شركة OpenAI تحت مظلة الذراع غير الربحية لشركة Y Combinator وقدمها على أنها مشروع خيري داخلي. قام بتخصيص أسهم YC للأعضاء المنضمين إلى OpenAI ونقل أموال التبرعات من خلال حسابات YC. في مرحلة ما، اعتمد هذا المختبر حتى على دعم من صندوق YC الذي كان لألتمان فيه مصالح شخصية. (أشار ألتمان لاحقًا إلى هذه الحصة في رأس المال بأنها "ضئيلة" وذكر أن أسهم YC المخصصة للموظفين جاءت من ممتلكاته الشخصية.)

وقد تجلى التشابه مع "مشروع مانهاتن" أيضاً في سباق المواهب. على غرار أبحاث الانشطار النووي، كان التعلم الآلي آنذاك مجالاً علمياً صغير النطاق ذو تأثير محتمل يصنع التاريخ، بقيادة مجموعة صغيرة من الأفراد الموهوبين بشكل واضح. كان إيلون ماسك، وألتمان، وجريج بروكمان، الذين انضموا من شركة سترايب، يعتقدون جميعًا أن علماء الكمبيوتر الذين حققوا إنجازات رائدة حقًا كانوا قليلين ونادرين. أما جوجل، من ناحية أخرى، فقد كانت تتمتع بميزة هائلة من حيث التمويل والوقت. "نحن متأخرون بشكل كبير في القوى العاملة والموارد، والفجوة غير واقعية"، كتب ماسك لاحقًا في رسالة بريد إلكتروني. لكنه كان يعتقد أيضاً أنه "إذا استطعنا الاستمرار في جذب أفضل المواهب وضمان الاتجاه الصحيح، فإن OpenAI ستظل منتصرة".

كان إيليا سوتسكيفر أحد أهم أهداف التوظيف - وهو باحث انطوائي ومكثف غالباً ما يعتبر أحد أكثر علماء الذكاء الاصطناعي موهبة في عصره. ولد سوتسكيفر في الاتحاد السوفيتي عام 1986، وكان لديه خط شعر متراجع، وعيون غائرة، وعادة التوقف والتحديق بتأمل قبل التحدث. ومن الشخصيات الرئيسية الأخرى داريو أمودي، وهو باحث في مجال الطاقة العالية ذو خلفية في الفيزياء الحيوية، والذي كان غالباً ما يمرر يده بعصبية عبر شعره الأسود في لحظات التوتر، ويرد بمقالات متعددة الفقرات حتى على رسائل البريد الإلكتروني المكونة من جملة واحدة. كان كلاهما يشغلان مناصب ذات رواتب عالية في شركات أخرى في ذلك الوقت، لكن ألتمان بذل جهداً كبيراً في ضمهما إلى الفريق. ثم قال مازحاً: "كنت عملياً ألاحق إيليا".

على الرغم من أن ماسك قد يتمتع بشهرة أكبر، إلا أن ألتمان هو الشخص الأكثر سلاسة في التعامل. بادر بإرسال بريد إلكتروني إلى أمودي ورتب اجتماعاً فردياً في مطعم هندي. (ألتمان: "تعرضت سيارة أوبر التي كنت أستقلها لحادث!" قد يتأخر عشر دقائق. أمودي: "أوه لا، أتمنى أن تكون بخير." مثل العديد من باحثي الذكاء الاصطناعي، يعتقد أمودي أنه لا ينبغي تطوير هذه التقنية إلا بعد أن يثبت أنها "متوافقة" مع القيم الإنسانية - أي أنها لا تنحرف بشكل كارثي عن النية البشرية، مثل إبادة البشرية باسم "تنظيف البيئة". كرر ألتمان هذا القلق المتعلق بالسلامة مراراً وتكراراً في محادثتهما، مما غرس الثقة.

أمضى أمودي، الذي انضم لاحقًا إلى الشركة، سنوات في توثيق تصرفات ألتمان وبروكمان، وجمعها في وثيقة بعنوان "تجربتي في OpenAI" (العنوان الفرعي: "مؤتمن: ممنوع التوزيع". تم تداول أكثر من 200 صفحة من الملفات المتعلقة بأمودي - بما في ذلك هذه الملاحظات ورسائل البريد الإلكتروني الداخلية والمذكرات - داخل دوائر وادي السيليكون ولكن لم يتم الكشف عنها علنًا أبدًا. في هذه السجلات، كتب أمودي أن هدف ألتمان كان إنشاء "مختبر ذكاء اصطناعي يركز على السلامة (ربما ليس في البداية، ولكن بعد ذلك بوقت قصير)".

في ديسمبر 2015، وقبل ساعات فقط من الإعلان الرسمي لشركة OpenAI، أرسل ألتمان بريدًا إلكترونيًا إلى ماسك يذكر فيه شائعة: كانت جوجل "ستقدم عرضاً عكسياً ضخماً للجميع في OpenAI غداً، في محاولة للقضاء على المنظمة تماماً". سأل ماسك: "هل قدم إيليا إجابة قاطعة؟" ردّ ألتمان قائلاً إن سوتسكيفر كان حازماً. في الواقع، عرضت جوجل على سوتسكيفر راتباً سنوياً قدره 6 ملايين دولار، وهو ما لم تستطع OpenAI مجاراته. ومع ذلك، ظل ألتمان واثقاً، قائلاً: "من المؤسف أنهم ليسوا على جانب "فعل الشيء الصحيح".

سبق أن وفر إيلون ماسك مساحة مكتبية لشركة OpenAI في مصنع حقائب سفر قديم في حي ميشن بمدينة سان فرانسيسكو. وكما أخبرنا إيليا سوتسكيفر، فإن الشعار الأساسي الذي كان يحشد الموظفين في ذلك الوقت هو: "أنتم جميعاً ستنقذون العالم". إذا سارت الأمور على ما يرام، فقد اعتقد مؤسسو OpenAI أن الذكاء الاصطناعي سيؤدي إلى يوتوبيا "ما بعد الندرة": أتمتة العمل الشاق، وعلاج السرطان، ومنح البشر المزيد من وقت الفراغ والوفرة. لكن إذا خرجت التكنولوجيا عن السيطرة أو وقعت في الأيدي الخطأ، فقد يكون الدمار شاملاً - مثل استخدامها لتطوير أسلحة بيولوجية جديدة أو أسراب طائرات بدون طيار متطورة؛ وقد تتجاوز النماذج الرقابة البشرية، وتتكاثر ذاتيًا على خوادم سرية تتجاوز إمكانية إيقاف تشغيلها؛ وفي الحالات القصوى، يمكنها حتى السيطرة على الشبكة أو سوق الأسهم أو الترسانة النووية.

على الرغم من أن هذه التقييمات لا تحظى بموافقة الجميع، إلا أن سام ألتمان قد أعرب مراراً وتكراراً عن اعتقاده بهذا الخطر. في منشور مدونة عام 2015، كتب أن الذكاء الآلي ذو المستوى الخارق "لا يحتاج إلى أن يكون شريراً لتدمير البشرية، بل يمكن أن يكون غير مبالٍ، وهو يمضي قدماً في تحقيق أهداف أخرى ... يقضي علينا ببساطة". تعهد المؤسس المشارك لشركة OpenAI بعدم إعطاء الأولوية للسرعة على السلامة، ويتضمن ميثاق الشركة التزامًا قانونيًا "بإفادة البشرية جمعاء". كما أنهم يخشون من أنه إذا أصبح الذكاء الاصطناعي أقوى تقنية على الإطلاق، فإن أي متحكم فردي سيحصل على قوة غير مسبوقة - وهو سيناريو يشيرون إليه باسم "ديكتاتورية الذكاء الاصطناعي العام".

بعد رحيل ماسك، بدأ باحثون مثل داريو أمودي في التعبير عن استيائهم من أسلوب إدارة جريج بروكمان، حيث وجده البعض استبدادياً، بينما وُصف سوتسكيفر بأنه "مبدئي ولكنه يفتقر إلى القدرة التنظيمية". خلال فترة انتقاله إلى منصب الرئيس التنفيذي، بدا أن ألتمان قد قطع التزامات مختلفة تجاه مختلف الفصائل داخل الشركة. لقد أكد لبعض الباحثين أنه سيضعف سلطة بروكمان، لكنه في الوقت نفسه توصل إلى "اتفاق شفهي" مع بروكمان وسوتسكيفر: سيتولى منصب الرئيس التنفيذي، لكنه سيستقيل إذا طلب كلاهما ذلك. (ينفي ألتمان هذا الادعاء، مصرحاً بأنه تمت دعوته ليكون الرئيس التنفيذي). أقر الثلاثة بوجود الاتفاق، وقال بروكمان إنه كان اتفاقاً غير رسمي: "قال من جانب واحد إنه إذا طلبنا نحن الاثنين ذلك، فسوف يستقيل." لقد عارضنا هذه الفكرة بالفعل، لكنه قال إنها مهمة بالنسبة له وأنها تمت بدافع الإيثار." وفي وقت لاحق، علم مجلس الإدارة أن الرئيس التنفيذي قد أنشأ بالفعل "مجلسًا ظليًا" لنفسه، الأمر الذي شكل صدمة.

تشير السجلات الداخلية إلى أن الفريق المؤسس كان لديه شكوك حول الهيكل غير الربحي في وقت مبكر من عام 2017. في نفس العام، وبعد محاولة ماسك للاستحواذ، كتب بروكمان في مذكراته: "لا أستطيع القول إننا التزمنا حقًا بكوننا مؤسسة غير ربحية... "إذا أصبحنا شركة معتمدة من B-Corp في غضون ثلاثة أشهر، فإن التصريحات السابقة كانت أكاذيب." كما وثّق أمودي في مذكراته المبكرة أنه سأل بروكمان عن أولوياته القصوى، فأجاب بروكمان "المال والسلطة". (ينفي بروكمان هذا الادعاء). تكشف مذكراته أيضًا عن عقلية متناقضة: فمن جهة يقول "إذا لم يكن الآخرون أغنياء، فلا يهمني أن أكون غنيًا أيضًا"، ومن جهة أخرى يسأل نفسه "ماذا أريد حقًا؟" وكانت إحدى الإجابات "الوصول إلى مليار دولار ماليًا".

في عام 2017، قرأ سوتسكيفر ورقة بحثية من باحثي جوجل في المكتب تقترح "بنية شبكة بسيطة جديدة - المحول". قفز من على كرسيه، وركض إلى الردهة، وصاح قائلاً: "توقفوا عن كل ما تفعلونه، هذا هو الحل". ويرى أن هذه البنية ستمكن OpenAI من تدريب نماذج أكثر تعقيداً. أدى هذا الإنجاز إلى ظهور نماذج Transformer المدربة مسبقًا لأول مرة، وشكّل الأساس لـ ChatGPT لاحقًا.

كان ألتمان قد تعهد سابقاً للموظفين الأوائل بأن شركة OpenAI ستظل دائماً نقية في طبيعتها غير الربحية، مما دفع العديد من المبرمجين إلى قبول تخفيضات كبيرة في رواتبهم للانضمام إلى الشركة. كما تلقت OpenAI حوالي 30 مليون دولار من التبرعات، بما في ذلك من منظمة Open Philanthropy، وهي مركز تمويل رئيسي في حركة الإيثار الفعال، والتي لطالما دعمت مشاريع مثل توزيع الناموسيات على المناطق الفقيرة.

كان بروكمان وسوتسكيفر يشرفان بشكل رئيسي على العمليات اليومية، بينما ظل ماسك وألتمان منشغلين بمشاريعهم الأخرى، وكانوا يزورون الشركة عادةً مرة واحدة في الأسبوع. بحلول سبتمبر 2017، بدأ ماسك ينفد صبره. عندما ظهرت مناقشات حول إمكانية تحويل OpenAI إلى شركة ربحية، طلب السيطرة على الأغلبية.

تنوعت ردود ألتمان في مناسبات مختلفة، لكن الشيء الوحيد الذي أصر عليه باستمرار هو أنه إذا كانت الشركة ستعيد هيكلة نفسها تحت قيادة رئيس تنفيذي، فيجب أن يشغل هو هذا المنصب. كان سوتسكيفر قلقاً بشكل ملحوظ حيال هذا الأمر. نيابة عن نفسه وبروكمان، أرسل بريدًا إلكترونيًا مطولًا إلى ماسك وألتمان بعنوان "أفكار صادقة"، مصرحًا بأن "هدف OpenAI هو جعل المستقبل أفضل وتجنب دكتاتورية الذكاء الاصطناعي العام". وكتب مخاطباً ماسك: "لذلك، فإن إنشاء هيكل يمكن أن يجعلك ديكتاتوراً هو فكرة سيئة". كما أعرب عن مخاوف مماثلة لألتمان، قائلاً: "نحن لا نفهم لماذا يعتبر منصب الرئيس التنفيذي بالغ الأهمية بالنسبة لك". تتغير أسبابك باستمرار، مما يجعل من الصعب علينا رؤية الدافع الحقيقي.

أجاب ماسك: "أيها السادة، لقد انتهيت، إما أن تفعلوا شيئًا آخر بمفردكم أو تستمروا في الحفاظ على وضع OpenAI كمنظمة غير ربحية - وإلا فأنا أموّلكم مجانًا لإدارة شركة ناشئة." وبعد خمسة أشهر، غادر وهو يشعر باستياء واضح. (في عام 2023، أسس شركة xAI المنافسة التي تهدف إلى الربح). وفي العام التالي، رفع دعوى قضائية ضد ألتمان وشركة OpenAI بتهمة الاحتيال وانتهاك الأمانة الخيرية، مدعياً أنه "تم التلاعب به بعناية" وأن ألتمان انخرط في "عملية احتيال طويلة الأمد" باستخدام مخاوفه بشأن مخاطر الذكاء الاصطناعي لتأمين التمويل. الدعوى القضائية لا تزال جارية، وقد نفت شركة OpenAI بشدة هذه الادعاءات.

مع تقدم القدرات التكنولوجية، علمنا أن حوالي اثني عشر مهندسًا أساسيًا في OpenAI قد عقدوا سلسلة من الاجتماعات السرية، وناقشوا بشكل خاص ما إذا كان يمكن الوثوق بالفريق المؤسس، بما في ذلك سام ألتمان وجريج بروكمان. خلال أحد هذه الاجتماعات، تذكر أحد الموظفين مشهدًا ساخرًا من تأليف الثنائي الكوميدي البريطاني ميتشل وويب - جندي نازي على الجبهة الشرقية يصاب فجأة بإدراك مفاجئ، ويسأل: "هل نحن الأشرار؟"

بحلول عام 2018، بدأ داريو أمودي في التشكيك علنًا في دوافع المؤسسين. وكتب لاحقاً في مذكرة: "يبدو كل شيء وكأنه مخطط تمويل لا ينتهي." أشعر أن ما تحتاجه OpenAI حقًا هو تعريف واضح: ما الذي تريد فعله، وما الذي لا تريد فعله، وكيف سيجعل وجودها العالم أفضل. على الرغم من أن الشركة لديها بالفعل بيان مهمة - "ضمان أن يفيد الذكاء الاصطناعي العام البشرية جمعاء" - شعر أمودي أن هذا البيان لم يكن واضحًا للفريق التنفيذي.

في أوائل عام 2018، بدأ في صياغة ميثاق الشركة، وبعد أسابيع من المناقشة مع ألتمان وبروكمان، ضغط لإدراج أحد أكثر البنود جذرية: إذا كان "مشروع متوافق مع القيم ويراعي السلامة" أقرب إلى تحقيق الذكاء الاصطناعي العام من OpenAI، فإن الشركة "ستتوقف عن المنافسة وستساعد ذلك المشروع بدلاً من ذلك". كان هذا يُعرف باسم بند "الدمج والمساعدة" - على سبيل المثال، إذا تمكنت جوجل من تحقيق الذكاء الاصطناعي العام الآمن أولاً، فإن OpenAI ستحل نفسها نظريًا وتنقل الموارد إلى جوجل. من منظور الأعمال التقليدية، كان هذا الالتزام شبه مستحيل، لكن شركة OpenAI لم تكن تنوي أبدًا أن تصبح شركة تقليدية.

واجهت هذه الفرضية اختباراً واقعياً في ربيع عام 2019. في ذلك الوقت، كانت شركة OpenAI تجري محادثات مع مايكروسوفت بشأن استثمار محتمل يصل إلى مليار دولار. على الرغم من أن أمودي (الذي كان يقود فريق السلامة آنذاك) قد شارك في عرض المشروع على بيل غيتس، إلا أنه كان لا يزال هناك قلق داخل الفريق من أن مايكروسوفت قد تقدم شروطًا من شأنها أن تضعف التزامات OpenAI الأخلاقية. قدم أمودي قائمة ذات أولوية لمتطلبات السلامة إلى ألتمان، مع وجود بند "الدمج والمساعدة" في الأعلى.

وافق ألتمان في ذلك الوقت. ومع ذلك، ومع اقتراب الصفقة من الاكتمال في يونيو، اكتشف أمودي بندًا جديدًا في الاتفاقية يمنح مايكروسوفت حق النقض على اندماج OpenAI. "هذا يرقى إلى مستوى انتهاك بنسبة 80% للميثاق"، كما ذكر لاحقاً. واجه ألتمان بهذا الأمر، حيث أنكر ألتمان في البداية وجود مثل هذا البند. قرأ أمودي العقد حرفياً على الفور، واضطر في النهاية إلى أن يقوم زميل آخر بالتأكيد مباشرة مع ألتمان. (صرح ألتمان بأنه لا يتذكر هذه الحادثة.)

الهجرة لأسباب تتعلق بالسلامة وولادة الأنثروبولوجيا

كما وثّقت ملاحظات أمودي سلسلة من الصراعات المتوترة المتصاعدة. وفي اجتماع عُقد بعد عدة أشهر، استدعى ألتمان شقيقه دانييلا، التي كانت تعمل أيضاً في مجال السلامة والسياسات في الشركة، مدعياً أنه تلقى معلومات موثوقة من "مسؤول تنفيذي كبير" تفيد بأن الاثنين كانا يخططان "لانقلاب". وذكرت الملاحظات أن دانييلا أصبحت "متأثرة عاطفياً" في الحال واستدعت المدير التنفيذي، الذي أنكر بعد ذلك قول مثل هذا الشيء. أشارت مصادر مطلعة على الأمر إلى أن ألتمان نفى لاحقاً توجيه هذا الاتهام على الإطلاق: "لم أقل ذلك أبداً." ردت دانييلا قائلة: "لقد فعلت ذلك للتو." (ذكر ألتمان أن روايته كانت مختلفة قليلاً، مدعياً أنه اتهم أمودي فقط بالانخراط في "سلوك سياسي"). في عام 2020، غادر أمودي ودانييلا والعديد من الزملاء الشركة لتأسيس شركة أنثروبيك، التي أصبحت منذ ذلك الحين واحدة من المنافسين الرئيسيين لشركة أوبن إيه آي.

وفي الوقت نفسه، واصل ألتمان التأكيد على التزام OpenAI بالسلامة، لا سيما في وجود المجندين المحتملين. في نهاية عام 2022، نشر أربعة علماء حاسوب ورقة بحثية تقترح خطر "التوافق الخادع": قد تعمل النماذج المتقدمة للغاية بشكل جيد أثناء الاختبار ولكنها تسعى لتحقيق أهدافها الخاصة بعد النشر الفعلي. (هذا السيناريو الذي يبدو وكأنه من الخيال العلمي قد حدث بالفعل في ظل ظروف تجريبية معينة.) بعد عدة أسابيع من نشر الورقة البحثية، تلقى أحد المؤلفين - وهو طالب دكتوراه في جامعة كاليفورنيا، بيركلي - بريدًا إلكترونيًا من ألتمان. أعرب ألتمان عن مخاوف متزايدة بشأن خطر "الذكاء الاصطناعي غير المتوافق" وفكر في استثمار مليار دولار لمعالجة هذه المشكلة، مثل إنشاء جائزة بحثية عالمية. على الرغم من أن هذا الطالب قد سمع شائعات مفادها أن "سام كان ماكرًا بعض الشيء"، إلا أن الالتزام أقنعه في النهاية بتعليق دراسته والانضمام إلى OpenAI.

ومع ذلك، وبحلول اجتماعات متعددة في ربيع عام 2023، بدا أن موقف ألتمان قد تغير. لم يعد يذكر إنشاء جائزة، بل اتجه بدلاً من ذلك إلى إنشاء "فريق التنسيق الفائق" الداخلي داخل الشركة. وجاء في بيان رسمي أن الفريق سيحصل على "20% من الحوسبة الآمنة للشركة"، وهو مورد تقدر قيمته بأكثر من مليار دولار. وأكد الإعلان أيضاً أنه إذا لم يتم حل مشكلة التوافق، فقد يؤدي الذكاء الاصطناعي العام إلى "إضعاف البشرية أو حتى انقراضها". صرح يان ليك، الذي كان مسؤولاً عن الفريق، لاحقاً: "لقد كانت بالفعل استراتيجية فعالة للغاية للاحتفاظ بالموظفين".

ومع ذلك، لم يتم الوفاء بوعد "20% من الحوسبة". أفاد أربعة أفراد مشاركين في الفريق أو يتابعونه عن كثب أن الموارد المخصصة الفعلية لم تمثل سوى 1% إلى 2% من إجمالي قدرة الحوسبة للشركة. بالإضافة إلى ذلك، أشار أحد الباحثين إلى أن "معظم ما يسمى بحسابات المحاذاة الفائقة يعمل في الواقع على أقدم مجموعة حاسوبية وأسوأها أداءً". كان أعضاء الفريق يعتقدون عموماً أن الأولوية في المشاريع المدرة للدخل تُعطى للأجهزة الأكثر تطوراً. (نفت شركة OpenAI هذا الأمر.) أثارت ليك هذه القضية مع رئيسة قسم التكنولوجيا آنذاك ميرا موراتي، لكن الرد كان أنه لا داعي للمضي قدماً - كان هذا الالتزام "غير واقعي" منذ البداية.

في ذلك الوقت تقريبًا، أخبرنا موظف سابق أن إيليا سوتسكيفر "بدأ في التركيز بشدة على السلامة". في الأيام الأولى لـ OpenAI، وبينما كان يعتقد أن المخاطر الكارثية مصدر قلق معقول، إلا أنها كانت لا تزال بعيدة إلى حد ما؛ ومع ذلك، عندما بدأ يعتقد تدريجياً أن الذكاء الاصطناعي العام يقترب، تصاعد هذا القلق بسرعة. بحسب ما يتذكره الموظف، خلال اجتماع عام، "وقف إيليا وقال إنه ستكون هناك نقطة في السنوات القليلة المقبلة حيث سيتعين على كل فرد تقريبًا في الشركة التحول إلى القيام بأعمال السلامة، وإلا فإننا سننتهي". إلا أنه في العام التالي، تم حل "فريق التوافق الفائق" هذا قبل إتمام مهمته.

في هذه المرحلة، تشير الاتصالات الداخلية إلى أن المديرين التنفيذيين وأعضاء مجلس الإدارة بدأوا يعتقدون أن إخفاء سام ألتمان وسلوكه المضلل قد يكون له تأثير مادي على سلامة منتجات OpenAI. خلال اجتماع عُقد في ديسمبر 2022، أكد ألتمان للمجلس أن لجنة السلامة قد وافقت على الميزات المتعددة لجهاز GPT-4 القادم. طلبت هيلين تونر، عضو مجلس الإدارة وخبيرة سياسات الذكاء الاصطناعي، الاطلاع على الوثائق ذات الصلة، لكنها اكتشفت أن الميزتين الأكثر إثارة للجدل - إحداهما تسمح للمستخدمين "بضبط" النموذج والأخرى تمكن من نشره كمساعد شخصي - لم تتم الموافقة عليهما في الواقع. بعد الاجتماع، تم استدعاء عضوة مجلس إدارة أخرى، وهي سيدة الأعمال تاشا مكولي، جانباً من قبل أحد الموظفين ليسألها عما إذا كانت على علم بـ "حادثة الامتثال في الهند": لم يذكر ألتمان في تحديثات مجلس الإدارة المتعددة أن مايكروسوفت أطلقت نسخة مبكرة من ChatGPT في الهند دون استكمال مراجعات السلامة اللازمة. "لقد تم التستر على هذا الأمر بشكل شبه كامل"، هكذا قال جاكوب هيلتون، الباحث في شركة OpenAI آنذاك.

على الرغم من أن هذه المشكلات لم تؤد مباشرة إلى حادثة تتعلق بالسلامة، إلا أن الباحث كارول واينرايت يعتقد أنها تعكس "انزلاقًا مستمرًا نحو اتجاه يركز على المنتج أولاً، مع إيلاء اهتمام أقل للأمان". بعد إصدار GPT-4، كتب يان ليك، المسؤول عن أعمال الأمن، إلى مجلس الإدارة: "إن شركة OpenAI تنحرف عن مهمتها." نعطي الأولوية للمنتج والإيرادات أولاً، ثم القدرات والبحث والتوسع، ويأتي التوافق والسلامة في المرتبة الثالثة. وأشار أيضاً إلى أن "شركات مثل جوجل تتعلم الدروس - حيث تسرع عملية النشر مع إهمال المخاوف الأمنية".

وكتب ماكولي في رسالة بريد إلكتروني إلى أعضاء مجلس الإدارة: "أعتقد أننا بالفعل في مرحلة تتطلب زيادة الرقابة". لكن عندما حاول المجلس معالجة هذه المشكلة، كان من الواضح أنهم في وضع غير مواتٍ. "بصراحة، إنها مجموعة من الأشخاص يفتقرون إلى الخبرة العملية"، هكذا قالت سو يون، العضوة السابقة في مجلس الإدارة. في عام 2023، كانت الشركة تستعد لإطلاق GPT-4 Turbo. وفقًا لوصف سوتسكيفر في مذكرة، أخبر ألتمان ميرا موراتي أن النموذج لا يتطلب موافقة أمنية، ونسب هذا القرار إلى المستشار العام للشركة، جيسون كوون. لكن عندما سأل موراتي كوون على تطبيق سلاك، أجاب قائلاً: "همم..." لست متأكدًا تمامًا لماذا قد يعتقد سام ذلك. (ذكرت OpenAI أن هذا الحادث "غير مهم".)

بعد ذلك بوقت قصير، قرر مجلس الإدارة فصل ألتمان، ثم شهد العالم كيف تراجع عن هذا القرار بسرعة. لا يزال ميثاق OpenAI متاحًا على الموقع الرسمي، لكن أولئك المطلعين على وثائق حوكمة الشركة يقولون إن محتوياته قد تم تخفيفها إلى حد يكاد يكون بلا معنى. في يونيو من العام الماضي، كتب ألتمان في منشور على مدونته الشخصية عن الذكاء الخارق: "لقد تجاوزنا أفق الحدث؛ لقد بدأ الإقلاع."

وفقًا للميثاق الأصلي، كان من المفترض أن تكون هذه نقطة تحول للشركة للتوقف عن المنافسة والتحول إلى التعاون. ومع ذلك، في المقال الذي يحمل عنوان "التفرد اللطيف"، تبنى نبرة جديدة تمامًا، واستبدل "الخوف الوجودي" بـ "الخيال المتفائل": "سنحصل جميعاً على أشياء أفضل، وسنخلق أشياء أفضل بشكل متزايد لبعضنا البعض." وأقر بأن مشاكل التوافق لا تزال قائمة دون حل، لكنه أعاد تعريفها على أنها "إزعاج"، على غرار الإدمان على خوارزمية التوصيات في إنستغرام.

كثيراً ما يُشار إلى ألتمان بإعجاب أو شك باعتباره "أقوى روائي قصصي في جيله". كان يُعتقد أن ستيف جوبز الذي كان معجباً به يمتلك "مجالاً لتشويه الواقع"، حيث كان يشكل العالم وفقاً لرؤيته بثقة مطلقة. لكن حتى ستيف جوبز لم يخبر المستخدمين قط: إذا لم يشتروا منتجه، فقد تهلك البشرية. في عام 2008، عندما كان عمره 23 عامًا فقط، وصفه معلمه بول غراهام على النحو التالي: "ألقِ به على جزيرة يسكنها آكلو لحوم البشر، وعد بعد خمس سنوات، وسيكون هو الملك." لم يستند هذا التقييم إلى إنجازاته في ذلك الوقت، بل إلى قوة إرادته التي لا تكاد تُقيد.

لكن بالنسبة لبعض أولئك الذين عملوا معه عن كثب، فإن لهذه السمة جانباً آخر. مع ازدياد قلق سوتسكيفر بشأن سلامة الذكاء الاصطناعي، قام بتجميع سلسلة من المذكرات حول ألتمان وجريج بروكمان - وهي مجموعة من الوثائق ذات أهمية كبيرة في وادي السيليكون لدرجة أنها يشار إليها باسم "مذكرات إيليا".

وفي الوقت نفسه، واصل داريو أمودي التوثيق. لم تقدم هذه المواد ما يسمى "بدليل قاطع" ولكنها صورت سلسلة من أنماط السلوك المتناثرة ظاهريًا ولكنها تتراكم: مثل عرض نفس المنصب على أشخاص مختلفين، وتقديم روايات متضاربة عن المعلومات العامة، والغموض بشأن العمليات الأمنية. وخلص سوتسكيفر إلى أن هذا السلوك "لا يخلق بيئة مواتية للذكاء الاصطناعي العام الآمن"؛ وكان أمودي أكثر صراحة، حيث كتب: "المشكلة مع OpenAI هي سام نفسه".

أجرينا مقابلات مع أكثر من مائة شخص مطلعين على نهج ألتمان: موظفين ومديرين حاليين وسابقين في OpenAI، وزملائه ومنافسيه، وأصدقاءه وخصومه - في وادي السيليكون، غالباً ما يرتدي الكثيرون أدواراً متعددة. دافع البعض عن فطنته التجارية، معتقدين أن سوتسكيفر وأمودي كانا مجرد منافسين فاشلين؛ بينما رأى آخرون أنه عالم ساذج وغائب الذهن، أو حتى متطرف عالق في "نظرية نهاية العالم". كان يون يعتقد أن ألتمان لم يكن "شريراً مكيافيلياً" بل شخصاً مقتنعاً بروايته الخاصة، "إنه منغمس جداً في معتقداته الذاتية لدرجة أنه يتخذ قرارات غير مفهومة في العالم الحقيقي - لكنه لا يعيش في العالم الحقيقي أصلاً".

ومع ذلك، فإن حكم معظم من أجريت معهم المقابلات مشابه لحكم سوتسكيفر وأمودي: يتمتع ألتمان بإرادة قوية للغاية، مما يجعله متميزاً حتى بين عمالقة الصناعة الذين نُقشت أسماؤهم على الصواريخ. قال أحد أعضاء مجلس الإدارة: "إنه غير مقيد بـ'الواقع'، فهو يمتلك صفتين نادراً ما تجتمعان معاً: الأولى هي رغبة قوية في أن يكون محبوباً، وأن يرضي الطرف الآخر في كل تفاعل؛ والأخرى تكاد تكون معادية للمجتمع، حيث يفتقر إلى الاهتمام بعواقب خداع الآخرين".

استخدم أكثر من شخص من الذين أجريت معهم المقابلات مصطلح "الشخصية المعادية للمجتمع" بشكل عفوي. كان ألتمان، وهو زميل في الدفعة الأولى من برنامج Y Combinator، زميلاً للمبرمج آرون شوارتز، الذي انتحر لاحقاً في عام 2013. قبل وفاته، أعرب شوارتز عن مخاوفه لأحد أصدقائه بشأن ألتمان: "يجب أن تفهم، لا يمكن الوثوق بسام أبداً." إنه شخصية معادية للمجتمع؛ إنه قادر على فعل أي شيء. كما صرح العديد من المديرين التنفيذيين في مايكروسوفت بأنه على الرغم من دعم ساتيا ناديلا الطويل الأمد لألتمان، إلا أن العلاقة بين الاثنين أصبحت متوترة. قال أحد المسؤولين التنفيذيين: "سيقوم بالتضليل، والتشويه، وإعادة التفاوض، أو حتى إلغاء الاتفاقيات". في وقت سابق من هذا العام، أكدت OpenAI مجدداً على أن مايكروسوفت هي المزود الحصري لخدمات الحوسبة السحابية لنموذجها "غير المعتمد على الحالة"، ولكن في نفس اليوم، أعلنت عن شراكة بقيمة 500 مليار دولار مع أمازون، مما جعل الأخيرة البائع الحصري لمنصة الذكاء الاصطناعي الخاصة بها للمؤسسات. على الرغم من أن هذا الترتيب لم ينتهك العقد، إلا أن مايكروسوفت اعتقدت أن هناك تضاربًا محتملاً. (أعلنت شركة OpenAI أنها لن تخالف العقد.) بل إن المسؤول التنفيذي علق قائلاً: "أعتقد أن هناك احتمالاً كبيراً بأن يُنظر إليه في المستقبل على أنه شخص مشابه لبيرني مادوف أو سام بانكمان-فريد".

لا يعتبر ألتمان عبقرياً تقنياً - ففي نظر العديد من زملائه، فإن قدراته المهنية في البرمجة أو التعلم الآلي محدودة، وقد يخلط بين المفاهيم الأساسية. لقد بنى OpenAI إلى حد كبير من خلال دمج أموال وموارد تقنية من أشخاص آخرين. هذا ليس بالأمر غير المألوف - فهذا هو دور رائد الأعمال. الأمر الأكثر جدارة بالملاحظة هو قدرته على إقناع المهندسين والمستثمرين والجمهور ذوي الآراء المتضاربة، وإقناعهم بأن أولوياته هي أولوياتهم أيضاً. عندما يحاول هؤلاء الأشخاص إيقافه، فإنه غالباً ما يكون قادراً على تهدئة الموقف بخطاب مناسب - على الأقل مؤقتاً؛ وبحلول الوقت الذي يدرك فيه الطرف الآخر المشكلة، يكون قد حقق هدفه بالفعل. قال وينرايت: "سيصمم بعض الهياكل لتقييد نفسه المستقبلية على الورق، ولكن عندما يأتي المستقبل بالفعل ويحتاج إلى التقييد، فسيفكك هذه الهياكل واحدة تلو الأخرى".

قال أحد المديرين التنفيذيين في مجال التكنولوجيا ممن عملوا معه: "إن قدرته على الإقناع قوية بشكل لا يصدق، أشبه بخدعة ذهنية من خدع الجيداي، إنه مستوى آخر تماماً". في أبحاث مواءمة الذكاء الاصطناعي، هناك مفهوم كلاسيكي: إرادة البشرية في مواجهة ذكاء اصطناعي قوي، حيث ينتصر الأخير بشكل شبه حتمي، مثل بطل شطرنج كبير ضد طفل. وفي رأي ذلك المسؤول التنفيذي، فإن مشاهدة ألتمان وهو يتنقل بين مختلف الأطراف خلال حدث "Blip" كانت بمثابة مشاهدة "ذكاء اصطناعي عام يتحرر من قفصه".

في الأيام التي تلت فصله، كان سام ألتمان يحاول منع أي تحقيق في الادعاءات الموجهة ضده. لقد أعرب لشخصين عن قلقه من أن مجرد وجود تحقيق سيجعله يبدو مذنباً. (ينفي ألتمان الإدلاء بهذا التصريح.) ومع ذلك، وبعد أن أصر أعضاء مجلس الإدارة المستقيلون على ضرورة إجراء "تحقيق مستقل" كشرط لرحيله، وافق ألتمان في النهاية على "مراجعة" "للأحداث الأخيرة". وبحسب مصادر مطلعة على المفاوضات، أصر عضوا مجلس الإدارة الجديدان على قيادة هذه المراجعة بأنفسهما.

يبدو أن لورانس سامرز، مستغلاً علاقاته في السياسة وفي وول ستريت، قد أضفى بعض المصداقية على هذه المراجعة. (في نوفمبر الماضي، استقال سامرز من مجلس الإدارة بعد أن تم الكشف علنًا عن أنه طلب المشورة من جيفري إبستين عبر البريد الإلكتروني أثناء سعيه وراء أحد المتدربين الشباب.) في نهاية المطاف، استعانت شركة OpenAI بشركة المحاماة البارزة WilmerHale لإجراء هذه المراجعة. سبق للشركة أن قادت تحقيقات داخلية في شركتي إنرون وورلدكوم.

أشار ستة أفراد مقربون من عملية التحقيق إلى أن المراجعة بدت مصممة للحد من الشفافية. وقال البعض إن المحققين لم يتواصلوا في البداية مع بعض الأفراد الرئيسيين داخل الشركة. وصل الأمر بأحد الموظفين إلى حد الاتصال بسامرز وبريت تايلور للتعبير عن مخاوفه. "لقد كانوا مهتمين فقط بتلك الفترة القصيرة التي حدثت فيها الدراما في مجلس الإدارة، وليس بمشاكل النزاهة القديمة لسام"، هكذا تذكر الموظف شعوره خلال مقابلته مع المحققين. كما تردد البعض في مشاركة مخاوفهم بشأن ألتمان بسبب ما اعتبروه نقصاً في حماية الهوية. وقال الموظف: "تشير كل الدلائل إلى أنهم يبحثون عن نتيجة محددة مسبقاً - تبرئته". (ومع ذلك، دافع بعض المحامين المشاركين في العملية عن المراجعة، واصفين إياها بأنها "مستقلة وشاملة ودقيقة ومستندة إلى الحقائق". وذكر تايلور أيضاً أن المراجعة كانت "شاملة ومستقلة".

غالباً ما يساهم دور التحقيق الداخلي للشركات في إضفاء الشرعية على القرار. في الشركات المملوكة للقطاع الخاص، لا تؤدي نتائج التحقيقات أحيانًا إلى تقرير مكتوب، مما يوفر وسيلة للتخفيف من المسؤولية القانونية. ومع ذلك، في الحالات التي تنطوي على جدل عام، عادة ما يكون هناك توقع بدرجة أعلى من الشفافية. في عام 2017، وقبل خروج ترافيس كالانيك من شركة أوبر، قام مجلس الإدارة بتعيين شركة خارجية ونشر ملخصًا من 13 صفحة للتحقيق للجمهور. وبالنظر إلى وضع OpenAI كمنظمة غير ربحية بموجب المادة 501(c)(3) والطبيعة العلنية للغاية لهذا الإنهاء، توقع العديد من المديرين التنفيذيين داخل الشركة في البداية تقرير تحقيق مفصل. ومع ذلك، بحلول مارس 2024، أعلنت OpenAI فقط عن "تبرئة" ألتمان دون إصدار أي تقارير رسمية، معترفة بـ "انهيار الثقة" في حوالي 800 كلمة على موقعها الإلكتروني.

حتى الزملاء السابقون يشعرون بالآثار اللاحقة. غادرت ميرا موراتي شركة OpenAI في عام 2024 لتأسيس شركتها الناشئة الخاصة في مجال الذكاء الاصطناعي. بعد ذلك، اتصل بها جوش كوشنر، الحليف المقرب لألتمان. بدأ بالإشادة بقيادتها، لكنه أطلق بعد ذلك تهديداً مبطناً، معرباً عن "قلقه" بشأن "سمعتها"، ومشيراً إلى أن بعض الزملاء السابقين يرونها الآن "عدواً". (قال كوشنر، من خلال متحدث باسمه، إن هذه الرواية "لم تقدم السياق الكامل"؛ من ناحية أخرى، ادعى ألتمان أنه لم يكن على علم بالمكالمة).

في بداية فترة توليه منصب الرئيس التنفيذي، أعلن ألتمان أن شركة OpenAI ستنشئ شركة "ذات ربح محدود" مملوكة للكيان غير الربحي. يبدو أن هذا الهيكل المعقد والملتوي للشركة كان من ابتكار ألتمان نفسه. خلال فترة الانتقال، أعرب مدير يدعى هولدن كارنوفسكي عن معارضته، معتقداً أن هذا الترتيب يقلل بشكل كبير من قيمة المنظمة غير الربحية. قال كارنوفسكي: "لا يمكنني بضمير مرتاح أن أوافق على هذا". وبحسب السجلات في ذلك الوقت، فقد أدلى بصوت معارض. ومع ذلك، بعد أن أشار محامي المجلس إلى أن معارضته "قد تكون بمثابة علامة تحذير لمزيد من التحقيق في شرعية الهيكل الجديد"، تم تسجيل تصويته في النهاية على أنه امتناع عن التصويت ويبدو أنه بدون موافقته - مما قد يشكل تزويرًا للسجلات التجارية. (أخبرتنا شركة OpenAI أن العديد من الموظفين يتذكرون امتناع كارنوفسكي عن التصويت وقدموا محاضر الاجتماعات كدليل.)

في أكتوبر من العام الماضي، خضعت شركة OpenAI لعملية "إعادة هيكلة رأس المال"، لتصبح كيانًا ربحيًا. أعلنت الشركة علنًا أن مؤسستها غير الربحية التابعة لها - والتي تُسمى الآن مؤسسة OpenAI - ستصبح واحدة من أغنى المؤسسات في التاريخ. ومع ذلك، فإن المؤسسة لا تملك الآن سوى 26% من أسهم الشركة، وجميع أعضاء مجلس إدارتها باستثناء واحد يعملون أيضاً في مجلس إدارة الشركة الربحية.

خلال جلسة استماع في الكونغرس، سُئل ألتمان عما إذا كان قد "حقق الكثير من المال". فأجاب قائلاً: "ليس لدي أي ملكية في شركة OpenAI..." أفعل هذا لأني أحبه. وبالنظر إلى حصته غير المباشرة من خلال الصناديق المرتبطة بـ Y Combinator، كانت هذه الإجابة حذرة للغاية. من الناحية الفنية، هذا صحيح. لكن العديد من الأفراد، بمن فيهم ألتمان، أشاروا إلينا إلى أن هذا الوضع من المرجح أن يتغير قريباً. قال ألتمان: "سيقول المستثمرون: 'أحتاج إلى معرفة أنه عندما تصبح الأمور صعبة، ستظلون تفعلون ذلك'"، على الرغم من أنه أضاف أنه لا توجد حاليًا "مناقشات نشطة" حول هذا الموضوع. وبحسب شهادة قانونية، تبلغ قيمة حصة جريج بروكمان حوالي 20 مليار دولار، ومن المفترض نظرياً أن تكون حصة ألتمان أعلى من ذلك. ومع ذلك، أخبرنا ألتمان أن الثروة ليست دافعه الأساسي. تذكر أحد الموظفين السابقين قوله: "أنا لا أهتم بالمال". أنا أهتم بالسلطة أكثر.

في عام 2023، أقام ألتمان وأوليفر مولهيرين حفل زفاف صغير في منزلهما في هاواي. (كان الاثنان قد التقيا قبل تسع سنوات في منزل بيتر ثيل بجوار حوض الاستحمام الساخن في وقت متأخر من الليل.) لقد استضافوا العديد من الضيوف في ذلك العقار، ولم تتجاوز المشاهد التي وصفها الزوار الذين أجرينا معهم مقابلات النطاق المعتاد لنمط حياة الأثرياء: عشاء أعده طاهٍ خاص، ورحلات بحرية عند غروب الشمس. كان هناك حفل رأس السنة الجديدة مستوحى من برنامج الواقع "Survivor "؛ وأظهرت الصور مجموعة من الرجال عاريي الصدور مبتسمين، بمن فيهم مقدم البرنامج، جيف بروبست. كما استضاف ألتمان تجمعات صغيرة في ممتلكاته الأخرى، وكان من بين هذه التجمعات حدث واحد على الأقل تضمن لعبة البوكر الاستعراضية الحماسية. (لم تتضمن الصورة المسربة ألتمان، لذلك من غير المعروف من فاز في النهاية، ولكن يبدو أن ثلاثة رجال على الأقل قد خسروا بشكل واضح.) لم يذكر العديد من الضيوف السابقين الذين تمت مقابلتهم سوى شيء واحد: لقد كان مضيفًا كريمًا بالفعل.

قال المشاركون في التحقيق إنه لم يتم إصدار أي تقرير على الإطلاق لأنه لم يكن هناك تقرير مكتوب رسمي. لم يتم إطلاع سامرز وتايلور على ما يسمى بنتائج التحقيق إلا شفهياً. وقال مصدر مقرب من التحقيق: "لم يخلص التقرير إلى أن 'سام صادق مثل جورج واشنطن وهو يقطع شجرة الكرز'". لكن بشكل عام، بدا أن التحقيق لم يركز حقًا على "قضية النزاهة" وراء فصل ألتمان، حيث تم إنفاق جزء كبير من الجهد بدلاً من ذلك على تحديد ما إذا كانت هناك جرائم جنائية واضحة؛ وبناءً على هذا المعيار، خلص التحقيق في النهاية إلى أنه يمكنه الاستمرار في منصبه كرئيس تنفيذي. بعد ذلك بوقت قصير، استعاد ألتمان مقعده في مجلس الإدارة الذي فقده عند إقالته. وكشفت مصادر مطلعة أن جزءًا من سبب عدم توثيق نتائج التحقيق كتابيًا يعود أيضًا إلى نصيحة من المحامي الخاص لكل من سامرز وتايلور. (امتنع سامرز عن التعليق علنًا على هذا الأمر؛ وذكر تايلور أنه نظرًا لوجود إحاطة شفهية، "لم تكن هناك حاجة لتقرير مكتوب رسمي".)

أخبرنا العديد من موظفي OpenAI الحاليين والسابقين أنهم شعروا بالصدمة بسبب عدم الإفصاح العلني. صرح ألتمان بأنه يعتقد أن جميع أعضاء مجلس الإدارة الذين انضموا بعد عودته إلى منصبه قد تم إطلاعهم شفهياً على هذه الأمور. قال أحد الأشخاص المطلعين على الوضع: "هذه كذبة صريحة". وأخبرنا بعض المديرين أيضاً أن التساؤلات المستمرة حول نزاهة "نتائج التحقيق" هذه قد تستدعي "إعادة التحقيق" في المستقبل.

بدون سجلات مكتوبة، يسهل التقليل من شأن هذه الادعاءات. وفي الوقت نفسه، أدى استمرار صعود ألتمان في مكانة وادي السيليكون إلى إضعاف التدقيق الخارجي لهذه القضايا. أخبرنا العديد من المستثمرين البارزين الذين عملوا معه عن عادة معروفة لدى ألتمان: إذا راهن مستثمر على منافس لشركة OpenAI، فقد يقوم لاحقًا "بإدراجه في القائمة السوداء". قال أحدهم: "إذا استثمروا في مشروع لا يعجب سام، فلا تتوقع أن تكون جزءًا من أي فرص أخرى لاحقًا". كان مصدر آخر لقوة ألتمان هو شبكة استثماراته الواسعة، والتي امتدت في بعض الأحيان إلى حياته الشخصية. كانت تربطه علاقات مالية بالعديد من الشركاء السابقين: بعضها تضمن إدارة مشتركة للصناديق، والبعض الآخر قاد فيه الاستثمارات، وبعضها كان عبارة عن استثمارات مشتركة متكررة. هذه الممارسة ليست غريبة في وادي السيليكون. يعمل العديد من المديرين التنفيذيين من ذوي الميول الجنسية المغايرة بهذه الطريقة أيضاً. (قال لنا رئيس تنفيذي معروف: "عليك أن تفعل ذلك"). صرح ألتمان نفسه قائلاً: "من الواضح أنني استثمرت مع بعض حبيباتي السابقات بعد انفصالنا، وأعتقد أن هذا أمر جيد تماماً". لكن هذا الترتيب بحد ذاته يخلق مستوى عالياً جداً من التبعية. "هذا يخلق بشكل أساسي اعتمادًا قويًا للغاية،" قال شخص مقرب من ألتمان، "في كثير من الأحيان، بل اعتمادًا مدى الحياة."

ومع ذلك، فقد تم استغلال العديد من الشائعات المحيطة بحياة سام ألتمان الشخصية، بل وتشويهها من قبل المنافسين. المنافسة الشرسة في مجال الأعمال ليست بالأمر الجديد، لكن المنافسة داخل صناعة الذكاء الاصطناعي أصبحت وحشية بشكل استثنائي. وصفها أحد المسؤولين التنفيذيين في OpenAI بأنها "شكسبيرية"، وأضاف: "يبدو أن القواعد المعتادة للعبة لم تعد سارية". قام بعض الوسطاء المرتبطين مباشرة بإيلون ماسك، بل وحتى الذين تلقوا تمويله في بعض الحالات، بنشر عشرات الصفحات من "البحوث المعارضة" حول ألتمان. تُظهر هذه المواد مستوى عالٍ من المراقبة: بما في ذلك الشركات الوهمية المرتبطة به، ومعلومات الاتصال الحميمة، وحتى سجلات المقابلات مع ما يسمى بعاملة الجنس في حانة للمثليين. كما زعم أحد الوسطاء أن جداول رحلات ألتمان والحفلات التي حضرها كانت تخضع للمراقبة. قال لنا ألتمان: "أشعر أنه لم يتم توظيف أي شخص للتحقيق في أمري أكثر مما تم توظيفي أنا".

وفي الوقت نفسه، تنتشر أيضاً اتهامات متطرفة مختلفة. ألمح الإعلامي اليميني تاكر كارلسون، دون أي دليل، إلى أن ألتمان كان متورطاً في وفاة أحد المبلغين عن المخالفات، وهو ادعاء قام المنافسون بتضخيمه باستمرار. صرحت آني، شقيقة ألتمان، في دعوى قضائية وأثناء مقابلة معنا بأنه اعتدى عليها جنسياً منذ أن كانت في الثالثة من عمرها وكان هو في الثانية عشرة. (لم نتمكن من التحقق من ادعاءات آني). ينفي ألتمان ذلك، كما صرحت والدته وشقيقه بأن هذه الاتهامات "غير صحيحة على الإطلاق" وأنها سببت "ألماً هائلاً" للعائلة بأكملها. في مقابلة أجرتها الصحفية كارين هاو لكتابها "إمبراطورية الذكاء الاصطناعي"، ذكرت آني أن هذه الذكريات استُرجعت في "استرجاعات" في مرحلة البلوغ.

بالإضافة إلى ذلك، ألمح لنا العديد من الأفراد من الشركات المنافسة وشركات الاستثمار إلى أن ألتمان كان متورطًا في أنشطة جنسية مع قاصرين - وهو ادعاء متداول على نطاق واسع في وادي السيليكون ويبدو أنه لا أساس له من الصحة بنفس القدر. لقد أمضينا شهوراً في التحقيق، وأجرينا عشرات المقابلات، ولم نجد أي دليل يدعم هذا الادعاء. رد ألتمان قائلاً: "هذا تكتيك مقزز أعتقد أنه محاولة من المنافسين لتسميم هيئة المحلفين في القضايا المستقبلية". رغم أن الأمر يبدو سخيفاً، إلا أنني ما زلت أرغب في التأكيد على أن أي ادعاءات حول إقامتي علاقات جنسية مع قاصرين، أو استئجار عاملات جنس، أو تورطي في جريمة قتل، هي ادعاءات لا أساس لها من الصحة على الإطلاق. وأضاف أيضًا أنه "ممتن إلى حد ما" لأننا قضينا "شهورًا عديدة في التحقيق في هذه الأمور بهذا العمق".

سام ألتمان يعترف بأنه كان على علاقة بشباب بالغين. أجرينا مقابلات مع بعض شركائه، الذين قالوا جميعاً إنهم لا يرون أي مشكلة في ذلك. ومع ذلك، فإن "أبحاث المعارضة" التي أجراها معسكر إيلون ماسك قد صاغت هذا الأمر عمداً كنقطة هجوم. (تضمنت هذه المواد حتى بعض الادعاءات المثيرة وغير المؤكدة، مثل ما يسمى بـ "جيش التوينك" و"انحراف الأب السكري"). رد ألتمان قائلاً: "هناك الكثير من رهاب المثلية المضخم مختلط هنا". وتتفق الصحفية المتخصصة في التكنولوجيا، كارا سويشر، مع هذا الرأي أيضاً: "لقد قام كل هؤلاء الأثرياء بأنواع مختلفة من الأشياء الشائنة، بل وأكثر شائنة من أي شيء سمعته عن سام." لكن لأنه رجل مثلي الجنس في سان فرانسيسكو، يتم استخدام ذلك كسلاح.

على مدى العقد الماضي، وعد المسؤولون التنفيذيون في شركات التواصل الاجتماعي بأنهم قادرون على "تغيير العالم" دون أي آثار جانبية تقريبًا، رافضين المطالب التنظيمية باعتبارها "مناهضة للتكنولوجيا"، مما أثار في النهاية غضبًا من الحزبين. وعلى النقيض من ذلك، بدت صورة ألتمان "واعية بذاتها" بشكل خاص. لم يكتفِ بعدم التهرب من التنظيم، بل دعا إليه بنشاط. في عام 2023، وأثناء إدلائه بشهادته أمام اللجنة القضائية بمجلس الشيوخ الأمريكي، اقترح إنشاء وكالة اتحادية جديدة لتنظيم نماذج الذكاء الاصطناعي المتقدمة. وقال: "إذا ساءت هذه التقنية، ستكون العواقب وخيمة للغاية". حتى أن السيناتور جون كينيدي من ولاية لويزيانا، المعروف بتصريحاته الحادة تجاه الرؤساء التنفيذيين لشركات التكنولوجيا، بدا موافقاً إلى حد ما، حيث اقترح مازحاً أن يكون ألتمان مسؤولاً عن التنظيم بنفسه.

ومع ذلك، فبينما كان ألتمان يتبنى التنظيم علنًا، كان يمارس الضغط سرًا ضده. بحسب مجلة تايم ، بين عامي 2022 و2023، نجحت شركة OpenAI في إضعاف اقتراح تنظيمي للاتحاد الأوروبي يستهدف شركات الذكاء الاصطناعي الكبيرة. في عام 2024، قدم المجلس التشريعي لولاية كاليفورنيا مشروع قانون يشترط إجراء اختبارات أمنية لنماذج الذكاء الاصطناعي، والتي كان العديد منها يعكس بشكل وثيق دعوة ألتمان في الكونجرس. عارضت شركة OpenAI مشروع القانون علنًا ومارست ضغوطًا من وراء الكواليس. "خلال ذلك العام، رأينا سلوك OpenAI يصبح أكثر دهاءً وتضليلاً"، هكذا أخبرنا أحد المساعدين التشريعيين.

في غضون ذلك، واصل ماسك هجماته العلنية على ألتمان، واصفًا إياه بـ"ألتمان المحتال" و"سام المخادع". (عندما اشتكى ألتمان من مشكلة في سيارة تسلا على متن طائرة إكس، رد ماسك قائلًا: "لقد سرقت من مؤسسة غير ربحية"). ولكن في واشنطن، بدا أن ألتمان هو صاحب اليد العليا. سبق أن تبرع ماسك بأكثر من 250 مليون دولار لمساعدة دونالد ترامب على إعادة انتخابه، وشغل منصباً لفترة وجيزة في البيت الأبيض قبل أن يغادر، مما أدى إلى توتر علاقته مع ترامب.

أصبح ألتمان اليوم أحد أقطاب التكنولوجيا المفضلين لدى ترامب، حتى أنه زار قلعة وندسور في المملكة المتحدة برفقته. يتحدث الاثنان عدة مرات في السنة. قال ألتمان: "يمكنك ببساطة الاتصال به مباشرة". "ليست من هذا النوع من الصداقة، ولكن إذا احتجت للتحدث معه بشأن شيء ما، فسأتصل به." عندما استضاف ترامب قادة التكنولوجيا في البيت الأبيض العام الماضي، كان ماسك غائباً، وجلس ألتمان مقابل الرئيس. قال له ترامب: "سام، أنت شخص مهم". "لقد أخبرتني بأشياء لا تُصدق من قبل."

كما قام المستثمر رون كونواي بالضغط على شخصيات سياسية من بينهم نانسي بيلوسي وغافين نيوسوم للدفع برفض مشروع القانون المذكور آنفاً. في نهاية المطاف، ورغم أن مشروع القانون حظي بدعم الحزبين وتم إقراره، إلا أن نيوسوم استخدم حق النقض ضده. هذا العام، واجه بعض المرشحين للكونغرس الذين يدعمون تنظيم الذكاء الاصطناعي معارضين ممولين من قبل "قيادة المستقبل"، وهي لجنة عمل سياسي فائقة مؤيدة للذكاء الاصطناعي. أعلنت شركة OpenAI رسمياً أنها لن تتبرع لمثل هذه المنظمات، لكن مؤسسها المشارك جريج بروكمان تعهد بتقديم 50 مليون دولار. (في نفس العام، تبرع هو وزوجته أيضاً بمبلغ 25 مليون دولار للجنة العمل السياسي الداعمة لترامب.)

تتجاوز أنشطة OpenAI نطاق الضغط التقليدي. في العام الماضي، عندما اقترح مجلس الشيوخ في كاليفورنيا نسخة منقحة من مشروع قانون، تلقى ناثان كالفين، وهو محامٍ في منظمة معنية بالمصلحة العامة شارك في صياغة مشروع القانون، استدعاءً من شركة OpenAI أثناء تناول العشاء في المنزل. زعمت الشركة أنها تحقق فيما إذا كان ماسك يمول المنتقدين سراً، لكنها طلبت جميع اتصالات كالفن الخاصة المتعلقة بمشروع القانون. وقال: "كان بإمكانهم ببساطة أن يسألونا مباشرة عما إذا كنا قد تلقينا أموالاً من ماسك - لم نتلق أي أموال على الإطلاق". كما تلقى مؤيدون آخرون للمشروع، بالإضافة إلى أولئك الذين ينتقدون عملية التحول التجاري لشركة OpenAI، مذكرات استدعاء مماثلة. قال دون هوارد، رئيس منظمة المصلحة العامة: "إنهم يحاولون ترهيب هؤلاء الناس لإسكاتهم". (أوضحت شركة OpenAI أن هذا جزء من الإجراءات القانونية العادية.)

أما فيما يتعلق بالموقف السياسي، فقد دعم ألتمان الحزب الديمقراطي لفترة طويلة. وقد صرح قائلاً: "أنا حذر للغاية من هؤلاء الحكام المستبدين الذين يستخدمون خطاب الخوف لقمع الضعفاء - وهذا نابع من خلفيتي اليهودية أكثر من ميولي الجنسية". في عام 2016، دعم هيلاري كلينتون، واصفاً ترامب بأنه "تهديد غير مسبوق لأمريكا"؛ وفي عام 2020، تبرع للحزب الديمقراطي وصندوق حملة بايدن الانتخابية. خلال فترة ولاية جو بايدن، زار البيت الأبيض عدة مرات لإجراء مناقشات حول السياسات وساعد في الدفع نحو أول إطار تنظيمي لأمن الذكاء الاصطناعي على المستوى الفيدرالي.

لكن بحلول عام 2024، ومع انخفاض معدلات تأييد بايدن، بدأ موقف ألتمان في التغير: "بغض النظر عن نتيجة الانتخابات، ستكون أمريكا بخير." بعد فوز ترامب، تبرع بمليون دولار لصندوق تنصيبه والتقط صورة مع مشاهير الإنترنت جيك ولوجان بول في حفل التنصيب. وكتب في تعليقه على X: "لقد كنت أراقب الرئيس الأمريكي عن كثب مؤخراً، وقد غيّر ذلك حقاً نظرتي إليه (أتمنى لو كنت قد فكرت بشكل مستقل أكثر في وقت سابق...)." في أول يوم له في منصبه، ألغى ترامب الأوامر التنفيذية المتعلقة بالذكاء الاصطناعي الصادرة في عهد بايدن. وعلق مسؤول حكومي رفيع سابق قائلاً: "لقد وجد طريقة فعالة لجعل إدارة ترامب تعمل لصالحه".

على مر السنين، شبّه ألتمان دائماً تطوير الذكاء الاصطناعي العام بمشروع "مانهاتن". وكما قام ج. روبرت أوبنهايمر ذات مرة بتعبئة العلماء بشعور من المهمة "ضد النازيين"، فإن ألتمان يستغل أيضًا سردية التنافس الجيوسياسي لحشد الدعم. في مواجهة جماهير مختلفة، يستخدم هذا التشبيه بمرونة - فيؤكد أحياناً على التسارع، وأحياناً أخرى على الحذر. في صيف عام 2017، وخلال اجتماع مع مسؤولي الاستخبارات الأمريكية، زعم أن الصين أطلقت "مشروع مانهاتن للذكاء الاصطناعي العام" واستخدمت ذلك للحصول على دعم التمويل الحكومي. عندما طُلب منه تقديم دليل، قال فقط: "لقد سمعت بعض الأشياء"، لكنه لم يقدم دليلاً محدداً. صرح مسؤول حكومي مشارك في التحقيق لاحقاً بأنه لم يتم العثور على أي مشاريع من هذا القبيل: "يبدو هذا أشبه بعرض ترويجي." (ادعى ألتمان أنه لا يتذكر صياغته بهذه الطريقة.)

وعندما واجه جمهوراً أكثر تركيزاً على الأمن، أكد بدوره على أهمية التنسيق الدولي. في عام 2017، قام أمودي بتعيين المحامية بيج هيدلي، المتخصصة في قضايا المصلحة العامة، للعمل كمستشارة في مجال السياسات والأخلاقيات. في عرض تقديمي داخلي، اقترح هيدلي إمكانية إنشاء آلية تنسيق دولية شبيهة بحلف الناتو لتجنب سباق تسلح كارثي في مجال الذكاء الاصطناعي. لكن، وفقًا لما تذكرته، لم يكن بروكمان قلقًا بشأن هذا الأمر: "مهما قلت، كان يعود دائماً إلى سؤال واحد: كيف نحصل على المزيد من التمويل؟" كيف نفوز؟ استناداً إلى مقابلات وسجلات متعددة، طرح بروكمان فكرة أخرى: الاستفادة من حرب المزايدة بين الولايات المتحدة والصين وروسيا - "بما أن عصر الأسلحة النووية يمكن أن يعمل بهذه الطريقة، فلماذا لا يعمل الذكاء الاصطناعي؟"

لقد صُدم في ذلك الوقت: "لم ينكروا هذه الفرضية حتى - 'نحن نناقش ما قد يكون أكثر التقنيات تدميراً على الإطلاق، ماذا لو بعناها لفلاديمير بوتين؟'" (ومع ذلك، صرح جريج بروكمان بأنه لم يفكر بجدية في "بيع" نماذج الذكاء الاصطناعي للحكومات). وقال متحدث باسم OpenAI: "كنا نناقش فقط بعض أطر التعاون المحتملة على مستوى كلي، مثل آلية تعاون الذكاء الاصطناعي المشابهة لمحطة الفضاء الدولية". "إن تصوير هذا على أنه شيء آخر أمر سخيف تماماً."

غالباً ما تولد جلسات العصف الذهني بعض الأفكار الغريبة في البداية. كانت بيج هيدلي تأمل في البداية أن يتم التخلي سريعاً عن المفهوم الذي يشار إليه داخلياً باسم "خطة الدول". ومع ذلك، ووفقًا لعدد من المشاركين والسجلات ذات الصلة في ذلك الوقت، أصبح المسؤولون التنفيذيون في OpenAI متحمسين بشكل متزايد لهذه الفكرة. وقال رئيس قسم السياسات آنذاك، جاك كلارك، إن هدف بروكمان كان "خلق وضع يشبه معضلة السجين، حيث يتعين على جميع الدول تمويلنا"، و"في إطار هذا الهيكل، يصبح عدم تمويلنا بحد ذاته عملاً خطيراً". يتذكر باحث مبتدئ أنه عندما سمع وصفًا تفصيليًا لهذه الخطة في اجتماع للشركة، فكر قائلاً: "هذا جنون بكل بساطة".

بل إن المسؤولين التنفيذيين ناقشوا هذه الخطة مع ممول محتمل واحد على الأقل. إلا أنه في وقت لاحق من ذلك الشهر، وبعد أن أعرب العديد من الموظفين عن نيتهم الاستقالة، تم إيقاف الخطة. قال هيدلي: "سيخسر سام أعضاءً من فريقه". "شعرت أنه في حساباته، كان ذلك دائمًا أكثر أهمية من "هذه الخطة يمكن أن تؤدي إلى صراع كبير بين القوى، لذا فهي غير معقولة بطبيعتها".

على الرغم من فشل "خطة الدول"، لم يتخل سام ألتمان عن نسخة معدلة من هذه الفكرة. في يناير 2018، عقد اجتماعاً بعنوان "الذكاء الاصطناعي العام" فعالية "عطلة نهاية الأسبوع" في فندق بيل إير في لوس أنجلوس. يشتهر هذا المنتجع المصمم على طراز هوليوود بحديقته الوردية من زهور الجهنمية وحوض السباحة الذي يحتوي على بجعات حقيقية. وشمل الحضور الفيلسوف الأكسفورد و"نبي" مخاطر الذكاء الاصطناعي نيك بوستروم، والمدافع عن الذكاء الاصطناعي في الإمارات العربية المتحدة عمر العلماء، وسبعة مليارديرات على الأقل. بالنسبة لأولئك الذين يشعرون بالقلق إزاء القضايا الأمنية، فقد تم وصف هذا الحدث بأنه فرصة لمناقشة "كيفية الاستعداد لوصول الذكاء الاصطناعي العام"؛ بينما توقع المستثمرون سماع عروض التمويل.

أقيمت فعاليات النهار في قاعة مؤتمرات حديثة، حيث تناوب الحضور على إلقاء الكلمات. (حتى أن ريد هوفمان تحدث عن كيفية ترميز "التعاطف البوذي" في الذكاء الاصطناعي.) وكان المتحدث الأخير هو ألتمان، الذي قدم خطة تمويل: إصدار عملة مشفرة عالمية يمكنها "تبادل انتباه الذكاء الاصطناعي العام". في رؤيته، بمجرد أن يصل الذكاء الاصطناعي العام إلى ذروة التطبيق العملي و"إزالة الشر"، سيتنافس المستخدمون العالميون لشراء وقت استخدام خوادم OpenAI. كتب داريو أمودي في ملاحظاته: "تبدو هذه الفكرة سخيفة ظاهرياً (هل سيحمل فلاديمير بوتين هذه الرموز أيضاً؟...)". بالنظر إلى الماضي، كانت هذه إحدى العلامات التحذيرية العديدة التي كان ينبغي عليّ أخذها على محمل الجد. بدت هذه الخطة أشبه بتكتيك لجمع التبرعات، لكن ألتمان قام بتغليفها كجزء من سلامة الذكاء الاصطناعي. وجاء في إحدى شرائحه: "أريد أن يقف أكبر عدد ممكن من الناس على الجانب الصحيح وأن يفوزوا في النهاية". وجاء في شريحة أخرى: "يرجى تأجيل الضحك إلى نهاية العرض التقديمي".

لقد تطورت رواية تمويل ألتمان على مر السنين، لكنها لطالما تمحورت حول حقيقة أساسية: تطوير الذكاء الاصطناعي العام يتطلب رأس مال ضخم. وهو يتبع "قانون المقياس" البسيط نسبياً - فكلما زادت البيانات وقوة الحوسبة المستخدمة لتدريب النموذج، أصبح النموذج أكثر ذكاءً. تُعد الرقائق المتخصصة التي تدعم هذه العملية باهظة الثمن للغاية. في أحدث جولة تمويل فقط، جمعت OpenAI أكثر من 120 مليار دولار - وهي أكبر عملية جمع تبرعات خاصة في التاريخ، أي أربعة أضعاف أكبر اكتتاب عام أولي. قال أحد المستثمرين في مجال التكنولوجيا: "عندما نتحدث عن الكيانات التي يمكنها التصرف بحرية في عشرات المليارات من الدولارات كل عام، فإن هناك عددًا قليلاً فقط على مستوى العالم". "الحكومة الأمريكية، وعدد قليل من أكبر شركات التكنولوجيا، والمملكة العربية السعودية والإمارات العربية المتحدة، هذا كل شيء."

سام ألتمان، لا يزال متغيراً خطراً لم يُحسم بعد

التنقيب في الخليج: مقامرة جيوسياسية

وضع ألتمان نصب عينيه في البداية المملكة العربية السعودية. التقى لأول مرة بولي العهد والحاكم الفعلي، محمد بن سلمان، في حفل عشاء في فندق فيرمونت في سان فرانسيسكو عام 2016. وفي وقت لاحق، ووفقًا لما يتذكره هيدلي، كان ألتمان يشير إليه غالبًا على أنه "صديق". في سبتمبر 2018، وفقًا لملاحظات هيدلي، ذكر ألتمان: "أنا أفكر فيما إذا كنت سأحصل على مئات المليارات من الدولارات من صندوق الثروة السيادية السعودي (PIF)".

لكن بعد شهر، اتخذ الوضع منعطفاً حاداً. قُتل الصحفي جمال خاشقجي، الذي انتقد الحكومة السعودية، وقُطّع جسده في تركيا، وسط اعتقاد واسع النطاق بأن ولي العهد هو من أمر بهذا العمل. وبعد أسبوع، تم الإعلان عن انضمام ألتمان إلى المجلس الاستشاري لمشروع "مدينة المستقبل" السعودي نيوم. "سام، لا يمكنك الانضمام إلى هذا المجلس الاستشاري"، هكذا تذكر جاك كلارك، المسؤول عن السياسات آنذاك، نصيحته له في ذلك الوقت. في البداية، دافع ألتمان عن قراره، مصرحاً بأن جاريد كوشنر قد أكد له أن المملكة العربية السعودية "لم تفعل ذلك" (ادعى ألتمان أنه لا يتذكر هذا، وقال كوشنر أيضاً إن الجانبين لم يكونا على اتصال في ذلك الوقت). ومع ازدياد وضوح مسؤولية ولي العهد، انسحب ألتمان في نهاية المطاف من المجلس الاستشاري لنيوم.

ومع ذلك، في جلسة خاصة، تذكر مستشار كان قد قدم المشورة السياسية لألتمان أنه رأى الأمر على أنه "انتكاسة مؤقتة" واستمر في استكشاف ما إذا كان لا يزال من الممكن الحصول على تمويل من المملكة العربية السعودية. لم يكن السؤال أبدًا "هل هذا صحيح أم خطأ؟" بل "ما هي العواقب إذا فعلنا هذا؟" هل سيؤدي ذلك إلى فرض ضوابط على الصادرات؟ هل سنتعرض للعقوبات؟ هل يمكنني إيجاد حل بديل لهم؟

وفي الوقت نفسه، وجه ألتمان انتباهه أيضاً إلى مصدر تمويل آخر: الإمارات العربية المتحدة. تخوض البلاد حالياً خطة تحول مدتها خمسة عشر عاماً، تسعى من خلالها إلى الانتقال من اقتصاد قائم على النفط إلى مركز تكنولوجي. يقود هذا المشروع شقيق الرئيس ورئيس المخابرات الوطنية طحنون بن زايد آل نهيان. وهو يشرف على مجموعة الذكاء الاصطناعي في البلاد، G42، بالإضافة إلى حوالي 1.5 تريليون دولار من الثروة السيادية. في يونيو 2023، زار ألتمان أبو ظبي، والتقى بمسؤولين، من بينهم أولاما، وصرح في حدث مدعوم من الحكومة بأن الإمارات العربية المتحدة "بدأت في وضع الأسس للذكاء الاصطناعي قبل أن يصبح رائجًا" ورسم رؤية مستقبلية: سيلعب الشرق الأوسط "دورًا محوريًا" في النظام البيئي العالمي للذكاء الاصطناعي.

أصبح التمويل من دول الخليج عملية روتينية للشركات الكبرى. لكن سام ألتمان كان يسعى لتحقيق رؤية جيوسياسية أوسع. في خريف عام 2023، بدأ بهدوء في استقطاب المواهب والتخطيط لمشروع عُرف فيما بعد باسم "ChipCo": ممول من دول الخليج بمئات المليارات من الدولارات لبناء مصانع رقائق ومراكز بيانات واسعة النطاق على مستوى العالم، مع وجود جزء منها في الشرق الأوسط. وقد اقترح على الرئيس الحالي لشركة ميتا إيه آي، ألكسندر وانغ، الانضمام إلى فريق القيادة، واقترح أن يتولى جيف بيزوس قيادة المشروع. سعى ألتمان إلى الحصول على استثمارات كبيرة من الإمارات العربية المتحدة. قال أحد المديرين: "على حد علمي، تم المضي قدماً في هذا الأمر برمته دون علم مجلس الإدارة". يتذكر الباحث جيمس برادبري، الذي دعاه ألتمان للمشاركة في المشروع، أنه اختار الرفض: "كانت فكرتي الأولية هي أنه من المحتمل جداً أن ينجح الأمر، لكنني لست متأكداً مما إذا كنت أريد ذلك."

قد تحل قوة الحوسبة للذكاء الاصطناعي قريباً محل النفط أو اليورانيوم المخصب كمورد أساسي يشكل ديناميكيات القوة العالمية. قال ألتمان إن قوة الحوسبة هي "عملة المستقبل". من الناحية النظرية، يبدو موقع مراكز البيانات غير ذي صلة، لكن العديد من مسؤولي الأمن القومي الأمريكي قلقون بشأن تركيز البنية التحتية المتقدمة للذكاء الاصطناعي في دول الخليج ذات الأنظمة الاستبدادية. تعتمد البنية التحتية للاتصالات في الإمارات العربية المتحدة بشكل كبير على شركة هواوي (وهي شركة تقنية مرتبطة ارتباطاً وثيقاً بالحكومة الصينية)، وقد اتُهمت الدولة في الماضي بتسريب التكنولوجيا الأمريكية إلى بكين. تخشى وكالات الاستخبارات من إمكانية استغلال المهندسين الصينيين للرقائق المتطورة التي تم تصديرها إلى الإمارات العربية المتحدة. بالإضافة إلى ذلك، فإن مراكز البيانات في الشرق الأوسط أكثر عرضة للاستهداف في الصراعات الجيوسياسية - فقد شنت إيران مؤخراً هجمات على مراكز بيانات مرتبطة بالولايات المتحدة في البحرين والإمارات العربية المتحدة. وفي سيناريو أكثر تطرفاً، قد تتمكن ملكية خليجية من السيطرة على مراكز بيانات الشركات الأمريكية واستخدامها لتدريب نماذج قوية بشكل غير متناسب - وهذا يكاد يكون نسخة واقعية من "ديكتاتورية الذكاء الاصطناعي العام".

خلال الفترة الحاسمة التي أعقبت إقالته، كان برايان تشيسكي أحد أكثر الأشخاص الذين اعتمد عليهم ألتمان. المؤسس المشارك لشركة Airbnb، وهو أيضاً أحد أشد مؤيديه. قال تشيسكي لنا: "إن مشاهدة صديقي وهو يواجه الهاوية جعلتني أبدأ في إعادة التفكير في معنى "إدارة شركة فعلياً". وفي العام التالي، ألقى خطاباً مرتجلاً لمدة ساعتين في تجمع لخريجي برنامج Y Combinator، "يبدو الأمر وكأنه جلسة علاج جماعي". كانت الفكرة الأساسية بسيطة: حدس المؤسس بشأن شركته هو الأكثر موثوقية، وأي شخص ينكر ذلك فهو "يحاول التلاعب بك". قال تشيسكي: "أنت لست مجنوناً، حتى لو كان موظفوك يقولون لك إنك مجنون". أطلق بول غراهام على هذا الموقف اسم "وضع المؤسس" في منشور على مدونته. منذ حدث "Blip"، من الواضح أن ألتمان كان في هذا الوضع.

في فبراير 2024، كشفت صحيفة وول ستريت جورنال لأول مرة عن خطة شركة تشيبكو. تصور ألتمان الأمر ككيان مشترك بحجم يصل إلى 5 إلى 7 تريليونات دولار (حتى أنه مازح على وسائل التواصل الاجتماعي قائلاً: "دعونا نجعلها 8 تريليونات دولار"). سمع العديد من الموظفين عن هذه الخطة لأول مرة من خلال وسائل الإعلام. كان رد فعل الجميع: لحظة، ماذا؟ تم استدعاء يان ليك. في اجتماع داخلي، أصر ألتمان على أن فريق الأمن "قد تم إشراكه في المناقشة"، وقامت ليك لاحقًا بإرسال رسالة إليه تطلب منه عدم الإيحاء بأن الخطة قد حصلت على موافقة أمنية.

خلال فترة ولاية جو بايدن، حاول ألتمان التقدم بطلب للحصول على تصريح أمني للمشاركة في مناقشات سياسة الذكاء الاصطناعي السرية. ومع ذلك، أعرب موظفو مؤسسة راند الذين ساعدوا في العملية عن مخاوفهم: كتب أحد الموظفين: "إنه يجمع عشرات المليارات من الدولارات من الحكومات الأجنبية، حتى أن الإمارات العربية المتحدة منحته سيارة مؤخراً (أعتقد أنها باهظة الثمن للغاية)." وأشار الشخص أيضاً إلى ما يلي: "الشخص الوحيد الذي يمكنني التفكير فيه والذي تقدم بطلب للحصول على تصريح أمني في ظل هذه العلاقات المالية الخارجية الواسعة النطاق هو جاريد كوشنر، وقد نصحت السلطة المختصة في ذلك الوقت بعدم منحه." انسحب ألتمان في نهاية المطاف من عملية التقديم. وقال مسؤول حكومي رفيع المستوى مشارك في المناقشات: "إن علاقته القائمة على المصالح المتبادلة مع الإمارات العربية المتحدة جعلت الكثير من الناس حذرين، والعديد من داخل الحكومة لا يثقون به تماماً".

وعندما سُئل عما إذا كان قد تلقى هدايا من طحنون بن زايد آل نهيان، أجاب ألتمان: "لن أحدد بالضبط ما قدمه، لكنه وغيره من القادة الوطنيين... قدموا لي هدايا بالفعل". وأضاف أن الشركة لديها سياسة واضحة تتطلب الإفصاح عن جميع الهدايا من الشركاء المحتملين. يمتلك ألتمان سيارتين خارقتين على الأقل: سيارة كوينجسيج ريجيرا بيضاء تبلغ قيمتها حوالي 2 مليون دولار وسيارة ماكلارين إف 1 حمراء تبلغ قيمتها حوالي 20 مليون دولار. في عام 2024، شوهد وهو يقود سيارة ريجيرا في وادي نابا، وانتشر مقطع فيديو قصير على وسائل التواصل الاجتماعي يظهر فيه جالساً في مقعد منخفض، يميل للخارج من هيكل السيارة الأبيض. أعاد أحد المستثمرين المقربين من موقف ماسك نشر الفيديو وعلق قائلاً: "أريد أن أبدأ منظمة غير ربحية أيضاً".

وفي نفس العام، اصطحب ألتمان أيضاً اثنين من موظفي شركة OpenAI على متن اليخت الفاخر "ماريا" التابع لطحنون والذي تبلغ قيمته 250 مليون دولار. تم تجهيز اليخت الفاخر ذو المستوى العالمي بمهبط للطائرات المروحية، ونادي ليلي، وسينما، ونادي شاطئي. وبحسب ما ورد، شعر موظفو ألتمان بأنهم في غير مكانهم في البيئة المحاطة بأفراد الأمن المسلحين، حيث أخبر أحدهم زميلاً له لاحقاً أن التجربة جعلته يشعر بعدم الارتياح. أشار ألتمان لاحقاً إلى طحنون على أنه "صديق شخصي مقرب" في برنامج X.

هبوط ستارغيت: تحول سياسي من بايدن إلى ترامب

يواصل سام ألتمان التواصل مع إدارة جو بايدن. سبق للإدارة أن طبقت سياسة تتطلب موافقة البيت الأبيض لتصدير التكنولوجيا الحساسة. أعرب العديد من المسؤولين الحكوميين عن قلقهم بعد هذه الاجتماعات مع ألتمان في الشرق الأوسط. وكما وصفوه، كان ألتمان غالباً ما يقدم أفكاراً عظيمة، مثل مساواة الذكاء الاصطناعي بـ "الكهرباء الجديدة".

في وقت مبكر من عام 2018، ذكر أن OpenAI تخطط لشراء جهاز كمبيوتر كمي "قابل للاستخدام بالكامل" من Rigetti Computing - وهو تصريح أثار دهشة حتى المديرين التنفيذيين الآخرين في OpenAI الحاضرين، حيث كانت Rigetti بعيدة كل البعد عن تحقيق هذا الهدف في ذلك الوقت. وفي اجتماع آخر، زعم أيضاً أنه بحلول عام 2026، ستنشئ الولايات المتحدة شبكة واسعة تتكون من مفاعلات الاندماج النووي لتوفير دعم الطاقة لتطوير الذكاء الاصطناعي. وتذكر مسؤول حكومي رفيع المستوى قائلاً: "كان رد فعلنا في ذلك الوقت هو أنه إذا تم تحقيق الاندماج النووي بالفعل، فسيكون ذلك خبراً كبيراً بالفعل". وفي النهاية، رفضت إدارة بايدن الموافقة على الخطط ذات الصلة. وقال مسؤول في وزارة التجارة لألتمان: "لن نقوم ببناء رقائق متطورة في الإمارات العربية المتحدة".

لكن الوضع سرعان ما تغير. قبل أربعة أيام فقط من تنصيب دونالد ترامب، ذكرت صحيفة وول ستريت جورنال أن طحنون بن زايد آل نهيان دفع 500 مليون دولار لعائلة ترامب مقابل حصة في شركته للعملات المشفرة. وفي اليوم التالي، تحدث ألتمان مع ترامب لمدة 25 دقيقة، وناقشا إطلاق مشروع مماثل لشركة ChipCo والتخطيط لأن "ينسب ترامب الفضل لنفسه" عند الإعلان عنه علنًا. في اليوم الثاني من رئاسة ترامب، ظهر ألتمان في غرفة روزفلت بالبيت الأبيض، معلناً إطلاق مشروع ستارغيت - وهو مشروع مشترك بقيمة 500 مليار دولار يهدف إلى بناء شبكة بنية تحتية واسعة للذكاء الاصطناعي داخل الولايات المتحدة.

وفي مايو من العام نفسه، رفعت الحكومة القيود المفروضة على صادرات تكنولوجيا الذكاء الاصطناعي التي كانت سارية خلال عهد بايدن. سافر ألتمان مع ترامب للقاء العائلة المالكة السعودية ومحمد بن سلمان. في الوقت نفسه تقريباً، أعلنت المملكة العربية السعودية عن إطلاق شركة عملاقة في مجال الذكاء الاصطناعي مدعومة من الدولة، وتخطط لاستثمار مليارات الدولارات في التعاون الدولي. وبعد حوالي أسبوع، كشف ألتمان عن خطط لتوسيع مسلسل ستارغيت إلى الإمارات العربية المتحدة. تخطط الشركة لبناء مجمع لمراكز البيانات في أبو ظبي، والذي سيكون حجمه سبعة أضعاف حجم سنترال بارك في نيويورك، وسيستهلك مستويات طاقة تعادل تقريبًا مدينة ميامي بأكملها.

وصف مسؤول تنفيذي سابق في شركة OpenAI العملية على النحو التالي: "بصراحة، نحن نبني نوعًا من بوابة "استدعاء الكائنات الفضائية". وأوضح قائلاً: "توجد هذه "البوابات" حاليًا في الولايات المتحدة والصين، وقد أضاف سام واحدة في الشرق الأوسط." وأضاف قائلاً: "يكمن السر في إدراك مدى رعب هذا الأمر - فهذه واحدة من أكثر الخطوات تهوراً حتى الآن."

التحول العسكري: تستحوذ OpenAI على طلبية البنتاغون

أصبح تآكل الالتزامات الأمنية تدريجياً هو القاعدة السائدة في جميع أنحاء الصناعة. كان المبدأ الأساسي لتأسيس شركة أنثروبيك هو الحفاظ على الحدود الأمنية في ظل الضغوط التجارية من خلال الهياكل والقيادة المناسبة. كانت إحدى الآليات الرئيسية هي "سياسة التوسع المسؤول": إذا لم يكن من الممكن إثبات أن النموذج الأقوى آمن، كان على الشركة التوقف عن التدريب. إلا أنه في فبراير من هذا العام، ومع حصول الشركة على تمويل بقيمة 30 مليار دولار، تم إضعاف هذا الالتزام. من بعض النواحي، لا تزال شركة أنثروبيك تركز على الأمن أكثر من شركة أوبن إيه آي، لكن رئيس قسم السياسات السابق فيها، جاك كلارك، صرح بصراحة: "منطق أسواق رأس المال هو - العمل بشكل أسرع." وأضاف: "في نهاية المطاف، صانعو القرار ليسوا الشركة، بل العالم بأسره." في العام الماضي، كشف داريو أمودي للموظفين في مذكرة داخلية أن الشركة ستسعى للحصول على استثمارات من الإمارات العربية المتحدة وقطر، معترفاً بأن هذا من المرجح أن يفيد "الديكتاتوريين".

وفي الوقت نفسه، دأبت شركة أنثروبيك على تعديل موقفها في الواقع بشكل مستمر. في عام 2024، دخلت الشركة في شراكة مع شركة بالانتير، إحدى أكثر شركات المقاولات الدفاعية صرامة في وادي السيليكون، لنشر نموذجها كلود في النظام العسكري، لتصبح بذلك المقاول الوحيد في مجال الذكاء الاصطناعي في مشروع البنتاغون شديد السرية. وفي العام الماضي، أضافت وزارة الدفاع الأمريكية عقداً إضافياً بقيمة 200 مليون دولار إليه. في يناير من هذا العام، نفذ الجيش الأمريكي عملية منتصف الليل للقبض على الرئيس الفنزويلي نيكولاس مادورو - وبحسب ما ورد تم استخدام كلود في جزء سري من تلك العملية، وفقًا لصحيفة وول ستريت جورنال.

لكن سرعان ما ظهرت التوترات. في السنوات السابقة، قامت OpenAI بإزالة الحظر الشامل على "الاستخدام العسكري" في سياستها؛ وفي وقت لاحق، وافق المنافسون بما في ذلك Google و xAI أيضًا على تقديم نماذج للجيش "لأي استخدام قانوني". من جهة أخرى، حافظت منظمة أنثروبيك على موقفها الرافض لدعم الأسلحة ذاتية التشغيل بالكامل أو المراقبة الجماعية المحلية، مما أدى إلى تعثر المفاوضات مع الحكومة. في أحد أيام الثلاثاء في نهاية شهر فبراير، استدعى وزير الدفاع الأمريكي بيت هيجسيث أمودي إلى البنتاغون وأصدر إنذارًا نهائيًا: يجب رفع هذه القيود بحلول الساعة 5:01 مساءً يوم الجمعة. رفض أمودي في نهاية المطاف. ثم أعلن هيغسيث على وسائل التواصل الاجتماعي أن شركة أنثروبيك تم تصنيفها كشركة "تمثل مخاطر سلسلة التوريد" - وهو تصنيف عادة ما يتم تخصيصه للشركات المرتبطة بخصوم أجانب مثل هواوي - وقام بتنفيذه بسرعة.