La IA ha provocado a la vez una escasez y un exceso de memoria

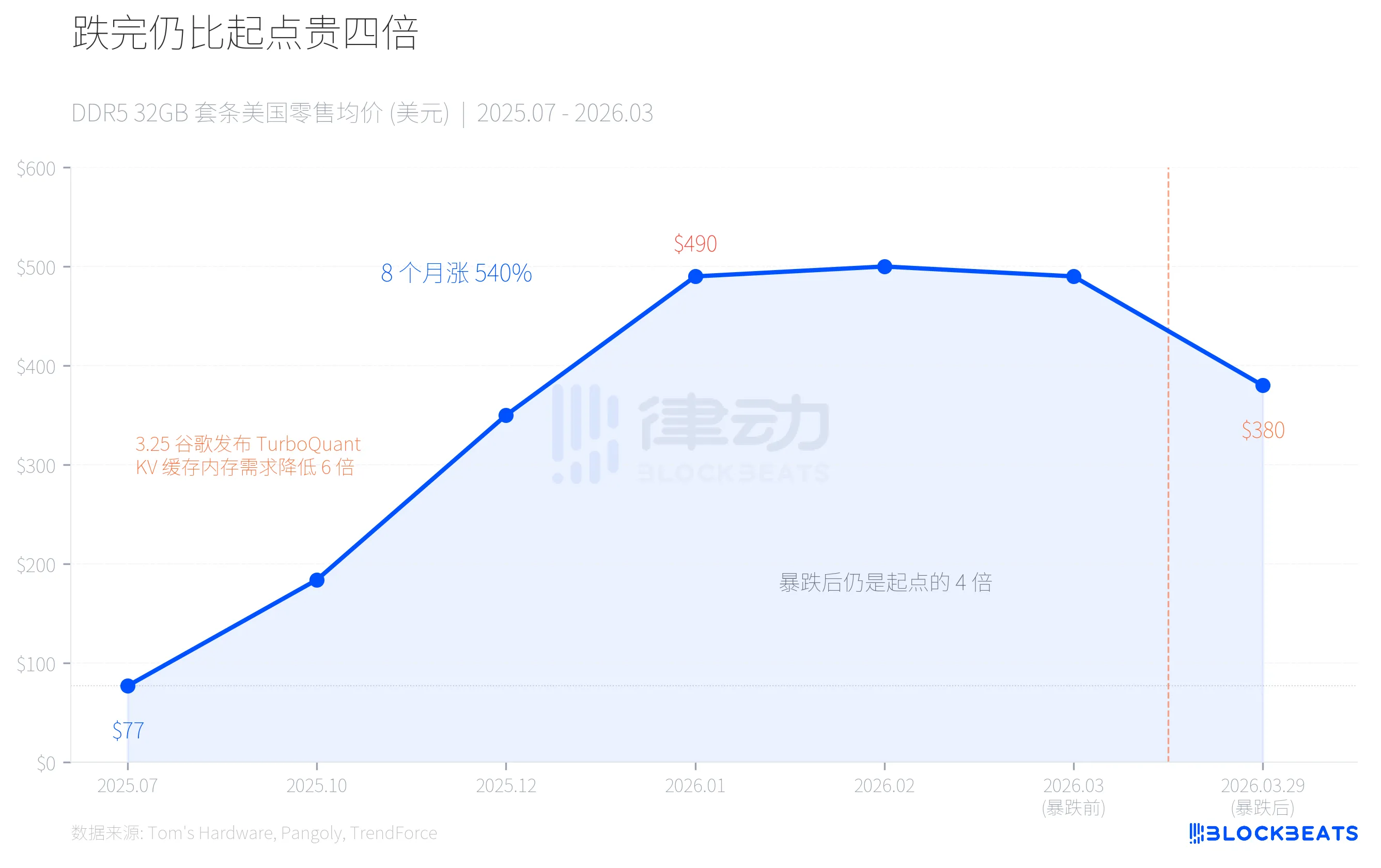

El 29 de marzo, tanto en Huaqiangbei como en el mercado minorista estadounidense se produjo simultáneamente una caída vertiginosa de los precios de la memoria. El kit Corsair de 32 GB DDR5-6400 se desplomó de 490 a 380 dólares, lo que supone una caída del 22 % en un solo día. En el mercado nacional, el precio de un kit de memoria DDR5 de alta velocidad de 32 GB bajó 800 yuanes en una semana, lo que provocó ventas masivas entre los distribuidores, y algunos llegaron a afirmar que «bajó más de 100 yuanes en un solo día».

Sin embargo, si se sitúa esta cifra en una perspectiva temporal más amplia, el panorama es completamente diferente: incluso tras la caída, el precio actual de la DDR5 sigue siendo cuatro veces superior al de julio de 2025. Se trató de un desequilibrio concreto entre la oferta y la demanda en la cadena de valor de la IA, donde esa misma fuerza provocó primero una escasez y luego un pánico ante el exceso de oferta.

Montaña rusa: Un aumento del 540 % en ocho meses, una caída del 22 % en un mes

En julio de 2025, un kit estándar de 32 GB de DDR5-6000 en el mercado minorista estadounidense costaba solo 77 dólares. En enero de 2026, el precio del mismo kit se disparó hasta los 490 dólares. Un aumento del 540 % en ocho meses.

El aumento de los precios no se debió a que los consumidores se hubieran vuelto de repente locos por renovar sus ordenadores. Según datos de TrendForce, en el primer trimestre de 2026, los precios de contrato de la DRAM subieron entre un 90 % y un 95 % con respecto al trimestre anterior, y los precios de la DRAM para ordenadores personales aumentaron más del 100 %, lo que supone el mayor incremento trimestral registrado hasta la fecha. Todo ello se debió a la enorme demanda de un tipo concreto de memoria por parte de la infraestructura de IA.

Posteriormente, el 25 de marzo, Google lanzó un algoritmo de compresión denominado TurboQuant. Cuatro días después, los precios de la memoria se desplomaron.

¿Dónde se ha ido la capacidad? HBM se ha comido tu memoria USB

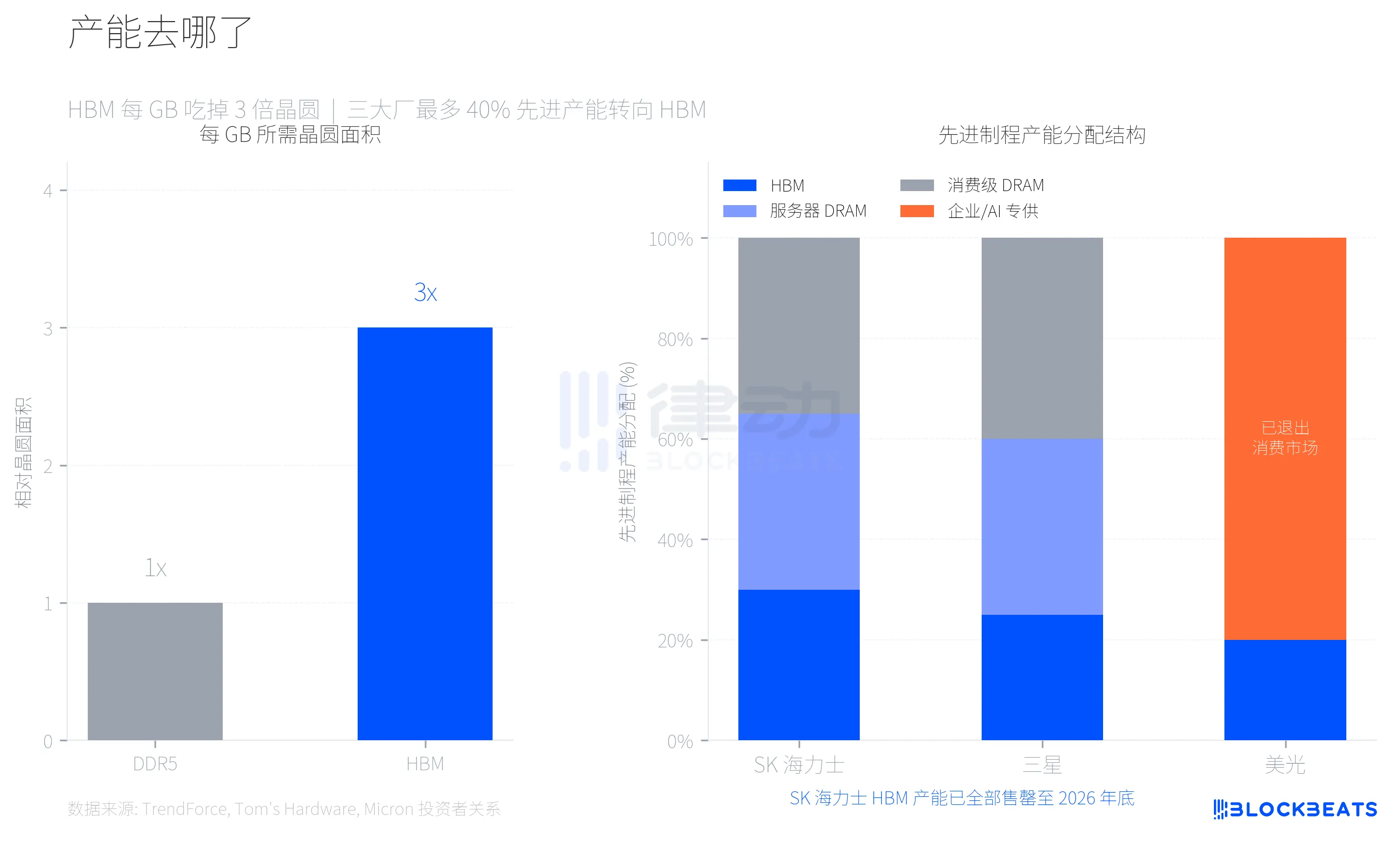

Para comprender este repunte de los precios, primero hay que entender un parámetro técnico clave. La HBM (High Bandwidth Memory, memoria dedicada para los chips de IA de NVIDIA) consume tres veces más superficie de oblea por GB que la DDR5 convencional. Según Tom's Hardware, esto significa que, a partir de la misma oblea, la producción de HBM solo ofrece un tercio de la capacidad de la DDR5.

Samsung, SK Hynix y Micron, los tres principales fabricantes de memorias, tomaron una decisión acertada ante los elevados márgenes de beneficio de la HBM, y destinaron hasta un 40 % de su capacidad de fabricación de obleas con procesos avanzados a la producción de HBM. Según los datos de TrendForce, se prevé que, en el primer trimestre de 2026, el margen de beneficio de la DDR5 supere por primera vez al de la HBM3e, lo que pone de manifiesto hasta qué punto se ha reducido la oferta de memoria para el mercado de consumo.

La decisión de Micron es la más radical. En diciembre de 2025, la empresa anunció el cierre de su marca de consumo Crucial, con 29 años de historia, abandonando por completo el mercado de memorias y almacenamiento para consumidores y centrándose exclusivamente en los clientes empresariales y de inteligencia artificial. Según el comunicado de Relaciones con los Inversores de Micron, sus ingresos totales para el ejercicio fiscal 2025 ascendieron a 37 380 millones de dólares, y las aplicaciones para centros de datos e inteligencia artificial representaron el 56 % de los ingresos totales. No vale la pena dedicarse al mercado de consumo.

La capacidad de producción de HBM de SK Hynix está completamente agotada hasta finales de 2026. Samsung tiene previsto aumentar su capacidad mensual de HBM de 170 000 obleas a 250 000 obleas para finales de 2026. No se prevé que las nuevas fábricas de obleas (Samsung P4L y SK Hynix M15X) comiencen la producción en masa hasta, como muy pronto, 2027-2028. En otras palabras, el desequilibrio entre la oferta y la demanda de DRAM para consumidores es de carácter estructural y no puede subsanarse en tan solo uno o dos trimestres.

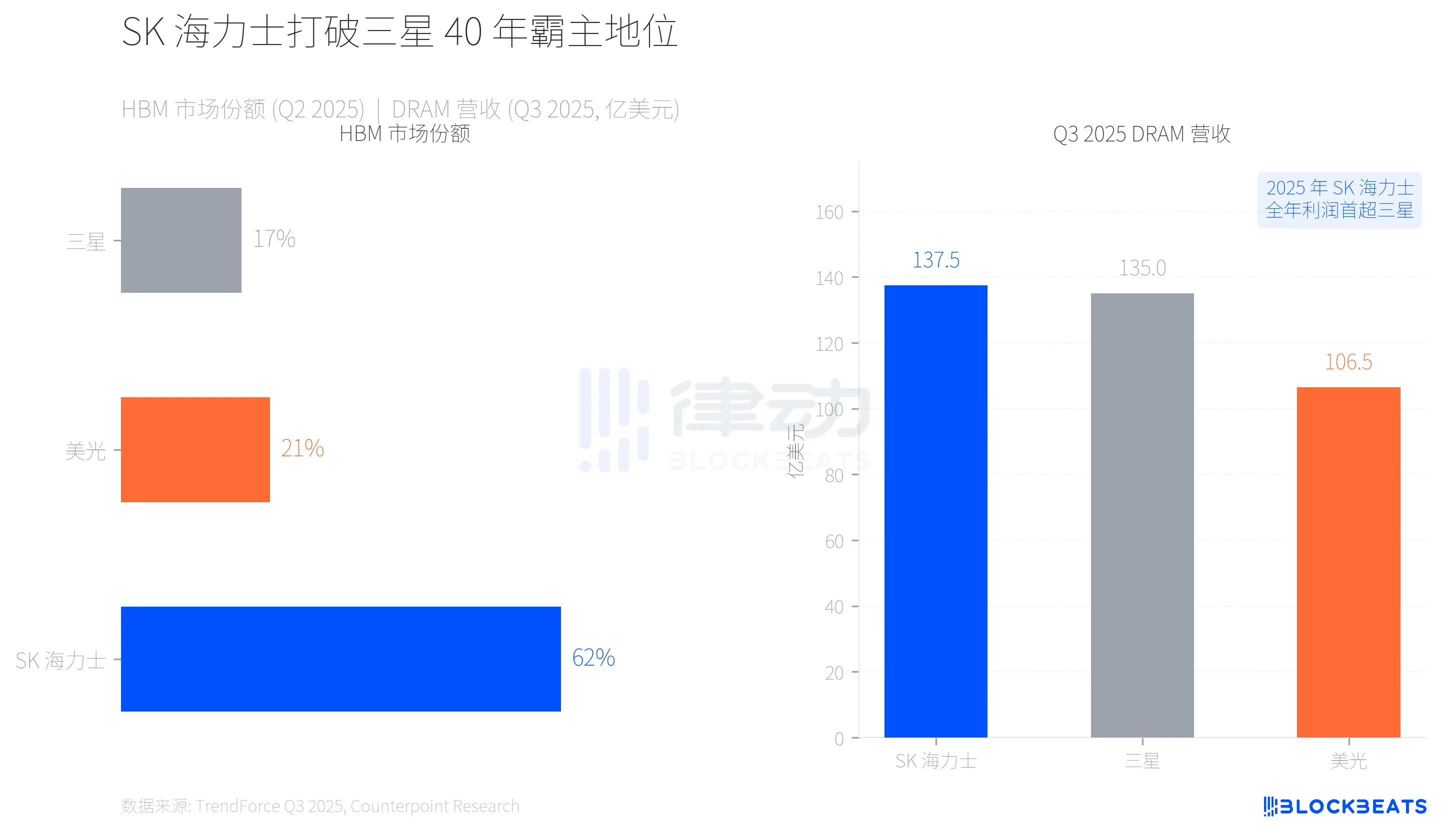

Transformación del paisaje: SK Hynix rompe el dominio de 40 años de Samsung

Este cambio en la capacidad también ha transformado la estructura de poder del sector de la memoria. Según datos de TrendForce, en el segundo trimestre de 2025, SK Hynix, que mantiene estrechos vínculos con NVIDIA, acaparó el 62 % del mercado de HBM, mientras que Samsung solo alcanzó el 17 % y Micron, el 21 %.

Y lo que es aún más significativo, se ha producido un cambio de tendencia en los ingresos. Según el informe del tercer trimestre de 2025 de TrendForce, SK Hynix encabezó por primera vez la clasificación de ingresos trimestrales por DRAM con 13 750 millones de dólares, seguida de cerca por Samsung con 13 500 millones de dólares. La diferencia entre ambas empresas fue de solo 250 millones de dólares, pero esta es la primera vez en casi 40 años que Samsung pierde su primer puesto en ingresos por memoria. Según informó la CNBC, el beneficio operativo anual de SK Hynix en 2025 también superó al de Samsung por primera vez.

La ventaja de ser pionera en HBM le ha dado a SK Hynix suficiente ventaja competitiva, pero esta carrera está lejos de haber terminado. Samsung está trabajando intensamente para ponerse al día en el proceso de producción en masa de HBM4 y, aunque Micron ha abandonado el mercado de consumo, el crecimiento de sus ingresos en los sectores empresarial y de la inteligencia artificial (un 53,2 % intertrimestral en el tercer trimestre) es el más rápido de las tres grandes.

¿Cómo logró un algoritmo revolucionar la lógica de las subidas de precios?

El 25 de marzo, Google presentó el algoritmo TurboQuant en la conferencia ICLR 2026. Este algoritmo hacía una cosa: comprimía la caché KV (caché clave-valor, la parte que más memoria consume durante la inferencia del modelo de lenguaje) de precisión FP16 a 3 bits, reduciendo el uso de memoria al menos seis veces, al tiempo que lograba una aceleración de hasta ocho veces en el cálculo de la atención en la GPU H100. Según el blog de investigación de Google, en cinco pruebas de rendimiento de contexto extenso, como «Needle-in-a-Haystack», la pérdida de precisión fue nula.

El mercado no tardó en darse cuenta. Si TurboQuant o un algoritmo similar se generaliza entre las principales empresas de IA, la demanda incremental de DRAM para la inferencia de IA se reducirá considerablemente. El argumento principal que ha sustentado el aumento de los precios de la memoria durante el último año y medio es precisamente que «la infraestructura de IA ha consumido demasiada capacidad de memoria».

Cuatro días después, la confianza en el canal se derrumbó.

Cabe señalar que TurboQuant se centra en el almacenamiento en caché de KV en la fase de inferencia de la IA, y no en la demanda de HBM en la fase de entrenamiento. La relación entre la oferta y la demanda de HBM no cambiará a corto plazo debido a un algoritmo de optimización de inferencias. Sin embargo, el mercado no siempre distingue entre ambos. Según Sina Finance, antes de la caída, un gran número de acaparadores que operaban fuera del canal oficial se lanzaron al mercado nacional debido al aumento de los precios, lo que provocó una caída de las ventas al por menor de más del 60 %. Las ventas en cadena, en un contexto de escasez de financiación, agravaron el descenso.

La cadena de suministro del sector de la inteligencia artificial ha provocado a la vez una escasez y un pánico por el exceso de oferta de memoria. La escasez de capacidad física de la HBM ha provocado una falta de oferta de memoria para el mercado de consumo, mientras que el avance de TurboQuant en materia de eficiencia algorítmica ha provocado una fuerte caída en las previsiones de demanda de memoria para IA. La misma fuerza está detrás tanto de la subida de precios como del colapso del mercado.

También te puede interesar

¿Cómo puede ganar una persona promedio en el auge de la IA en 2026?

Cuando Wall Street se encuentra con las criptomonedas, aquí tienes tu "Guía para principiantes y avanzados del mercado de valores"

StandX presenta SIP1 y SIP2: Se pone en marcha el mecanismo de subvenciones por tenencia, lo que transforma el comercio en cadena y la estructura de recompensas

Decodificando Aave V4: Un cambio del producto a la "banca"

Huobi HTX lanza el whitepaper "Tendencias de activos digitales 2026": Reconfiguración de la liquidez global, que define la nueva era de las "finanzas on-chain"

Desglose de la valoración de PUMP: Narrativa de Debunking on-chain Data “Wash tradeando”: ¿De dónde proviene el descuento real?

Tras el fraude de L2, Ethereum recurre a la «zona económica» para valerse por sí mismo

StandX lanza SIP1 y SIP2: El mecanismo de subsidio de posición entra en funcionamiento, transformando la estructura de ingresos y el comercio en la cadena de bloques.

Huobi HTX publica el «Informe técnico sobre las tendencias de los activos digitales en 2026»: Reestructuración de la liquidez global: definiendo una nueva era soberana de las «finanzas en cadena»

El CEX cifrado se está convirtiendo en una especie histórica.

DeFi Gobernanza Revolución

Informe CoinShares 2026: ¿Han llegado los mineros de Bitcoin a su momento más difícil?

El proyecto criptomonedas World, fundado por el fundador de OpenAI, ha recaudado $67 millones en fondos, pero aún lucha con desafíos de crecimiento

Noticias matutinas | El holding de BTC de American Bitcoin superó los 7.000; Midas completa un financiamiento Serie A de $50 millones; Empresa matriz de Upbit, Dunamu, anuncia ingresos para 2025

WEEX P2P ahora soporta PHP—Reclutamiento de Comerciantes Ahora Abierto

Para facilitar los depósitos en criptomonedas, WEEX ha lanzado oficialmente su plataforma de trading P2P y continúa expandiendo el soporte para fiat. ¡Estamos emocionados de anunciar que el Peso Filipino (PHP) ya está disponible en WEEX P2P!

Una caída de más del 97% continúa desbloqueándose, sin embargo, WLD ha completado $65 millones en financiamiento extrabursátil: ¿quién sigue pagando la cuenta?

Desglose de la Valoración de PUMP: Los datos en cadena desmienten la teoría del "volumen falso", ¿de dónde proviene el verdadero descuento?