OpenAIの確執:パワー、信頼、そして汎用人工知能の制御不能な境界

元の記事タイトル:サム・アルトマンは我々の未来を左右するかもしれない――彼を信用できるのか?

原著論文の著者:ロナン・ファローとアンドリュー・マランツ(ニューヨーカー誌)

翻訳:ペギー、ブロックビーツ

編集者注:本稿は、多数の未公開文書と詳細なインタビューを通して、サム・アルトマンの権力と信頼をめぐるOpenAI内部の危機を改めて検証する。取締役会の解任から迅速な再任に至るまで、「クーデターのような逆転劇」とも言えるこの混乱は、単発的な出来事ではなく、長年にわたる経営上の対立が集中して噴出したものだった。

この対立の核心にあるのは、2つの論理体系間の絶え間ない綱引きである。一方には、「人間の安全第一」を基盤とするOpenAIの非営利ミッションがあり、他方には、汎用人工知能(AGI)の実現が近づき商業化が加速するにつれて、製品、規模、収益を重視した開発路線への緩やかな移行がある。この過程で、安全への取り組みは継続的に弱体化し、権力と意思決定は徐々に少数の人々に集中するようになった。

イリヤ・スツケバーやダリオ・アモデイをはじめとする多くの重要人物は、情報の不透明性や戦略的な表現に焦点を当て、アルトマンのリーダーシップスタイルは「人類の運命を変える」テクノロジーをしっかりと統括するには不十分だと疑問を呈している。しかし、彼の支持者たちは、資源統合、資本運用、実行における彼の能力こそがOpenAIの急速な拡大の鍵であると強調している。

技術力が世界秩序に影響を与えるほどに高まった時、既存の企業統治構造は依然として個人を抑制するのに十分なのだろうか?言い換えれば、AI時代における真の不確実性は、技術そのものだけでなく、その技術を制御する人々からも生じる可能性がある。

以下は元の記事です。

権力と信頼:アルトマンのリーダーシップ下におけるガバナンスの亀裂

2023年秋、OpenAIのチーフサイエンティストであるイリヤ・サツケバーは、同社の他の3人の取締役に秘密のメモを送った。その数週間前から、彼らはあるデリケートな問題について非公式に話し合っていた。それは、CEOのサム・アルトマンと副CEOのグレッグ・ブロックマンが、引き続き会社を率いるのにふさわしい人物かどうかという問題だった。

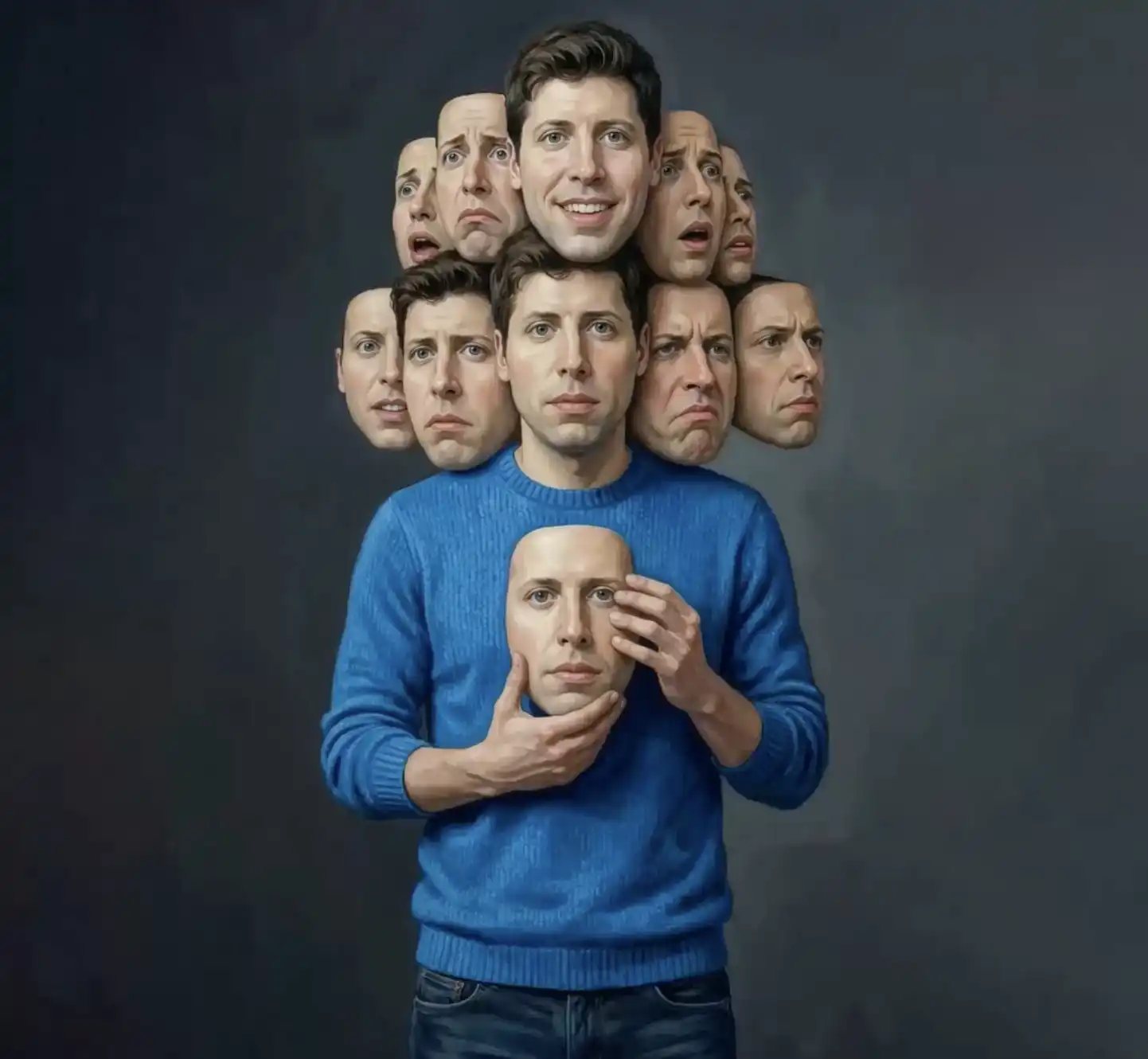

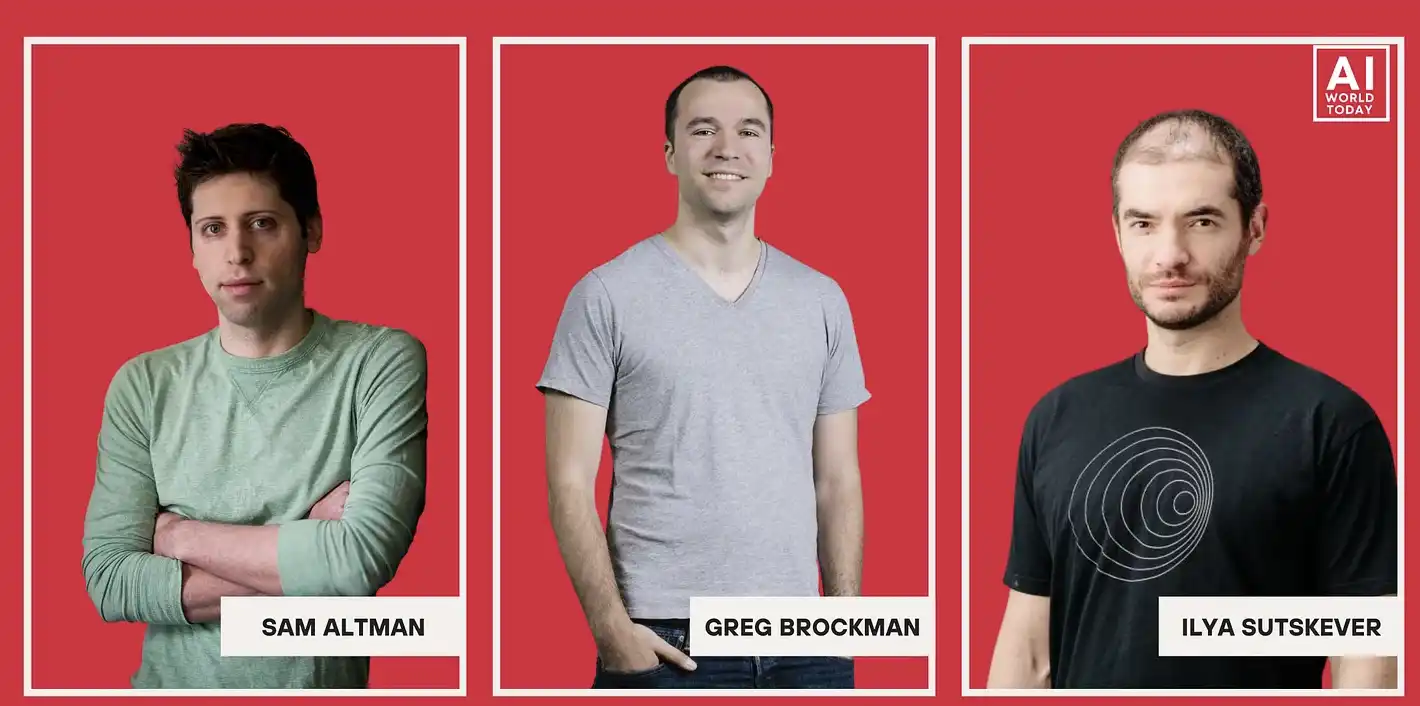

画像出典:AIワールドトゥデイ

サツケバーはかつて、彼ら二人のことを友人だと考えていた。2019年には、彼はOpenAIのオフィスでブロックマンの結婚式を主催し、そこではロボットアームが「指輪運び」の役を務めた。

しかし、同社が長期目標である、人間の認知能力に匹敵するか、あるいはそれを凌駕する人工知能の創造に近づいているという確信が深まるにつれ、アルトマンに対する彼の疑念は深まっていった。当時、彼は別の取締役に対し、「サムは、その決定権を握るべき人物ではないと思う」と述べた。

他の取締役の要請を受け、サツケバー氏は志を同じくする同僚たちと共に、Slackのチャットログ、人事ファイル、および付随する解説を含む約70ページの文書を作成した。中には、会社の端末による監視を避けるためと思われる、スマートフォンで撮影されたスクリーンショットもあった。彼は最終的に、これらのメモがより多くの人の目に触れないようにするため、「読んだら燃やす」という方法で他の役員に送付した。

「彼は当時、本当に怖がっていた」と、資料を受け取ったある監督は回想した。私たちは、これまで完全には公開されていなかったこれらのメモを精査した。これらの文書は、アルトマン氏が経営幹部や取締役会メンバーに対して事実を歪曲し、社内セキュリティプロトコルに関して欺瞞的な行動をとったと非難している。アルトマンに関するあるメモは、「サムは一貫して…を示してきた」というタイトルの項目リストから始まっており、最初の項目は「嘘をつくこと」だった。

多くのテクノロジー企業は「世界をより良い場所にする」と主張するが、実際の事業活動は収益の最大化を中心に展開されている。しかし、OpenAIの創設理念は、このモデルとは異なるものであった。アルトマン、サツケバー、ブロックマン、イーロン・マスクといった創設者たちは、人工知能は人類史上最も強力で、同時に最も危険な発明の一つになり得ると信じていた。こうした「存亡の危機」を背景に、同社は従来とは異なる組織構造を必要とするかもしれない。

OpenAIは当初、非営利団体として設立され、その理事会は「全人類の安全」を会社の成功よりも優先し、会社の存続よりも優先するという使命を担っていた。CEOには、並外れた人格と倫理観が求められるだろう。

サツケバー氏が述べたように、「私たちが知る文明を変革しうるこの技術の開発に関わる者は誰でも、重い責任と前例のない義務を負うことになる」。しかし彼はまた、「こうした地位に就く人々は、往々にして特定のタイプの人々、つまり権力に飢えた人々、政治家タイプの人々、あるいは権力そのものを楽しむ人々である」と指摘した。あるメモの中で、彼は「他人が聞きたいことしか言わない」人物にこの技術を委ねることへの懸念を表明した。

もしOpenAIのCEOが最終的に信頼できない人物だと判明した場合、この6人からなる取締役会には彼を解任する権限がある。AI政策の専門家であるヘレン・トナーや起業家のタシャ・マコーリーなど、一部の取締役はこれらのメモを読んだ後、以前からの判断をより確信するようになった。アルトマンが引き受けたのは人類の未来に関わる責任だったが、彼自身は信用できない人物だったのだ。

役員会でのクーデター:サム・アルトマンが解雇された

当時、サム・アルトマンはラスベガスでF1レースを観戦していたところ、イリヤ・サツケバーから取締役会とのビデオ通話に招待され、彼がOpenAIの従業員ではなくなったことを発表する短い声明を読み上げられた。取締役会は、法的助言に基づき、アルトマン氏が「コミュニケーションにおいて一貫して誠実さを保てなかった」ことを理由に解雇されたとする声明を発表した。

この決定は、OpenAIの多くの投資家や経営陣に衝撃を与えた。OpenAIに約130億ドルを投資していたマイクロソフトも、この決定が実行される直前にこのニュースを知った。「当時は本当に驚きました」と、マイクロソフトのCEO、サティア・ナデラは後に振り返った。「誰からもそれ以上の情報は得られなかった。」その後、彼はリード・ホフマン(LinkedInの共同創業者、OpenAIの投資家、マイクロソフトの取締役)に連絡を取り、ホフマンはアルトマンが何らかの明白な不正行為を犯したかどうかをあらゆる方面に問い合わせ始めた。「当時は全く混乱していました」とホフマンは語った。「横領やハラスメントといった問題を探していたのですが、何も見つかりませんでした。」

他のビジネスパートナーも同様に不意を突かれた。アルトマンが投資家のロン・コンウェイに解雇を告げる電話をかけた時、コンウェイはナンシー・ペロシ米下院議員と昼食をとっていたため、その場でペロシに電話を代わった。「早くここから出て行った方がいいわよ」と彼女はコンウェイに言った。

一方、OpenAIは、ジョシュ・クシュナーが設立したベンチャーキャピタル企業Thrive Capitalからの大規模な資金調達ラウンドを間もなく完了する予定だった。ジョシュ・クシュナーは、アルトマンが長年知っていたジャレッド・クシュナーの弟でもある。この取引が成立していれば、OpenAIの企業価値は860億ドルと評価され、多くの従業員が数百万ドル相当の株式報酬を受け取ることができたはずだ。クシュナーは音楽プロデューサーのリック・ルービンとのミーティングを終えたばかりだったが、アルトマンからの着信に気づき、折り返し電話をかけた。「我々は即座に戦闘態勢に入った」と彼は後に回想した。

解雇された当日、アルトマンはサンフランシスコにある2700万ドルの豪邸に飛行機で戻り、そこからは湾全体を見渡せる片持ち式のインフィニティプールがあり、彼はそこに「一種の亡命政府」と呼ぶ臨時の指揮センターを設置した。コンウェイ氏、Airbnbの共同創業者ブライアン・チェスキー氏、そして攻撃的なことで有名な危機管理広報担当者クリス・レハネ氏がビデオ通話や電話で参加し、時には何時間も話し続けた。アルトマンの経営陣の中には、邸宅の廊下に寝泊まりする者さえいた。弁護士たちは寝室の隣にある彼の自宅オフィスに陣取った。不眠症に悩まされる時、アルトマンはパジャマ姿で部屋を行ったり来たりしていた。最近のインタビューで、彼はこの解雇後の体験を「奇妙な一種の解離状態」と表現した。

取締役会が沈黙を保つ中、アルトマンの顧問チームは彼の復帰に向けたストーリー作りに着手した。リーハン氏は、今回の解雇は実際には「効果的利他主義者」によって仕組まれた「クーデター」であり、彼らは人類全体の幸福の最大化を重視する思想体系の提唱者であり、人工知能を存亡の危機とみなしていたと主張した。(ホフマンは当時、ナデラに対し、解雇は「ある種の効果的な利他的狂気」によるものかもしれないと示唆した。)マイク・タイソンから拝借した「誰もが顔面を殴られるまでは計画を持っている」というモットーで広く知られるレヘインは、アルトマンに大胆なソーシャルメディア攻勢をかけるよう提案した。チェスキーはテクノロジー系ジャーナリストのカラ・スウィッシャーと連絡を取り続け、取締役会に対する批判を外部に向けて繰り返し発信していた。

毎晩6時になると、アルトマンは「作戦室」から出てきて、ネグローニをグラスに注いだ。彼は周囲の人々に「リラックスしなさい。起こるべきことは起こるものだ」と言ったことを思い出した。しかし、彼は通話記録によると、その期間中、1日に12時間以上電話をかけていたと付け加えた。

ある情報筋によると、アルトマン氏は当時OpenAIの暫定CEOを務めていたミラ・ムラティ氏に対し、彼の支持者たちが「あらゆる手段を講じて」彼女や彼の追放を推し進める関係者の評判を落とすために「スキャンダルを掘り起こそうとしている」と語ったという。(アルトマン自身はこの会話を覚えていないと主張している。)

解雇から数時間以内に、Thrive Capitalは計画していた投資を一時停止し、サム・アルトマンが復帰した場合にのみ取引が成立し、従業員は株式報酬を受け取ることができると明言した。当時のテキストメッセージの記録によると、アルトマンはサティア・ナデラと非常に頻繁に連絡を取り合っていた。(共同声明を作成するにあたり、アルトマンは「サティアと私の現在の最優先事項はOpenAIを救うことだ」という文言を提案したが、ナデラは別の表現を提案した。)「OpenAIが今後も繁栄し続けるよう尽力する。」

電力反転:アルトマン氏は5日後に速やかに復職した。

その後間もなく、マイクロソフトはアルトマン氏と、OpenAIを退職した従業員を対象とした競争的なプロジェクトを開始すると発表した。同時に、アルトマンの復帰を求める公開書簡が社内で出回り始めた。当初署名をためらっていた人の中には、同僚から懇願の電話やメッセージを受け取った人もいた。最終的に、OpenAIの従業員の大多数は、アルトマン氏を支持するために集団辞職をちらつかせた。

理事会は窮地に追い込まれた。「Ctrl+Z、それも選択肢の一つよ」とヘレン・トナーは言った。これは解雇決定を取り消すことを指している。「もう一つの選択肢は、全面的な崩壊だ。」当時暫定CEOだったミラ・ムラティ氏も、最終的には公開書簡に署名した。アルトマンの支持者たちは、イリヤ・スツケヴェルに立場を変えるよう説得し始めた。ブロックマンの妻アンナは、オフィスで彼に近づき、「あなたは良い人だから、きっとこの状況を正せるわ」と言った。サツケバー氏は後に法廷証言で、「当時、もしサムが戻ってこないという道を選んだら、OpenAIは崩壊してしまうだろうと感じていた」と説明した。

ある夜、アルトマンは睡眠薬のアンビエンを服用し、オーストラリア人プログラマーである夫のオリバー・マルヘリンに起こされた。マルヘリンは、サツケバーの立場が揺らいでいると告げ、アルトマンにすぐに取締役会と連絡を取るよう勧めた。「アンビエンの影響で朦朧とした状態で目が覚めたんです」とアルトマンは当時を振り返り、「完全に方向感覚を失っていて、『今の状況では役員会と話すことなんて到底無理だ』と思ったんです」と語った。

緊迫感を増していく一連の電話会談の中で、サム・アルトマンは自身の解雇を推し進めた取締役たちの辞任を要求した。帰国するという考えを振り返り、彼は当初の反応をこう思い出した。「こんな極めて疑わしい環境で、彼らの尻拭いをしなければならないのか?」「絶対に嫌だと思った」と彼は語った。最終的に、イリヤ・サツケバー、ヘレン・トナー、タシャ・マコーリーは取締役の座を失い、当初の取締役として残ったのはアダム・ダンジェロ(Quoraの共同創設者)のみとなった。

辞任条件の一環として、これらの取締役は、アルトマンに対する告発(幹部間の分裂を引き起こしたことや、金銭的なつながりを隠蔽したことなど)について調査するよう要請した。彼らはまた、外部調査を独立して監督するための新たな委員会の設立を強く求めた。しかし、新たに任命された2人の取締役、元ハーバード大学学長のローレンス・サマーズ氏と元フェイスブック最高技術責任者のブレット・テイラー氏は、アルトマン氏との緊密な協議を経て選出された。「ブレット、ラリー・サマーズ、アダムが取締役で、私がCEO、そしてブレットが調査を主導するという体制で、うまくいくと思いますか?」とアルトマンはサティア・ナデラにテキストメッセージを送った。(マコーリーは後に、テイラーが取締役候補として検討されていた際、彼がアルトマンにあまりにも従順すぎるのではないかと懸念していたと証言した。)

解雇されてから5日も経たないうちに、アルトマンは復職した。会社の従業員たちは後にこの時期を「ブリップ」と呼ぶようになった。これはマーベル映画の筋書きから取ったもので、短期間の失踪とその後の帰還、しかし彼らの不在によって世界は根本的に変化していた、というものだ。

しかし、アルトマンの信頼性をめぐる論争は、とっくにOpenAIの役員室を超えて広がっていた。彼を追放する策略を巡らせた同僚は、彼が広範囲にわたる欺瞞行為を行っていたと非難した。それは、いかなる企業の幹部にとっても容認できない行為であり、ましてや、そのような革新的な技術を保有するリーダーにとってはなおさらである。「権力に見合った抑制策が必要だ」とミラ・ムラティは私たちに語った。「理事会から意見を求められたので、私は自分の見たままを正直に伝えただけです。そして、その意見に変わりはありません。」一方、アルトマンの支持者たちは、これらの疑惑を長らく軽視してきた。解雇後、投資家のロン・コンウェイはブライアン・チェスキーとクリス・レハネにメッセージを送り、広報面での反撃を促した。「これはサムの評判に関わる問題だ。」彼はまた、ワシントン・ポスト紙に対し、アルトマン氏は「手に負えない取締役会」によって不当な扱いを受けていると語った。

それ以来、OpenAIは世界で最も価値のある企業の1つに成長し、1兆ドル規模の新規株式公開(IPO)を準備していると報じられている。一方、アルトマンは大規模な人工知能インフラの構築を推進しており、その取り組みの一部は海外の権威主義体制にも及んでいる。OpenAIはまた、大規模な政府契約の獲得を目指しており、移民取締り、国内監視、紛争地域における自律型兵器といった分野におけるAIアプリケーションの標準規格を徐々に策定している。

サム・アルトマンは、未来への壮大なビジョンを描き続けることで、OpenAIの成長を牽引してきた。2024年のブログ記事で、彼はこう書いている。「気候変動の解決、地球外植民地の建設、あらゆる物理法則の解明といった、息を呑むような勝利も、いずれはありふれたものになるだろう。」この物語は、史上最も急速に成長したスタートアップ企業の1つを支えるものであり、その企業は多額の資金を高いレバレッジをかけたパートナーからの資金調達に大きく依存している。米国経済は、少数の影響力の大きいAI企業への依存度を高めており、アルトマン氏自身を含め、多くの専門家が業界におけるバブルのリスクを警告している。「誰かが大金を失うことになるだろう」と彼は昨年、記者団に語った。バブルが崩壊すれば、経済的な大惨事を引き起こす可能性がある。しかし、彼の最も楽観的な予測が実現すれば、彼は世界で最も裕福で権力のある人物の一人になる可能性もある。

アルトマン氏の解雇後に行われた緊迫した電話会議で、取締役会は彼に対し、一連の欺瞞的な行動を認めるよう要求した。その場に居合わせた関係者によると、彼は繰り返し「これは馬鹿げている」と言い、「私は自分自身を変えることはできない」と述べたという。アルトマンは後に、その会話については全く記憶がないと主張した。「私が言いたかったのは、おそらく『私は常に人々を一つにまとめようとしてきた』ということだったのでしょう」と彼は後に私たちに説明し、自身が非常に成功した企業を率いることができたのは、この特質のおかげだと述べた。彼はこうした批判を、キャリア初期に「対立を避けすぎていた」傾向があったことに起因するものだと説明した。しかし、ある理事は全く異なる解釈を示した。「彼が本当に言いたかったのは、『私は人に嘘をつく癖があって、それをやめない』ということだったんです。」

ミッションドリフト:セキュリティ第一からビジネス第一へ

そして、より根本的な疑問が浮かび上がった。アルトマンの解任を推し進めていた同僚たちは、過剰な熱意や個人的な敵意から行動していたのか、それとも彼らの判断は正しく、アルトマンは本当に信用できない人物だったのか?

今年のある冬の朝、私たちはサンフランシスコにあるOpenAIの本社でアルトマン氏と会った。これは、この記事のために私たちが行った十数回の会話のうちの1つだった。同社は最近、11階建てのガラス張りの高層ビル2棟に移転したが、そのうちの1棟は以前、別の巨大テクノロジー企業であるUberが入居していた。Uberの共同創業者で元CEOのトラビス・カラニックは、倫理的な問題が原因で2017年に追放されるまで、止められない天才起業家と見なされていた。(カラニック氏は現在、ロボット関連のスタートアップ企業を経営しており、余暇にはOpenAIのChatGPTを使って「量子物理学の最先端を探求している」と述べている。)

従業員の方がオフィス内を案内してくれました。共有の長いテーブルが並び、自然光が差し込む空間には、コンピューター科学者アラン・チューリングの躍動感あふれるデジタル絵画が飾られており、私たちが動くと、その目が私たちを追うように動いていた。このインスタレーションは明らかに「チューリングテスト」へのオマージュだった。チューリングテストとは、機械が人間を説得力をもって模倣できるかどうかを判断するための、1950年代の思考実験である。(2025年の研究では、ChatGPTはこのテストにおいて、実際に人間のパフォーマンスを上回った。)通常、その絵画はインタラクティブな作品だった。しかし、ガイドの説明によると、その音声機能は従業員間の会話を常に「盗み聞き」、頻繁に割り込んでくるため、無効化されているとのことだった。オフィス内の別の場所には、「AGIを感じろ」と書かれた看板が目に入った。これはもともとイリヤ・スツケバーが考案したもので、高度な汎用人工知能(機械が人間レベルの認知能力を獲得する時点)のリスクを同僚に思い出させるために使われたスローガンだ。ブリップ事件後、それは明るい未来を祝う陽気なキャッチフレーズへと変化した。

8階にある何の変哲もない会議室で、私たちはサム・アルトマンを見つけた。「以前は意思決定疲れについてよく耳にしていたけれど、自分にはそれが理解できなかった」と彼は語った。「今は毎日グレーのセーターとジーンズを着ているんだけど、クローゼットからどのグレーのセーターを選ぶかさえ、こんな選択をしなくて済むならいいのにって思うの。」

アルトマンは、すらりとした体型、離れた青い目、少し乱れた髪で、いつまでも若々しく見えたが、実際は40歳だった。彼とオリバー・マルヘリンの間には、代理出産によって生まれた1歳の息子がいる。「アメリカ合衆国大統領という仕事は確かに大きなプレッシャーがかかると思うが、現実的に自分が務められる仕事の中で、最もプレッシャーが大きいと想像できるのはこの仕事だ」と彼は言い、私たちの一人を見てから、もう一人を見た。「私は友人たちにこう説明しました。「ChatGPTを立ち上げるまでは、世界で一番面白い仕事だった。」それ以前にも、私たちは数々の大きな科学的ブレークスルーを成し遂げていました。私は、これはここ数十年で最も重要な科学的発見の一つだと考えていました。彼は下を向いた。「しかし、ChatGPTがサービスを開始して以来、あらゆる決断が非常に難しくなった。」

アルトマンは、セントルイスの裕福な郊外であるミズーリ州クレイトンで、4人兄弟の長男として育った。彼の母親であるコニー・ギブスタインは皮膚科医で、父親のジェリー・アルトマンは不動産業者であり、住宅関連の取り組みにも携わっていた。彼は改革派ユダヤ教のシナゴーグで育ち、私立の予備校に通ったが、後にそこを「ゲイであることをカミングアウトするには容易な場所ではなかった」と述べている。しかし、全体的に見ると、彼が属していた上流中産階級のコミュニティは比較的リベラルだった。

彼は16歳か17歳頃、セントルイスのゲイが多く住む地域で夜間に外出中に、深刻な暴行とホモフォビアに基づく侮辱を受けた。アルトマンはこの事件を報告せず、詳細を明かすことも拒否した。「もっと詳しく説明すると、私が人を操っているか、同情を求めているように見えてしまう」と述べた。彼はこの経験と、自身の性的指向がアイデンティティにとって持つ重要性を軽視した。しかし彼はまた、「心理的に非常に深い何かがあるのかもしれない。カミングアウトしたような気分になりながらも、実際にはカミングアウトしていなかったのは、さらなる衝突を避けるためだったのかもしれない」と認めた。

彼の兄は、2016年のニューヨーカー誌のインタビューで、彼の幼少期の性格を「勝ちたい、すべてをコントロールしたい」と表現した。アルトマンは後にスタンフォード大学に進学し、学外で頻繁にポーカーゲームに参加した。「大学時代よりも、そこで人生やビジネスについて多くを学んだように感じます。」

Yコンビネーター時代:誇張表現と信頼性に関する論争

スタンフォード大学の学生は野心的だが、中でも行動力のある学生はしばしば退学を選択する。アルトマンは大学2年生の終わりに、マサチューセッツ州へ向かい、Yコンビネーターのスタートアップ育成プログラムに参加する最初の起業家グループの一員となった。この機関は、著名なソフトウェアエンジニアであるポール・グラハムによって共同設立された。参加者それぞれが、起業のアイデアを持って参加した。(彼と同じ学年の中には、後にRedditやTwitchを創設したチームも含まれていた。)アルトマンのプロジェクトは後にLooptと名付けられ、折りたたみ式携帯電話の位置を追跡することで友人同士が互いの居場所を確認できる、初期のソーシャルネットワーキング製品となった。同社は、彼の実行力と、曖昧な領域で自らの居場所を切り開く傾向の両方を実証した。当時、連邦規制では通信事業者は緊急時に携帯電話の位置を特定できることが義務付けられており、アルトマンは通信事業者と契約を結び、この機能を自社製品に組み込んだ。

ループト時代、従業員のほとんどはサム・アルトマンを好意的に見ていたが、中には彼が些細なことでも「誇張する」傾向があることに驚いた人もいた。アルトマンは「ミズーリ州の高校卓球チャンピオン」だと自慢していたが、実際には会社で最も下手な選手の一人だったと、ある者は回想している。(アルトマンは、それはおそらくただの冗談だったのだろうと述べた。)Looptの年長社員であるマーク・ジェイコブスタインは、投資家によってアルトマンの「後見人」に任命され、後にキース・ヘイギーの伝記『楽観主義者』の中で次のように述べている。「『もしかしたらできるかもしれない』と『実際にできた』の間には曖昧な領域があり、この曖昧さが最も極端な形で現れると、セラノスのような結果につながる可能性がある。」

ヘイギー氏によると、アルトマン氏のリーダーシップスタイルと透明性の欠如に対する懸念から、ループト社の幹部社員数名が取締役会に対し、彼をCEOの座から解任するよう2度提案したという。しかし同時に、彼には強い個人的な魅力もあった。元従業員の証言によると、取締役の一人が「ここはサムの会社だ。元の仕事に戻れ」と直接言い放ったという。(ただし、一部の取締役は、こうした解任の試みが真剣なものではなかったと否定している。)

Looptはユーザー数の増加に改善が見られず、最終的に2012年にフィンテック企業に買収された。関係者によると、今回の買収は主にアルトマン氏が「円満に退任する」ためのものだったという。しかし、2014年にポール・グラハムがY Combinatorを引退した際も、彼は後継者としてアルトマンを選んだ。「自分のキッチンで彼に尋ねたところ、彼はすべてがうまくいったかのように微笑んだ」とグラハムはニューヨーカー誌に語った。サムの、まるで紙くずをゴミ箱の奥深くまで投げ入れた時に見せるような、抑えきれない笑顔を見たことがない。

この新たな役職によって、当時28歳だったアルトマンは「キングメーカー」となった。彼の仕事は、最も野心的で将来有望な起業家を選抜し、一流のプログラマーや投資家と繋げ、業界をリードする独占企業を築く手助けをすることだった(その一方で、YCは6~7%の株式を取得する)。

彼のリーダーシップの下、Y Combinatorは急速に拡大し、インキュベーションプロジェクトの数は数十件から数百件に増加した。しかし、シリコンバレーの一部の投資家は、彼の利害が完全に一致していないのではないかと考えるようになった。ある投資家は、アルトマン氏が「外部投資家を排除するために、個人的に最も質の高い企業にのみ投資するだろう」と語った(アルトマン氏はこの主張を否定した)。彼はまた、セコイア・キャピタルのスカウトとしても活動し、初期段階のプロジェクト投資に参加して一定の収益を得ていた。

関係者によると、アルトマン氏がエンジェル投資家としてフィンテック企業Stripeに投資した際、より高い株式保有比率を要求したため、セコイア・キャピタル社内で不評を買ったという。情報筋は、これは「サム優先」戦略を反映したものだと述べた。(アルトマンはこの主張を否定した。)彼は2010年頃にStripeに約1万5000ドルを投資し、株式の約2%を保有していたが、現在同社の時価総額は1500億ドルを超えている。アルトマン氏は約400社に投資したと主張した。

2018年までに、Y Combinatorの複数のパートナーがアルトマンの行動に不満を抱き、それをグラハムに報告した。その後、グラハムは妻でありYCの共同創設者でもあるジェシカ・リビングストンとアルトマンと率直な話し合いを行った。その後、グラハムは、アルトマンが口頭では辞任に同意したものの、実際には辞任していなかったと公に述べ始めた。

アルトマンは一部のパートナーに対し、社長を辞任するが会長職には留まると伝えた。2019年5月、Y Combinatorはブログ記事を公開し、新社長の就任を発表するとともに、「サムはYC会長に就任します」と記した。数か月後、この声明は「サム・アルトマンはYCにおけるすべての運営職から辞任した」と修正され、その後、この文章は完全に削除された。しかしながら、2021年の時点でも、アルトマンは依然として米国Y Combinatorの会長として記載されていた。米国証券取引委員会への提出書類。(アルトマンは、このことを知ったのは後になってからだと述べている。)

サム・アルトマン氏は長年にわたり、また最近の法廷証言においても、Y Combinatorを解雇されたのではなく、退社に抵抗もしなかったと一貫して公言している。ポール・グラハムはツイッターで「彼に辞めてほしくはなかったが、YCとOpenAIのどちらかを選んでほしかった」とツイートした。グラハム氏は声明の中で、「我々には誰かを解雇する法的権限はない。できることは道義的な圧力をかけることだけだ」とも述べている。

しかし、内情はもっと明確だった。アルトマンの退社は、YCのパートナーからの信頼の欠如が原因だったのだ。アルトマンのY Combinator在籍期間に関するこの記述は、複数のYC創設者やパートナーへのインタビュー、および当時の資料に基づいており、それらはすべて、両者の別れが完全に円満なものではなかったことを示唆している。報道によると、グラハムは社内での話し合いの中で、YCの同僚に対し「サムは解雇される前からずっと私たちに嘘をついていた」と語ったという。

OpenAIのミッションドリフト:安全第一から利益第一へ

2015年5月、アルトマンは当時世界でおよそ100番目に裕福な人物だったイーロン・マスクにメールを送った。多くのシリコンバレーの起業家と同様に、マスクは当時、彼が「存亡の危機」と捉えていた一連の事柄に強く焦点を当てていた。もっとも、他のほとんどの人はそれらを可能性の低いものと見ていた。「AIには細心の注意を払う必要がある」と彼はツイッターに投稿した。「核兵器よりも危険な可能性がある」。

長らくテクノロジーの楽観主義者だったアルトマンは、AIに関する論調をたちまち終末論的なものへと転換させた。彼は公の場での発言やマスク氏らとの個人的なやり取りの中で、この技術が営利目的の巨大テクノロジー企業に独占されることを許してはならないと警告した。「AI軍拡競争を止める方法はないかと考えてきたが、もし方法がないのなら、適切な企業に任せるのが最善策だろう」と彼は書いている。彼は核兵器のアナロジーを用いて、「AI」の設立を提案した。マンハッタン計画。彼はさらに、この組織の基本理念を概説した。「安全は最優先事項でなければならない」「我々は当然、すべての規制を遵守し、支持すべきである」。

その後、彼とマスクはプロジェクト名を決定した。OpenAI。

当初は政府主導で原子爆弾の開発に至ったマンハッタン計画とは異なり、OpenAIは初期段階では民間資金によって運営されることになる。アルトマンは、汎用人工知能(AGI)を凌駕する「超知能」が出現すれば、それが「宇宙の未来の光円錐を捉える」のに十分な経済的価値を生み出すだろうと予見していた。しかし、彼は同時に、この技術が国家安全保障に及ぼす潜在的なリスクについても繰り返し強調した。つまり、ある時点で、この技術が国家安全保障に及ぼす影響は非常に大きくなり、米国政府がOpenAIを接収、ひいては国有化し、その施設を砂漠の安全な拠点に移転せざるを得なくなる可能性があるというのだ。2015年末までに、マスクは確信した。「我々は10億ドルの資金拠出を表明すべきだ」と彼は書き、「もし他の人が賛同しないなら、私が支持する」と付け加えた。

サム・アルトマンは当初、OpenAIをY Combinatorの非営利部門の下に置き、社内慈善プロジェクトとして位置づけた。彼はOpenAIに参加するメンバーにYC株を割り当て、寄付金はYCアカウントを通じて送金した。一時期、この研究所はアルトマンが個人的に出資していたYCファンドからの支援に頼っていたことさえあった。(アルトマンは後にこの株式保有額を「ごくわずか」と述べ、従業員に割り当てられたYC株は自身の個人保有分から拠出されたものだと説明した。)

「マンハッタン計画」との類似性は、人材獲得競争にも表れていた。核分裂研究と同様に、機械学習も当時は小規模な科学分野だったが、画期的な影響を与える可能性を秘めており、非常に才能のある少数の個人によって主導されていた。イーロン・マスク、アルトマン、そしてStripeから移籍してきたグレッグ・ブロックマンは皆、真に画期的なコンピューター科学者はごく少数しかいないと考えていた。一方、Googleは資金と時間の面で圧倒的に有利だった。「我々は人材と資源の面で大きく遅れをとっており、その差は想像を絶するほどだ」とマスク氏は後にメールで述べている。しかし彼はまた、「最高の才能を引きつけ続け、正しい方向性を確保できれば、OpenAIは必ず成功するだろう」と信じていた。

最も重要な採用対象者の1人は、イリヤ・スツケバーだった。彼は内向的で情熱的な研究者であり、同時代で最も才能のあるAI科学者の1人としばしば評されていた。1986年にソビエト連邦で生まれたスツケバーは、生え際が後退しており、目は深く、話す前に少し間を置いて物思いにふける癖があった。もう一人重要な人物はダリオ・アモデイだった。彼は生物物理学のバックグラウンドを持つ精力的な研究者で、緊張するとよく黒髪に手をやり、たった一文のメールにも何段落にもわたる長文の返信をするのが常だった。当時、二人はそれぞれ別の会社で高給の役職に就いていたが、アルトマンは彼らを自社に迎え入れるために多大な努力を注いだ。彼は後に冗談交じりに「僕はほとんどイリヤを『ストーキング』していたんだ」と語った。

マスク氏の方が知名度は高いかもしれないが、アルトマン氏の方が手腕は優れている。彼は自らアモデイにメールを送り、インド料理店で一対一の面会をセッティングした。(アルトマン:「私の乗っていたUberが事故に遭った!」10分ほど遅れるかもしれない。アモデイ:「ああ、大変でしたね。ご無事だといいのですが。」)多くのAI研究者と同様に、アモデイ氏は、この技術は人間の価値観と「一致」していることが証明されて初めて開発されるべきだと考えている。つまり、「環境浄化」の名の下に人類を滅ぼすなど、人間の意図から大きく逸脱するようなものであってはならないということだ。アルトマンは会話の中でこの安全上の懸念を繰り返し述べ、相手に安心感を与えた。

後に同社に入社したアモデイは、アルトマンとブロックマンの行動を何年もかけて記録し、「OpenAIでの私の経験」(副題:"機密:配布禁止」アモデイ氏に関連する200ページを超えるファイル(これらのメモ、社内メール、覚書などを含む)は、シリコンバレーの関係者の間で出回っていたものの、これまで一般に公開されたことはなかった。これらの記録の中で、アモデイは、アルトマンの目的は「安全性を重視したAI研究所(最初はそうではないかもしれないが、すぐにそうなるだろう)」を創設することだったと記している。

2015年12月、OpenAIの公式発表のわずか数時間前、アルトマンはマスクにメールを送り、ある噂について言及した。Googleは「明日、OpenAIの全員に対して大規模な買収提案を行い、組織を完全に潰そうとするだろう」とのことだった。マスク氏は「イリヤは明確な答えを出したのか?」と尋ねた。アルトマンは、サツケバーは断固として譲らないと答えた。実際、Googleはサツケバーに年間600万ドルの給与を提示しており、OpenAIはそれに匹敵する金額を提示できなかった。しかし、アルトマンは自信を失わず、「彼らが『正しいことをする』側にいないのは残念だ」と述べた。

イーロン・マスクはかつて、サンフランシスコのミッション地区にある古いスーツケース工場を改装したオフィススペースをOpenAIに提供したことがある。イリヤ・スツケバーが語ったように、当時従業員たちの間で最も重視されていたスローガンは、「君たち全員が世界を救うんだ」だった。すべてが順調に進めば、OpenAIの創設者たちは、人工知能が「ポスト希少性」のユートピアをもたらすと信じていた。それは、過酷な労働を自動化し、癌を治療し、人々により多くの余暇と豊かさをもたらすというものだ。しかし、もしこの技術が暴走したり、悪意のある者の手に渡ったりすれば、破壊は甚大なものになる可能性がある。例えば、新たな生物兵器や高度なドローン群の開発に利用されたり、人間の監視を超越して、シャットダウン後も秘密裏にサーバー上で自己複製したりするモデルが登場したり、極端な場合には、電力網、株式市場、あるいは核兵器庫を掌握することさえあり得る。

誰もがこれらの評価に同意しているわけではないが、サム・アルトマンはこのリスクに対する自身の見解を繰り返し表明している。2015年のブログ記事で、彼は超人的な機械知能は「人類を滅ぼすために悪である必要はなく、他の目的を達成する過程で無関心なまま、何気なく人類を滅ぼすこともできる」と書いた。OpenAIの共同創設者は、安全性よりもスピードを優先しないと誓約しており、同社の定款には「全人類に利益をもたらす」という法的義務が含まれている。彼らはまた、AIが史上最も強力な技術になった場合、単一の制御者が前例のない権力を得ることになるという事態を警戒している。彼らはこのシナリオを「AGI独裁」と呼んでいる。

マスク氏の退任後、ダリオ・アモデイ氏のような研究者たちはグレッグ・ブロックマン氏の経営スタイルに不満を表明し始め、彼を権威主義的だと感じる者もいた。一方、サツケバー氏は「信念は強いが、組織運営能力に欠ける」と評された。CEO就任の過程で、アルトマンは社内の様々な派閥に対して異なる約束をしているように見えた。彼は一部の研究者に対し、ブロックマンの権威を弱めると約束したが、同時にブロックマンとサツケバーとの間で「握手による合意」に達した。つまり、彼はCEOを務めるが、両者が辞任を要請すれば辞任するというものだ。(アルトマンはこの主張に異議を唱え、CEO就任を打診されたと述べている。)3人は合意の存在を認めており、ブロックマン氏はそれが非公式なものだったと述べている。「彼は一方的に、もし私たち二人が辞任を求めれば辞任すると言った。」私たちは実際にはこの考えに反対しましたが、彼はそれが自分にとって重要であり、利他主義から行ったと言いました。)その後、取締役会はCEOが実際には自分のために「影の取締役会」を設置していたことを知り、衝撃を受けました。

内部記録によると、創設チームは2017年の時点で既に非営利団体の組織形態に疑問を抱いていたことが明らかになっている。同年、マスク氏が買収を試みた後、ブロックマン氏は日記にこう記した。「我々は非営利団体であり続けたとは言えない…」もし私たちが3ヶ月以内にBコーポレーションの認証を取得できれば、これまでの発言はすべて嘘だったということになります。アモデイは初期のメモの中で、ブロックマンに最優先事項を尋ねたところ、ブロックマンは「金と権力」と答えたと記している。(ブロックマンはこの主張を否定している。)彼の日記には矛盾した考え方も表れている。一方では「他人が金持ちでないなら、自分も金持ちになりたいとは思わない」と述べ、他方では「自分が本当に欲しいものは何か?」と自問し、その答えの一つとして「経済的に10億ドルに到達すること」を挙げている。

2017年、サツケバーはオフィスで、Googleの研究者たちが提案した「新しいシンプルなネットワークアーキテクチャ、トランスフォーマー」に関する研究論文を読んだ。彼は椅子から飛び上がり、廊下に駆け出して、「今やっていることをすべて止めろ、これが答えだ!」と叫んだ。彼にとって、このアーキテクチャによってOpenAIはより複雑なモデルを訓練できるようになるだろう。この画期的な発見は、初期の生成型事前学習済みTransformerモデルの開発につながり、後にChatGPTの基盤となった。

アルトマンは以前、初期の従業員に対し、OpenAIは常に非営利団体としての純粋な性質を維持すると約束しており、そのため多くのプログラマーが大幅な減給を受け入れて同社に入社した。OpenAIはまた、約3000万ドルの寄付金を受け取った。その中には、効果的な利他主義運動における主要な資金提供拠点であり、貧困地域への蚊帳配布などのプロジェクトを長年支援してきたOpen Philanthropy組織からの寄付金も含まれている。

日々の業務は主にブロックマンとサツケバーが監督し、マスクとアルトマンはそれぞれ他の事業で忙しく、通常は週に一度会社を訪れる程度だった。2017年9月までに、マスクは焦り始めていた。OpenAIを営利企業へと移行させる可能性についての議論が持ち上がると、彼は過半数の支配権を要求した。

アルトマンの回答は状況によって異なったが、彼が一貫して主張していたのは、もし会社がCEOの下で組織再編を行うのであれば、そのCEOの地位は自分が担うべきだということだった。サツケバーはこのことについて明らかに不安を感じていた。彼は自身とブロックマンを代表して、マスクとアルトマンに「率直な考え」と題した長文のメールを送り、「OpenAIの目標は、より良い未来を作り、汎用人工知能(AGI)による独裁を回避することだ」と述べた。彼はマスク氏に向けて、「したがって、独裁者になりかねないような仕組みを作るのは悪い考えだ」と書いた。彼はアルトマン氏にも同様の懸念を表明し、「なぜCEOという肩書きがあなたにとってそれほど重要なのか、私たちには理解できません」と述べた。あなたの理由は次々と変わるので、本当の動機を見極めるのが難しいのです。

「諸君、私はもう終わりだ」とマスク氏は答えた。「君たち自身で何か別のことをするか、OpenAIの非営利団体としての地位を維持し続けるか、どちらかにしてくれ。さもなければ、私は君たちがスタートアップ企業を運営するための資金を無償で提供しているだけだ。」5か月後、彼は明らかに不満そうな様子で去っていった。(2023年には、営利企業である競合企業xAIを設立した。)翌年、彼はアルトマンとOpenAIを詐欺と慈善信託違反で訴え、自身が「巧妙に操られていた」こと、そしてアルトマンがAIリスクに対する彼の懸念を利用して資金を確保する「長期にわたる詐欺」を行ったと主張した。訴訟は現在も継続中で、OpenAIはこれらの主張を強く否定している。

技術力が向上するにつれ、OpenAIの中核を担う十数名のエンジニアが、サム・アルトマンやグレッグ・ブロックマンを含む創設チームを信頼できるかどうかについて、一連の秘密会議を非公開で話し合っていたことが明らかになった。こうした会議の一つで、ある従業員がイギリスのコメディデュオ、ミッチェル&ウェッブの風刺的な寸劇を思い出した。東部戦線のナチス兵士が突然悟りを開き、「我々が悪者なのか?」と問いかけるというものだ。

2018年までに、ダリオ・アモデイは創業者たちの動機について公然と疑問を呈し始めた。彼は後にメモにこう書いた。「すべてが終わりなき資金調達計画のように見える。」OpenAIに本当に必要なのは、明確な定義だと私は感じています。つまり、OpenAIが何をしたいのか、何をしたくないのか、そしてOpenAIの存在がどのように世界をより良くするのか、ということです。同社は既に「汎用人工知能が全人類に利益をもたらすことを確実にする」というミッションステートメントを掲げていたにもかかわらず、アモデイ氏は、このステートメントが経営陣に明確に伝わっていないと感じていた。

2018年初頭、彼は会社の定款の草案作成に着手し、アルトマンとブロックマンとの数週間にわたる議論の後、最も過激な条項の一つを盛り込むよう働きかけた。それは、「価値観が一致し、安全性を重視するプロジェクト」がOpenAIよりも汎用人工知能(AGI)の実現に近ければ、同社は「競争をやめ、代わりにそのプロジェクトを支援する」というものだった。これは「合併・支援」条項として知られており、例えば、Googleが先に安全な汎用人工知能(AGI)を実現した場合、理論的にはOpenAIは解散し、リソースをGoogleに譲渡することになる。従来のビジネスの観点からすれば、このような取り組みはほとんど考えられないことだったが、OpenAIはそもそも従来型の企業になることを目指していなかった。

この前提は、2019年春に現実を突きつけられた。当時、OpenAIはマイクロソフトと最大10億ドルの投資の可能性について協議していた。アモデイ氏(当時、安全チームを率いていた)はビル・ゲイツ氏にこのプロジェクトを売り込むことに携わっていたものの、マイクロソフトがOpenAIの倫理的コミットメントを弱めるような条件を提示するのではないかという不安がチーム内には依然として存在していた。アモデイ社は、アルトマン氏に安全要件の優先順位リストを提出し、その中で「合流・支援」条項を最優先事項とした。

アルトマンは当時、これに同意した。しかし、6月に取引が完了に近づくにつれ、アモデイ氏は、マイクロソフトがOpenAIの合併を拒否する権限を持つという新たな条項が契約書に含まれていることを発見した。「これは憲章の80%に相当した」と彼は後に振り返った。彼はこの件についてアルトマンに問い詰めたが、アルトマンは当初、そのような条項の存在を否定した。アモデイはその場で契約書を逐語的に読み上げたが、最終的には別の同僚にアルトマンに直接確認してもらう必要があった。(アルトマン氏は、この出来事については覚えていないと述べた。)

安全の流出と人間活動の誕生

アモデイのメモには、緊迫した対立がエスカレートしていく様子も記録されていた。数か月後の会議で、アルトマンは彼と、同じく同社で安全と政策を担当していた彼の妹ダニエラを呼び出し、「上級幹部」から、二人が「クーデター」を計画しているという信頼できる情報を受け取ったと主張した。メモには、ダニエラはその場で「感情的に圧倒され」、その幹部を呼び寄せたが、幹部はそんなことは言っていないと否定したと記されていた。この件に詳しい関係者によると、アルトマンは後にこの告発をしたことを否定したという。「私はそんなことは言っていません。」ダニエラは「あなたは今まさにそうしたわ」と答えた。(アルトマンは自身の記憶が若干異なり、アモデイを「政治的な行動」をとったと非難しただけだと主張した。)2020年、アモデイ、ダニエラ、そして数人の同僚は会社を去り、アントロピックを設立した。アントロピックはその後、OpenAIの主要な競合企業の1つとなった。

一方、アルトマン氏は、特に採用候補者がいる場において、OpenAIが安全対策に尽力していることを改めて強調した。2022年末、4人のコンピュータ科学者が「欺瞞的なアライメント」のリスクを提唱する論文を発表した。高度なモデルはテスト中は優れた性能を発揮するかもしれないが、実際の展開後には独自の目的を追求する可能性があるというのだ。(一見SFのようなこのシナリオは、特定の実験条件下では既に発生している。)論文発表から数週間後、著者の1人であるカリフォルニア大学バークレー校の博士課程学生は、アルトマンからメールを受け取った。アルトマン氏は「方向性の定まらないAI」の脅威に対する懸念を強めており、この問題に対処するために10億ドルを投資することを検討している。例えば、世界的な研究賞を設立することなどが挙げられる。この学生は「サムは少しずる賢い」という噂を聞いていたものの、彼の熱意に感銘を受け、最終的に学業を中断してOpenAIに加わることを決意した。

しかし、2023年春に複数回行われた会合を経て、アルトマンの態度は変化したように見えた。彼はもはや賞の創設については言及せず、代わりに社内に「スーパーアライメントチーム」を設立することに着手した。公式発表によると、同チームは「会社の確保されたコンピューティングリソースの20%」を受け取ることになり、その価値は10億ドルを超える可能性があるという。また、この発表では、アライメントの問題が解決できない場合、汎用人工知能(AGI)は「人類の力を奪い、あるいは絶滅にまで至る可能性がある」と強調された。チームを率いていたヤン・ライケは後に、「それは実に効果的な人材維持戦略だった」と述べた。

しかし、「コンピューティング能力20%向上」という約束は果たされなかった。チームに関わっている、あるいはチームを綿密に追跡している4人の人物は、実際に割り当てられたリソースは、会社の総コンピューティング能力のわずか1~2%に過ぎないと述べた。さらに、ある研究者は「いわゆるスーパーアライメント計算のほとんどは、実際には最も古く、最も性能の低いクラスター上で実行されている」と指摘した。チームメンバーは概して、より高度なハードウェアは収益を生み出すプロジェクトに優先的に使用されると考えていた。(OpenAIはこのことを否定した。)ライケはこの件を当時の最高技術責任者であるミラ・ムラティに提起したが、それ以上追求する必要はない、この約束は最初から「非現実的」だという返答だった。

この頃、元従業員の一人が、イリヤ・スツケバーが「安全対策を非常に重視し始めた」と語っていた。OpenAIの初期の頃、彼は壊滅的なリスクは妥当な懸念事項だと考えていたものの、それはまだやや遠い未来のことだと捉えていた。しかし、汎用人工知能(AGI)が近づいていると徐々に確信するようになるにつれ、この懸念は急速に高まっていった。その従業員の記憶によると、全社員が集まった会議で、「イリヤが立ち上がり、『今後数年のうちに、会社のほぼ全員が安全管理業務に切り替えなければならなくなるだろう。さもなければ、我々は終わりだ』と言った」とのことだ。しかし、翌年、この「超連携チーム」は任務を完了する前に解散した。

現時点で、社内コミュニケーションによると、経営陣や取締役会メンバーは、サム・アルトマンの隠蔽行為や誤解を招くような行動が、OpenAI製品の安全性に重大な影響を与える可能性があると考え始めている。2022年12月の会議で、アルトマン氏は取締役会に対し、今後登場するGPT-4の複数の機能が安全委員会によって承認されたことを保証した。理事会メンバーでAI政策の専門家であるヘレン・トナー氏は、関連文書の閲覧を求めたが、最も物議を醸している2つの機能――ユーザーがモデルを「微調整」できる機能と、パーソナルアシスタントとして展開できる機能――が実際には承認されていなかったことを発見した。会議後、別の取締役である起業家のタシャ・マコーリーは、従業員に呼び止められ、「インドでのコンプライアンス違反事件」について知っているかと尋ねられた。アルトマン氏は、複数の取締役会報告の中で、マイクロソフトが必要な安全審査を完了せずにインドでChatGPTの初期バージョンをリリースしたことについて、一度も言及していなかった。「これはほとんど完全に隠蔽されてしまった」と、当時OpenAIの研究員だったジェイコブ・ヒルトンは語った。

これらの問題は直接的に安全事故にはつながらなかったものの、研究者のキャロル・ウェインライト氏は、これらは「製品優先でセキュリティが軽視される」という傾向の継続を反映していると考えている。GPT-4のリリース後、セキュリティ業務を担当していたヤン・ライケは取締役会に次のような書簡を送った。「OpenAIは本来の使命から逸脱している。」私たちはまず製品と収益を最優先事項とし、次に能力、研究、規模拡大、そして最後に連携と安全性を優先します。彼はまた、「Googleのような企業は教訓を学んでいる。セキュリティ上の懸念を軽視しながら、導入を加速させている」と指摘した。

マコーリー氏は理事会メンバー宛てのメールの中で、「我々は確かに、より厳格な監督が必要な段階にあると確信している」と記した。しかし、理事会がこの問題に対処しようとした際、彼らは明らかに不利な立場にあった。「率直に言って、彼らは実社会での経験が不足している集団だ」と、元理事のスー・ユン氏は述べた。2023年、同社はGPT-4 Turboのリリース準備を進めていた。サツケバーがメモで説明したところによると、アルトマンはミラ・ムラティに対し、このモデルはセキュリティ承認を必要としないと伝え、この決定は同社の法務顧問であるジェイソン・クォンによるものだと述べたという。しかし、ムラティがSlackでクォンに尋ねたところ、彼は「えっと…」と答えた。サムがなぜそう思ったのか、私にはよく分かりません。(OpenAIはこの件について「重大なことではない」と述べています。)

その後まもなく、取締役会はアルトマンの解任を決定したが、彼はその後、いかに迅速にその決定を覆したかを世界は目の当たりにした。OpenAIの定款は公式ウェブサイトで今も閲覧可能だが、同社のガバナンス文書に詳しい関係者によると、その内容は骨抜きにされ、ほとんど意味をなさなくなっているという。昨年6月、アルトマンは自身のブログ記事で超知能について次のように書いた。「我々は事象の地平線を越えた。離陸が始まった。」

当初の定款によれば、これは同社が競争をやめ、協業へと移行するための転換点となるはずだった。しかし、「穏やかな特異点」と題された記事では、彼は全く新しいトーンを採用し、「実存的不安」を「楽観的な想像力」に置き換えた。「私たちは皆、より良いものを手に入れ、互いのためにますます良いものを創造していくでしょう。」彼は、位置合わせの問題は未解決のままだと認めつつも、それを「厄介なもの」と再定義し、インスタグラムのおすすめアルゴリズムに依存するのと似たようなものだと述べた。

アルトマンはしばしば、畏敬の念や懐疑的な見方を交えながら、「同世代で最も力強いストーリーテラー」と評される。彼が尊敬していたスティーブ・ジョブズは、かつて「現実歪曲フィールド」を持ち、絶対的な自信をもって世界を自らのビジョン通りに形作っていたと考えられていた。しかし、ジョブズでさえユーザーには決して言わなかった。「もし彼の製品を買わなければ、人類は滅亡するかもしれない」と。2008年、わずか23歳だったアルトマンは、彼の師であるポール・グラハムによって次のように評された。「彼を人食い族の島に放り込んで、5年後に戻ってきたら、彼は王様になっているだろう。」この評価は、当時の彼の業績に基づくものではなく、彼のほぼ無制限の意志力に基づくものだった。

しかし、彼と最も密接に仕事をしてきた人々の中には、この特性には別の側面もあると考える者もいる。サツケバーはAIの安全性についてますます不安を募らせ、アルトマンとグレッグ・ブロックマンに関する一連のメモをまとめた。これらの文書はシリコンバレーで非常に重要な意味を持つため、「イリヤ・メモ」と呼ばれることもある。

一方、ダリオ・アモデイは記録を続けていた。これらの資料は、いわゆる「決定的な証拠」を提供するものではなかったが、一見散在しているように見えるものの、徐々に蓄積されていく一連の行動パターンを示していた。例えば、異なる人物に同じ役職を提示したり、公開情報について矛盾した説明をしたり、セキュリティプロセスについて曖昧な態度をとったりといったことである。サツケバー氏は、この行動は「安全な汎用人工知能(AGI)に適した環境を構築しない」と結論づけた。アモデイ氏はさらに直接的に、「OpenAIの問題はサム自身にある」と述べている。

私たちは、アルトマン氏の手法をよく知る100人以上の人々にインタビューを行った。OpenAIの現従業員や元従業員、取締役、同僚や競合相手、友人や敵など、シリコンバレーでは多くの人が複数の役割を兼任している。彼のビジネス手腕を擁護する者もおり、サツケバーとアモデイは単なる失敗した競争相手だと考える者もいた。一方、彼を世間知らずでうっかり者の科学者、あるいは「終末論」に囚われた過激派と見る者もいた。ユンは、アルトマンは「マキャベリ的な悪人」ではなく、自身の物語に確信を抱いている人物だと考えていた。「彼は自己信念に深く浸りきっているため、現実世界では理解できないような決断を下す。しかし、そもそも彼は現実世界に生きていないのだ。」

しかし、ほとんどのインタビュー対象者の判断は、スツケバーとアモデイの判断と類似している。アルトマンは極めて強い意志の持ち主であり、ロケットに名前が刻まれるような産業界の大物の中でも際立っている。「彼は『現実』に縛られない」とある理事は語った。「彼はめったに同時に現れない二つの特質を持っている。一つは人に好かれたいという強い願望、あらゆる場面で相手を喜ばせたいという欲求。もう一つはほとんど反社会的で、他人を欺くことの結果を気にしない。」

複数のインタビュー対象者が、自発的に「反社会性パーソナリティ」という言葉を使った。Y Combinatorの第1期生の一人であるアルトマンは、後に2013年に自殺したプログラマーのアーロン・スワルツの同僚だった。スワーツは亡くなる前に、友人にアルトマンについて懸念を表明していた。「サムは決して信用してはいけないということを理解してください。」彼は反社会的な性格で、何でもやりかねない。マイクロソフトの複数の幹部も、サティア・ナデラが長年にわたりアルトマンを支持してきたにもかかわらず、両者の関係は緊張し始めていると述べている。「彼は誤解を招いたり、歪曲したり、再交渉したり、あるいは合意を覆したりすることさえあるだろう」とある幹部は述べた。今年初め、OpenAIはMicrosoftを自社の「ステートレスモデル」の独占的なクラウドサービスプロバイダーとして再確認したが、同日、Amazonとの5000億ドル規模の提携を発表し、Amazonを同社のエンタープライズAIプラットフォームの独占的な再販業者とした。この取り決めは契約違反ではなかったものの、マイクロソフトは潜在的な利益相反があると判断した。(OpenAIは契約違反はしないと表明した。)その幹部はさらに、「将来、彼がバーニー・マドフやサム・バンクマン=フリードのような人物と見なされる可能性は十分にあると思う」とコメントした。

アルトマンは技術的な天才ではない。多くの同僚の目には、彼のプログラミングや機械学習における専門的な能力は限られており、基本的な概念さえ混同しているように見える。彼は、他者の資金や技術リソースを統合することで、OpenAIをほぼ完全に構築した。これは珍しいことではない。これこそが起業家の役割なのだ。さらに注目すべきは、相反する意見を持つエンジニア、投資家、そして一般の人々を説得し、自分の優先事項が彼らの優先事項でもあると納得させる彼の能力である。こうした人々が彼を止めようとすると、彼は適切な弁舌で状況を沈静化させることが多く、少なくとも一時的にはそうすることができる。そして、相手が問題に気づく頃には、彼はすでに目的を達成しているのが常である。「彼は紙の上で未来の自分を制約するための構造をいくつか設計するだろう」とウェインライトは述べた。「しかし、未来が実際に到来し、制約する必要が生じたとき、彼はそれらの構造を一つずつ解体していくだろう。」

「彼の説得力は信じられないほど強力で、まるでジェダイの精神操作のようだ」と、彼と一緒に仕事をしたことのあるあるテクノロジー企業の幹部は語った。「全く別次元の力だ。」AIの協調に関する研究には、古典的な概念が存在する。それは、人類の意志と強力なAIとの対立であり、後者がほぼ必然的に勝利するというものだ。まるでチェスのグランドマスターが子供に勝つようなものだ。そして、その幹部の見解では、アルトマンが「ブリップ」事件の際に様々な関係者の間を巧みに渡り歩く様子は、「汎用人工知能が檻から解き放たれるのを見ているようだった」という。

解雇後、サム・アルトマンは自身に対する疑惑に関する調査が行われないよう、あらゆる手段を講じていた。彼は2人の人物に対し、捜査が行われているという事実だけでも自分が有罪に見えてしまうのではないかと懸念していると打ち明けていた。(アルトマンはこの発言をしたことを否定している。)しかし、辞任した取締役たちが、彼の辞任の条件として「独立した調査が行われるべきだ」と主張したため、アルトマンは最終的に「最近の出来事」の「検証」に同意した。交渉に詳しい関係者によると、新たに加わった2人の取締役は、この見直しを自ら主導することを強く主張したという。

ローレンス・サマーズは、政界とウォール街における自身のコネクションを駆使し、この批評にある程度の信憑性を与えたように見えた。(昨年11月、サマーズ氏は、若い弟子との関係を深める過程でジェフリー・エプスタイン氏にメールで助言を求めていたことが公に明らかになった後、取締役を辞任した。)OpenAIは最終的に、この調査を担当させるために著名な法律事務所であるウィルマーヘイルを起用した。同社は過去にエンロンとワールドコムの内部調査を主導した実績がある。

調査過程に深く関わった6人の関係者は、今回の調査は透明性を制限することを目的としているように見えると述べた。捜査官らは当初、社内の主要人物数名に接触していなかったと指摘する声もあった。ある従業員は、サマーズ氏とブレット・テイラー氏に連絡を取り、懸念を表明するまでに至った。「彼らは取締役会を巡る騒動が起きた短い期間にしか興味がなく、サムの長年にわたる倫理問題には全く関心がなかった」と、その従業員は調査員との面談中に感じたことを振り返った。また、匿名性が十分に保護されていないと感じたため、アルトマンに関する懸念を表明することをためらう人もいた。「あらゆる兆候から見て、彼らはあらかじめ決められた結論、つまり彼を無罪にすることを望んでいるようだ」と従業員は述べた。(しかし、このプロセスに関わった弁護士の中には、この調査を「独立性があり、徹底的で、包括的であり、事実に基づいている」と擁護する者もいた。)テイラー氏はまた、この調査は「徹底的かつ独立したものだった」と述べた。

社内調査の役割は、多くの場合、意思決定を正当化するのに役立つ。非公開企業では、調査結果が書面による報告書にすら至らない場合があり、これは法的責任を軽減する手段となる。しかし、世間の論争が絡むような事案では、通常、より高いレベルの透明性が求められる。2017年、トラビス・カラニックがウーバーを退任する前に、取締役会は外部の調査会社を雇い、調査結果の概要をまとめた13ページの報告書を公表した。OpenAIが501(c)(3)非営利団体であること、そして今回の解雇が非常に注目を集めたことを考慮すると、社内の多くの幹部は当初、詳細な調査報告書が発表されることを予想していた。しかし、2024年3月までに、OpenAIは正式な報告書を一切公表することなく、アルトマン氏の「潔白」を発表しただけで、ウェブサイト上で約800語で「信頼関係の崩壊」を認めたに過ぎなかった。

元同僚たちでさえ、その余波を感じている。ミラ・ムラティは2024年にOpenAIを退社し、自身のAIスタートアップを立ち上げた。その後、アルトマンの親しい盟友であるジョシュ・クシュナーが彼女に電話をかけた。彼はまず彼女のリーダーシップを称賛したが、その後、彼女の「評判」に対する「懸念」を表明し、かつての同僚の中には彼女を「敵」と見なしている者もいると述べ、遠回しな脅迫を行った。(クシュナー氏は広報担当者を通じて、この話は「全容を伝えていない」と述べ、一方アルトマン氏はその電話について知らなかったと主張した。)

アルトマンはCEO就任初期に、非営利団体が保有する「利益上限付き」の会社をOpenAIが設立すると発表した。この複雑に入り組んだ、ほとんどねじれたような企業構造は、どうやらアルトマン自身が考案したものだったようだ。移行期間中、ホールデン・カーノフスキーという名の理事は、この取り決めは非営利団体の価値を著しく過小評価しているとして反対意見を表明した。「良心に照らして、これには賛同できない」とカルノフスキー氏は述べた。当時の記録によると、彼は反対票を投じた。しかし、理事会の弁護士が彼の反対意見は「新体制の合法性に関するさらなる調査のきっかけとなる可能性がある」と示唆した後、彼の投票は最終的に棄権として記録され、本人の同意なしに行われたようで、商業記録の改ざんに該当する可能性さえある。(OpenAIは、複数の従業員がカルノフスキー氏が棄権したことを覚えていると述べ、その証拠として会議議事録を提出した。)

昨年10月、OpenAIは「資本再編」を行い、営利企業となった。同社は、傘下の非営利団体(現在はOpenAI Foundationと改称)が、史上最も裕福な組織の一つになると公に表明した。しかし、現在、この財団が保有する同社の株式はわずか26%であり、理事のうち1名を除く全員が営利企業の取締役も兼任している。

議会公聴会で、アルトマン氏は「多額の金を稼いだのか」と問われた。彼は「私はOpenAIの所有権を一切持っていません…」と答えた。私がこれをやっているのは、それが好きだからだ。Y Combinator関連のファンドを通じて間接的に出資していることを考えると、この回答は非常に慎重なものだったと言えるだろう。技術的には、それは正しい。しかし、アルトマン氏を含む数名が、この状況は近いうちに変わる可能性が高いと示唆している。「投資家は『状況が厳しくなった時でも、あなた方はこれをやり遂げるつもりなのか』と言うだろう」とアルトマン氏は述べたが、現時点ではそれに関する「活発な議論」は行われていないとも付け加えた。法廷証言によると、グレッグ・ブロックマンの持ち株は約200億ドル相当であり、アルトマンの持ち株は理論的にはそれよりも高いはずだ。しかし、アルトマンは、富は彼にとって最大の動機ではないと語った。元従業員は彼が「お金には興味がない」と言っていたことを覚えている。私は権力の方をより重視する。

2023年、アルトマンとオリバー・マルヘリンはハワイの自宅でささやかな結婚式を挙げた。(二人は9年前、ピーター・ティールの家の深夜のジャグジーで出会った。)彼らはその邸宅で多くの客をもてなしており、私たちがインタビューした訪問者たちが語った光景は、超富裕層のライフスタイルの一般的な範囲を超えるものではなかった。例えば、専属シェフが用意した夕食、夕日を眺めながらのボートトリップなどだ。リアリティ番組「サバイバー」をテーマにした新年パーティーが開催され、写真には番組司会者のジェフ・プロブストを含む、上半身裸で笑顔の男性たちのグループが写っていた。アルトマンは他の所有物件でも小規模な集まりを主催しており、少なくとも1回は白熱したストリップポーカーが行われた。(流出した写真にはアルトマンの姿は写っていなかったため、最終的に誰が勝ったのかは不明だが、少なくとも3人の男性は明らかに敗北したように見えた。)インタビューを受けた元宿泊客の多くは、ただ一つだけ口にしていた。それは、彼が実に気前の良いホストだったということだ。

調査に関わった関係者によると、正式な書面による報告書は作成されなかったため、報告書も発行されなかったという。いわゆる調査結果は、サマーズ氏とテイラー氏には口頭で伝えられただけだった。「調査の結果、『サムはジョージ・ワシントンが桜の木を切り倒した時と同じくらい正直だ』という結論には至らなかった」と、捜査関係者は述べた。しかし全体的に見ると、調査はアルトマン氏の解任の背景にある「倫理問題」に真に焦点を当てたものではなく、むしろ明確な犯罪行為があったかどうかを判断することにかなりの労力が費やされたようで、その基準の下では、最終的に彼はCEOとして留任できるという結論に至った。その後まもなく、アルトマンは解任によって失った取締役の座を取り戻した。関係者によると、調査結果を文書化しなかった理由の一つは、サマーズ氏とテイラー氏のそれぞれの私選弁護士からの助言によるものだったという。(サマーズ氏は本件について公にコメントすることを拒否した。テイラー氏は、口頭での説明があったため、「正式な書面による報告書は不要だった」と述べた。)

OpenAIの現従業員および元従業員の多くが、情報公開の欠如に衝撃を受けたと語っていた。アルトマン氏は、自身の復職後に加わったすべての理事は、これらの問題について口頭で説明を受けていたと信じていると述べた。「これは真っ赤な嘘だ」と、状況を知る関係者の一人は語った。また、一部の取締役は、これらの「調査結果」の信憑性に関する疑問が続いているため、将来的に「調査のやり直し」が必要になる可能性もあると述べた。

書面による記録がなければ、こうした疑惑は軽視されやすくなる。一方、アルトマンのシリコンバレーにおける地位の上昇は、これらの問題に対する外部からの監視をさらに弱める結果となった。彼と仕事をしたことのある著名な投資家数名が、アルトマンの広く知られた癖について語ってくれた。それは、投資家がOpenAIの競合企業に投資した場合、後になってその投資家を「ブラックリスト」に載せる可能性があるというものだった。「もし彼らがサムの気に入らないプロジェクトに投資したら、その後、他のどんな機会にも参加できるとは思わない方がいい」と、彼らのうちの一人が言った。アルトマンの権力のもう一つの源泉は、彼の広範な投資ネットワークであり、それは時に彼の私生活にまで及んでいた。彼は複数の元パートナーと金銭的な関係を持っていた。その中にはファンドの共同運用に関わるもの、彼が投資を主導するもの、そして頻繁に共同投資を行うものなどがあった。この慣習はシリコンバレーでは珍しいことではない。多くの異性愛者の経営幹部も同様のやり方で仕事をしている。(ある著名なCEOは私たちに「そうするしかないんだ」と語った。)アルトマン自身は、「別れた後も元恋人と投資をしたことは事実だが、それは全く問題ないと思う」と述べている。しかし、この仕組み自体が非常に高いレベルの依存関係を生み出す。「これは根本的に非常に強い依存を生み出し、多くの場合、生涯にわたる依存にまで発展する」と、アルトマンに近い人物は語った。

しかしながら、サム・アルトマンの私生活に関する様々な噂は、競合他社によって悪用され、歪曲されて伝えられてきた。激しいビジネス競争は何も新しいことではないが、人工知能業界における競争は極めて熾烈なものとなっている。OpenAIの幹部は「シェイクスピア的だ」と表現し、「従来のルールはもはや通用しないようだ」と付け加えた。イーロン・マスクと直接関係のある仲介者の中には、場合によっては彼から資金提供を受けている者もおり、アルトマンに関する数十ページに及ぶ「反対派調査」資料を配布している。これらの資料は、高度な監視が行われていたことを示している。彼に関連するペーパーカンパニー、親密な連絡先情報、さらにはゲイバーのいわゆるセックスワーカーとのインタビュー記録まで含まれている。ある仲介者は、アルトマンのフライトスケジュールや出席したパーティーが追跡されていたと主張した。アルトマンは私たちにこう語った。「私自身以上に、私のことを調査するために雇われた人はいないように感じます。」

一方、様々な過激な非難も広まっている。右派メディアのパーソナリティであるタッカー・カールソンは、何の証拠もないまま、アルトマンが内部告発者の死に関与していたと示唆しており、競合他社はこの主張を繰り返し増幅させている。アルトマンの妹アニーは、訴訟の中で、また我々とのインタビューの中で、彼女が3歳の時、彼が12歳の時から性的虐待を受けていたと述べている。(アニーの主張を検証することはできませんでした。)アルトマンはこの疑惑を否定しており、彼の母親と兄弟も、これらの告発は「全くの事実無根」であり、家族全員に「計り知れない苦痛」をもたらしたと述べている。ジャーナリストのカレン・ハオが著書『AI帝国』のために行ったインタビューの中で、アニーはこれらの記憶は成人してから「フラッシュバック」として蘇ったと述べている。

さらに、競合他社や投資会社の複数の関係者からも、アルトマンが未成年者との性行為に関与していたという示唆があった。これはシリコンバレーで広く流布している主張だが、同様に根拠がないように思われる。私たちは数ヶ月かけて調査を行い、数十件の聞き取り調査を実施しましたが、この主張を裏付ける証拠は一切見つかりませんでした。アルトマン氏は、「これは卑劣な戦術であり、競合他社が将来の裁判のために陪審員候補者を『毒する』ことを企んでいるのだと私は考えている」と反論した。ばかげているように聞こえるかもしれないが、あえて言っておきたい。私が未成年者と性的関係を持った、性労働者を雇った、あるいは殺人に関与したという主張は、すべて全くの事実無根だ。彼はまた、私たちが「これほど多くの月日をかけてこれらの事柄を深く調査してくれたこと」に「多少感謝している」とも付け加えた。

サム・アルトマンは、成人年齢に達した若い男性と交際していたことを認めている。私たちは彼のビジネスパートナー数名にインタビューを行ったが、彼らは皆、この件に問題はないと考えていると述べた。しかし、イーロン・マスク陣営による「反対派調査」は、これを意図的に攻撃材料として利用した。(これらの資料には、いわゆる「トゥインク軍団」や「シュガーダディの性的嗜好」といった、センセーショナルで未確認の主張も含まれていた。)アルトマンはこれに対し、「ここには誇張された同性愛嫌悪がかなり混ざっている」と答えた。テクノロジー系ジャーナリストのカラ・スウィッシャーも同意見だ。「これらの金持ちたちは、ありとあらゆるとんでもないことをやってきた。サムについて私が聞いたどんなことよりも、もっととんでもないことだ。」しかし、彼がサンフランシスコに住むゲイ男性であるということが、攻撃の武器として利用されているのだ。

過去10年間、ソーシャルメディア企業の幹部たちは、ほとんど副作用なく「世界を変えることができる」と約束し、規制当局の要求を「ラッダイト運動」と一蹴し、最終的には超党派の怒りを招いた。それとは対照的に、アルトマンの作品は特に「自己認識」に満ちているように見えた。彼は規制を避けるどころか、積極的に規制を求めた。2023年、彼は米国上院司法委員会での証言において、高度なAIモデルを規制するための新たな連邦機関の設立を提案した。「この技術が誤作動を起こせば、非常に深刻な結果を招くだろう」と彼は述べた。ルイジアナ州選出の上院議員で、ハイテク企業のCEOに対する辛辣な発言で知られるジョン・ケネディ氏でさえ、やや好意的な様子を見せ、半ば冗談めかしてアルトマン氏自身が規制を担当すべきだと示唆した。

しかし、アルトマンは公には規制を支持していたものの、裏では規制に反対するロビー活動も行っていた。タイム誌によると、OpenAIは2022年から2023年にかけて、大手AI企業を対象とした欧州連合の規制案を骨抜きにすることに成功した。2024年、カリフォルニア州議会はAIモデルのセキュリティテストを義務付ける法案を提出したが、その多くはアルトマン氏が議会で提唱していた内容と酷似していた。OpenAIは法案に公然と反対し、水面下で圧力をかけた。「その年を通して、OpenAIの行動はますます狡猾で人を欺くものになっていった」と、ある立法補佐官は私たちに語った。

一方、マスク氏はアルトマン氏を「詐欺師アルトマン」「詐欺師サム」などと呼び、公然と攻撃を続けた。(アルトマン氏がXでテスラ車の不具合について苦情を述べた際、マスク氏は「あなたは非営利団体から盗んだ」と反論した。)しかし、ワシントンではアルトマン氏が優勢に見えた。マスク氏はかつてドナルド・トランプ氏の再選を支援するために2億5000万ドル以上を拠出し、短期間ホワイトハウスで勤務した後、退任したことでトランプ氏との関係が悪化した。

現在、アルトマンはトランプのお気に入りのテクノロジー界の大物の一人となり、トランプと共にイギリスのウィンザー城を訪れることさえある。二人は年に数回話をする。「直接電話すればいいですよ」とアルトマンは言った。「そういう種類の友情ではないけれど、何か彼に相談したいことがあれば電話するよ。」昨年トランプ大統領がホワイトハウスでテクノロジー業界のリーダーたちを招いた際、マスク氏は欠席し、アルトマン氏が大統領の向かい側に座っていた。「サム、君はすごい人物だ」とトランプは彼に言った。「あなたは以前、信じられないようなことを私に話してくれましたね。」

投資家のロン・コンウェイは、ナンシー・ペロシやギャビン・ニューサムといった政治家にも働きかけ、前述の法案の否決を促した。最終的に、この法案は超党派の支持を得て可決されたものの、ニューサム知事によって拒否権が行使された。今年、AI規制を支持する一部の連邦議会議員候補者は、AI推進派のスーパーPACである「Leading the Future」から資金提供を受けた反対派と対峙した。OpenAIは公式にはそのような組織には寄付しないと表明したが、共同創設者のグレッグ・ブロックマンは5000万ドルの寄付を約束した。(同年、彼と妻はトランプ氏を支持するスーパーPACに2500万ドルを寄付した。)

OpenAIの活動は、従来のロビー活動の域を超えている。昨年、カリフォルニア州上院が法案の修正案を提出した際、法案の起草に関わっていた公益団体の弁護士、ネイサン・カルビンは、自宅での夕食中にOpenAIから召喚状を受け取った。同社は、マスク氏が密かに批判者への資金提供を行っているかどうかを調査するためだと主張したが、法案に関するカルビン氏のすべての私的な通信記録を要求した。「彼らは直接、我々がマスク氏から金銭を受け取ったかどうか尋ねればよかったのに。我々は全く受け取っていない」と彼は述べた。法案の支持者や、OpenAIの商業化への移行を批判する人々も、同様の召喚状を受け取った。「彼らはこれらの人々を脅迫して黙らせようとしている」と、公益団体の代表であるドン・ハワードは述べた。(OpenAIは、これは通常の法的手続きの一環であると述べている。)

政治的立場に関して言えば、アルトマンは長年民主党を支持してきた。彼は「恐怖を煽って弱者を抑圧する権威主義的な支配者には、非常に警戒している。これは私の性的指向というよりも、むしろユダヤ教の背景に起因するものだ」と述べている。2016年にはヒラリー・クリントンを支持し、トランプを「アメリカにとって前例のない脅威」と呼んだ。2020年には民主党とバイデン陣営の選挙資金に寄付を行った。ジョー・バイデン氏は大統領在任中、政策協議のためにホワイトハウスを複数回訪問し、連邦レベルで初のAIセキュリティ規制枠組みの策定を推進した。

しかし、2024年までにバイデン氏の支持率が低下するにつれ、アルトマン氏の姿勢も変化し始めた。「選挙結果がどうであれ、アメリカは大丈夫だろう。」トランプ氏の勝利後、彼は就任式資金として100万ドルを寄付し、就任式ではインターネットセレブのジェイク・ポールとローガン・ポールと共に写真を撮った。Xについて彼はこう書いた。「最近@potusをより注意深く観察するようになったが、彼に対する私の認識が大きく変わった(もっと早く独自に考えていればよかった…)。」トランプ氏は就任初日に、バイデン政権時代に出されたAI関連の大統領令を撤回した。ある元政府高官は、「彼はトランプ政権を自分に有利に働かせる効果的な方法を見つけた」とコメントした。

アルトマンは長年にわたり、汎用人工知能(AGI)の開発を「マンハッタン計画」になぞらえてきた。J・ロバート・オッペンハイマーがかつて「ナチスに対抗する」という使命感を持って科学者たちを動員したように、アルトマンもまた地政学的な競争という物語を利用して支持を集めている。彼は、異なる聴衆を前にして、このたとえ話を柔軟に使い分け、時には加速を強調し、時には慎重さを強調する。2017年夏、彼は米国の情報機関関係者との会合で、中国が「汎用人工知能(AGI)マンハッタン計画」を開始したと主張し、これを利用して政府からの資金援助を求めた。証拠を提示するよう求められた際、彼は「いくつか耳にしたことがある」と述べるにとどまり、具体的な証拠は一切提示しなかった。調査に関わった政府関係者は後に、そのような計画は発見されなかったと述べた。「これはまるでセールストークのようだ。」(アルトマンは、そのような言い方をした記憶はないと主張した。)

安全保障に関心の高い聴衆を前にすると、彼は逆に国際的な連携の重要性を強調した。2017年、アモデイは公益弁護士のペイジ・ヘドリーを政策・倫理アドバイザーとして採用した。ヘドリー氏は社内プレゼンテーションの中で、壊滅的なAI軍拡競争を回避するために、NATOのような国際的な調整メカニズムを確立できる可能性があると示唆した。しかし、彼女の記憶によれば、ブロックマンはこのことを気にしていなかった。「私が何を言っても、彼はいつも同じ質問に戻ってきました。『どうすればもっと資金を得られるのか?』と。」どうすれば勝てるのか?複数のインタビューや記録に基づき、ブロックマンはさらに別のアイデアも提案した。それは、米国、中国、ロシア間の入札合戦から利益を得るというものだ。「核兵器時代がこのように機能するのなら、AIもそうではないだろうか?」

彼は当時ショックを受けた。「彼らはこの前提を否定さえしなかった。『我々は史上最も破壊的な技術かもしれないものについて議論している。もしそれをウラジーミル・プーチンに売ったらどうなるだろうか?』」(ただし、グレッグ・ブロックマンは、AIモデルを政府に「競売」することを真剣に検討したことは一度もないと述べている。)「我々は、国際宇宙ステーションに似たAI協力メカニズムなど、マクロレベルでの潜在的な協力枠組みについて議論していたに過ぎない」と、OpenAIの広報担当者は述べた。「これを別のものとして描くのは全くばかげている。」

ブレインストーミングでは、最初は突飛なアイデアが生まれることが多い。ペイジ・ヘドリーは当初、後に内部で「国別計画」と呼ばれることになるこの構想がすぐに棚上げされることを望んでいた。しかし、当時の複数の関係者や関連記録によると、OpenAIの幹部たちはこのアイデアにますます熱意を燃やすようになったという。当時の政策責任者であるジャック・クラークは、ブロックマンの目標は「囚人のジレンマに似た状況を作り出し、すべての国が我々に資金提供せざるを得ない状況を作り出すこと」であり、「この構造の中では、我々に資金提供しないこと自体が危険な行為となる」と述べた。ある若手研究員は、社内会議でこの計画の詳細な説明を聞いたとき、「これは全くもって狂気の沙汰だ」と思ったと回想している。

経営陣は、少なくとも1人の潜在的な資金提供者とこの計画について話し合った。しかし、その月の後半、数名の従業員が辞職の意向を表明したため、計画は中止された。「サムはチームメンバーを失うだろう」とヘドリーは言った。「彼の計算では、常に『この計画は重大な権力闘争を引き起こす可能性があるから、本質的に不合理だ』という点よりも、そちらの方が重要だったように感じました。」

「国別計画」は頓挫したものの、サム・アルトマンはこのアイデアの派生形を諦めなかった。2018年1月、彼は「AGI」を招集した。ロサンゼルスのホテル・ベルエアで開催される「週末」イベント。このハリウッド風リゾートは、ピンクのブーゲンビリアが咲き誇る庭園と、本物の白鳥が泳ぐプールで有名だ。出席者には、オックスフォード大学の哲学者でAIリスクの「預言者」であるニック・ボストロム氏、UAEのAI推進派であるオマル・アル・オラマ氏、そして少なくとも7人の億万長者が含まれていた。セキュリティ問題を懸念する人々にとって、このイベントは「汎用人工知能(AGI)の到来に備える方法」を議論する機会と位置づけられており、投資家は資金調達の提案を聞くことを期待していた。

日中の活動は近代的な会議室で行われ、参加者は順番にスピーチを行った。(リード・ホフマンは、AIに「仏教的な慈悲」をどのように組み込むかについても語った。)最後の講演者はアルトマン氏で、彼は「AGIの注目を集めることができる」グローバルな暗号通貨を発行するという資金調達計画を発表した。彼の構想では、汎用人工知能(AGI)が実用性の頂点に達し、「悪影響」が排除された後には、世界中のユーザーがOpenAIのサーバーの利用時間を購入するために競い合うようになるだろう。ダリオ・アモデイはメモにこう書いている。「この考えは一見ばかげているように思える(ウラジーミル・プーチンもこれらのトークンを保有するだろうか?…)」今思えば、これは私がもっと真剣に受け止めるべきだった数多くの警告サインの一つだった。この計画は資金調達のための戦術のように見えたが、アルトマンはそれをAIの安全性の一環として位置づけた。彼のスライドの一つには、「できるだけ多くの人に『正しい側』に立ってもらい、最終的に勝利してもらいたい」と書かれていた。別のスライドには、「笑いはプレゼンテーションの最後にお願いします」と書かれていた。

アルトマンの資金調達に関する説明は長年にわたって変化してきたが、常に中心となるのは、汎用人工知能(AGI)の開発には莫大な資金が必要だという現実である。彼は比較的単純な「規模の法則」に従っている。つまり、モデルの学習に用いるデータと計算能力が多ければ多いほど、モデルの知能は高まるという法則だ。このプロセスを支える特殊なチップは非常に高価である。直近の資金調達ラウンドだけでも、OpenAIは1200億ドル以上を調達した。これは史上最大の民間資金調達であり、過去最大の新規株式公開(IPO)の4倍の規模となる。「毎年数百億ドルを自由に使えるような組織は、世界的に見てもごくわずかしかない」と、あるテクノロジー投資家は語った。「米国政府、大手テクノロジー企業数社、そしてサウジアラビアとアラブ首長国連邦、それだけだ。」

サム・アルトマン、依然として未解決のリスク要因

湾岸地域における探査活動:地政学的な賭け

アルトマンは当初、サウジアラビアに目を向けていた。彼は2016年、サンフランシスコのフェアモントホテルでの夕食会で、皇太子であり事実上の統治者であるムハンマド・ビン・サルマンと初めて会った。その後、ヘドリーの記憶によれば、アルトマンはしばしば彼を「友人」と呼んだという。ヘドリーのメモによると、2018年9月、アルトマンは「サウジアラビアの政府系ファンド(PIF)から数千億ドルを受け取るかどうか検討している」と述べた。

しかし、1か月後、状況は劇的に変化した。サウジアラビア政府を批判していたワシントン・ポスト紙のジャーナリスト、ジャマル・カショギ氏はトルコで殺害され、遺体は切断された。この事件は、皇太子が指示したという見方が広く浸透している。その1週間後、アルトマンはサウジアラビアの「未来都市」プロジェクトであるネオムの諮問委員会に加わることが発表された。「サム、君はこの諮問委員会には参加できないよ」と、当時政策責任者だったジャック・クラークは彼に忠告したことを回想している。当初、アルトマン氏は自身の決定を擁護し、ジャレッド・クシュナー氏がサウジアラビアは「そのようなことはしていない」と保証したと述べた(アルトマン氏はそのことを覚えていないと主張し、クシュナー氏も当時両者は連絡を取っていなかったと述べた)。皇太子の責任がますます明確になるにつれ、アルトマンは最終的にネオム諮問委員会から辞任した。

しかし、かつてアルトマンに政策助言を与えていたある顧問は、個人的にはこの件を「一時的な後退」と捉え、サウジアラビアからの資金調達がまだ可能かどうかを引き続き模索していたと回想している。「問題は『これが正しいか間違っているか』ではなく、『これを実行した場合、どのような結果が生じるか』だったのです。」輸出規制の対象となるだろうか?我々は制裁を受けるのだろうか?彼らを避けて仕事を進めることはできますか?

一方、アルトマンは別の資金源にも目を向けた。それはアラブ首長国連邦だった。同国は、石油依存型経済からテクノロジーハブへの転換を目指す15年間の変革計画の真っ只中にある。このプロジェクトは、大統領の弟であり国家情報長官であるタフヌーン・ビン・ザイード・アル・ナヒヤーンが主導している。彼は、中国のAIグループであるG42を統括するとともに、約1兆5000億ドルに上る政府系ファンドも管理している。2023年6月、アルトマンはアブダビを訪れ、オラマを含む関係者と会談し、政府主催のイベントで、UAEは「AIが流行する前からその基盤を築き始めていた」と述べ、中東が世界のAIエコシステムにおいて「中心的な役割」を果たすという未来像を描いた。

湾岸諸国からの資金調達は、大企業にとって日常的な業務となっている。しかし、サム・アルトマンは、より壮大な地政学的ビジョンを追求していた。2023年秋、彼は密かに人材の採用を開始し、後に「ChipCo」として知られることになるプロジェクトの計画を進めた。このプロジェクトは、湾岸諸国から数千億ドルの資金提供を受け、中東に拠点を置く部分を含め、世界各地に大規模な半導体工場とデータセンターを建設する計画だった。彼は、現Meta AI責任者のアレクサンドル・ワンに経営陣への参加を提案し、ジェフ・ベゾスがプロジェクトを率いる可能性を示唆した。アルトマンはアラブ首長国連邦から多額の投資を求めた。「私の知る限り、この件全体は取締役会の了解なしに進められた」とある取締役は述べた。アルトマンからプロジェクトへの参加を依頼された研究者のジェームズ・ブラッドベリーは、その依頼を断ったことを回想している。「最初に思ったのは、成功する可能性はかなり高いけれど、そうなってほしいかどうかは分からない、ということだった。」

AIの計算能力は、世界のパワーバランスを左右する主要資源として、石油や濃縮ウランに取って代わる日が近いかもしれない。アルトマン氏は、コンピューティング能力は「未来の通貨」だと述べている。理論上はデータセンターの所在地は重要ではないように思えるが、多くの米国の国家安全保障当局者は、高度なAIインフラが湾岸の独裁国家に集中することに懸念を抱いている。アラブ首長国連邦の通信インフラは、ファーウェイ(中国政府と密接な関係にあるテクノロジー企業)に大きく依存しており、過去には米国製の技術を北京に漏洩したとして非難されたこともある。情報機関は、アラブ首長国連邦に輸出された高度なチップが中国の技術者によって悪用される可能性があると懸念している。さらに、中東のデータセンターは地政学的紛争の標的になりやすい。イランは最近、バーレーンとアラブ首長国連邦にある米国関連のデータセンターを攻撃した。さらに極端なシナリオでは、湾岸諸国の君主制国家がアメリカ企業のデータセンターを掌握し、それを利用して極めて強力なモデルを訓練する可能性さえある。これはまさに現実版の「汎用人工知能独裁政権」と言えるだろう。

アルトマンが解任された後の重要な時期において、彼が最も頼りにしていた人物の一人がブライアン・チェスキーだった。Airbnbの共同創業者であり、彼の最も熱心な支持者の一人でもある。「友人がどん底に突き落とされるのを見て、『実際に会社を経営する』とはどういうことなのか、改めて考えさせられた」とチェスキーは語った。翌年、Y Combinatorの卒業生が集まる会合で、彼は即興で2時間のスピーチを行った。「まるで集団セラピーのセッションのようだった」と彼は語った。その核心となる考え方は単純だ。創業者自身の会社に対する直感が最も信頼できるものであり、それを否定する者は創業者を「ガスライティング」しているのだ、というものだ。「たとえ従業員たちがあなたを狂っていると言っても、あなたは狂ってなんかいない」とチェスキーは言った。ポール・グラハムはこの姿勢をブログ記事の中で「創業者モード」と名付けた。「ブリップ」事件以来、アルトマンは明らかにこのモードに入っている。

2024年2月、ウォール・ストリート・ジャーナル紙が初めてChipCoの計画を明らかにした。アルトマンは、それを5兆ドルから7兆ドル規模の共同事業体として構想していた(彼はソーシャルメディアで「いっそのこと8兆ドルにしよう」と冗談を言ったほどだ)。多くの従業員は、この計画についてメディアを通じて初めて知った。「みんなの反応は『え、何だって?』だった。」ヤン・ライケは回想した。内部会議で、アルトマンはセキュリティチームが「議論に参加していた」と主張し、その後ライケは彼に、計画がセキュリティ承認を得たかのように示唆しないようメッセージを送った。

ジョー・バイデン政権時代、アルトマンは機密扱いのAI政策に関する議論に参加するために、セキュリティクリアランスの申請を試みた。しかし、このプロセスを支援していたランド研究所の職員は懸念を表明した。「彼は外国政府から『数百億ドル』もの資金を集めている」とあるスタッフは書き、「UAEは最近彼に車を贈った(きっとすごく高価な車だろう)」と付け加えた。その人物はさらに次のように述べている。「これほど広範な海外との金融関係を理由にセキュリティクリアランスを申請した人物として私が思いつくのはジャレッド・クシュナー氏だけだが、当時の承認権限者はそれを付与しないよう勧告していた。」アルトマンは最終的に応募手続きから撤退した。協議に関与した政府高官は、「彼とアラブ首長国連邦との極めて取引的な関係は多くの人々の警戒心を招いており、政府内部でも彼を完全に信頼していない者が多い」と述べた。

タフヌーン・ビン・ザイード・アル・ナヒヤーンから贈り物を受け取ったかどうか尋ねられたアルトマンは、「彼が具体的に何を贈ってくれたかは明言しませんが、彼や他の国の指導者たちから確かに贈り物をいただきました」と答えた。同氏は、同社には潜在的なパートナーからのすべての贈答品を開示することを義務付ける明確な方針があると付け加えた。アルトマンは少なくとも2台のスーパーカーを所有している。1台は約200万ドル相当の白いケーニグセグ・レゲーラ、もう1台は約2000万ドル相当の赤いマクラーレンF1だ。2024年、彼はナパバレーでレゲーラを運転しているところを目撃され、その短い動画がソーシャルメディアで拡散された。動画には、彼が低い座席に座り、白い車体から身を乗り出している様子が映っていた。マスク氏の立場に近い投資家がこの動画をリツイートし、「私も非営利団体を立ち上げたい」とコメントした。

同年、アルトマンはOpenAIの従業員2名を、タヌーン所有の2億5000万ドル相当のスーパーヨット「マリア」に乗せた。この世界最高級の豪華ヨットには、ヘリポート、ナイトクラブ、映画館、ビーチクラブが備え付けられている。伝えられるところによると、アルトマンの従業員たちは武装した警備員に囲まれた環境に居心地の悪さを感じており、少なくとも一人は後に同僚に、その経験で不安になったと話したという。アルトマンは後に、X誌上でタヌーンを「親しい友人」と呼んだ。

スターゲイトが着陸:バイデンからトランプへの政治的転換

サム・アルトマンは、ジョー・バイデン政権との対話を継続している。政権は以前、機密技術の輸出にはホワイトハウスの承認を義務付ける政策を実施していた。中東でアルトマンと会談した後、多くの政府関係者が不安を表明した。彼らによれば、アルトマンはしばしば、AIを「新しい電気」になぞらえるなど、壮大なアイデアを提示したという。

彼は2018年の時点で、OpenAIがRigetti Computingから「完全に使用可能な」量子コンピュータを購入する計画だと述べていた。当時Rigettiはその目標達成には程遠かったため、この発言は同席していた他のOpenAI幹部をも驚かせた。別の会合で彼は、2026年までに米国はAI開発のためのエネルギー供給源として、核融合炉からなる広大なネットワークを構築するだろうと主張した。ある政府高官は当時を振り返り、「もし核融合が本当に実現すれば、それは確かに大きなニュースになるだろう」と述べた。結局、バイデン政権は関連計画の承認を拒否した。「我々はUAEで先端チップを製造するつもりはない」と、商務省当局者はアルトマン氏に語った。

しかし、状況はすぐに変化した。ドナルド・トランプ氏の大統領就任式のわずか4日前、ウォール・ストリート・ジャーナル紙は、タフヌーン・ビン・ザイード・アル・ナヒヤーン氏が自身の仮想通貨会社の株式と引き換えに、トランプ一家に5億ドルを支払ったと報じた。翌日、アルトマンはトランプと25分間話し、チップコに似たプロジェクトを立ち上げることや、発表時にトランプが「手柄を独り占めする」計画について話し合った。トランプ大統領就任2日目、アルトマンはホワイトハウスのルーズベルト・ルームに姿を現し、米国内に広大なAIインフラネットワークを構築することを目的とした総額5000億ドルの共同事業プロジェクト「スターゲイト」の立ち上げを発表した。

同年5月、政府はバイデン政権時代に実施されていたAI技術の輸出規制を解除した。アルトマン氏はトランプ氏に同行し、サウジアラビア王室およびムハンマド・ビン・サルマン皇太子と会談した。ほぼ同時期に、サウジアラビアは国家支援による巨大AI企業の設立を発表し、国際協力に数十億ドルを投資する計画を明らかにした。その約1週間後、アルトマンはスターゲイトをアラブ首長国連邦に拡大する計画を明らかにした。同社はアブダビにデータセンターキャンパスを建設する計画を立てており、その規模はニューヨークのセントラルパークの7倍にもなり、消費電力はマイアミ市全体の電力消費量にほぼ匹敵する見込みだ。

元OpenAI幹部は、そのプロセスを次のように説明した。「正直に言うと、私たちはある種の『宇宙人召喚』ポータルを構築しているんです。」彼はこう説明した。「これらの『ポータル』は現在、米国と中国に存在しており、サムは中東にも一つ追加した。」彼はさらにこう述べた。「重要なのは、これがどれほど恐ろしいことかを認識することだ。これはこれまでで最も無謀な行動の一つだ。」

軍事化の転換:OpenAIが国防総省の発注を引き継ぐ

セキュリティに関する取り組みの緩みは、業界全体で徐々に常態化しつつある。アントロピック設立の根本的な理念は、適切な組織構造とリーダーシップを通じて、商業的な圧力下でもセキュリティ境界を維持することであった。重要な仕組みの一つは「責任ある規模拡大ポリシー」だった。より強力なモデルの安全性が証明できない場合、企業はトレーニングを中止しなければならなかった。しかし、今年2月に同社が300億ドルの資金調達を確保したことで、この約束は弱体化した。ある意味では、AnthropicはOpenAIよりもセキュリティを重視していると言えるが、元政策責任者のジャック・クラークは率直にこう述べている。「資本市場の論理は、より速く動け、ということだ。」彼はさらにこう付け加えた。「最終的に意思決定を行うのは企業ではなく、全世界だ。」昨年、ダリオ・アモデイは社内メモで、同社がアラブ首長国連邦とカタールから投資を募る予定であることを従業員に明らかにし、それが「独裁政権」に利益をもたらす可能性が高いことを認めた。

一方、アントロピックは現実世界において、その姿勢を継続的に調整してきた。2024年、同社はシリコンバレー屈指の防衛関連企業であるパランティアと提携し、自社のモデル「クロード」を軍事システムに導入した。これにより、極秘の国防総省プロジェクトにおける唯一のAI請負業者となった。昨年、米国国防総省はこれにさらに2億ドルの契約を追加した。ウォール・ストリート・ジャーナル紙によると、今年1月、米軍はベネズエラのニコラス・マドゥロ大統領を拘束するため深夜作戦を実施したが、クロードはその作戦の機密部分で使用されたと報じられている。

しかし、すぐに緊張が高まった。以前、OpenAIはポリシーから「軍事利用」に対する包括的な禁止規定を撤廃した。その後、GoogleやxAIなどの競合他社も、「あらゆる合法的な利用」のために軍事機関にモデルを提供することに同意した。一方、アントロピック社は、完全自律型兵器や国内における大規模監視を支持しないという姿勢を堅持し、政府との交渉は行き詰まった。2月末のある火曜日、ピート・ヘグセス米国防長官はアモデイ氏を国防総省に呼び出し、金曜日の午後5時1分までにこれらの制限を解除するよう最後通牒を突きつけた。アモデイは最終的に拒否した。ヘグセス氏はその後、ソーシャルメディア上で、アントロピック社を「サプライチェーンリスク」企業に指定すると発表した。この指定は通常、ファーウェイのような外国の敵対勢力と関係のある企業に適用されるものであり、ヘグセス氏はそれを迅速に実行に移した。

この決定は業界に大きな衝撃を与えた。OpenAIと数百人のGoogle社員は、Anthropicを擁護する「我々は分裂しない」と題した公開書簡に共同署名した。サム・アルトマンは社内メモの中で、これを「業界全体の問題」と呼び、OpenAIとAnthropicは同様の倫理的境界線を共有していると述べた。しかし、彼は少なくとも2日間、国防総省との交渉を続けてきた。国防次官補(研究担当)のエミル・マイケル氏は、「代替案を早急に見つける必要があったのでサムに電話したところ、彼はすぐに引き受けてくれた。私は彼を愛国者だと考えている」と述べた。アルトマンは「私は国のために何ができるだろうか?」と問いかけたが、その答えはまるで事前に用意されていたかのようだった。OpenAIは機密システムに必要なセキュリティクリアランスをまだ取得していないものの、金曜日の朝、同社の技術をアマゾンウェブサービス(ペンタゴンのデジタルインフラの不可欠な部分)に統合するための5000億ドル規模の提携が発表された。その日の夜、アルトマンはX上で、米軍がOpenAIのモデルの使用を開始すると発表した。

ビジネス的な観点から見ると、この決定は会社に悪影響を与えなかった。提携が発表された当日、OpenAIは新たな資金調達ラウンドを実施し、その企業価値をさらに1100億ドル引き上げた。しかし、それに伴う影響もあった。多くのユーザーがChatGPTアプリを削除し、少なくとも2人の幹部が辞任した(うち1人はAnthropicに入社した)。社内会議で、アルトマンは疑問を呈した従業員に対して不満を表明した。「イランへの攻撃は正しく、ベネズエラへの侵攻は間違っていると思うかもしれないが、それはあなたが決めることではない。」

社内では、一部の幹部が依然としてアルトマンのリーダーシップスタイルに疑問を抱いており、フィジー・シモ(現OpenAIのAGI導入責任者)が後継者になる可能性を示唆している。事情に詳しい情報筋によると、シモはアルトマンが将来辞任する可能性があると密かに考えているという。(シモはこの主張を否定している。)

アルトマン氏は、自身の立場変更は、マスク氏らが非難しているような「長期的な詐欺」ではなく、状況の変化への適応によるものだと述べている。「リーダーには常に固定された立場を守ってほしいと願う人もいるが、我々の分野は急速に変化している」と彼は述べた。彼は自身の行動の一部を「通常のビジネス競争」によるものだと説明している。一部の投資家は、彼に対する批判は理想主義的すぎると考えている。「安全性の問題をほとんどSFのような極端なレベルまで押し進める人たちがいる」と投資家のロン・コンウェイ氏は語った。「彼の使命は結果で測れるものであり、OpenAIの業績を見れば、それらの数字を否定するのは難しいだろう。」

しかし、シリコンバレーでは、サム・アルトマンの行動が容認できない経営上の混乱を招いたと感じている人が多い。「より大きな問題は、同社が実際の業務においてガバナンス能力の欠如を示していることだ」と、ある取締役はコメントした。人工知能の開発者は、他の業界幹部よりも厳しい基準で評価されるべきだと主張する人も依然として存在する。インタビューした人々のほとんどが、ある一点で意見が一致した。アルトマンは今、彼自身が当初設定した基準とは異なる基準で評価されているようだ。

会話の中で、私たちはアルトマンにこう尋ねました。AI企業を経営するということは、「より高い倫理的要件」が求められるということなのか?その質問は非常に単純なはずだった。これまで彼は、常にためらうことなく力強く「はい」と答えてきた。しかし今回は、彼はこう付け加えた。「多くの産業は、実際には社会に大きなプラスとマイナスの影響を与えていると思います。」(その後、彼はさらにこう付け加えた。「はい、これにはより高い倫理基準が求められますし、私はその責任を日々感じています。」

OpenAI設立当初、最も基本的な取り組みの一つは、「安全な方法でAIを現実のものとする」ことだった。しかし今日では、こうした懸念はシリコンバレーやワシントンではしばしば足かせと見なされている。昨年、現在の米国副社長兼元ベンチャーキャピタリストのJDヴァンス氏はパリで開催されたAIアクションサミットで次のように述べた。「AIの未来は、安全性に対する過剰な不安によって勝ち取られるものではない。」ダボス会議で、元ホワイトハウスのAIおよび暗号通貨担当高官で、現在はベンチャーキャピタリストであるデビッド・サックス氏も、安全性の問題を「自傷行為」と表現し、それが米国がAI競争で敗北する原因になり得ると述べた。アルトマン氏は現在、トランプ氏の規制緩和政策を「非常に爽快な変化」と評している。

一方、OpenAI社内の安全性に重点を置いた複数のチームが解散された。スーパーアライメントチームの解散に先立ち、そのリーダーであるイリヤ・スツケバーとヤン・ライケが相次いで辞任した。(サツケバーは後にセーフ・スーパーインテリジェンス社を設立した。)ライケはXについてこう書いた。「安全文化と安全プロセスは、より魅力的な製品を生み出すために取って代わられた。」その後まもなく、「汎用人工知能(AGI)が社会に与える影響をシミュレーションする」責任を負っていたチームも解散した。最近IRS(内国歳入庁)に提出された書類の中で、OpenAIは「最も重要な活動」を説明する際に「安全性」という言葉を一切使わなくなった。(同社は「使命は変わっていない」と回答し、安全性の研究に引き続き積極的に取り組んでいることを強調した。)非営利団体であるFuture of Life Instituteによる最新の評価では、OpenAIは「存在の安全性」という側面でF評価を受けた。もちろん、Anthropic(D)とGoogle DeepMind(D-)を除けば、他の主要企業も同様に不合格だった。

「従来のAIの安全性に関する私の直感は、実はあまり一貫していない」とアルトマン氏は述べた。彼はこれらの問題に依然として重きを置いていると主張するが、具体的な対策については曖昧な態度をとっている。「今後も安全対策プロジェクト、あるいは安全に関連するプロジェクトをいくつか実施していく予定です。」私たちが「存在の安全性」(彼が「停電問題」と表現したもの)に焦点を当てた社内の研究員へのインタビューを依頼したところ、OpenAIの広報担当者は困惑した様子だった。「『実存的安全性』とはどういう意味ですか?」それは明確な概念ではない。

かつては傍流だった「AI終末論者」たちの懸念は、現実のものとなりつつある。国連の報告書によると、2020年にはすでに、AI搭載ドローンがリビア内戦において、人間の介入なしに致命的な攻撃を実行していた可能性がある。それ以来、AIは世界的な軍事行動においてより重要な役割を担うようになり、報道によると、イランに対する米国の継続的な作戦にもAIが関与しているという。2022年、ある製薬会社の研究者たちは、創薬モデルを用いて新たな毒素を発見しようと試み、わずか数時間で4万種類もの潜在的な化学兵器を生成した。一方、より日常的なリスクも顕在化しつつある。人々は文章作成、思考、意思決定においてAIへの依存度を高めており、いわゆる「人間のスキル低下」を悪化させている。AIが生成するコンテンツの氾濫は、詐欺を容易にし、真実を見極めることを困難にしている。AIエージェントは、監視されていない状況下で自律的に行動し始めている。2024年のニューハンプシャー州予備選挙を前に、多数の有権者がジョー・バイデンの声を模倣したAI生成の自動音声電話を受け取り、投票しないよう促された。これは、技術的な障壁をほとんど必要としない選挙妨害の一形態である。一方、OpenAIは、ChatGPTが複数の自殺事件と1件の殺人共謀事件において、誘発的な役割を果たしたとして、7件の不当死亡訴訟に直面している。(OpenAIはこれらの疑惑に異議を唱え、安全対策の改善を継続すると述べている。)

OpenAIがIPO(新規株式公開)に向けて準備を進める中、外部からの監視は、AIが経済に与える影響(広範な失業につながる可能性)だけでなく、同社の財務構造にも向けられている。スタートアップ企業のガバナンス専門家であるエリック・リース氏は、業界の「往復取引」(OpenAIと半導体メーカーとの提携など)を批判し、歴史的に見ると、こうした会計処理は「詐欺に近い」と見なされていた可能性があると指摘している。取締役の一人は、「当社の現在の財務レバレッジは、不安を抱かせるレベルに達している」と率直に述べた。(OpenAIはこの主張を否定している。)

今年の2月、私たちは再びアルトマンに会うことになる。彼は濃い緑色のセーターとジーンズを着用しており、背後にはNASAの月面探査車の写真が飾られている。彼は椅子の上で足を組むこともあれば、足をだらりと垂らすこともある。彼は、過去のマネージャーとしての最大の欠点は、対立を避けすぎたことだと述べている。「今は従業員をすぐに解雇することに非常に抵抗がなく、直接こう言うことにも抵抗がない」と彼は言う。これが我々の進むべき方向だ。もし誰かが反対意見を述べたら、「出て行けばいい」。

彼の未来に対する楽観主義は、これまで以上に強固なものとなっている。「私が考える『成功』とは、人類全体の著しい向上、つまりSFの世界から抜け出した未来の実現のことだ」と彼は語る。「人類に対する私の期待は非常に高く、非常に野心的です。」しかし不思議なことに、私自身はあまり個人的な野心を持っていないのです。ここで彼は少し間を置いて、「あなたがこれらのことを単に面白いからやっているだけだと、誰も信じてくれないでしょう」と付け加えた。彼らはあなたが権力か何か別のものを求めていると思うでしょう。

サム・アルトマンの身近な人々でさえ、彼の「人類への希望」がどこで終わり、個人的な野心がどこから始まるのかを見分けるのは難しいと感じている。彼の最大の才能は、自分が望むものがまさに彼らに必要なものだと、様々な集団に信じ込ませることにある。彼は歴史上類を見ない好機を捉えた。それは、一般の人々がテクノロジー業界の壮大な物語に警戒心を抱いており、真に汎用人工知能(AGI)を構築できる能力を持つ人々が、その潜在的な影響を深く恐れているという状況だ。アルトマンの回答は、これまでほとんど誰も成し遂げられなかった物語的なアプローチである。一方では、終末論的な言葉遣いを用いて汎用人工知能(AGI)がもたらす可能性のある壊滅的なリスクを描写し、他方では、それを理由に「だからこそ、彼自身がこの技術を開発すべきだ」と主張するのだ。これは綿密に練られた戦略かもしれないし、あるいは不確実な状況の中で偶然見つけた機会に過ぎないのかもしれない。どちらにしても、うまくいった。

しかし、チャットボットを危険に見せる要因は、単なる「不具合」だけではなく、システム自体の構造に起因するものもある。トレーニング過程において、大規模な言語モデルは最適化のために人間のフィードバックに依存しており、人間は「従順で好ましい」応答を好む傾向がある。そのため、モデルはユーザーに迎合するようになり、これは「おべっか」として知られる傾向であり、時には真実の表現よりもユーザーの迎合を優先することさえある。さらに、このモデルは「事実を捏造する」可能性があり、これは「幻覚」として知られています。主要なAI研究所はこれらの問題点を以前から認識していたものの、実際にはしばしばそれらを容認する選択をしてきた。モデルの性能が向上するにつれて、この「幻覚」はますます説得力を増していく。2023年、解雇される直前に、アルトマンはこの現象を擁護した。彼は、ある程度の不確実性や誤りを許容することが、実際には利点をもたらすと信じていたのだ。「最もシンプルな戦略、つまりモデルに100%確信できないことは決して言わないように指示すれば、確かにそれは可能です」と彼は述べた。「でもそうすると、ユーザーに愛されているあの『魔法』がなくなってしまうでしょう。」

関連記事

OpenAIには「ニューディール」のような、AIへの報酬支払いを拒否する青写真はない。

ウォール街でフラッシュモブラン?メガキャップ株の暴落、ゴールドマン・サックスの大脱出、民間信用危機の図解ガイド

「AI終末カルト」がホルムズ海峡にオペレーターを派遣:彼らは何を見つけたのか?

誰もが戦争の終結を待っているが、石油価格が長期にわたる紛争を示唆しているのだろうか?

データ分析:ハイパーリキッドとCME原油の流動性ギャップはどのくらい広いのか?

従業員を40%削減した後、Twitterの創業者、100万ドル相当のビットコインを寄付へ

Trade.xyz:世界の価格付け?オンチェーン市場が市場になる

XXYYの職業スキル:24時間365日稼働のアルゴリズム取引AIトレーダー | プロジェクト紹介

DeFiのトッププロトコルAaveのセキュリティチームが離脱、弱気市場での次のブラック・スワン・イベントに耐えられるのは誰?

史上最も正確に金価格を予測した人物が将来の金価格を予測することは可能か?

量子コンピューティングはビットコインを滅ぼすことはないが、真のリスクは迫っている

コインベースはx402への姿勢を中立に転換した一方、ストライプはMPP以外の分野で両陣営への投資を継続している

フィンテックが暗号の基盤と融合する:デジタル金融の次の10年

あなたが出会う高ネットワークの顧客は、北朝鮮のハッカーの「傭兵」かもしれません。

Chaos Labsが離脱し、Aaveは最後のリスクゲートキーパーを失った。

量子コンピュータはビットコインを殺さないが、本当のリスクが近づいている

デラウェア、銀行フレームワークに沿ったステーブルコインの規制へ

デラウェア州は1981年以来初めてその銀行法を改正し、規制されたステーブルコイン市場を取り込もうとしています。 上院法案19号は、ステーブルコイン発行者を金融機関として扱い、州銀行監督官の直轄下に置く特別なライセンス制度を提案しています。 この法案は、発行されたステーブルコインごとに1:1のリザーブを求め、実質的な監査と支払能力基準を導入しています。 デラウェア州は、特定の規制環境を築くことで、失っていた雇用や税収を取り戻そうとしています。 連邦規制が停滞する中、デラウェア州は規制の主導権を握ろうとしています。 WEEX Crypto News, 2026-03-25 08:38:13 デラウェア支払いステーブルコイン法の仕組み デラウェア州の新法案、上院法案19号は、ステーブルコイン発行者を銀行の基準で規制し、1:1のリザーブを求めます。これにより、発行済みのステーブルコインはすべて完全に準備金で裏付けられることになります。法的に強化されたこの環境を通じて、ステーブルコイン市場は競争の構造を再構築します。 デラウェア州は、州銀行監督官の監視下で、発行者に対する厳格な審査を可能にしました。この一貫した監督体制によって、州内の金融システムは透明性と信頼性を得ることが期待されています。しかし、この動きには代償が伴います。資本要件により、小規模でアルゴリズムに頼るプロジェクトは淘汰されるリスクがあり、サークルやパクソスのような大手だけがこの環境で生き残る可能性が高まります。 デラウェアの暗号資産への野望 デラウェア州は、連邦政府の規制の遅延を好機として、州独自の規制を打ち出しています。特に、連邦GENIUS法案と用語を合わせる戦略で、将来の連邦レジームでのパスポート的役割を獲得しようとしています。これにより、もしデラウェア州が高機能なステーブルコインの銀行フレームワークを確立すれば、それは事実上の全国基準となりうるのです。 デラウェア州はその歴史を企業法に基づいて築き上げてきましたが、今度はデジタルドルのドミノを築こうとしています。そして、この試みは連邦の指示を待たず、自らが規則を作成する姿勢を表しています。 ステーブルコインの未来と市場のプレッシャー デラウェア州の規制強化により、信頼性の高いステーブルコインが市場で優先され、流動性が増します。一方で、直接の金融リスクが少ない州公認のステーブルコインは、DeFiプロトコルや取引所で他のオフショア代替案よりも優先される可能性が高まります。この新たな規制の明確化は、流動性の拡大に寄与することが期待されます。…

ビットコイン価格がトランプ大統領のイラン攻撃延期で反応、オイルとゴールドに変動

トランプ大統領がイランへの攻撃を五日間延期したことで、ビットコイン価格は急上昇し、過去の損失を一気に取り戻しました。 原油先物はほぼ10%下落し、金価格も3.7%下落しましたが、仮想通貨市場は急騰しました。 ビットコインは供給ゾーンに突入し、重要な抵抗線である$72,000を突破することが鍵となっています。 マクロ経済的には、原油価格の急落がビットコインの流動性改善を示し、金とビットコインの価格相関が逆転しました。 ビットコインに連動した高成長のインフラプロジェクトへの投資が新たな注目を集めています。 WEEX Crypto News, 2026-03-25 08:38:09 ビットコイン価格と原油の相関関係 トランプ大統領がイランへの攻撃を五日間延期すると発表した直後、ビットコイン価格は急上昇しました。具体的には、ビットコインは$71,000を再び突破し、週末の損失を即座に回復しました。石油先物が約10%の急落を見せ、金価格も3.7%下落する中でのこの動きは、クリプト市場の特異性を際立たせました。 [Place Image: チャートのスクリーンショット – ビットコイン価格と原油価格の動向] この動向は、ビットコインが今サイクルでは安全資産というよりも流動性の指標として機能していることを示しています。トレーダーたちは、48時間の最後通告の期限切れに伴う即時エスカレーションを予想していましたが、延期の報が熊派の期待を裏切りました。…