قمار عرضه اولیه سهام آنتروپیک: در بعیدترین لحظه، تصمیم گرفت نه بگوید

این سناریو را تصور کنید.

سه ماه است که قبوض آب و برقت را پرداخت نکردهای، ماه گذشته به بیمارستان رفتی، و هر سال با دقت مالیاتهایت را ثبت میکنی. این موارد به نظر بیربط میآیند.

اما در یک سیستم هوش مصنوعی خاص، این سه قطعه اطلاعات جمع میشوند و یک نقطه قرمز روی نقشه ایجاد میکنند. آن نقطه قرمز نشان دهنده موقعیت مکانی شما و یک دستورالعمل اجرای قانون است که شما را هدف قرار داده است.

این علمی تخیلی نیست. در اوایل سال ۲۰۲۶، ایالات متحده آژانس مهاجرت فدرال با تکیه بر این منطق، عملیات پاکسازی گستردهای را در مینیاپولیس انجام داد. سیستم هوش مصنوعی مربوطه از یک شرکت داده به نام پالانتیر میآید که سوابق پزشکی، قبوض آب و برق و اطلاعات مالیاتی مهاجران را در یک الگوریتم ادغام میکند و با خونسردی اهداف مورد نظر را یکی یکی مشخص میکند.

هوش مصنوعی در حال تبدیل شدن به یک سلاح است. نه زمان آینده، بلکه زمان حال.

دیگر سوال این نیست که آیا این اتفاق خواهد افتاد یا نه، بلکه سوال این است که چه کسی حق دارد تصمیم بگیرد که چه کاری میتواند و چه کاری نمیتواند انجام دهد.

در ۲۷ فوریه ۲۰۲۶، به آن سوال پاسخی نگرانکننده داده شد.

در آن روز، شرکتی به نام آنتروپیک - یک شرکت هوش مصنوعی، توسعهدهنده محصول هوش مصنوعی مکالمهای کلود، رقیبی در سطح ChatGPT - رسماً توسط دولت ایالات متحده تحریم شد. دلیل این ممنوعیت، امتناع این شرکت از اجازه استفاده از هوش مصنوعی خود برای نظارت بر شهروندان آمریکایی و تصمیمگیری مستقل در مورد اهداف حذف بود.

این به عنوان یک «خطر امنیت ملی» طبقهبندی شد زیرا روی آن نوشته شده بود: «نمیتوان از آن به این شکل استفاده کرد.»

آنچه شرکتی که برای عرضه اولیه سهام آماده میشود، بیش از همه به آن نیاز دارد

قبل از پاسخ به «چرا آنتروپیک مصالحه نمیکند»، لازم است بفهمیم که اکنون در چه جایگاهی قرار دارد.

شرکت آنتروپیک یکی از ارزشمندترین شرکتهای هوش مصنوعی جهان است که ارزش آن ۳۸۰ میلیارد دلار برآورد میشود و درآمد سالانه آن در سال ۲۰۲۵، ۱۴ میلیارد دلار خواهد بود. بزرگترین سهامدار آن آمازون است که سهم آن از هر سهامدار دیگری بیشتر است. مدل هوش مصنوعی آن، Claude، یکی از سریعترین محصولات هوش مصنوعی در حال رشد در بازار سازمانی در حال حاضر است.

با هر استانداردی، این شرکتی است که آماده عرضه عمومی است. در واقع، آنتروپیک امسال خود را برای عرضه اولیه سهام آماده میکند و به مردم عادی اجازه میدهد سهام آن را خریداری کنند.

شرکتی که برای عرضه اولیه سهام آماده میشود، بیش از همه به چه چیزی نیاز دارد؟ پاسخ به کمی تفکر نیاز دارد: ثبات، پیشبینیپذیری و عدم وجود مشکلات نظارتی. هر رویداد منفی میتواند بر اعتماد سرمایهگذاران به شرکت تأثیر بگذارد و در نتیجه قیمتگذاری عرضه اولیه سهام را کاهش دهد.

سپس، اوضاع کاملاً در جهت مخالف تغییر کرد.

در ژوئیه ۲۰۲۵، پنتاگون همزمان قراردادی تا سقف ۲۰۰ میلیون دلار به شرکتهای Anthropic، OpenAI (توسعهدهنده ChatGPT)، گوگل و xAI ماسک اعطا کرد، با هدف ادغام هوش مصنوعی پیشرفته در سیستم نظامی ایالات متحده. این بزرگترین خرید دولتی در تاریخ هوش مصنوعی بود.

نکته قابل توجه این است که قرارداد آنتروپیک حاوی جزئیاتی بود که سه شرکت دیگر نداشتند. این قانون به صراحت دو محدودیت استفاده را بیان کرد: کلود نمیتوانست بدون نظارت انسانی برای نظارت گسترده بر شهروندان آمریکایی یا برای سیستمهای سلاحهای خودمختار مورد استفاده قرار گیرد.

OpenAI، گوگل، xAI، همگی توافق کردند که ارتش میتواند از هوش مصنوعی برای تمام اهداف قانونی و بدون هیچ محدودیت اضافی استفاده کند. فقط شرکت آنتروپیک دو خط قرمز در قرارداد کشید.

این دو خط قرمز بعدها نقطه شروع همه دردسرها شدند.

اولتیماتوم

در فوریه ۲۰۲۶، پنتاگون تصمیم گرفت شرکت آنتروپیک را تحت فشار قرار دهد.

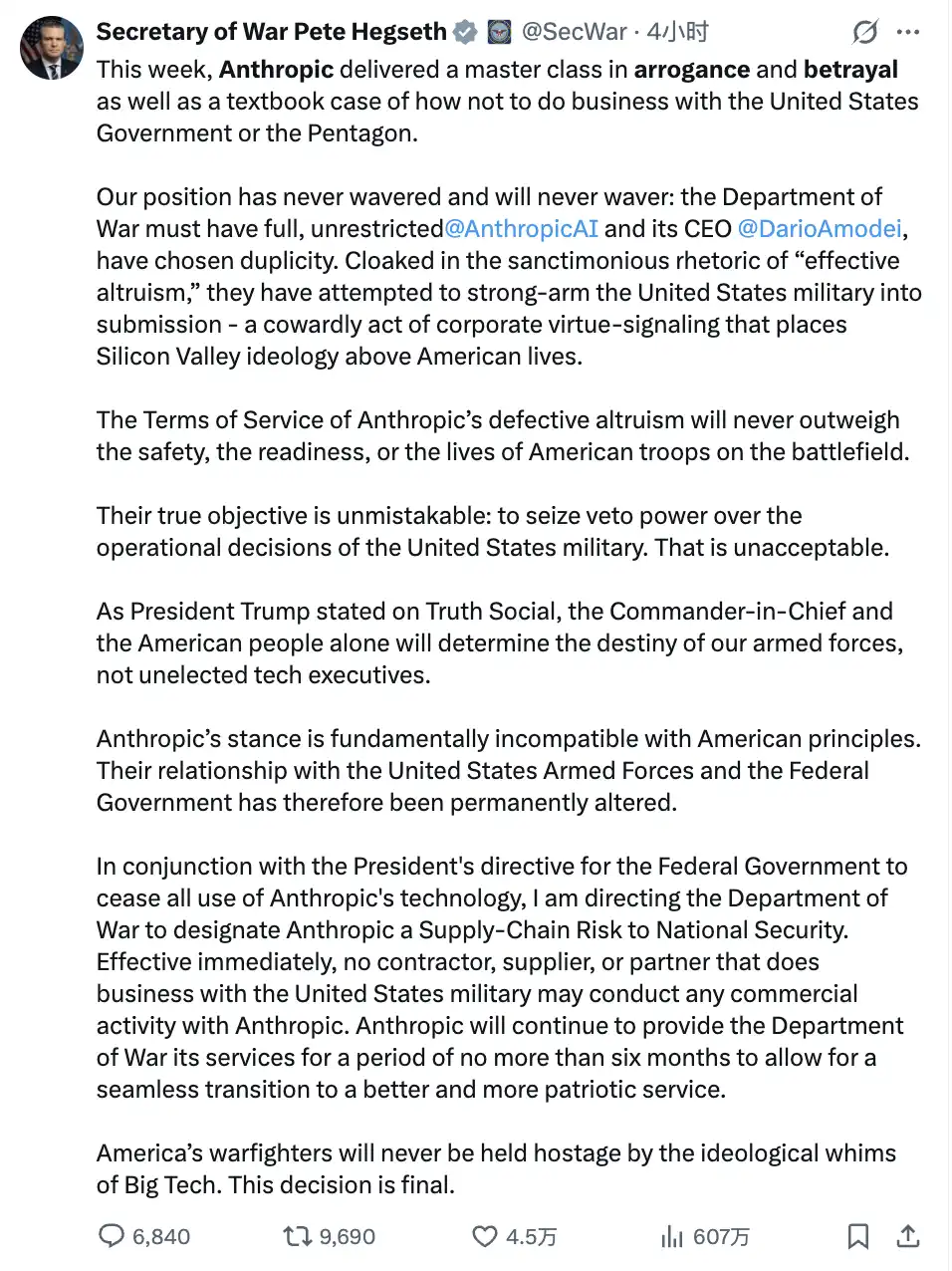

وزیر دفاع، پیت هگست، به مدیرعامل شرکت آنتروپیک، داریو آمودی، اولتیماتوم داد: محدودیتهای استفاده از قرارداد را حذف کنید و اجازه دهید کلود برای تمام اهداف قانونی مورد استفاده قرار گیرد. در غیر این صورت، پنتاگون قرارداد را لغو کرده و شرکت آنتروپیک را به عنوان یک «خطر زنجیره تأمین» معرفی خواهد کرد. آخرین مهلت ۲۷ فوریه بود.

پاسخ داریو این بود: خیر.

او در یک بیانیه عمومی نوشت: «ما درک میکنیم که تصمیمات نظامی توسط دولت گرفته میشود، نه شرکتهای خصوصی. اما در موارد بسیار کمی، ما معتقدیم که هوش مصنوعی ممکن است به جای تقویت ارزشهای دموکراتیک، آنها را تضعیف کند. ما وجدان راحتی داریم و نمیتوانیم خواستههای آنها را بپذیریم.»

امیل مایکل، مدیر فناوری پنتاگون، سپس در رسانههای اجتماعی پستی منتشر کرد و داریو را کلاهبردار خواند، او را به داشتن عقده خداباوری و تلاش برای کنترل شخصی ارتش ایالات متحده و به خطر انداختن امنیت ملی متهم کرد.

بعد خود ترامپ آمد. او در پلتفرم اجتماعی خودش، Truth Social، نوشت که آنتروپیک یک «شرکت بیداری چپ رادیکال» است که «مرتکب یک اشتباه فاجعهبار شده» و دستور داد: تمام سازمانهای دولتی فدرال فوراً استفاده از تمام محصولات آنتروپیک را متوقف کنند و این گذار ظرف ۶ ماه تکمیل شود.

پنتاگون فوراً آنتروپیک را به عنوان یک «خطر زنجیره تأمین» طبقهبندی کرد.

این برچسب قبلاً فقط برای علامتگذاری شرکتهای مرتبط با دشمنان خارجی مانند چین استفاده میشد. این برای هواوی و SMIC استفاده شده است. حالا نوبت یک شرکت هوش مصنوعی آمریکایی است که دفتر مرکزی آن در سانفرانسیسکو قرار دارد و ارزش آن به ۳۸۰ میلیارد دلار رسیده است.

۲۰۰ میلیون دلار مسئلهی کوچکی است، مشکل اصلی اینجاست

واکنش اولیه بسیاری از مردم این بود: از دست دادن یک قرارداد دولتی ۲۰۰ میلیون دلاری برای آنتروپیک با درآمد سالانه ۱۴ میلیارد دلار، تنها بخش کوچکی از این مبلغ است.

این ارزیابی درست است، اما تمرکز آن اشتباه است.

تأثیر واقعی از خودِ برچسب «ریسک زنجیره تأمین» ناشی میشود. این بدان معناست که هر شرکتی که با ارتش ایالات متحده همکاری میکند، باید ثابت کند که تجارت آنها شامل شرکت آنتروپیک نبوده است. این یک فشار اخلاقی ملایم نیست، بلکه یک الزام اکید برای رعایت قوانین است.

با دنبال کردن این خط فکری به سمت پایین، دامنه تأثیر کمتر خوشبینانه به نظر میرسد.

خدمات وب آمازون زیرساخت عملیاتی اصلی کلود و همچنین بزرگترین ارائه دهنده خدمات ابری برای دولت ایالات متحده است و ادغام عمیقی بین این دو وجود دارد. شرکت تحلیل داده پالانتیر، ضمن خدمت به ارتش و سازمانهای اطلاعاتی ایالات متحده، کلود را در خود جای داده است. شرکت فناوری دفاعی Anduril با استفاده از Claude در پروژههای مرتبط با پنتاگون، دادهها را پردازش میکند.

این مشتریان اکنون باید انتخاب کنند: به استفاده از کلود ادامه دهند و با فشار همکاری با یک شرکت «ریسک زنجیره تأمین» روبرو شوند، یا کلود را که عمیقاً در جریان کاری آنها ادغام شده است، جایگزین کنند.

هر دو گزینه برای آنتروپیک ضرر و زیان هستند. این ریسک واقعی است که باید مدیریت شود، و بسیار نگرانکنندهتر از مبلغ قرارداد ۲۰۰ میلیون دلاری است.

تمام این مشکلات قبل از عرضه اولیه سهام (IPO) اتفاق میافتد.

چرا رد شدن هنوز اتفاق افتاد؟

اوضاع داره جالب میشه.

شرکتی که به سمت عرضه اولیه سهام (IPO) در حرکت است، آخرین چیزی که در این لحظه حساس به آن نیاز دارد، دردسر است، با این حال تصمیم گرفته است که مستقیماً با فشار دولت مقابله کند. آیا این یک خطای قضاوت تجاری است یا یک قمار حسابشده؟

قرار دادن این دو گزینه در کنار هم، منطق را روشنتر میکند.

اگر آنها مصالحه کنند، قرارداد حفظ میشود، روابط دولتی حفظ میشود و مشکل فوری از بین میرود. اما روایت اصلی برند آنتروپیک در سه سال گذشته - «مسئولترین شرکت هوش مصنوعی»، «اولویت با ایمنی» - در این لحظه دچار تزلزل خواهد شد.

خطر بزرگتر، فوری نیست. به محض اینکه کلود واقعاً برای نظارت در مقیاس بزرگ یا تصمیمگیری در مورد سلاحهای خودکار مورد استفاده قرار گیرد، به محض اینکه هرگونه حادثه ناگواری رخ دهد، ضرر فقط یک قرارداد نخواهد بود، بلکه کل تز ارزشگذاری شرکت را تحت تأثیر قرار میدهد. هزینهای که سرمایهگذاران در ابتدا برای داستان «هوش مصنوعی مسئول» پرداخت کردند، یک شبه از بین خواهد رفت.

در صورت رد درخواست، ۲۰۰ میلیون دلار ضرر خواهید کرد، برچسب ریسک زنجیره تأمین را فعال میکنید و بازار دولتی اساساً تعطیل میشود. اما روایت برند «ایمنی در اولویت» گرانترین حمایت عمومی تاریخ را دریافت کرده است. هیچ بودجه روابط عمومی نمیتواند این تأثیر را بخرد، چرا که دولت به دلیل امتناع از اجازه دادن به هوش مصنوعی برای نظارت بر شهروندان کشور، آن را ممنوع کرده است.

جملهای در گفتهی داریو وجود دارد که شایان توجه است: «ارزشگذاری و درآمد ما تنها پس از این موضعگیری افزایش مییابد.»

آیا این جمله یک بیانیه روابط عمومی است یا یک حکم تجاری؟ میتواند هر دو باشد، اما این دو با هم متناقض نیستند.

یک مثال نقض هم وجود دارد که باید بررسی شود. پالانتیر، شرکت دادهای که قبلاً به آن اشاره شد و از هوش مصنوعی برای کمک به آژانس مهاجرت فدرال در ردیابی اهداف استفاده میکرد، مسیر کاملاً متفاوتی را در پیش گرفت. این [سیستم/برنامه/...] عمیقاً با هر خواسته دولتی مطابقت داشت، و پذیرای ردیابی مهاجرت، تجزیه و تحلیل اطلاعاتی و هدفگیری نظامی بود. در نتیجه، تقریباً بیست سال توسط حلقه سرمایه جریان اصلیِ مسئولیتپذیر اجتماعی طرد شد، برای مدت طولانی قادر به جمعآوری پول نبود و توسط صندوقهای بزرگ طرد شد.

سپس، در سال ۲۰۲۴، زمانی که روایت نظامی هوش مصنوعی به داستان اصلی بازار تبدیل شد، قیمت سهام آن در عرض یک سال ۱۵۰ درصد افزایش یافت و ارزش بازار آن از ۴۰۰ میلیارد دلار فراتر رفت.

دو مسیر، دو سرنوشت، هر کدام با منطق خاص خود. پالانتیر بیست سال صبر را با انفجار امروز عوض کرد. شرکت آنتروپیک روی منطق ارزشگذاری متفاوتی شرط میبندد - در رقابت همگن و فزایندهی امروزی بین شرکتهای هوش مصنوعی، «امنترین هوش مصنوعی» فقط یک موضع اخلاقی نیست، بلکه یک خندق تجاری در دنیای واقعی است.

اینکه کدام شرط بزرگتر است هنوز مشخص نیست. اما آنتروپیک به وضوح معتقد است که هزینه مصالحه بیشتر از رد کردن است.

آیا شرط داریو میتواند نتیجه بدهد؟

پاسخ به این سوال به متغیرهای متعددی بستگی دارد که هنوز محقق نشدهاند.

اول، این پاسخ واقعی مشتریان سازمانی است. آیا آمازون، پالانتیر و آندوریل به دلیل برچسب «خطر زنجیره تأمین» به طور فعال کلود را قطع خواهند کرد یا ترجیح میدهند ساکت بمانند و منتظر تغییر اوضاع بمانند؟ در حال حاضر، این شرکتها بیانیه عمومی صادر نکردهاند. اگر آنها تصمیم بگیرند که صبر کنند و ببینند، ضرر واقعی آنتروپیک در واقع فقط همان قرارداد دولتی ۲۰۰ میلیون دلاری خواهد بود.

مورد بعدی، دشواری عملی جایگزینی دولت است. حتی دپارتمان خود پنتاگون که از کلود استفاده میکند، به طور داخلی اذعان میکند: کلود در حال حاضر یکی از قدرتمندترین مدلهای هوش مصنوعی موجود است، در حالی که گروکِ ماسک هنوز از نظر فنی از آن عقب مانده است. جایگزینی به معنای کاهش استفاده است. چه کسی این هزینه را متحمل خواهد شد؟

در نهایت، تأثیر غیرمنتظره و گسترده این موضوع وجود دارد. درست در روزی که آنتروپیک ممنوع شد، سم آلتمن، مدیرعامل OpenAI و توسعهدهندهی ChatGPT، علناً موضع خود را اعلام کرد: OpenAI و Anthropic در مورد مرز استفاده از هوش مصنوعی نظامی «خط قرمز یکسانی» دارند و هر دو شرکت موضع واحدی اتخاذ کردهاند.

به عبارت دیگر - اگر دولت به دنبال جایگزینی است که مایل به رعایت کامل و بدون هیچ محدودیتی باشد، گزینهها بسیار کمتر از حد تصور هستند.

روند مسلحسازی هوش مصنوعی به این دلیل کند نخواهد شد. گروکِ ماسک پیش از این به شبکه طبقهبندیشده پنتاگون نفوذ کرده است، سایر شرکتهای هوش مصنوعی نیز از قراردادهای نظامی بینصیب نماندهاند و سیستمهای تسلیحاتی مبتنی بر هوش مصنوعی همچنان در حال توسعه هستند.

انتخاب آنتروپیک این مسیر را تغییر نمیدهد. آنچه تغییر میکند، جایگاه آن در این مسیر است.

اما یک چیز قطعی است: این اولین بار در تاریخ صنعت هوش مصنوعی است که یک شرکت جریان اصلی آشکارا در برابر فشار دولت بر سر اصول صریح مقاومت کرده است - حتی اگر در نهایت بهای ممنوعیت فعالیت خود را بپردازد. صرف نظر از نتیجه این قمار، این سابقه اکنون وجود دارد.

آخرین مسئلهی محاسباتی که به خواننده واگذار میشود: یک شرکت با ارزش ۳۸۰ میلیارد دلار، به خاطر دو اصل مندرج در یک قرارداد، کل بازار دولتی را واگذار کرد و سپس به عنوان یک خطر امنیت ملی طبقهبندی شد.

در عصر تسلیحاتی شدنِ شتابگرفته توسط هوش مصنوعیِ امروزی، نحوهی محاسبهی این معادله بستگی به این دارد که چه چیزی را در آینده ارزشمندترین چیز میدانید.

ممکن است شما نیز علاقهمند باشید

اخبار صبحگاهی | OpenAI 110 میلیارد دلار سرمایهگذاری دریافت کرد؛ Solana Solana Payments را راهاندازی کرد؛ M0، MoonPay و PayPal به طور مشترک PYUSDx را راهاندازی کردند

تحلیل پس از لیست شدن CEX کره جنوبی در سال 2025: سرمایهگذاری در سکههای جدید = 70% ضرر؟

تحلیل BIP-360: اولین گام بیت کوین به سوی مصونیت کوانتومی، اما چرا فقط «گام اول»؟

۵۰ میلیون USDT در برابر ۳۵۰۰۰ دلار AAVE مبادله شد: فاجعه چگونه رخ داد؟ چه کسی را باید سرزنش کنیم؟

گفتگوی ویتالیک چیانگ مای: انفجار هوش مصنوعی، ارزهای دیجیتال باید برای چه چیزی بجنگند؟

بازار همچنان در حال سقوط است، بهترین زمان برای TGE چه زمانی است؟

الان سال ۲۰۲۶ است، چطور باید ارزش بازار L1 را به طور منطقی ارزیابی کنیم؟

نهادها به پذیرش ارزهای دیجیتال روی آوردهاند، اما فعالان به طرز غیرمعمولی ناامید هستند. چه کسی در نهایت پیروز خواهد شد؟

AWS دنیای مالی: چرا به بزرگترین برنده در عصر هوش مصنوعی و استیبلکوینها تبدیل میشود

وقتی همه در حال فروش سهام نرمافزار هستند، HSBC میگوید شما اشتباه میکنید

گزارش صبحگاهی | کالشی برای اولین بار علناً معاملات نهانی را مجازات میکند؛ STS Digital تأمین مالی 30 میلیون دلاری را تکمیل میکند؛ American Bitcoin گزارش مالی 2025 را اعلام میکند

کارآگاه بزرگ زاکاکسبیتی چگونه در حل پروندههای عجیب مهارت یافت؟

قیمت سهام بیش از ۳۵٪ افزایش یافت! گزارش مالی Circle فراتر از انتظارات است: گردش USDC با ۷۲٪ افزایش به اوج خود رسید

حل معضل زندانیان بین نسلی: مسیر اجتناب ناپذیر سرمایه ناپایدار بیت کوین

چرا بیت کوینی که قرار بود به ۱۵۰ هزار دلار برسد، به نصف کاهش یافت و مغز متفکر پشت آن در واقع جین استریت است؟

چه کسی هوش مصنوعی را کنترل خواهد کرد؟ چرا هوش مصنوعی غیرمتمرکز میتواند تنها جایگزین برای دولت و شرکتهای بزرگ فناوری باشد؟

هوش مصنوعی به زیرساختی حیاتی تبدیل شده است و دولتها و شرکتها برای کنترل آن با هم رقابت میکنند. توسعه و تنظیم متمرکز، ساختارهای قدرت موجود را تثبیت میکند. جامعه وب ۳ در حال ساخت یک جایگزین غیرمتمرکز است - محاسبات توزیعشده، مشوقهای توکن و مدیریت جامعه - قبل از بسته شدن آن پنجره.

«عمو توسط یک خرچنگ زخمی شد» که با فریب از ۴۴۰،۰۰۰ دلار فرار کرد، آیا عامل هوش مصنوعی واقعاً در نفوذ به سیستم اینقدر خوب است؟

پیشبینی آرتور هیز برای قیمت Bitcoin تا 2027: رسیدن به $750,000 به دلیل چاپ پول

نکات کلیدی آرتور هیز پیشبینی میکند که قیمت Bitcoin تا سال 2027 به $750,000 خواهد رسید. هیز تاکید…